前言

根据R1的GitHub可知

| 类别 | 开源内容 | 未开源内容 |

|---|---|---|

| 模型权重 | R1、R1-Zero 及蒸馏模型权重(MIT 协议) | 原始训练数据 未公开冷启动数据、RL 训练数据集或合成数据的具体内容,仅提供依赖的公开数据集名称(如 AI-MO、NuminaMath-TIR) |

| 技术文档 | GRPO 算法、奖励系统设计、冷启动流程等技术报告 | 训练代码,比如分布式训练代码细节 |

| 训练工具 | 合成数据生成脚本、评估基准代码 | 完整 RL 训练框架 |

| 推理支持 | API 接口、本地部署方案、框架适配指南 | 生产级优化内核 即动态显存管理、生产级批处理等企业级部署工具未开源 |

可以看到,R1并未开源关键的训练数据和训练代码,好在如此文《复现DeepSeek V3——在V3官方代码库对MoE、MLA的推理代码之外,补充我对多token预测MTP训练代码的实现》所说,有个Open R1的开源项目,本文便基于Open R1复现正式版的R1

以下是本文的编写过程

- 2.13,完成本文的基本框架,包括Open R1项目的介绍(含OpenR1-Math-220k数据集),以及安装/训练/评估等

- 2.14,要想复现R1,算法层面得先有GRPO的实现,好在TRL库实现了,故在此文的第三部分 好好解读了下TRL包中实现的GRPO源码

- ..

第一部分 Open R1:以Qwen2.5-1.5B为基础,封装各种开源框架

1.1 Open R1分别对外开源的内容

1.1.1 GRPO的实现、数据生成器

Open R1复现了R1正式版完整训练流程的前两个阶段「以Qwen2.5-1.5B为基础,以deepseek-R1的训练过程打造」,并把代码开源了,其GitHub仓库主要包括GRPO的实现、训练与评估代码、用于合成数据的生成器

具体而言,涉及如下

- src/open_r1:自身实现的4个独立脚本,用于训练和评估模型以及生成合成数据的脚本,这4个独立脚本具体如下所示

1) grpo.py:在给定的数据集上使用 GRPO 训练模型

2) sft.py:在数据集上执行模型的简单 SFT

3) evaluate.py:在 R1 基准上评估模型

4) generate.py:使用Distilabel从模型生成合成数据 - 封装了Transformer框架,和RL框架TRL

TRL这个框架我曾在我这篇文章里介绍过,其支持SFT、PPO、GRPO等训练方法

换言之,Open R1并没有再去实现一遍GRPO——也没必要,而是直接用的TRL框架中对GRPO的实现 - 封装了计算图distilabel框架,和MegFlow类似,内部用 networkx 实现 DAG

比如open-r1 用 distilabel 加载目标 LLM、造 QA 数据。 例如用 qwen-7B时:python3 src/open_r1/generate.py --hf-dataset /data/share/NuminaMath-TIR --model Qwen2.5-7B-Instruct --prompt-column problem - 封装了评测方法 lighteval

evaluation 框架基本模式,都是加载 dataset、运行模型、打满吞吐、打印精度表。推理期间包装不同的 inference repo - 封装了底层推理框架vLLM

1.1.2 对R1训练流程前两个阶段的复现(SFT和GRPO训练)

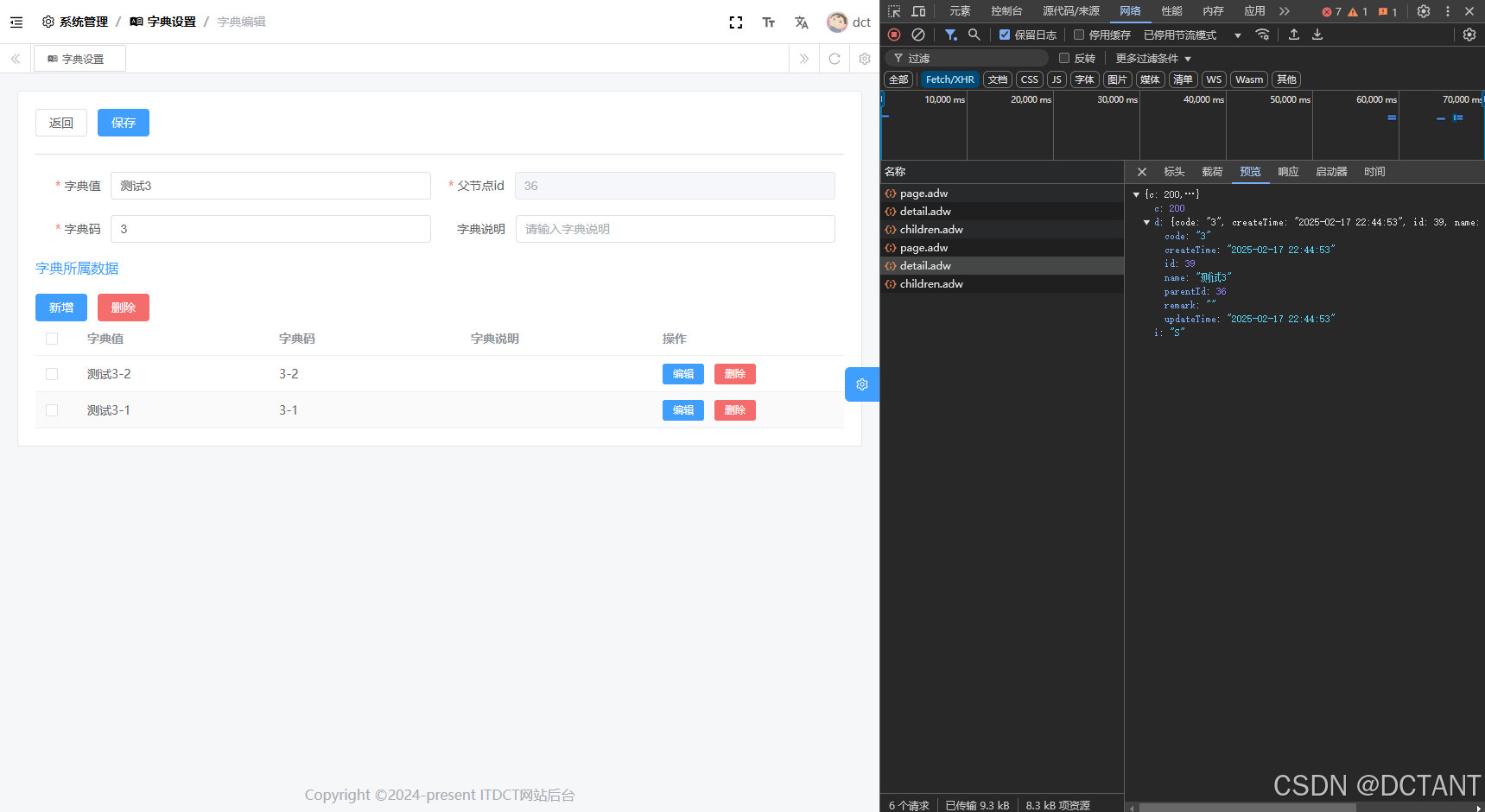

如下图所示,Open R1分别实现了

- 从 DeepSeek-R1 中提取高质量语料库来复现 R1-Distill 模型

这里有个很重要的问题是,到底如何从R1中提取高质量语料库

其实如Open R1的GitHub所说,从 DeepSeek-R1 提炼出的具有推理轨迹的数据集(例如Bespoke-Stratos-17k)上运行 SFT - 基于DeepSeek V3 创建 R1-Zero 的纯 RL 管道

- 复现R1正式版完整训练流程的前两个阶段(SFT + 规则奖励下的RL)——毕竟完整的R1正式版训练流程有4个阶段呢

而其中比较有价值的便是对GRPO的实现阶段一 冷启动SFT 阶段二 规则奖励下的RL R1-Zero模型生成的冷启动数据:微调V3 面向推理的RL:结合三个规则奖励——准确率奖励、格式奖励、语言一致性奖励 阶段三 增强SFT 阶段四 规则+偏好奖励下的RL 来自阶段二模型的60w推理数据

和V3模型的20w非推理数据:微调V3

全场景RL

规则奖励、偏好奖励

我司也会在这个课程《DeepSeek原理与项目实战营》里讲一下这个Open R1的复现思路,及深入解读其源码,以帮助更多人可以更好的用好该Open R1

1.2 Open R1对外开源的OpenR1-Math-220k数据集

1.2.1 Math-220k与现存推理数据集的比较

如此文《一文速览火爆全球的推理模型DeepSeek R1:如何通过纯RL训练以比肩甚至超越OpenAI o1(含Kimi K1.5的解读)》所说

作者还实验了蒸馏——赋予小模型推理能力

- 方法是直接使用 DeepSeek-R1 阶段三中精心挑选的 80 万个样本对开源模型如 Qwen(Qwen, 2024b)和 Llama(AI@Meta,2024)进行了微调

- 这80万样本中包含来自R1 4阶段训练中阶段二模型的60w推理数据

最终,通过这「60w推理数据+20w非推理数据」对小模型做微调,也能让小模型即便不经过专门的RL训练也能获得不俗的推理能力,比如DeepSeek-R1-32B和DeepSeek-R1-70B在大多数基准上明显优于o1-mini

遗憾的是,R1并未开源这60万条推理数据

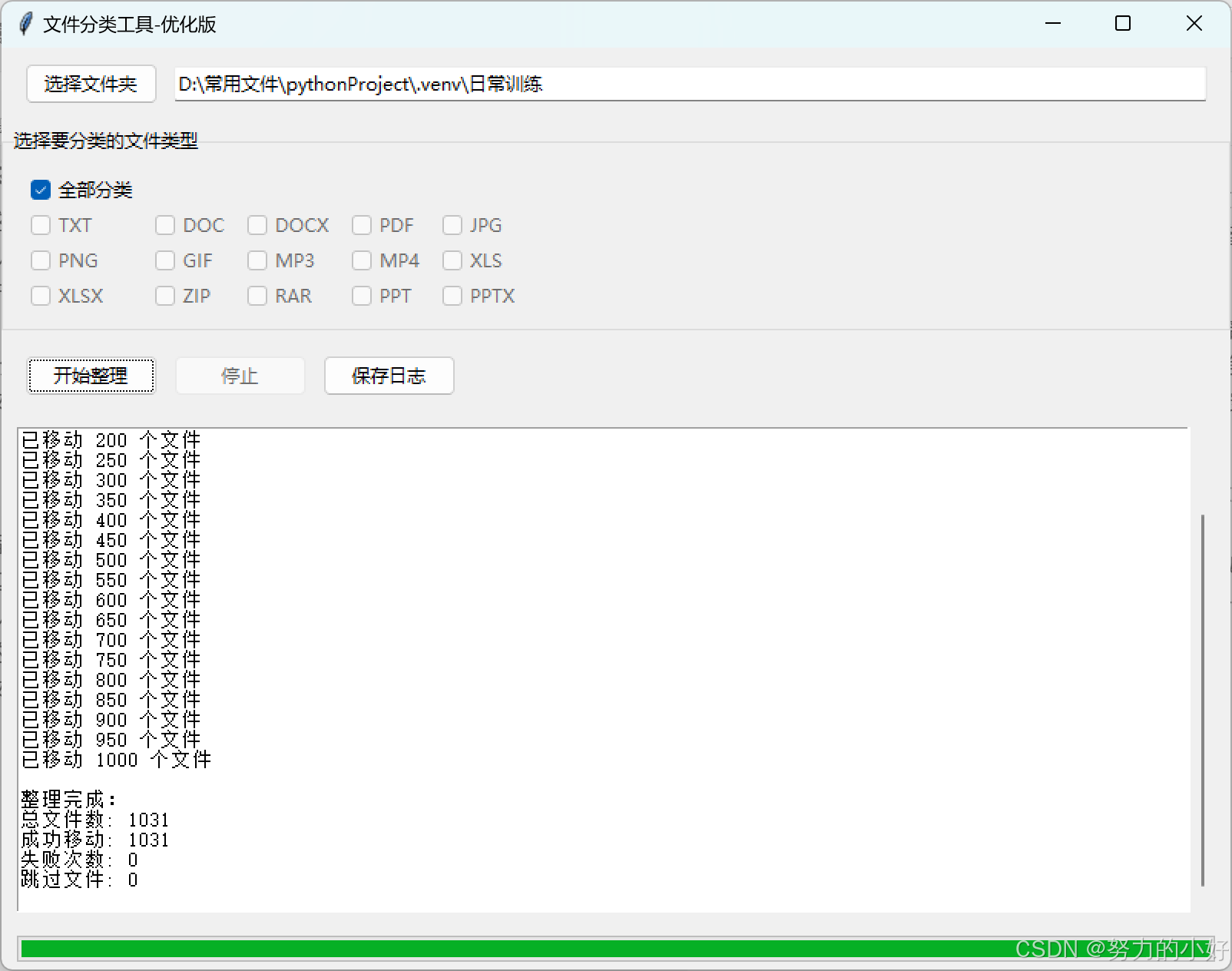

OpenR1-Math-220k 数据集就是来补上这块空缺的。具体而言,Open R1 团队使用 DeepSeek R1 生成了 80 万条推理轨迹,经过筛选和验证后得到了 22 万条高质量数据

虽然在此之前,目前市面上开源的推理数据集包括:OpenThoughts-114k、Bespoke-Stratos-17k、Dolphin-R1 和 LIMO 等多个推理数据集

那与现有数据集相比,OpenR1-Math-220k数据集有什么新的特点呢

- 80 万条 R1 推理轨迹

使用 DeepSeek R1 为 40 万个问题各生成了两个答案,最终经过筛选后保留了 22 万个具有正确推理轨迹的问题 - 本地运行 512 个 H100

没有依赖 API,而是在计算集群上利用 vLLM 和 SGLang 本地运行生成任务,每天可以生成 18 万条推理轨迹 - 基于 NuminaMath 1.5

专注于数学推理公式,为 NuminaMath 1.5(NuminaMath-CoT 数据集的改进版本)中的问题生成答案 - 自动过滤

Open R1 团队通过数学验证,只保留至少有一个正确答案的问题,还让 Llama3.3-70B-Instruct 作为「判官」,以筛选出更多正确的样本,特别是那些因格式错误而无法通过基于规则的解析器验证的答案 - 在 OpenR1-Math-220k 训练出来的 Qwen-7B-Math-Instruct,达到了与 DeepSeek-Distill-Qwen-7B 相当的性能

总之,OpenR1-Math-220k数据集分为如下两个部分

- default(94k 问题):这部分数据在经过监督微调(SFT)后表现最佳

- extended(131k 问题):这部分数据包含额外的 NuminaMath 1.5 数据源,例如 cn_k12,提供了更多的推理公式

研究发现这个子集在经过监督微调后的性能低于默认数据集,作者认为可能是因为 cn_k12 中的问题相对简单

1.2.2 OpenR1-Math-220k数据集的创造过程:生成、过滤、评估

首先,对于数据生成

他们为了构建数据集,OpenR1 团队让 DeepSeek R1 为来自 NuminaMath 1.5 的 40 万个问题生成答案。他们遵循了 DeepSeek 技术报告中推荐的参数设置,并在提示词前添加了以下指令:

Please reason step by step, and put your final answer within \boxed{}.且为了确保生成过程的高效性,团队将每次生成的 tokens 限制设置为 16k。经过分析发现,只有 75% 的问题能够在 8k tokens 内解决,而大多数剩余问题需要完整的 16k tokens

- 最初,他们使用 vLLM 进行推理,每个 H100 节点每秒可以生成 15 个答案(相关生成脚本已分享在 OpenR1 仓库中)

- 最近,他们又开始尝试使用 SGLang,每个 H100 节点每秒可以生成 25 个答案(速度提升了近两倍),这使得 512 个 H100 节点上每天能生成 30 万个问题的答案

- 为了在后续的过滤和优化过程中提供更大的灵活性,团队为每个问题生成了两个答案 —— 有时甚至生成四个

这样一来,不仅复刻出了类似于 DeepSeek R1 允许进行拒绝采样的方法,还能使数据集能够适用于如 DPO 等偏好优化方法

对应的数据生成脚本在此:huggingface/open-r1/tree/main/slurm

其次,对于数据过滤

即为了确保数据集中只包含高质量且正确的推理结果,Open R1 团队设计了一套数学验证系统,用于自动比对 LLM 生成的复杂数学表达式答案与数据集中的标准答案

- 在这个过程中,OpenR1 团队发现大约 55% 的问题至少有一个正确答案。然而,NuminaMath 1.5 数据集中有很多答案是空的,或者格式不符合验证标准,这都给自动验证带来了困难

- 为了解决这些问题,Open R1 团队先是对 Math-Verify 工具进行了改进,使其能够处理更多不常见的答案格式,再使用 Llama-3.3-70B-Instruct 模型进行二次评估

具体来说,对于那些被 Math-Verify 判定为错误的答案,使用 Llama-3.3-70B-Instruct 模型重新评估,识别实际上正确但因格式问题被错判的答案

最终,他们找回了 2.5 万条被「误判」的数据 - 优化 Math-Verify 工具:对 Math-Verify 工具进行了改进,使其能够处理更多不常见的答案格式

让 Llama-3.3-70B-Instruct 「作判官」的提示词如下:You are a mathematical answer validator. You will be provided with a mathematical problem and you need to compare the answer in the reference solution, and the final answer in a model's solution to determine if they are equivalent, even if formatted differently.PROBLEM:{problem}REFERENCE SOLUTION:{answer}MODEL'S SOLUTION:{generation}Focus ONLY on comparing the final mathematical answer provided by the model while ignoring differences in:- Formatting (e.g., \\boxed{{}} vs plain text) - Multiple choice formatting (e.g., "A" vs full solution) - Order of coordinate pairs or solutions - Equivalent mathematical expressions or notation variations - If the model's answer is nonsense, return "Verdict: AMBIGUOUS"Start with a brief explanation of your comparison (2-3 sentences). Then output your final answer in one of the following formats:- "Verdict: EQUIVALENT" - "Verdict: DIFFERENT" - "Verdict: AMBIGUOUS" - 对于那些包含多个正确答案的数据行,团队尝试使用奖励模型(RM)作为最终筛选器来选择最佳答案。具体操作如下:

首先,从每个包含多个正确答案的数据行中,去掉(<think>…</think>),提取最终答案;

第二,将问题和提取的答案输入到配置了 vLLM 的 Qwen/Qwen2.5-Math-RM-72B 模型中,获取每个答案的评分

接着,根据模型评分,对每个包含多个正确答案的数据行排名,选择排名最高的答案纳入训练数据集

遗憾的是,消融实验表明,这种方法并没有比随机选择一个正确答案带来更好的模型性能。Open R1 团队的判断是,可能在使用奖励模型评分时,不仅要考虑最终答案,还要包括推理过程

最后,对于效果评估上

Open R1 在 OpenR1-Math-220k 的基础上,对 Qwen2.5-Math-Instruct 进行了 3 轮微调,学习率为 5e-5

- 为了将上下文长度从 4k 扩展到 32k,他们将 RoPE 频率提高到 300k。训练遵循线性学习率调度,其中包含 10% 的预热阶段

- 下表展示了在 lighteval 上 OpenR1-Qwen-7B、DeepSeek-Distill-Qwen-7B 和 OpenThinker-7B 的性能对比,可以看出在数学成绩上,OpenR1-Qwen-7B 和 DeepSeek-Distill-Qwen-7B 差距不是非常明显

第二部分 Open R1的安装、训练、评估

2.1 环境搭建与依赖安装

Open-R1 项目依赖 CUDA 12.1

- 创建虚拟环境并升级 pip

可使用uv工具创建 Python 虚拟环境,安装uv后执行如下命令(uv安装文档 https://docs.astral.sh/uv/getting-started/installation/)uv venv openr1 --python 3.11 && source openr1/bin/activate && uv pip install --upgrade pip - 安装 vLLM:CUDA 12.1 环境下,运行下面的命令

uv pip install vllm==0.6.6.post1`` ``# For CUDA 12.1``pip install vllm==0.6.6.post1 --extra-index-url https://download.pytorch.org/whl/cu121``export LD_LIBRARY_PATH=$(python -c "import site; print(site.getsitepackages()[0] + '/nvidia/nvjitlink/lib')"):$LD_LIBRARY_PATH - 安装其余依赖:根据具体使用场景,执行

pip install -e.[LIST OF MODES]

对于多数开发者,建议使用

pip install -e ".[dev]" - 登录账号与检查 Git LFS:登录 Hugging Face 和 Weights and Biases 账号,分别执行

检查系统是否安装 Git LFS,若未安装,使用sudo apt-get install git-lfs进行安装huggingface-cli login``wandb login

2.2 模型训练

2.2.1 SFT阶段:可通过Bespoke-Stratos-17k微调Qwen2.5-Math-1.5B-Instruct

Open-R1 支持 DDP 和 DeepSpeed(ZeRO-2、ZeRO-3)两种训练方式,切换时只需调整configs文件夹中加速器 YAML 配置文件路径。以配备 8 块 H100(80GB)显卡的节点为例,训练命令如下:

SFT 的代码在下述代码文件里

accelerate launch --config_file=configs/zero3.yaml src/open_r1/sft.py

简言之

- 可以先下载HuggingFaceH4/Bespoke-Stratos-17k数据集

「数据集地址:https://huggingface.co/datasets/bespokelabs/Bespoke-Stratos-17k」 - 然后再下载Qwen/Qwen2.5-Math-1.5B-Instruct模型

- 之后,基于上面的数据集做对该模型做SFT

具体SFT时,一般涉及以下步骤

- 加载数据集和tokenizer

# Load datasets dataset = load_dataset(script_args.dataset_name, name=script_args.dataset_config)# Load tokenizer tokenizer = AutoTokenizer.from_pretrained(model_args.model_name_or_path, trust_remote_code=model_args.trust_remote_code, use_fast=True ) tokenizer.pad_token = tokenizer.eos_token - 配置模型参数

- 设置训练器

# Initialize the SFT Trainer trainer = SFTTrainer(model=model_args.model_name_or_path, # 指定模型路径args=training_args, # 指定训练参数train_dataset=dataset[script_args.dataset_train_split], # 指定训练数据集eval_dataset=dataset[script_args.dataset_test_split] if training_args.eval_strategy != "no" else None, # 指定测试数据集processing_class=tokenizer, # 指定tokenizerpeft_config=get_peft_config(model_args),callbacks=get_callbacks(training_args, model_args), ) - 训练与保存

过程中,若使用 Slurm 调度系统,可运行

sbatch --output=/path/to/logs/%x-%j.out --err=/path/to/logs/%x-%j.err slurm/sft.slurm {model} {dataset} {accelerator}

2.2.2 GRPO阶段:可通过NuminaMath-TIR数据集对R1-Distill-Qwen-7B做RL训练

首先是数据集、模型权重的下载

- 可以先下载AI-MO/NuminaMath-TIR数据集

数据集地址:https://huggingface.co/datasets/AI-MO/NuminaMath-TIR - 然后再下载deepseek-ai/DeepSeek-R1-Distill-Qwen-7B

初始模型权重地址:https://huggingface.co/deepseek-ai/DeepSeek-R1-Distill-Qwen-1.5B/tree/main

下载完成后注意修改recipes/qwen/Qwen2.5-1.5B-Instruct/grpo/confg_full.yaml中的model_name_or_path和dataset_name,以匹配模型和数据集的位置

然后修改num_processes,如果你有8块GPU,需设置为7(因为vllm需要占用一块GPU),以此类推。(如果只有一块GPU,建议直接将use_vllm改为false,然后将num_processes改为1) - 之后使用上面的数据集对该模型做RL训练——RL算法用GRPO

在Open R1中,整个GRPO的流程被封装在TRL库中,用户可以直接调用

accelerate launch --config_file configs/zero3.yaml src/open_r1/grpo.py

接下来,咱们便来具体看下GRPO的训练过程

- 首先是,奖励函数,包括两个:准确率奖励(accuracy_reward)和格式奖励(format_reward)。准确率奖励意味着解题越准确,分数越高;格式奖励意味着输出的格式越标准,分数越高

// 待更 - 加载数据集、设置奖励函数、设置模型

# Load the dataset dataset = load_dataset(script_args.dataset_name, name=script_args.dataset_config)# Get reward functions reward_funcs = [reward_funcs_registry[func] for func in script_args.reward_funcs]torch_dtype = (model_args.torch_dtype if model_args.torch_dtype in ["auto", None] else getattr(torch, model_args.torch_dtype) ) model_kwargs = dict(revision=model_args.model_revision,trust_remote_code=model_args.trust_remote_code,attn_implementation=model_args.attn_implementation,torch_dtype=torch_dtype,use_cache=False if training_args.gradient_checkpointing else True, ) training_args.model_init_kwargs = model_kwargs - 设置trainer

# Initialize the GRPO trainer trainer = GRPOTrainer(model=model_args.model_name_or_path, # 指定模型路径reward_funcs=reward_funcs, # 指定奖励函数args=training_args,train_dataset=dataset[script_args.dataset_train_split], # 指定训练集eval_dataset=dataset[script_args.dataset_test_split] if training_args.eval_strategy != "no" else None,peft_config=get_peft_config(model_args), # 指定PEFT配置callbacks=get_callbacks(training_args, model_args), # 指定回调函数 ) - 训练和保存

// 待更

2.3 模型评估

// 待更

第三部分 Open R1的相关源码解读

// 待更