一、研究背景

视觉与语言导航(VLN)是一个AI领域的研究任务,旨在开发能够按照自然语言指令在三维空间中导航到指定位置的智能体。这项任务与人类的日常活动——如按照口头指示到达某个地点——十分相似,对于推动人机交互的自然性和实用性具有重要意义。大多数现有的研究假设用户提供的语言指令总是正确无误的。然而,现实生活中,人们在给出方向时往往会犯错,如将“左转”误说成“右转”。此外,指令的复杂性和人们在空间认知能力上的差异也可能导致错误的发生。错误的指令会直接影响导航任务的成功率。智能体如果严格遵循错误的指令,很可能无法到达目标位置,或者在错误的路径上浪费大量时间和资源。

为了解决这些问题,研究者提出了交互式视觉与语言导航(IVLN-CE)。与传统的VLN任务不同,IVLN-CE允许智能体在执行任务过程中与用户进行交互,以验证和纠正可能的指令错误。这种模式不仅可以提高导航的准确性,还可以通过实时纠错减少用户的等待时间和潜在的挫败感。

论文还讨论了人类如何利用认知映射来处理和记忆环境信息,这对于理解指令错误的根源和设计更好的交互式导航系统具有启示作用。人们的空间认知能力差异意味着智能体需要能够处理各种不精确或错误的空间信息。

二、当前难点

- 错误检测和定位

错误检测和定位是视觉与语言导航中的一个核心问题,尤其是在交互式环境中。在现有的研究中,智能体往往在导航完成后才能识别出指令中的错误,这种模式称为离线模式。这意味着智能体在执行任务过程中,一旦走错了路线,就无法及时获得反馈并修正错误,从而可能导致任务失败。此外,由于这种错误检测和定位发生在事后,用户和智能体之间缺乏有效的实时交互,这限制了系统在实际应用中的灵活性和有效性。

- 实时交互的复杂性

实时交互是提高智能体导航效率和正确率的关键因素,但这也带来了显著的挑战。首先,智能体需要在没有完整场景观察的情况下,即时识别和定位指令中的潜在错误。这要求智能体具备高度的语境理解能力和即时反应能力。其次,频繁的交互可能会对用户造成干扰,增加其认知负担。例如,如果智能体需要用户频繁确认指令的准确性,这可能会打断用户的其他活动,影响用户体验。因此,如何设计一个既能有效检测和定位错误,又能在保持用户交互简洁性和低干扰性的系统,是当前研究的一个主要难点。

三、技术方案

I2EDL(Interactive Instruction Error Detector and Localizer)是一个用于交互式视觉和语言导航(IVLN-CE)的模型,它能够在线检测和定位自然语言指令中的错误。智能体在执行任务过程中,通过与用户的交互来验证指令的正确性,并及时纠正错误。这种方法能够在不增加用户认知负担的前提下,提高导航的准确性和效率。

- 错误检测和定位的技术实现

预训练模块:I2EDL利用预训练的深度学习模型来分析指令文本和智能体的视觉观察数据。这种模型结合了自然语言处理和计算机视觉技术,能够理解复杂的指令和识别与指令相关的视觉对象。

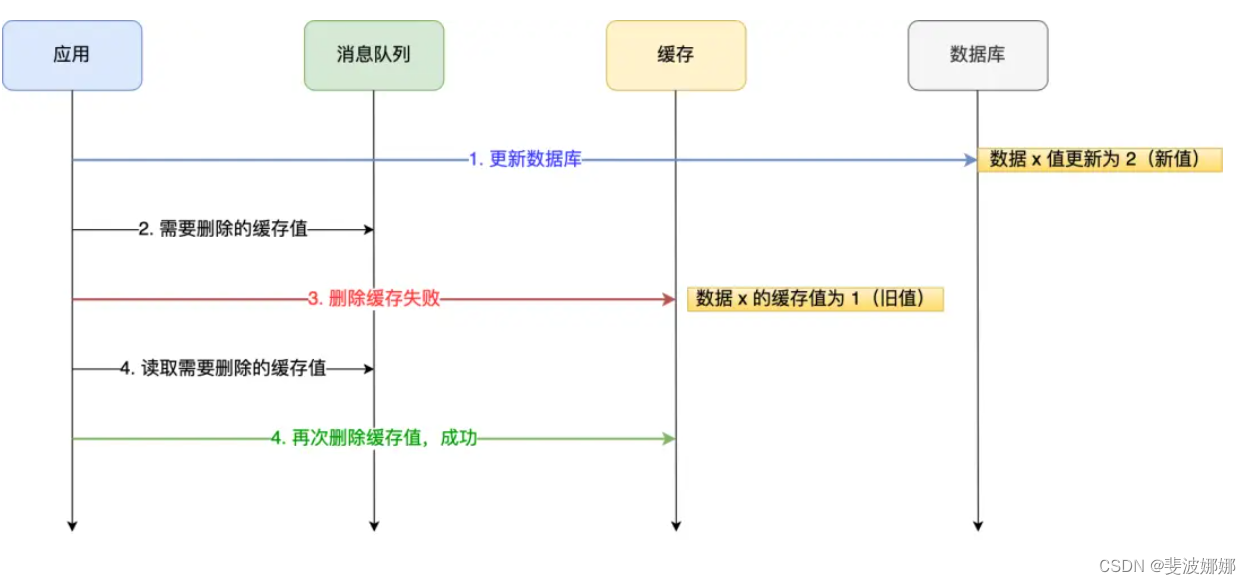

实时交互机制:当模型检测到指令中可能存在的错误时,智能体会主动向用户提问,确认指令中特定词汇或短语是否正确。如果用户确认存在错误,智能体会请求用户提供正确的指令部分,然后更新其导航策略。

错误定位:I2EDL模型不仅能检测出错误,还能精确地定位到错误所在的具体位置。这通过分析语言指令与视觉观察之间的不一致性来实现,从而确保智能体提出的问题尽可能具体和相关,减少用户解答的难度。

四、实验结果

Taioli F, Rosa S, Castellini A, et al. I2EDL: Interactive Instruction Error Detection and Localization[J]. arxiv preprint arxiv:2406.05080, 2024.