🍉 CSDN 叶庭云:https://yetingyun.blog.csdn.net/

归纳偏好(Inductive Bias)是机器学习中的一个非常基础但又非常重要的概念。为了更好地理解它,我们先从 “归纳” 和 “偏好” 这两个词开始讲解。

什么是归纳(Induction)?

我们先来理解 “归纳” 是什么。在日常生活中,归纳指的是通过观察一些具体的事例,然后推测出一个一般性的规律或结论。例如,假设你在一个公园里看到了 10 只鸟,每只鸟都是红色的,那么你可能会归纳出 “所有的鸟都是红色的”。这种从具体到一般的推理方式就是归纳。

在机器学习中,归纳指的是从有限的数据中推断出普遍适用的规律。换句话说,算法需要从已有的训练数据中学习出模型,以便它可以在没有见过的新数据上做出预测。

什么是偏好(Bias)?

“偏好” 这个词通常意味着某种倾向或者偏向,它是对某些选择的倾向性偏爱。在机器学习中,偏好指的是模型在做预测时倾向于选择某些特定的假设或解释,而不是其他可能的假设。比如,当我们用机器学习算法来预测未来的趋势时,模型可能会偏好某种方式的预测,而忽略其他不符合的方式。

归纳偏好是什么?

归纳偏好(Inductive Bias)指的是机器学习算法在从有限数据中推断出规律时,所固有的偏好或假设。也就是说,归纳偏好就是算法在做推理时内置的 “假设” 或者 “假定” 条件,它决定了在面对不完整或者不确定的数据时,算法会如何做出预测。

在没有完全的知识和数据的情况下,算法需要做出一些 “假设”,这些假设帮助它做出更合理的预测。例如,假设我们有一个算法来预测一个房屋的价格。如果训练数据表明房价与房屋的大小有关,那么这个算法可能会有一个归纳偏好,假设 “房屋越大,价格越贵”。这种偏好可能并不是绝对正确的,但它帮助算法在没有更多信息时做出预测。

归纳偏好的作用

归纳偏好的核心作用是帮助机器学习模型在面对有限的、甚至是不完美的数据时做出更合理的假设,从而推断出更普适的规律。例如:

-

模型的简化假设:归纳偏好常常会限制模型的复杂性,帮助它避免过度拟合训练数据(即记住所有细节而忽视更一般的规律)。

-

提高泛化能力:归纳偏好通过对模型进行合理的假设,使得它能够在新数据上进行更好的预测,而不仅仅是 “记住” 训练数据。

归纳偏好的例子

-

线性假设:假设你正在用一条直线来预测两个变量之间的关系,比如预测房价和面积之间的关系。你可能会假设它们之间是线性关系 —— 即面积越大,房价越贵。如果你的算法基于这种假设进行训练,这就是它的一种归纳偏好。

-

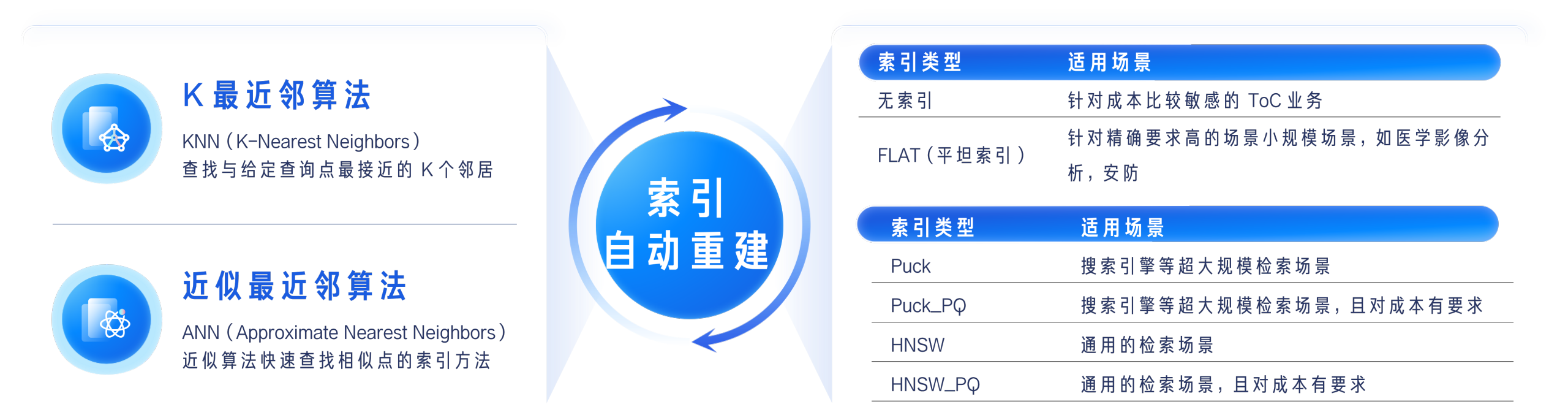

平滑性假设:如果一个算法认为相似的输入应该对应相似的输出(比如说相似的图片应该被分类为同一类),这就是一种归纳偏好。例如,KNN(K 最近邻)算法就有这种归纳偏好,它认为相似的样本点应该具有相似的标签。

-

正则化:正则化是一种技术,用于防止模型在训练数据上过度拟合。这种技术本质上是在加一个归纳偏好,即 “模型不应该过于复杂,应该尽量保持简洁”。

归纳偏好带来的挑战

尽管归纳偏好在很多情况下是有用的,但它也会带来一些挑战。例如:

-

假设的偏差:如果我们对数据做出了不恰当的假设(比如假设房价和面积之间的关系是线性的,但实际情况是非线性的),模型可能会出现偏差,做出错误的预测。

-

偏好过强:如果归纳偏好过于强烈,比如强制模型采用某种简单的假设,可能会导致模型无法捕捉到数据中的复杂模式,从而失去预测的准确性。

-

依赖于数据的质量:归纳偏好使得算法依赖于我们所做的假设。如果我们做的假设本身就不准确或不完整,模型的表现就会受到影响。

总结

归纳偏好是机器学习算法在有限数据上推断规律时的 “内置假设”,它使算法能够面对不完整数据做出合理预测。归纳偏好的合理性直接影响模型性能。因此,理解归纳偏好对于设计和选择合适的模型至关重要,特别是在确保模型能在新数据上泛化时。