前言:磕磕绊绊,不过收获很多,最大的收获就是解决报错error的分析方法和解决思路

1、首先,我参考的是这篇博客:怎样训练一个自己的大语言模型?全网最简单易懂的教程!_开源模型训练出一个语言模型-CSDN博客

2、然后,我在其中遇到了大概5-6个error,基本都在我的文章中有所总结,包括对应的解决思路。

3、最后,这虽然并不是我所需要的实验,但是能够我后续熟练使用lora带来很多帮助,后续我也会对这些代码进行详细分析,然后化为己有——用LoRA成功微调出我想要的东西:

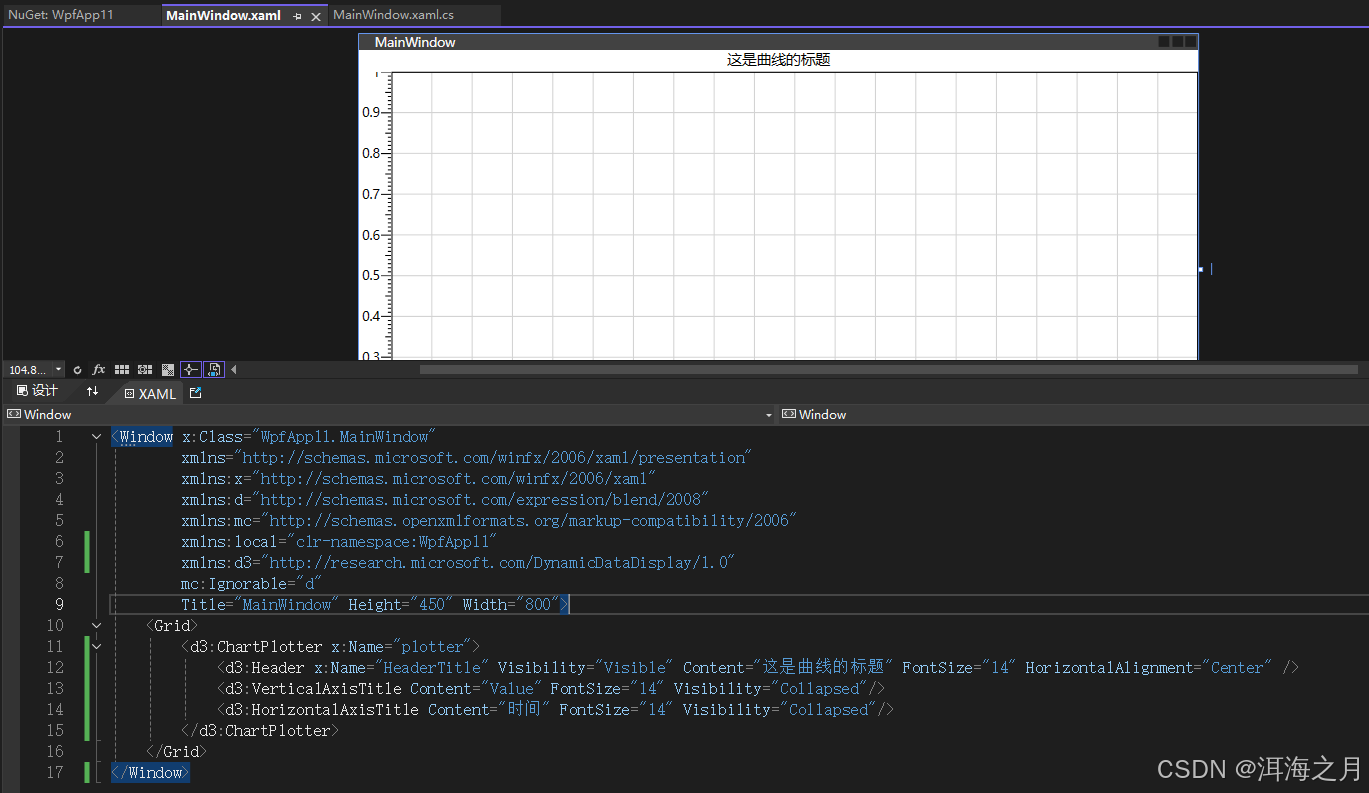

-保存的模型结果如下:

第一次,只是保存了adpater部分的权重:(文件只有141MB左右)

第二次,将这个adpater权重和原来llama2的权重合并:(文件就是13G左右了)