原文:ChatGPT细说从头(十四):思维链 - 知乎

引言

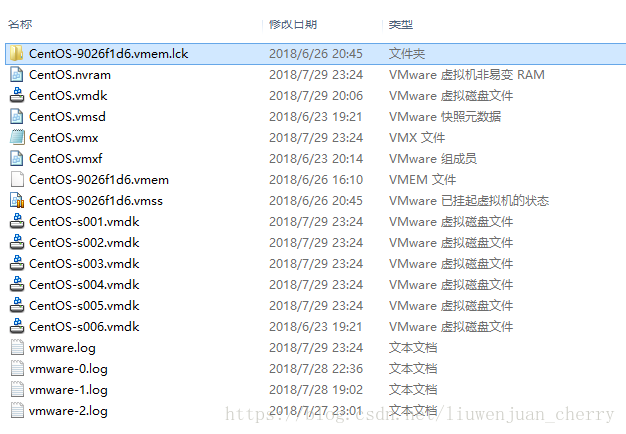

ChatGPT刚推出的时候,大家会发现它在数学运算方面表现不佳,因为复杂的数学问题需要多步推理过程,但没过多久就发现它有了重要提升,而且回答方式也有了显著的变化。这种变化的背后就是思维链技术。

推理系统

人类的决策行为其实分为系统一(System1)和系统二(System2)两种截然不同的类型。这两种决策系统一起配合来提升人类整体的决策行为。系统一具有速度快、下意识、可能存在错误等特点,它在日常生活中经常使用,例如驾驶车辆时。系统二则速度慢、有意识、需要经过多步骤推理,因此比较可靠。当我们在下棋、做复杂的数学运算、学习弹钢琴等时候,我们在使用系统二。系统一比较感性,系统二比较理性,但往往我们并不接受系统二。

系统一和系统二

图片来自网络

大模型

人工智能在感知方面,例如人脸识别、物体检测等领域已经达到甚至超过了人类表现,但是逻辑推理一直是人工智能的弱项方面。虽然还有很大的进步空间,但是ChatGPT已经表现出比前辈模型更强的能力,而且它可以通过指令快速学习和进化。其实不仅是ChatGPT,其他大模型也在逻辑推理方面取得了重要突破,逻辑推理能力也是新一轮人工智能浪潮的热点,当人工智能可以进行逻辑推理,它可以帮助人类完成更多事情。

通过之前的文章我们了解到大模型已经事实上带来了一次新的人工智能革命。随着模型越来越大,性能和能力不断增强。但是在数学、常识和符号推理等方面,仍然是大模型的弱项。我们认为大模型已经比较擅长完成系统一任务,但是完成系统二任务的能力并不能随着模型大小增长而提升。

大模型已经具备了强大的通过自然语言提示词进行上下文小样本学习能力,那它能否通过这种方式补强系统二任务的推理能力呢?

思维链

人类解决复杂推理问题是将其分解为一些中间问题然后逐步解决,最后得到最终结果,也称为“自顶向下,逐步求精”(top down stepwise refinement)。思维链(Chain-of-Thought)就是参考人类解决问题的方法,从输入问题开始的一系列自然语言形式的推理过程,直到得到最后输出结论。和之前的提示词模式(问题,答案)不同,思维链提示词模式即(输入问题、思维链、输出结论)。

下图左边是一般的提示词方法,通过给大模型输入一个样例,大模型就能学会这个新的任务,这种提示词是直接给出答案,在复杂推理时会容易出错。下图右边是思维链提示词,和前面不同的是在给出的样例(蓝色)时,增加了推理步骤,直到得到最后答案。这时大模型也会采用类似的方式(绿色)给出推理过程和答案。实验证明,这种方式可以大幅度提升大模型在复杂推理时的准确率。

思维链提示词

图片来自网络

大模型生成推理过程的能力在ChatGPT之前已由艾伦人工智能研究院实现,通过思维链提示词就可将大模型这种能力激发出来。

大模型实现推理能力

图片来自网络

总结

思维链提示词大幅提升了大模型复杂推理能力的准确度,而这只是提示词的一种使用技巧,一定还有更多的方式等我们去发现。另外这只是通用人工智能的一小步,从系统一到系统二将是人工智能下面的重点研究方向。