目录

导语

ChatGPT的应用场景

ChatGPT的局限性

ChatGPT的发展前景

总结

导语

作为一款基于人工智能的自然语言处理(NLP)聊天机器人程序,ChatGPT通过大量来自互联网的文本进行训练,并使用深度学习和机器学习算法来理解用户的问题并提供回答。并且,ChatGPT还内置了情感分析、关键字提取和实体识别等功能,可以检测对话情绪,这有助于它对客户的询问做出适当的回应。

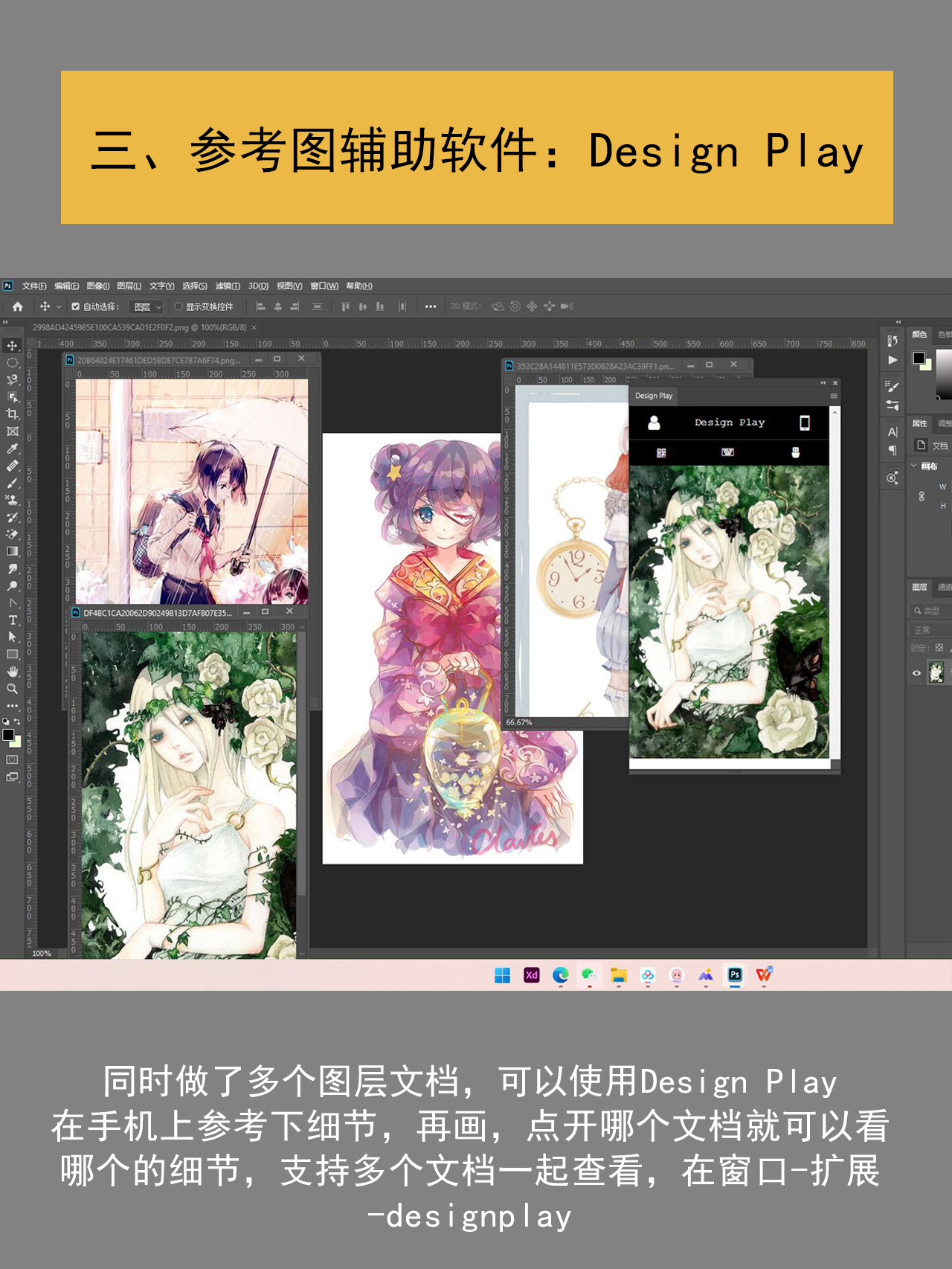

ChatGPT的应用场景

下面是ChatGPT的一些常见应用场景:

1. 回答常见问题:ChatGPT可以回答各种常见问题,如天气查询、国家信息、历史事件、科学知识等。你可以向ChatGPT提出问题,它会尽力给出有用的答案。

2. 写作支持:无论是写文章、写作业还是进行创作,ChatGPT都可以提供文本生成的协助。你可以向ChatGPT描述你的需求或提供初始的段落,它会提供下文、阐述观点或提供灵感。

3. 语言翻译:如果你需要进行语言翻译,ChatGPT可以帮助你将文本或短语翻译成其他语言。

4. 编程支持:如果你遇到编程问题或需要帮助解决编程难题,ChatGPT可以提供一些参考和指导。你可以向ChatGPT描述你的问题,它可以提供代码片段、建议和解释。

5. 旅行规划:如果你正在计划旅行,ChatGPT可以提供旅行目的地的建议、景点推荐、预订信息等帮助。

6. 社交对话:ChatGPT可以与你进行闲聊,回答一些非技术性的问题,分享笑话、故事或进行日常对话,以增添一些趣味和娱乐。

需要注意的是,尽管ChatGPT具有强大的语言理解和生成能力,但它并非全知全能。它的回答和生成结果是基于对大量文本数据的训练得出的结果,可能存在信息的不完整性或错误。在使用ChatGPT时,建议对其输出结果保持一定的谨慎和理性思考。

ChatGPT的局限性

虽然ChatGPT类技术具有许多优点,但也存在一些局限性,包括:

1. 上下文理解的限制:尽管ChatGPT在处理上下文方面比较出色,但它仍然可能存在对较长或复杂上下文的理解限制。当对话涉及很多轮次或较长的历史对话时,ChatGPT可能会遗忘或混淆之前提到的重要信息,导致回答不准确或不连贯。

2. 缺乏常识知识:ChatGPT主要是根据大量的训练数据进行学习,而没有内置的常识知识。这意味着在面对缺乏明确上下文或复杂推理的问题时,ChatGPT可能会给出不准确或不完整的答案。

3. 对抗性攻击的问题:ChatGPT可能对对抗性攻击较为敏感。有人可能会试图以误导、含糊不清或恶意构造的问题来欺骗ChatGPT,使其给出错误或有害的回答。尽管有一些对抗性训练的努力,但仍然存在对抗性攻击的挑战。

4. 道德和法律问题:ChatGPT只是一个基于训练数据的模型,缺乏道德判断和责任意识。它可能会生成或回答一些有争议、不道德或违法的内容。因此,在应用ChatGPT时,需要加强人类监督和审核,确保输出结果符合伦理和法律准则。

5. 数据偏见和信息可信度:ChatGPT的训练数据来源于互联网上的大量文本,其中可能存在各种偏见和错误信息。这可能导致ChatGPT在回答问题或生成文本时传递不准确、有偏见或不可信的信息。

6. 机器学习模型的限制:ChatGPT是基于机器学习的模型,在未见过的问题或领域上可能表现较差。它的回答受限于训练数据的范围和品质,无法提供与人类专家相媲美的专业领域知识和判断。

这些局限性表明,尽管ChatGPT在其设计和应用方面取得了显著的进展,但它仍然是一个无法完全覆盖和模拟人类智能的AI模型。在使用ChatGPT时,我们应该对其输出结果保持谨慎和理性,并结合人类的判断和审核,确保其应用的合理性、可靠性和安全性。

ChatGPT的发展前景

ChatGPT作为一种基于自然语言处理和机器学习的技术,具有广阔的发展前景。以下是ChatGPT的一些发展前景:

1. 改进模型性能:未来,我们可以预期ChatGPT模型的性能将不断改进。通过更大规模的训练数据、更强大的计算资源以及算法和架构的进一步优化,ChatGPT可以提供更准确、更连贯和更智能的回答和生成结果。

2. 针对特定领域的定制模型:将ChatGPT技术应用于特定领域的定制模型也是未来的发展方向。通过在特定领域收集和训练相关数据,可以构建能够提供专业化、领域特定知识的ChatGPT模型,为特定行业或领域的用户提供更有针对性的支持和解决方案。

3. 结合多模态输入:将ChatGPT与视觉、语音和其他感知模态相结合,创建多模态的智能对话系统是另一个发展方向。这将使ChatGPT能够理解和处理来自多种感知输入的信息,并以更丰富、交互性更强的方式与用户进行沟通。

4. 提高对话交互性和个性化:未来的发展也将集中在提高ChatGPT对话的交互性和个性化水平。通过考虑用户的个人历史、兴趣和偏好,ChatGPT可以生成与用户更加亲密、个性化的对话体验,并提供更具人性化的交互。

5. 解决数据偏见和可信度问题:在ChatGPT的发展中,需要更多的关注和努力来解决数据偏见和信息可信度问题。通过更好的数据采集和筛选、数据增强和对抗性训练等方法,可以减少数据偏见,并提高生成内容的准确性和可信度。

总体而言,ChatGPT类技术的发展前景非常广阔。随着技术的不断进步和应用的深入,我们可以期待ChatGPT在提供智能对话、辅助决策、个性化服务等方面发挥越来越重要的作用,并为人们带来更具交互性和智能化的体验。然而,我们也需要平衡技术发展与伦理、道德和隐私等问题的考虑,以确保技术的可持续发展与社会的整体利益相符。

总结

总结起来,ChatGPT是一种基于自然语言处理和机器学习的技术,具有广阔的发展前景。它可以应用于回答常见问题、写作支持、语言翻译、编程支持、旅行规划等多个领域,为用户提供便捷和智能的服务。

然而,ChatGPT也存在一些局限性,如对上下文理解的限制、缺乏常识知识、对抗性攻击的问题、道德和法律问题、数据偏见和信息可信度等。这些局限性需要我们保持谨慎和理性,并结合人类的判断和审核,确保应用的合理性、可靠性和安全性。

未来,可以预期ChatGPT模型的性能将不断改进,定制模型针对特定领域将得到发展,和多模态输入结合的多模态智能对话系统将成为发展方向,并将更大地关注对话交互性和个性化。同时,解决数据偏见和可信度问题也是未来需要关注和努力解决的方向。

总的来说,ChatGPT类技术在智能对话系统领域的应用将会持续扩大,为用户提供更好的体验和服务,并为科技进步的发展带来许多机遇和挑战。