题目

科学计数法是科学家用来表示很大或很小的数字的一种方便的方法,其满足正则表达式[±][1-9]”.”[0-9]+E[±][0-9]+,即数字的整数部分只有1位,小数部分至少有1位,该数字及其指数部分的正负号即使对正数也必定明确给出。

现以科学计数法的格式给出实数A,请编写程序按普通数字表示法输出A,并保证所有有效位都被保留。

输入格式

每个输入包含1个测试用例,即一个以科学计数法表示的实数A。该数字的存储长度不超过9999字节,且其指数的绝对值不超过9999。

输出格式

对每个测试用例,在一行中按普通数字表示法输出A,并保证所有有效位都被保留,包括末尾的0。

输入样例1

+1.23400E-03

输出样例1

0.00123400

输入样例2

-1.2E+10

输出样例2

-12000000000

来源:PAT 乙 1024 科学计数法

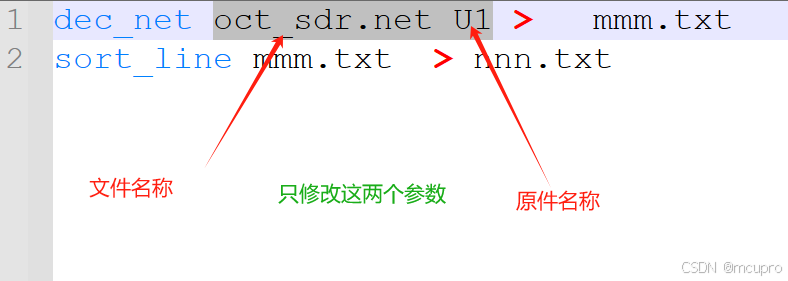

思路(注意事项)

区分:

s.insert(1,"a") 插入字符串

s.insert(1,1,'a') 插入字符

题解

#include<iostream>

using namespace std;int main()

{string s, ans, tmp; // s: 输入字符串, ans: 存储结果, tmp: 存储指数部分cin >> s; // 输入科学计数法表示的字符串int n = s.size(), f; // n: 字符串长度, f: 指数部分的正负号位置// 提取小数部分for (int i = 1; i < n; i ++) // 从第二个字符开始遍历(跳过第一个正负号){if (isdigit(s[i])) // 如果当前字符是数字ans += s[i]; // 将其添加到结果字符串中else if (s[i] == '+' || s[i] == '-') // 如果遇到指数部分的正负号{f = i; // 记录指数部分的正负号位置break; // 结束循环}}// 提取指数部分for (int i = f + 1; i < n; i ++) // 从指数部分的正负号位置开始遍历tmp += s[i]; // 将指数部分的字符添加到 tmp 中int t = stoi(tmp); // 将指数部分转换为整型 tint m = ans.size(); // m: 小数部分的长度// 处理负指数if (s[f] == '-') // 如果指数部分是负数{ans.insert(0, t, '0'); // 在结果字符串开头插入 t 个 '0'ans.insert(1, 1, '.'); // 在第二个位置插入小数点}// 处理正指数else{if (m - t > 1) // 如果小数部分的长度减去指数值大于 1ans.insert(t + 1, 1, '.'); // 在小数点后插入小数点else if (m - t < 1) // 如果小数部分的长度减去指数值小于 1{int k = t - m + 1; // 计算需要补零的数量while (k --) ans += '0'; // 在末尾补零}}// 处理原数的符号if (s[0] == '-') // 如果原数是负数ans.insert(0, "-"); // 在结果字符串开头插入负号cout << ans; // 输出最终结果return 0;

}

纯代码

#include<iostream>

using namespace std;

int main()

{string s, ans, tmp;cin >> s;int n = s.size(), f;for (int i = 1; i < n; i ++)if (isdigit(s[i])) ans += s[i];else if (s[i] == '+' || s[i] == '-'){f = i; break;}for (int i = f + 1; i < n; i ++) tmp += s[i];int t = stoi(tmp); int m = ans.size();if (s[f] == '-'){ans.insert (0, t, '0');ans.insert (1, 1, '.');} else{if (m - t > 1) ans.insert(t + 1, 1, '.');else if (m - t < 1) {int k = t - m + 1;while (k --) ans += '0';}}if (s[0] == '-') ans = "-" + ans;cout << ans;return 0;

}

![[JMCTF 2021]UploadHub](https://i-blog.csdnimg.cn/direct/bb7332cf200d4c7988f6ec4f050dd01d.png)