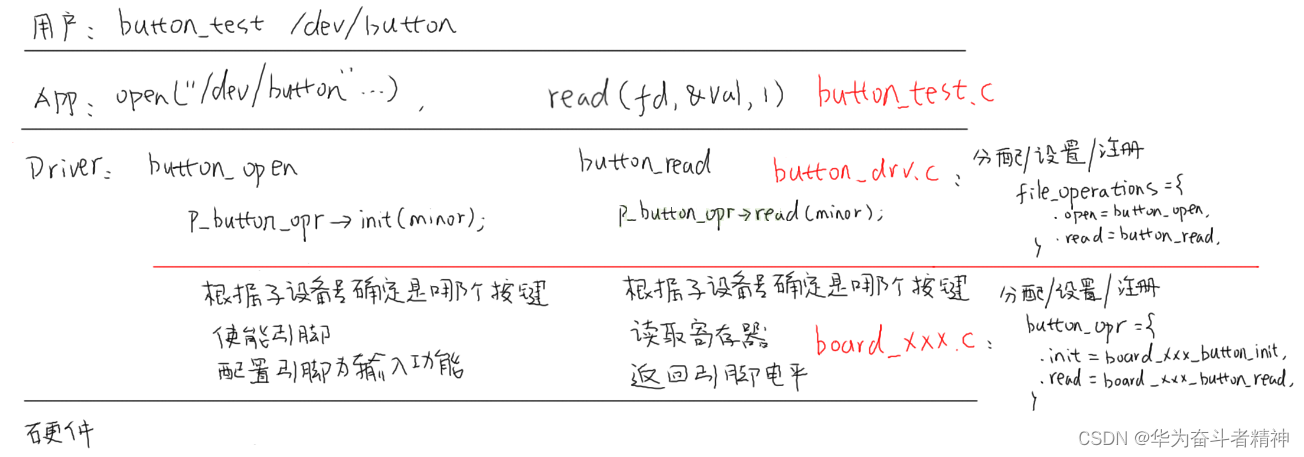

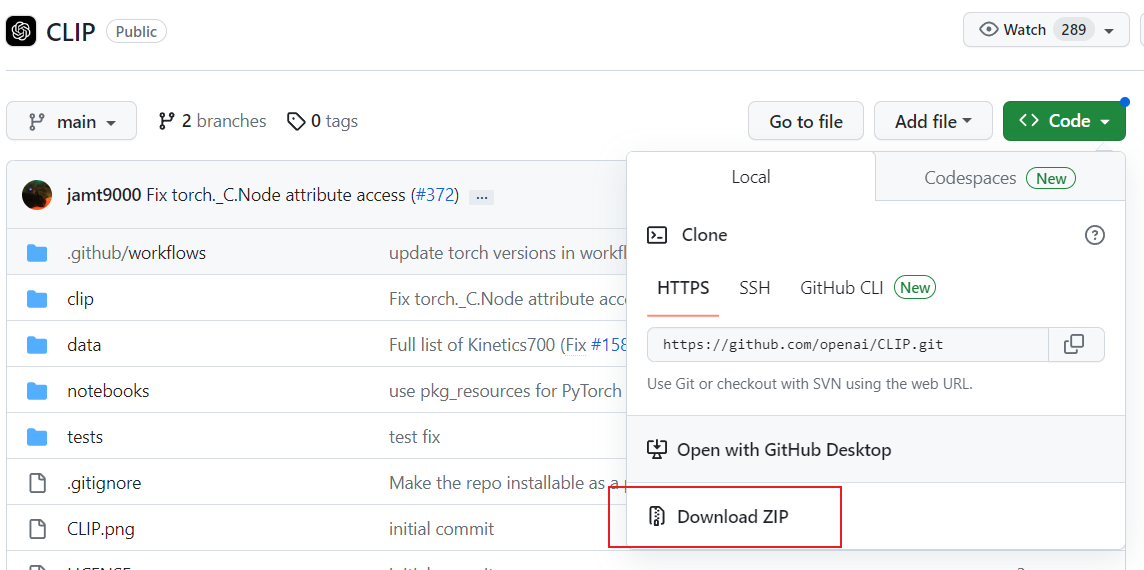

CLIP模型及代码地址:GitHub - openai/CLIP: Contrastive Language-Image Pretraining

代码准备环境

先创建一个anaconda虚拟环境,包含python=3.7版本,将该环境命名为clip。成功。

( pytorch=1.7.1 所需 python 版本 >=3.6,本博客决定安装 py3.7 )

conda create --name clip python=3.7安装clip

切换到虚拟环境clip中

conda activate clip根据CLIP的github上指示,安装pytorch=1.7.1 及其他所需库。成功。

conda install --yes -c pytorch pytorch=1.7.1 torchvision cudatoolkit=11.0

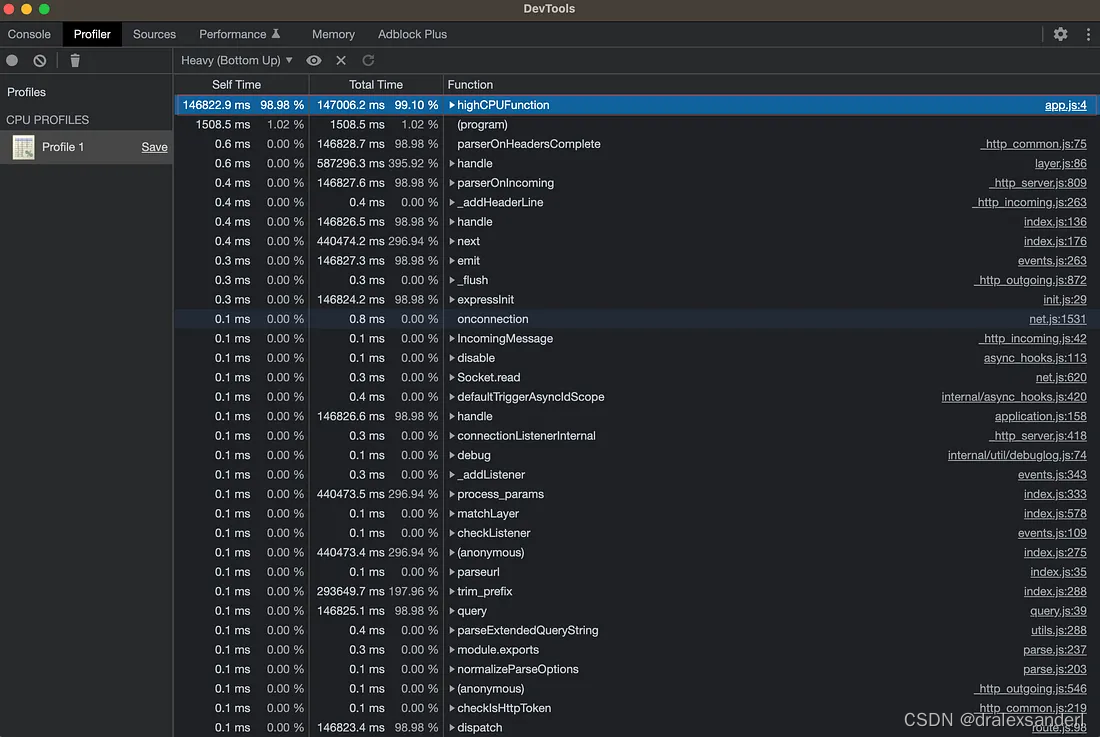

pip install ftfy regex tqdm最后,从github上直接安装CLIP。这一步可能会失败。

pip install git+https://github.com/openai/CLIP.git如果失败去官网下载zip

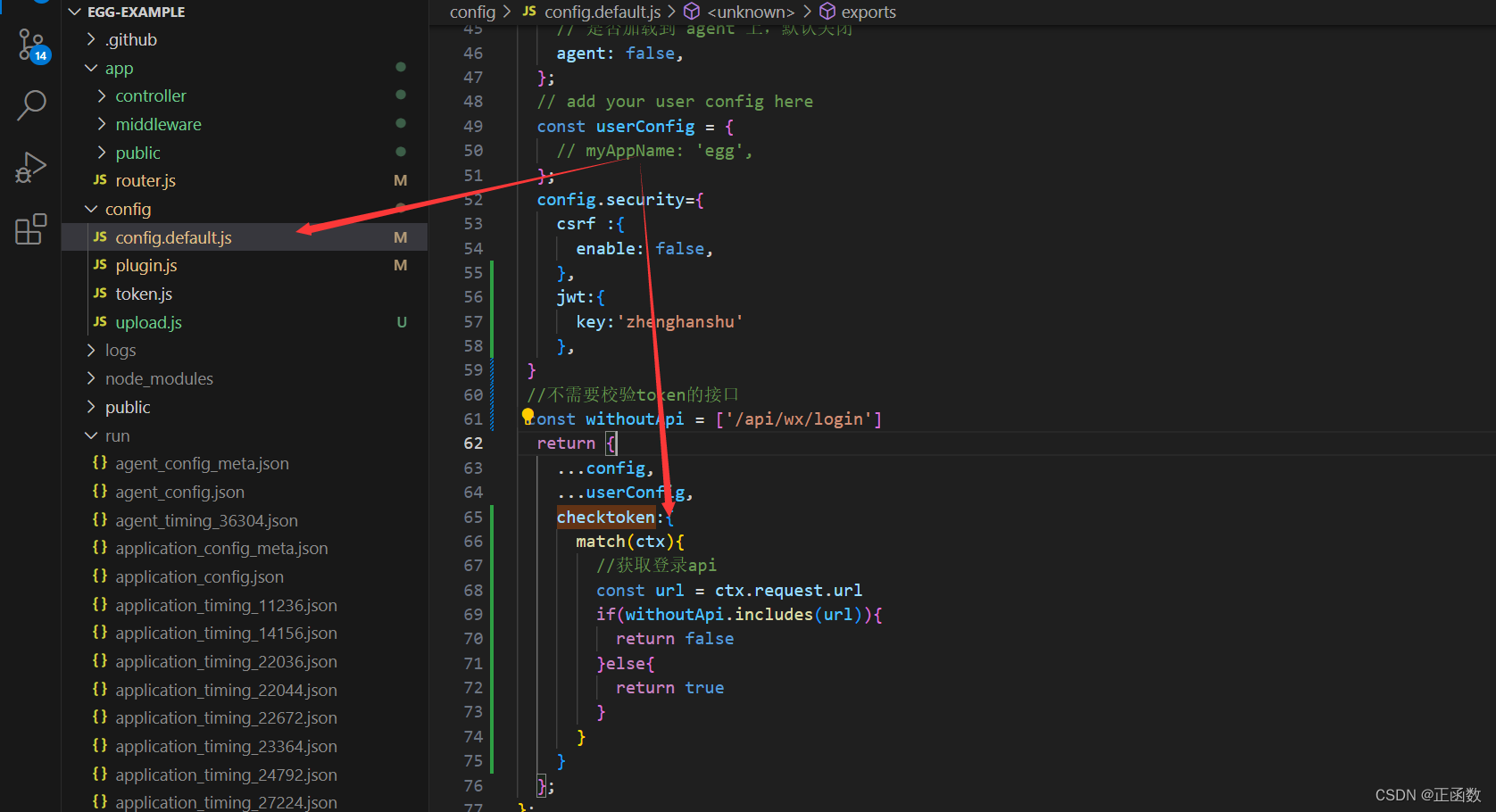

放在这个目录下(因人而异)

运行下面代码

pip install -r requirements.txt

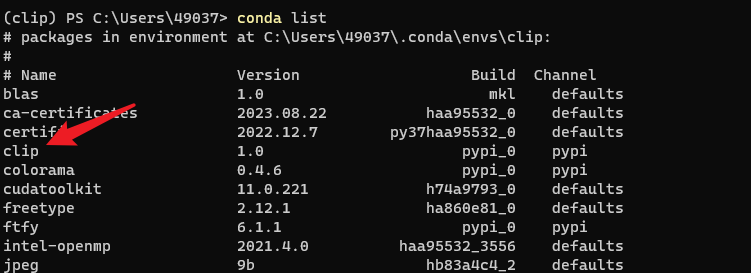

python setup.py install最后conda list看看是不是有clip