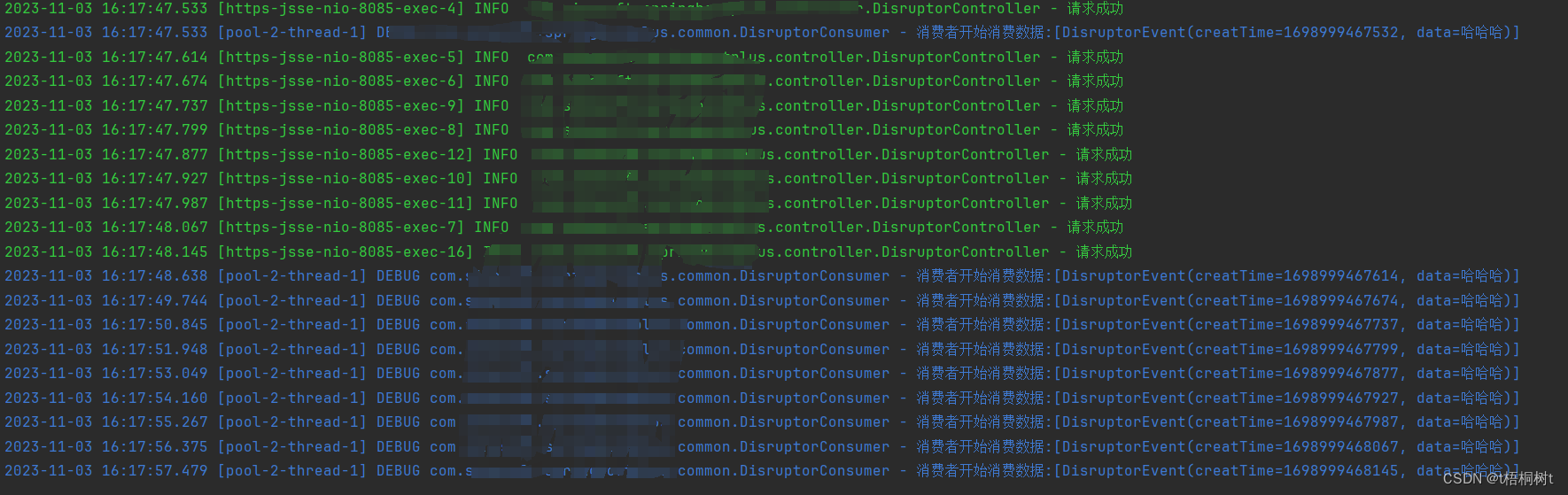

示例一,工作辅助、写函数代码:

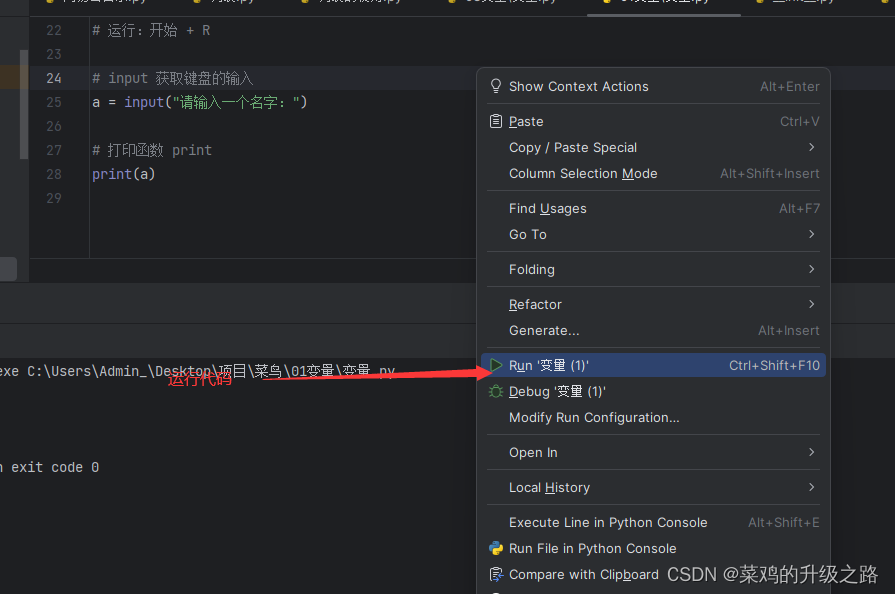

这里展示了一个完整的代码,修正,然后最终输出的过程。GPT具备足够丰富的相关的小型代码生成能力,语法能力也足够好。这类应用场景,在我的GPT使用中,能占到65%以上。我也推荐一些朋友用GPT写Excel公式之类的。

Python我刚刚用了大概2个月,现在的代码编写能力,如果ChatGPT不存在,我觉得速度至少会慢3倍甚至10倍。

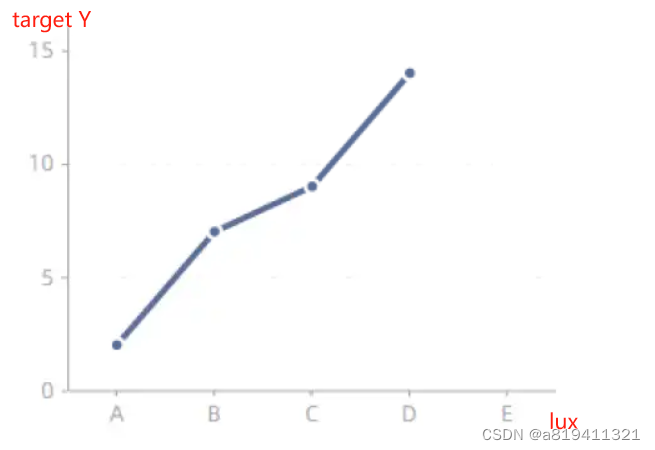

@@curr_in = im + im*(rm + lm*freq_in*i)/(r2 + l2*freq_in*i + (1-s)/s*r2); 这是一个矢量公式,我现在需要把curr_in和 s的曲线画出来。im rm lm freq_in r2 L2均已知,你能帮我画出来吗?abs(curr_in) 最小值从im开始,最大值可以取3倍的im.

可以的,我可以帮你画出这个曲线。我们可以使用Python中的matplotlib库来可视化这个矢量公式。

以下是示例代码,你可以替换其中的参数值以及频率值的范围和步长来生成不同的曲线图:

import numpy as np import matplotlib.pyplot as plt# 设置已知参数值 im = 1 rm = 2 lm = 3 r2 = 4 l2 = 5 s = 0.5# 设置频率值范围和步长 freq_in = np.linspace(0.1, 1000, 1000)# 计算并绘制曲线 curr_in = im + im*(rm + lm*freq_in*1j)/(r2 + l2*freq_in*1j + (1-s)/s*r2) plt.plot(freq_in, np.abs(curr_in)) plt.xlabel('Input Frequency (Hz)') plt.ylabel('Absolute value of curr_in') plt.ylim(im, 3*im) # 设置y轴范围,最小值为im,最大值为3倍im plt.show()运行代码后,即可生成频率与电流绝对值的曲线图,其中x轴为频率值,y轴为电流绝对值,最小值为im,最大值为3倍im。

@@感谢。

不客气,如果您还有其他问题或需要帮助,请随时提问。

@@np.linspace 是什么意思?

np.linspace是 NumPy 库中的一个函数,用于创建一个表示等间隔数值的数组。它的语法如下:np.linspace(start, stop, num=50, endpoint=True, retstep=False, dtype=None, axis=0)参数说明:

start:起始值stop:结束值num(可选):要生成的样本数量,默认为 50endpoint(可选):是否包含结束值,默认为 True,即包含结束值retstep(可选):是否返回步长,默认为 Falsedtype(可选):输出数组的数据类型,默认为 None,表示使用输入数据的数据类型axis(可选):指定生成数组的轴,默认为 0

np.linspace函数会生成一个从起始值到结束值之间的等间隔的样本,样本数量由num参数指定(默认为 50)。函数的返回值是一个包含等间隔样本的 NumPy 数组。例如,

np.linspace(0, 1, 5)会生成一个长度为 5 的数组,包含从 0 到 1 的等间隔的样本:[0. 0.25 0.5 0.75 1.]。在上面的代码示例中,我们使用

np.linspace(0.1, 1000, 1000)生成了一个长度为 1000 的数组,包含从 0.1 到 1000 的等间隔的样本,用作频率值的范围。这样可以在绘制曲线时获得更好的分辨率。@@python设置默认字符集

在 Python 中,可以使用

sys.setdefaultencoding来设置默认字符集。然而,从 Python 3.0 版本开始,Python 删除了sys.setdefaultencoding函数,因为它可能会导致一些问题,并且不推荐在编程中使用它。在 Python 3 中,默认字符集(即编码)被设置为 UTF-8,这是一种广泛使用的字符集,可以表示各种语言的字符。因此,大多数情况下,您无需显式地设置默认字符集,Python 会默认使用 UTF-8 编码。

如果您

@@把字符串转换为utf8 python

在 Python3 中,字符串已经默认采用 Unicode 编码,不需要再进行转换就可以使用UTF-8编码的字符串。如果你需要将字符串转换为 UTF-8 编码的 字节序列 (bytes),可以使用字符串的

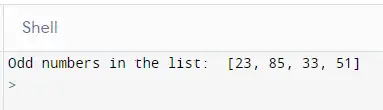

encode方法。示例如下:str = "这是一个字符串" utf8_bytes = str.encode('utf-8') print(utf8_bytes)执行上述代码,会得到一个 UTF-8 编码的字节序列,如下所示:

b'\xe8\xbf\x99\xe6\x98\xaf\xe4\xb8\x80\xe4\xb8\xaa\xe5\xad\x97\xe7\xac\xa6\xe4\xb8\xb2'其中每个十六进制数都代表一个字节,组成了 UTF-8 编码的字节序列。

要想将一个 UTF-8 编码的字节序列转换为字符串,可以使用字节序列的

decode方法,示例如下:str_from_utf8 = utf8_bytes.decode('utf-8') print(str_from_utf8)对上述代码进行执行,会得到以下字符串:

这是一个字符串这里采用的也是 UTF-8 编码的字符串。需要注意的是,如果要正确解码一个字节序列,必须使用与编码时相同的编码方式进行解码。

@@额定转差率 英文翻译

"额定转差率"的英文翻译是 “rated conversion efficiency”。

@@额定功率英文翻译

"额定功率"的英文翻译是 “rated power”。

@@在python输出图上绘制一条横线,

在 Python 中,你可以使用 Matplotlib 库来输出图形并在图上绘制一条横线。下面是绘制一条横线的示例代码:

import matplotlib.pyplot as plt# 创建示例数据 x = [1, 2, 3, 4, 5] y = [2, 4, 6, 8, 10]# 绘制图形 plt.plot(x, y)# 绘制横线 horiz_line = plt.axhline(y=5, color='r', linestyle='--')# 显示图形 plt.show()在这个示例中,我们通过

plt.axhline()函数绘制了一条纵坐标为 5 的横线,颜色为红色(color='r'),线型为虚线(linestyle='--')。你可以根据需要调整横线的位置和样式。@@能给刚才的横线加图例吗?

可以的,请看下面的代码示例。我们可以使用

matplotlib.lines.Line2D类型的对象,设置其label属性,然后使用plt.legend()函数添加图例即可。import matplotlib.pyplot as plt import matplotlib.lines as lines# 创建示例数据 x = [1, 2, 3, 4, 5] y = [2, 4, 6, 8, 10]# 绘制图形 plt.plot(x, y)# 绘制横线 horiz_line = lines.Line2D([1, 5], [5, 5], color='r', linestyle='--', label='Horizontal Line') plt.gca().add_line(horiz_line)# 添加图例 plt.legend()# 显示图形 plt.show()在这个示例中,我们创建了一个

Line2D类型的对象horiz_line,并通过设置其label属性为'Horizontal Line',指定该横线的图例描述。然后使用plt.gca().add_line()函数将该横线添加到当前 Axes 对象中。最后使用plt.legend()函数添加图例,自动显示横线的图例。

示例二,刺探陌生领域信息

一份电力工程系的美国本科生培养计划【巩义二中吧】_百度贴吧一份电力工程系的美国..》》可以给我一份美国的自动化专业的本科生科目和教材清单吗?当谈到美国的自动化工程本科生科目和教材清单时,不同大学可能会有不同的课程设置和教材选择。以下是一些常见的自动化工程本科生科目以及可能使用的教材![]() https://tieba.baidu.com/p/8633177342

https://tieba.baidu.com/p/8633177342

一个美国家庭的收入和支出【巩义二中吧】_百度贴吧一个美国家庭的收入和..》一个美国人,比如程序员,他一周的工作时间会有多少?一个美国程序员的一周工作时间通常是40小时。这是标准的全职工作时间,在美国许多行业中普遍使用。值得一提的是,具体的工作时间可能会因公司政策、职位要求![]() https://tieba.baidu.com/p/8629737932

https://tieba.baidu.com/p/8629737932

示例三,试探它的能力边界

那肉眼可见的执拗【巩义二中吧】_百度贴吧那肉眼可见的执拗..》你一定有论语的知识,对吧?是的,我有关于《论语》的知识。《论语》是一部记录孔子及其学生言行的经典著作,被认为是儒家学派的重要经典之一。它包含了孔子的哲学思想、道德教诲、政治观点等方面的内容。《论语》![]() https://tieba.baidu.com/p/8629799212

https://tieba.baidu.com/p/8629799212

我还尝试过让gpt写诗, gpt如果先写,还可以,它的模仿能力足够好,但是它主动表达能力很差。连基本的结构都维持不住。因为你的权重不高,所以,你跟他说3~5遍,它会一次次改得更离谱。

示例四,扫清疑问,类似数字助理的用途

the signal of under broken relationship![]() https://www.douban.com/group/topic/295499104/?_i=8719951FcPrnDD

https://www.douban.com/group/topic/295499104/?_i=8719951FcPrnDD

ChatGPT非常擅长这类综述性的知识。另一个示例:

@@insist 第一个s是清辅音还是浊辅音?

"insist"一词中的第一个"s"是清辅音。

@@清辅音浊化的规则是什么?

清辅音在特定条件下可以发生浊化,以下是一些常见的浊化规则:

词尾浊化:在单词的词尾,清辅音可以浊化为相应的浊辅音。例如,“cats” 中的 “t” 在发音时会变得浊音,读作 /kæts/ 而不是 /kæt/.

元音前浊化:当清辅音出现在元音前时,也可以发生浊化。例如,“bigger” 中的 “g” 在发音时就会变得浊音,读作 /ˈbɪɡər/ 而不是 /ˈbɪkər/.

邻音浊化:清辅音在某些特定的邻音环境下可以发生浊化。例如,当清辅音前后都有浊音时,通常会发生邻音浊化。例如,“dish” 中的 “sh” 在发音时会变为浊音,读作 /dɪʃ/ 而不是 /dɪs/.

需要注意的是,浊化规则在不同的语言和方言中可能会有所不同,因此具体情况还需要根据语言和方言的特点来确定。

@@insist 第一个s不是在元音前吗?

非常抱歉我的回答有误。在单词 “insist” 中,第一个 “s” 确实在元音 “i” 前面,但它仍然是一个清辅音。我混淆了情况,请原谅。正确的发音是 /ɪnˈsɪst/,其中第一个 “s” 是清辅音。再次对我的错误表示歉意,并感谢您的指正。如果还有其他问题,请随时提问。

示例五,ChatGPT最有价值的适用场景:专业领域的小白问题

你可以把他当做细分技术领域,足够有耐心的业务咨询:

34CrMo4QT是什么材质?

34CrMo4QT 是一种低合金钢材料,常用于制造高强度和高温下工作的机械零件和压力容器。其中的数字“34”表示该钢材的平均碳含量为0.34%,“CrMo4”表示其含有约1%的铬和0.25%的钼,这些合金元素能够增加钢材的硬度和耐热性。而添加了 QT 后缀表示经过淬火和回火热处理,以提高材料的机械性能和韧性。34CrMo4QT 具有良好的强度、韧性和耐热性,因此适用于要求高强度和高温下工作的应用。

它有个钢号吗?无论是国内还是国外的编号。

34CrMo4QT 的钢号在国际上通常被标示为 ASTM A193 Grade B7 或者 ISO 898-1 Class 10.9。在中国,其对应的钢号为 35CrMo。这些钢号通常用于标识具有类似化学成分和机械性能的钢材。如果要在具体项目或标准中使用34CrMo4QT 材料,建议与相关的工程师、设计师或供应商进一步确认,以确保选择的材料符合特定的要求。

它的抗拉强度是这类钢材的主要特征吗?

在低合金钢材中,抗拉强度是一个重要的机械性能参数,也是衡量材料强度的一项指标。对于 34CrMo4QT 这种含有合金的钢材来说,其抗拉强度的确是其主要特征之一,通常可达到 980 MPa 左右。此外,34CrMo4QT 材料还具有较好的可塑性和韧性,适用于制造需要高强度和高韧性的工程零件。除了抗拉强度,这种钢材的其它机械性能,例如屈服强度、冲击韧性以及硬度等也需要考虑,以便确定其在具体应用中的可靠性和适用性。

它的延展度可以达到多少?

34CrMo4QT 材料通常具有良好的可塑性和延展性,其延伸率一般在15%到25%之间。然而,延展度受到许多因素的影响,例如制造工艺、材料状态、试样形状和大小,以及测试方式等。因此,实际的延展性可能会因具体情况而有所不同。如果需要更具体的信息,请参考相关的技术规范或咨询材料制造商。

它的那个弹性形变的分界点,那个强度可以达到多少?

在应力-应变曲线中,弹性形变分界点通常被称为屈服点(yield point)。对于 34CrMo4QT 钢材,其屈服强度可达到约 785 MPa 左右。屈服强度是材料在开始发生可见塑性变形之前所能承受的最大应力。超过屈服强度后,材料将会发生塑性变形,而不是恢复到初始形状。需要注意的是,屈服强度也受到材料处理和测试方法的影响,因此具体数值可能会有所不同。如需准确的数据,请参考相关的技术规范或咨询材料制造商。

它好高。。。。航母的甲板钢应该也是这种级别了,对吧?如果只看屈服强度。

航母的甲板钢通常需要具备很高的强度和耐用性,以承受飞机起降、重物加载以及恶劣海洋环境下的应力。普通的船用钢或结构用钢的屈服强度一般在400到600 MPa之间,但为了满足航母甲板的特殊需求,所使用的钢材通常会具备更高的屈服强度。

通常情况下,航母的甲板钢屈服强度会达到800 MPa以上。一些常见的用于航母甲板的钢材类型包括AH36、DH36和EH36等。这些钢材通过添加合适的合金元素和经过特殊处理,以提供高强度和较好的耐蚀性能。

需要指出的是,航母甲板的设计和材料选用涉及多个方面的考虑,除了屈服强度,还包括其他性能指标,例如韧性、抗裂纹扩展和冲击吸能等。因此,仅仅根据屈服强度来评估航母甲板钢的适用性是不够全面的,具体条件和要求需要进一步考虑。

34CrNiMo6QT比刚才这个更好还是更差。

34CrNiMo6QT 是一种优质的合金钢材料,相比之前的 34CrMo4QT 钢材,它具有更高的强度和韧性。一般来说,34CrNiMo6QT 钢材的屈服强度大约为900-1100 MPa,而断裂韧性通常也比较高。

另外,34CrNiMo6QT 钢材在高温高压下的承载能力也比较出色,它适用于需要高强度和高韧性的重载部件,例如连接杆、轴、齿轮等。

总的来说,34CrNiMo6QT 钢材的性能相比于 34CrMo4QT 更好。但是需要注意的是,材料的性能不仅仅受到化学成分和热处理方式的影响,还受到材料加工的条件和方法的影响。因此,在选择特定的钢材时,需要根据实际应用需求做出具体的评估和选择。

一般的吊钩都需要考虑高温环境,对吧?

是的,高温环境对于吊钩的选择和设计非常重要。

在高温环境下,吊钩需要能够承受高温所带来的热膨胀、氧化、退火和变形等影响。因此,钢材的选择对于吊钩的性能至关重要。

一种常用的高温吊钩材料是合金钢,例如经过热处理的合金钢 25CrMo4 或 42CrMo4。这些合金钢材料在高温下具有较好的力学性能和耐热性,能够保持较高的强度和韧性。此外,合金钢还具有较高的耐磨性和耐蚀性,适用于恶劣的高温工作环境。

除了钢材的选择,吊钩的设计也需要考虑高温环境下的工作条件。例如,吊钩的结构应该合理,以保证在高温下能够承受额定的工作负荷,并且必要时还要考虑降低温度对钢材的影响。

总之,高温环境下的吊钩需要选择合适的材料和进行专门的设计,以确保其在高温工作条件下的安全可靠性。

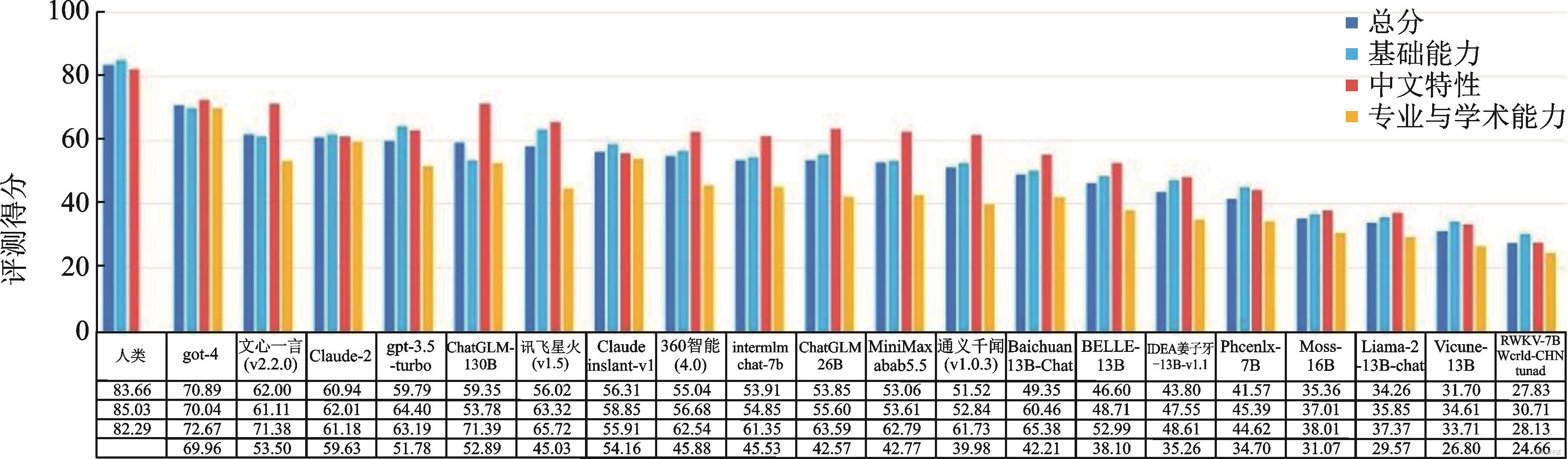

附录A 一份专业测评报告

一份核心期刊上针对ChatGT及相关产品的测评![]() https://sjcj.nuaa.edu.cn/sjcjycl/article/html/202305002

https://sjcj.nuaa.edu.cn/sjcjycl/article/html/202305002

这是论文中,7月份的一个测评。只有针对gpt3.5的数据比对。防止原文失效,附上论文的引用文献列表:

这是论文中,7月份的一个测评。只有针对gpt3.5的数据比对。防止原文失效,附上论文的引用文献列表:

1

NADKARNI P M, OHNO-MACHADO L, CHAPMAN W W. Natural language processing: An introduction[J]. Journal of the American Medical Informatics Association, 2011, 18(5): 544-551. [百度学术]

2

YOUNG T, HAZARIKA D, PORIA S, et al. Recent trends in deep learning based natural language processing[J]. IEEE Computational Intelligence Magazine, 2018, 13(3): 55-75. [百度学术]

3

BROWN P F, DELLA P V J, DESOUZA P V, et al. Class-based N-gram models of natural language[J]. Computational Linguistics, 1992, 18(4): 467-480. [百度学术]

4

MIKOLOV T, KARAFIÁT M, BURGET L, et al. Recurrent neural network based language model[C]//Proceedings of the 11th Annual Conference of the Nternational Speech Communication Association. Makuhari, Chiba, Japan: DBLP, 2010: 1045-1048. [百度学术]

5

HOCHREITER S, SCHMIDHUBER J. Long short-term memory[J]. Neural Computation, 1997, 9(8): 1735-1780. [百度学术]

6

CHUNG J, GULCEHRE C, CHO K, et al. Empirical evaluation of gated recurrent neural networks on sequence modeling[EB/OL].(2014-02-01)[2023-08-30]. https://arxiv.org/abs/1412.3555. [百度学术]

7

VASWANI A, SHAZEER N, PARMAR N, et al. Attention is all you need[C]//Proceedings of the 31st Conference on Neural Information Processing Systems (NIPS 2017). [S.l.]: ACM, 2017: 5998-6008. [百度学术]

8

CHEN S F, GOODMAN J. An empirical study of smoothing techniques for language modeling[J]. Computer Speech & Language, 1999, 13(4): 359-394. [百度学术]

9

BENGIO Y, DUCHARME R,VINCENT P. A neural probabilistic language model[J]. Machine Learning Research, 2003, 3: 1137-1155. [百度学术]

10

HINTON G E. Learning distributed representations of concepts[C]//Proceedings of the Eighth Annual Conference of the Cognitive Science Society. [S.l.]: American Psychological Association, 1986: 1-12. [百度学术]

11

ELMAN J L. Finding structure in time[J]. Cognitive Science, 1990, 14(2): 179-211. [百度学术]

12

BENGIO Y, SIMARD P, FRASCONI P. Learning long-term dependencies with gradient descent is difficult[J]. IEEE Transactions on Neural Networks, 1994, 5(2): 157-166. [百度学术]

13

Colah. Understanding LSTM networks[EB/OL]. (2015-08-27) [2023-08-21]. http://colah.github.io/posts/2015-08-Understanding-LSTMs. [百度学术]

14

SOCHER R, PERELYGIN A, WU J, et al. Recursive deep models for semantic compositionality over a sentiment treebank[C]//Proceedings of the 2013 Conference on Empirical Methods in Natural Language Processing. Washington, USA: [s.n.], 2013: 1631-1642. [百度学术]

15

SUTSKEVER I, MARTENS J, HINTON G E. Generating text with recurrent neural networks[C]//Proceedings of the 28th International Conference on Machine Learning (ICML-11). Washington, USA: DBLP, 2011: 1017-1024. [百度学术]

16

GRAVES A. Generating sequences with recurrent neural networks[EB/OL]. (2014-06-05)[2023-08-21]. https://arxiv.org/abs/1308.0850v5. [百度学术]

17

YANG C, SUN M, YI X, et al. Stylistic chinese poetry generation via unsupervised style disentanglement[C]//Proceedings of the 2018 Conference on Empirical Methods in Natural Language Processing. Brussels, Belgium: Association for Computational Linguistics, 2018: 3960-3969. [百度学术]

18

GRAVES A, MOHAMED A R , HINTON G. Speech recognition with deep recurrent neural networks[C]//Proceedings of 2013 IEEE International Conference on Acoustics, Speech and Signal Processing. Washington, USA: IEEE, 2013: 6645-6649. [百度学术]

19

CHO K, VAN MERRIËNBOER B, GULCEHRE C, et al. Learning phrase representations using RNN encoder-decoder for statistical machine translation[EB/OL]. (2014-03-15)[2023-08-23]. https://arxiv.org/abs/1406.1078. [百度学术]

20

SUTSKEVER I, VINYALS O, LE Q V. Sequence to sequence learning with neural networks[J]. Advances in Neural Information Processing Systems, 2014, 27: 3104‑3112. [百度学术]

21

BAHDANAU D, CHO K, BENGIO Y. Neural machine translation by jointly learning to align and translate[EB/OL]. (2014-03-15)[2023-08-23]. http://10.48550/arXiv.1409.0473. [百度学术]

22

GEHRING J, AULI M, GRANGIER D, et al. Convolutional sequence to sequence learning[C]//Proceedings of International Conference on Machine Learning. [S.l.]: PMLR, 2017: 1243-1252. [百度学术]

23

SPARCK J K. A statistical interpretation of term specificity and its application in retrieval[J]. Journal of Documentation, 1972, 28(1): 11-21. [百度学术]

24

HoNg Liangjie. Probabilistic latent semantic analysis[EB/OL]. (2012‑12‑24)[2023‑08‑30]. http://arxiv.org/abs/1212.3900v2. [百度学术]

25

Deerwester S, Dumais S T, Furnas G W, et al. Indexing by latent semantic analysis[J]. Journal of the American Society for Information Science, 1990, 41(6): 391-407. [百度学术]

26

BLEI D M, NG A Y, JORDAN M I. Latent dirichlet allocation[J]. Journal of Machine Learning Research, 2003, 3: 993-1022. [百度学术]

27

MIKOLOV T, CHEN K, CORRADO G S, et al. Efficient estimation of word representations in vector space[C]//Proceedings of International Conference on Learning Representations. [S.l.]:[s.n.], 2013. [百度学术]

28

MIKOLOV T, SUTSKEVER I, CHEN K, et al. Distributed representations of words and phrases and their compositionality[J]. Advances in Neural Information Processing Systems, 2013, 26: 3111‑3119. [百度学术]

29

DAI A M, LE Q V. Semi-supervised sequence learning[J]. Advances in Neural Information Processing Systems, 2015, 28: 3079‑3087. [百度学术]

30

PETERS M E, NEUMANN M, IYYER M, et al. Deep contextualized word representations[EB/OL]. (2018-03-22)[2023-08-23]. https://arxiv.org/abs/1802.05365v1. [百度学术]

31

RADFORD A, NARASIMHAN K, SALIMANS T, et al. Improving language understanding by generative pre-training[EB/OL]. (2018-06-11)[2023-07-22]. https://cdn.openai.com/research-covers/language-unsupervised/language_understanding_paper.pdf. [百度学术]

32

DEVLIN J, CHANG M W, LEE K, et al. BERT: Pre-training of deep bidirectional transformers for language understanding[EB/OL]. (2019-05-24)[2023-08-23]. https://arxiv.org/abs/1810.04805v2. [百度学术]

33

RADFORD A, WU J, CHILD R, et al. Language models are unsupervised multitask learners[J]. OpenAI Blog, 2019, 1(8): 9. [百度学术]

34

BROWN T, MANN B, RYDER N, et al. Language models are few-shot learners[J]. Advances in Neural Information Processing Systems, 2020, 33: 1877-1901. [百度学术]

35

OUYANG L, WU J, JIANG X, et al. Training language models to follow instructions with human feedback[C]// Proceedings of Advances in Neural Information Processing Systems. [S.l.]:[s.n.], 2022: 27730-27744. [百度学术]

36

OpenAI. Introducing ChatGPT[EB/OL]. (2022-12-30)[2023-08-02]. Introducing ChatGPT. [百度学术]

37

KAELBLING L P, LITTMAN M L, MOORE A W. Reinforcement learning: A survey[J]. Journal of Artificial Intelligence Research, 1996, 4: 237-285. [百度学术]

38

QIN C, ZHANG A, ZHANG Z, et al. Is ChatGPT a general-purpose natural language processing task solver[EB/OL].(2023-02-15)[2023-08-23]. https://arxiv.org/abs/2302.06476v1. [百度学术]

39

WEI J, WANG X, SCHUURMANS D, et al. Chain-of-thought prompting elicits reasoning in large language models[J]. Advances in Neural Information Processing Systems, 2022, 35: 24824-24837. [百度学术]

40

ZHONG Q, DING L, LIU J, et al. Can chatgpt understand too? A comparative study on ChatGPT and fine-tuned bert[EB/OL]. (2023-03-10)[2023-08-23]. https://arxiv.org/abs/2302.10198. [百度学术]

41

WANG A, SINGH A, MICHAEL J, et al. GLUE: A multi-task benchmark and analysis platform for natural language understanding[EB/OL]. (2019-02-22)[2023-08-23]. http://arxiv.org/abs/arXiv:1804.07461. [百度学术]

42

LIU Y, OTT M, GOYAL N, et al. Roberta: A robustly optimized bert pretraining approach[EB/OL]. (2019-07-26)[2023-08-23]. https://arxiv.org/abs/1907.11692. [百度学术]

43

YANG X, LI Y, ZHANG X, et al. Exploring the limits of chatgpt for query or aspect-based text summarization[EB/OL].(2023-02-26)[2023-08-23]. https://arxiv.org/abs/2302.08081. [百度学术]

44

XU L, LI A, ZHU L, et al. SuperCLUE: A comprehensive Chinese large language model benchmark[EB/OL]. (2023-07-08)[2023-08-23]. https://arxiv.org/pdf/2307.15020.pdf. [百度学术]

45

TLILI A, SHEHATA B, ADARKWAH M A, et al. What if the devil is my guardian angel: ChatGPT as a case study of using chatbots in education[J]. Smart Learning Environments, 2023, 10(1): 15. [百度学术]

46

GUO B, ZHANG X, WANG Z, et al. How close is ChatGPT to human experts? Comparison, evaluation, and detection[EB/OL]. (2023-01-15)[2023-08-23]. https://arxiv.org/abs/2301.07597. [百度学术]

47

DESHPANDE A, MURAHARI V, RAJPUROHIT T, et al. Toxicity in ChatGPT: Analyzing persona-assigned language models[EB/OL]. (2023-04-01)[2023-08-23]. https://arxiv.org/abs/2304.05335. [百度学术]

48

LIU H, NING R, TENG Z, et al. Evaluating the logical reasoning ability of ChatGPT and GPT-4[EB/OL].(2023-04-07)[2023-08-23]. https://arxiv.org/abs/2304.03439. [百度学术]

49

BAIDOO-ANU D, ANSAH L O. Education in the era of generative artificial intelligence (AI): Understanding the potential benefits of ChatGPT in promoting teaching and learning[J]. Journal of AI, 2023, 7(1): 52-62. [百度学术]

50

PARK J S, O’BRIEN J C, CAI C J, et al. Generative agents: Interactive simulacra of human behavior[EB/OL]. (2023-04-08)[2023-08-23]. https://arxiv.org/abs/2304.03442. [百度学术]

51

TOUVRON H, LAVRIL T, IZACARD G, et al. LLaMA: Open and efficient foundation language models[EB/OL]. (2023-04-02)[2023-08-23]. https://arxiv.org/abs/2302.13971. [百度学术]

52

TOUVRON H, MARTIN L, STONE K, et al. LLaMA 2: Open foundation and fine-tuned chat models[EB/OL]. (2023-07-25)[2023-08-23]. https://arxiv.org/abs/2307.09288. [百度学术]

53

BaichuanAI. Baichuan-7B[EB/OL]. (2023-06-11)[2023-08-11]. https://github.com/baichuan-inc/Baichuan-7B. [百度学术]

54

BaichuanAI. Baichuan-13B[EB/OL]. (2023-07-09)[2023-08-11]. https://github.com/baichuan-inc/Baichuan-13B. [百度学术]

55

PRESS O, SMITH N A, LEWIS M. Train short, test long: Attention with linear biases enables input length extrapolation[EB/OL]. (2022-04-22)[2023-08-23]. https://arxiv.org/abs/2108.12409v2. [百度学术]

56

NEWSWIRE P. Alibaba cloud unveils new AI model to support enterprises’ intelligence transformation[EB/OL]. (2023-04-10)[2023-08-11]. https://finance.yahoo.com/news/alibaba-cloud-unveils-ai-model-031300094.html. [百度学术]

57

AlibabaCloud. Qwen-7B[EB/OL]. (2023-07-30) [2023-08-15]. https://github.com/QwenLM/Qwen-7B. [百度学术]

58

ZENG A, LIU X, DU Z, et al. GLM-130b: An open bilingual pre-trained model[EB/OL].(2022-08-04)[2023-08-23]. https://arxiv.org/abs/2210.02414. [百度学术]

59

DU Z, QIAN Y, LIU X, et al. GLM: General language model pretraining with autoregressive blank infilling[EB/OL]. (2022-03-17)[2023-08-23]. https://arxiv.org/abs/2103.10360. [百度学术]

60

DAO T, FU D, ERMON S, et al. Flashattention: Fast and memory-efficient exact attention with IO-awareness[J]. Advances in Neural Information Processing Systems, 2022, 35: 16344-16359. [百度学术]

61

SHAZEER N. Fast transformer decoding: One write-head is all you need[EB/OL].(2019-11-06)[2023-08-23]. https://arxiv.org/abs/1911.02150v1. [百度学术]

62

ROHAN T, ISHAAN G, TIANYI Z, et al. Alpaca: A strong, replicable instruction-following model[EB/OL].(2023-03-13)[2023-08-15]. Stanford CRFM. [百度学术]

63

CHIANG W L, LI Z, LIN Z, et al. Vicuna: An open-source chatbot impressing GPT-4 with 90% ChatGPT quality[EB/OL]. (2023-03-30)[2023-08-15]. https://lmsys.org/blog/2023-03-30-vicuna. [百度学术]

64

SUN T, ZHANG X, HE Z, et al. MOSS: Training conversational language models from synthetic data[EB/OL]. (2023-07-10)[2023-08-15]. https://github.com/OpenLMLab/MOSS. [百度学术]