Mistral 7B 比Llama 2更好的开源大模型

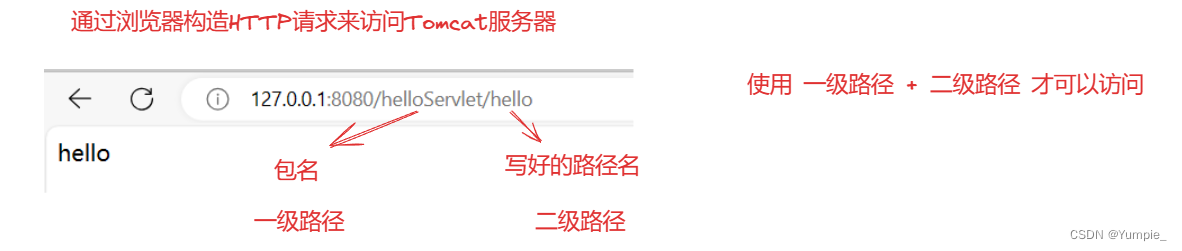

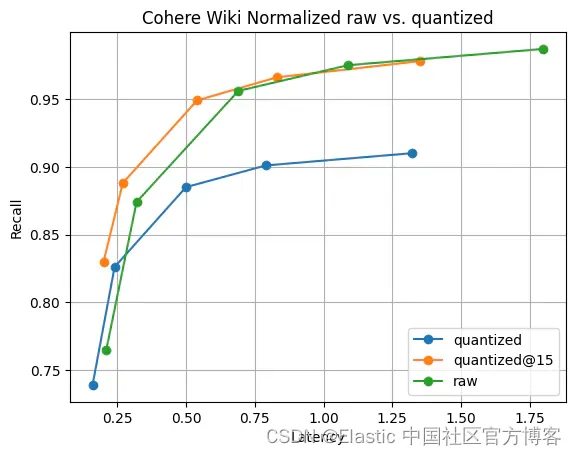

Mistral 7B是一个70亿参数的语言模型,旨在获得卓越的性能和效率。Mistral 7B在所有评估的基准测试中都优于最好的开放13B模型(Llama 2),在推理、数学和代码生成方面也优于最好的发布34B模型(Llama 1)。Mistral 7B模型利用分组查询注意力(GQA)进行更快的推理,再加上滑动窗口注意力(SWA),在降低推理成本的情况下有效处理任意长度的序列。

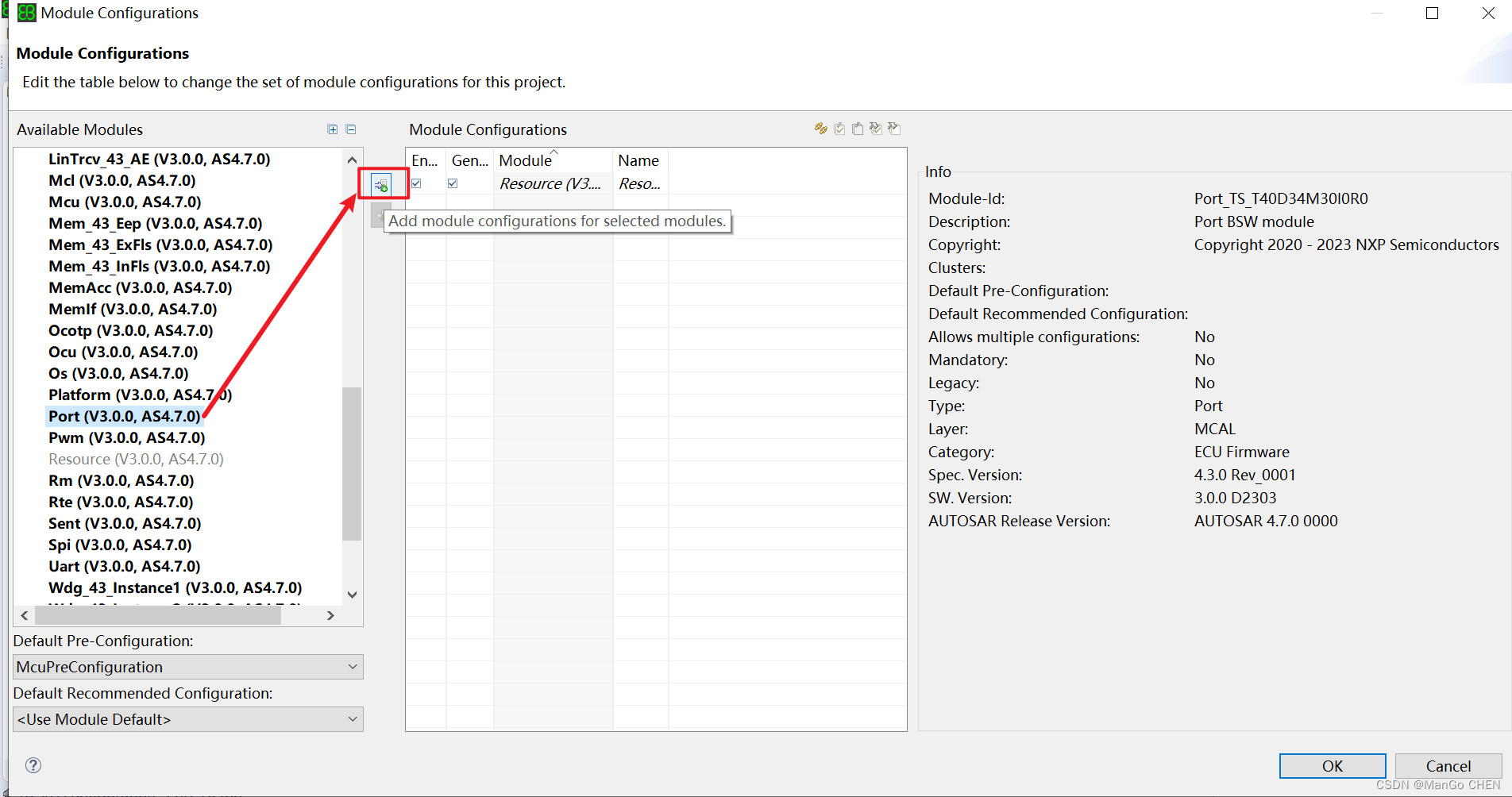

本文学习分组查询注意力(GQA)的论文: GQA: Training Generalized Multi-Query Transformer Models from Multi-Head Checkpoints

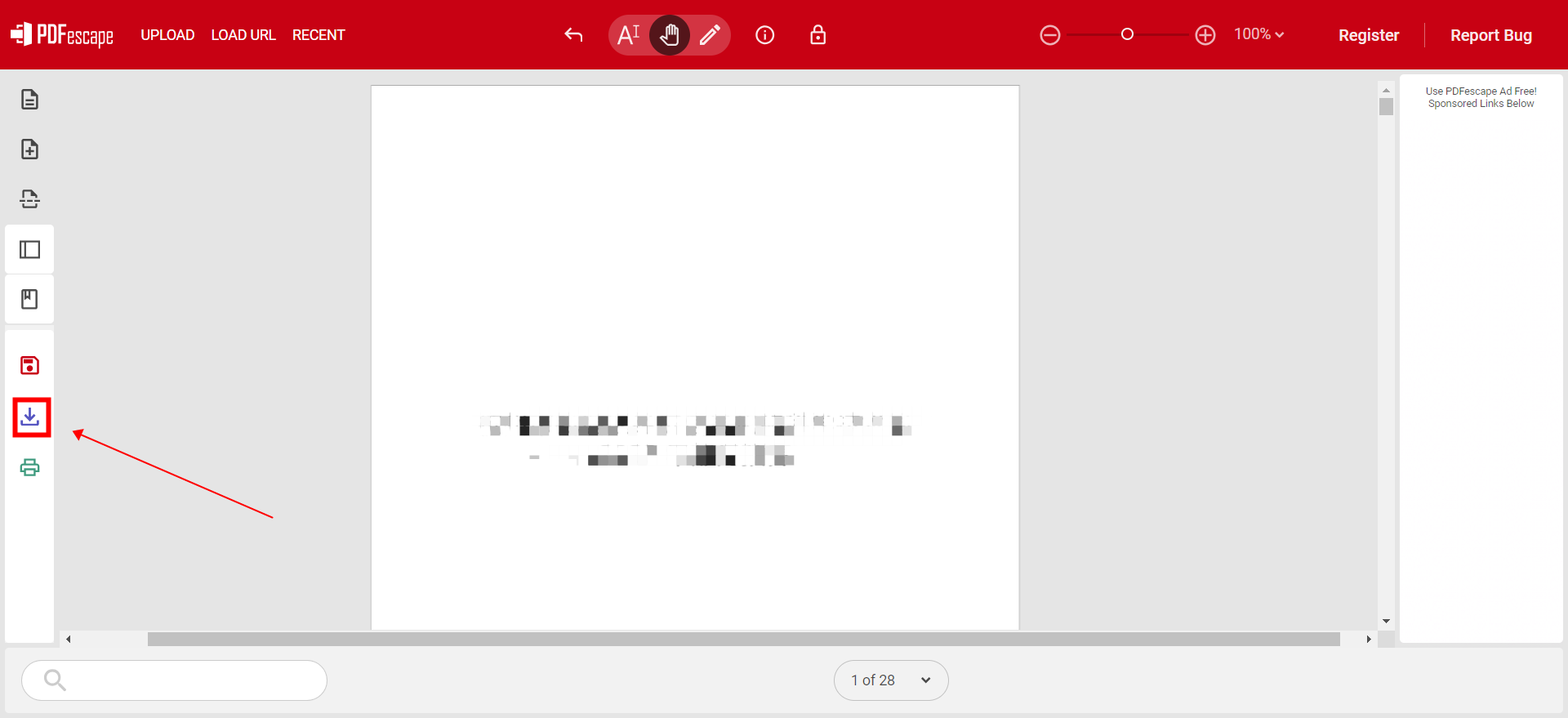

论文链接:

https://arxiv.org/abs/2305.13245

摘要

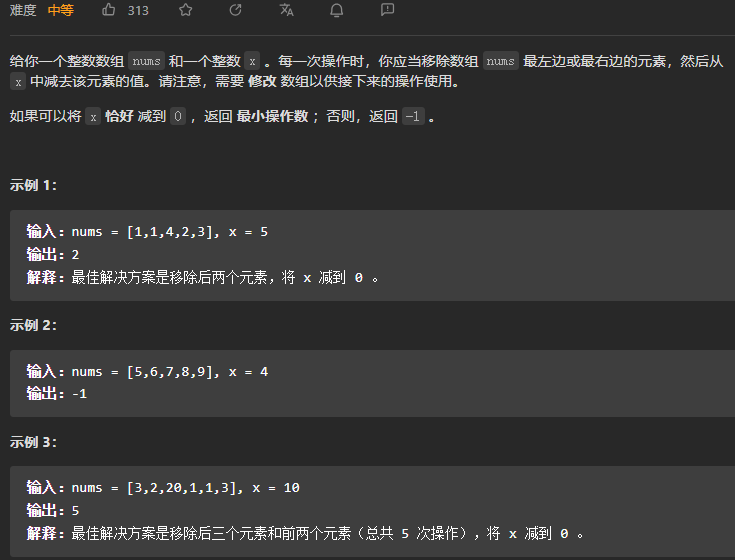

只使用单个键值头的多查询注意力(MQA)大大加快了解码器推理的速度。然而,MQA可能会导致质量下降,而且更严重的是,为了更快的推理而训练单独的模型可能是不可取的。论文(1)提出了一种使用5%的原始预训练计算将现有的多头语言模型检查点升级为具有MQA的模型的方法,以及(2)引入分组查询注意力(GQA),这是多查询注意力的一种推广,它使用中间数量(多于一个,少于查询头的数量)的键值