Batch Normalization(批标准化)是一种深度学习中的正则化技巧,它可以改进网络的训练过程。在训练神经网络时,Batch Normalization可以帮助解决内部协变量偏移(Internal Covariate Shift)的问题。

在标准的神经网络训练中,每一层的输入分布都会随着训练的进行而发生变化,这使得网络训练变得困难。Batch Normalization通过在每一层中规范化输入分布,使得网络更稳定,从而加速了训练。

然而,Batch Normalization并不一定需要在每个batch_size为1的情况下报错。实际上,Batch Normalization在每个batch_size为1的情况下是可以正常工作的。在这种情况下,每个batch的均值和方差会被计算出来,然后使用这些统计数据来进行规范化。

然而,当batch_size为1时,Batch Normalization的效果可能会降低,因为它失去了批处理的优点,比如能够更好地估计网络输入的总体分布。此外,batch_size为1还会导致收敛速度变慢,因为无法利用前一层的参数进行梯度更新。

所以,虽然Batch Normalization可以在batch_size为1的情况下运行,但这通常不是最佳实践。标准的Batch Normalization通常使用较大的batch_size,这样可以更好地估计总体分布,加速收敛,并减少内部协变量偏移的问题。

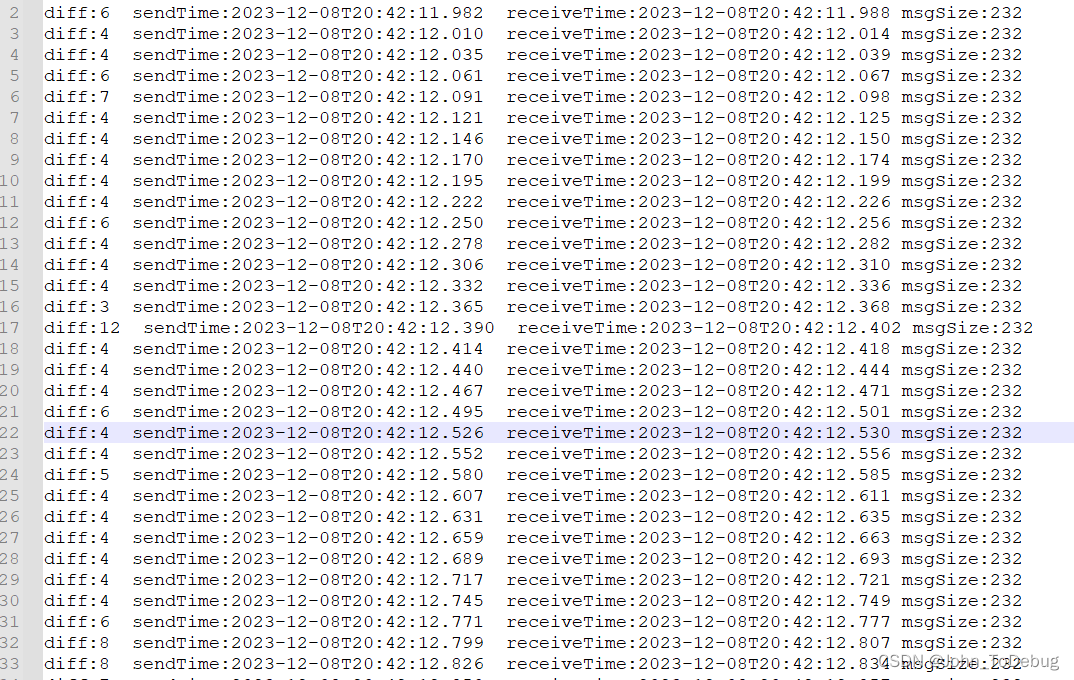

计算方法:N×H×W 数据上计算 mean and variance。batch normalization 对 batch size 的大小敏感,每次计算均值和方差是在一个 batch 上。如果 batch size 太小,则计算的均值、方差不足以代表整个数据分布 (不能反映全局的统计信息)。