HDFS

- 一、HDFS概述

- 1.1 HDFS适用场景

- 1.2 HDFS优缺点

- 1.3 HDFS文件块大小

- 二、HDFS的shell操作

- 2.1 上传

- 2.2 下载

- 2.3 HDFS直接操作

一、HDFS概述

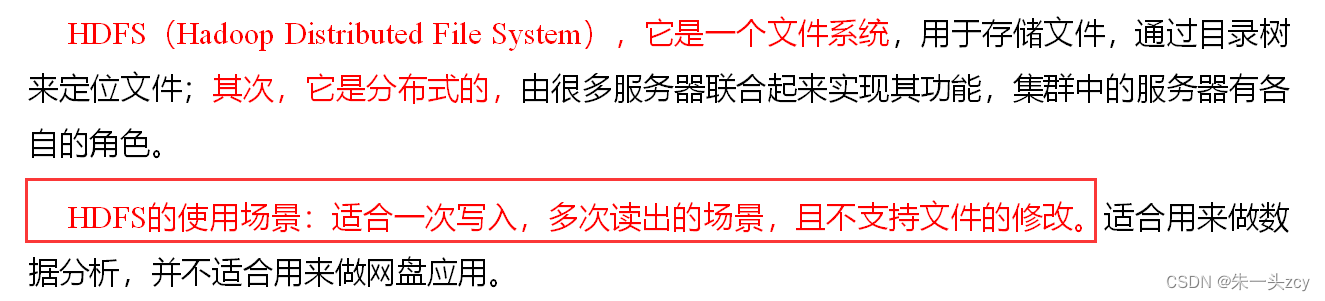

1.1 HDFS适用场景

因为HDFS里所有的文件都是维护在磁盘里的

在磁盘中对文件的历史内容进行修改 效率极其低(但是追加可以)

1.2 HDFS优缺点

-

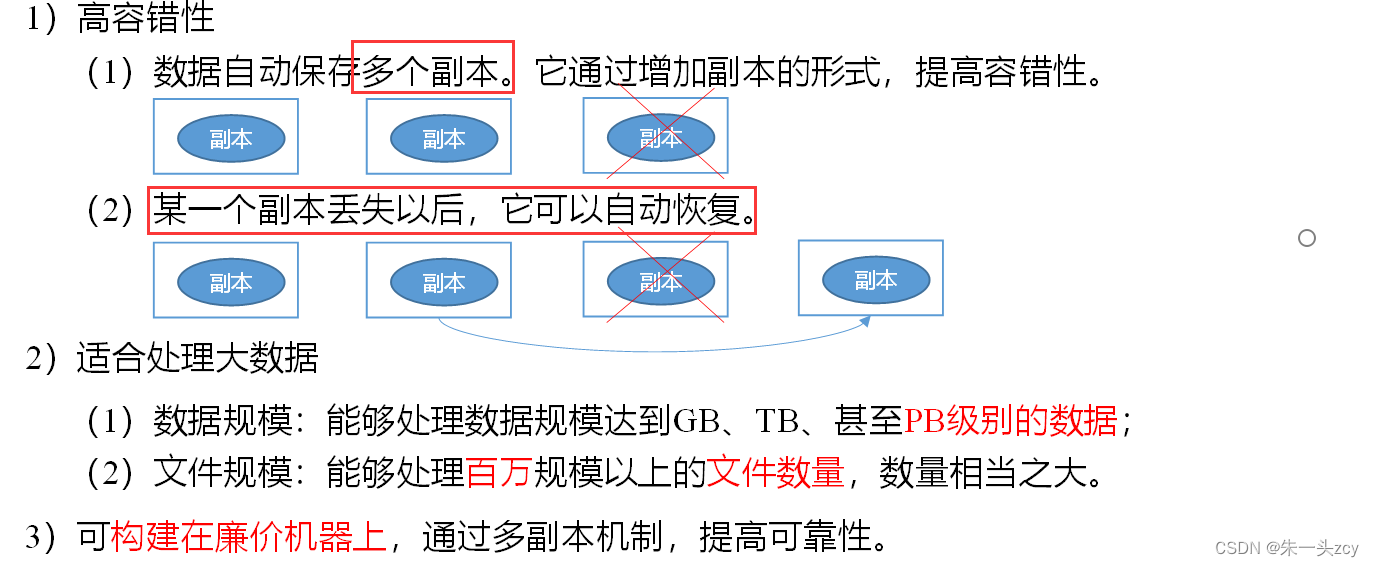

优点

-

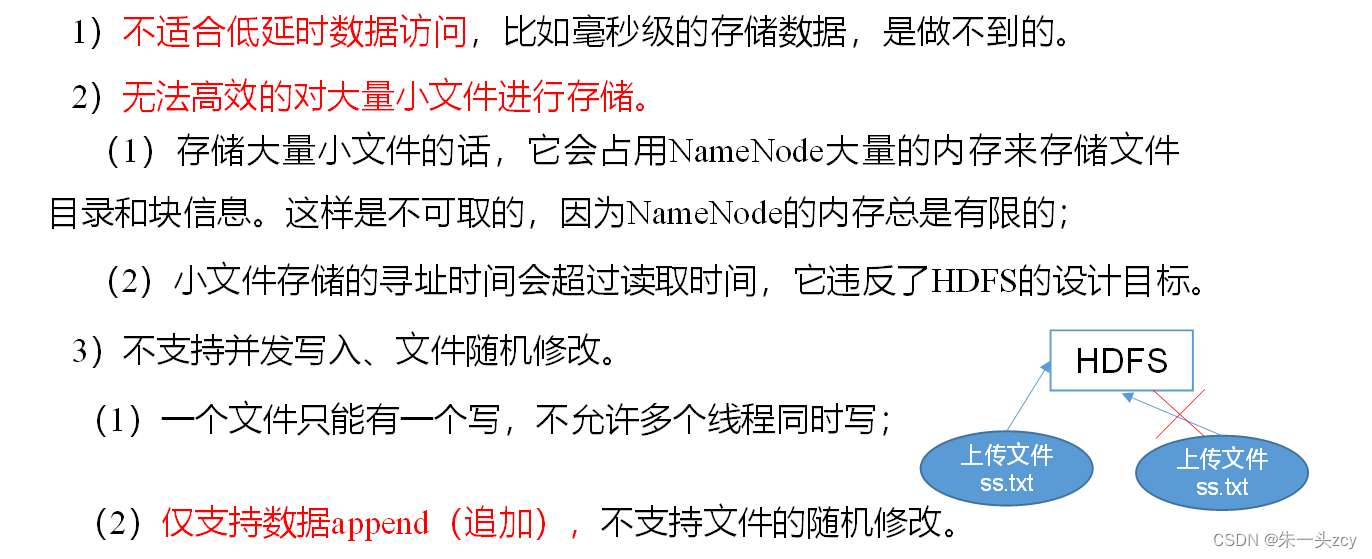

缺点

因为数据量太大 且磁盘IO操作很多 所以不适合低延时的要求

那HDFS为什么怕小文件呢-因为不管是大文件 还是小文件 他们对应的元数据信息大小都是一样的(大概150字节) 而元数据都是存在服务器的内存中 这是有限的

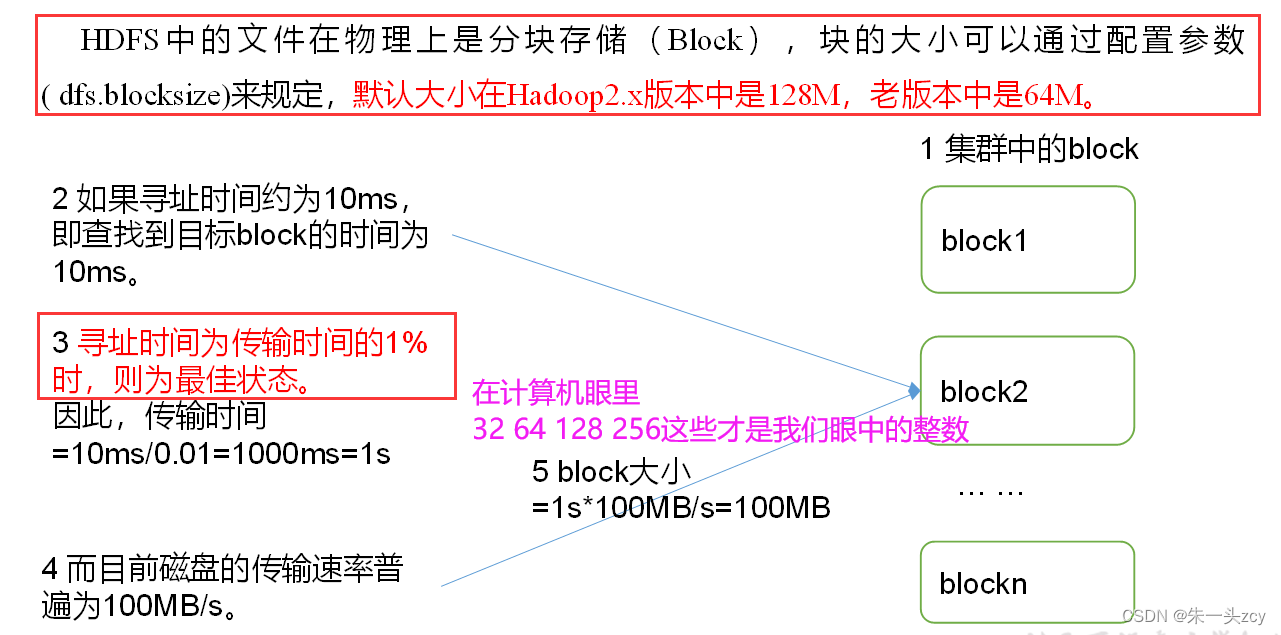

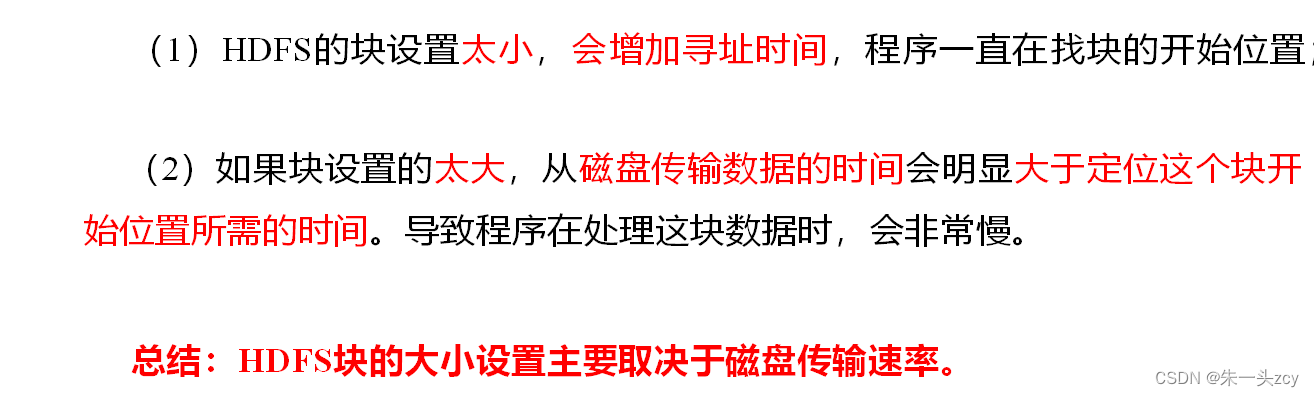

1.3 HDFS文件块大小

二、HDFS的shell操作

2.1 上传

-

-moveFromLocal:从本地剪切粘贴到HDFS(本地就没了)

hadoop fs -moveFromLocal ./test.txt /test -

-copyFromLocal:从本地文件系统中拷贝文件到HDFS(本地还有)

hadoop fs -copyFromLocal README.txt /test -

-appendToFile:追加一个文件到已经存在的文件末尾

hadoop fs -appendToFile liubei.txt /shuguo/kongming.txt -

-put:等同于copyFromLocal

hadoop fs -put ./test2.txt /test/

2.2 下载

- -copyToLocal:从HDFS拷贝到本地

hadoop fs -copyToLocal /sanguo/shuguo/kongming.txt ./ - -get:等同于copyToLocal

hadoop fs -get /sanguo/shuguo/kongming.txt ./ - -getmerge:合并下载多个文件(把多个文件的内容合并放在一个文件)

hadoop fs -getmerge /user/atguigu/test/* ./zaiyiqi.txt

2.3 HDFS直接操作

-

-ls: 显示目录信息

hadoop fs -ls / -

-mkdir:在HDFS上创建目录(-p创建多级目录)

hadoop fs -mkdir -p /sanguo/shuguo -

-cat:显示文件内容

hadoop fs -cat /sanguo/shuguo/kongming.txt -

-chgrp -chmod -chown:Linux文件系统中的用法一样 修改权限(Web可以直接改)

-

-cp :从HDFS的一个路径拷贝到HDFS的另一个路径

hadoop fs -cp /sanguo/shuguo/kongming.txt /zhuge.txt -

-mv:在HDFS目录中移动(重命名)文件

hadoop fs -mv /zhuge.txt /sanguo/shuguo/ -

-tail:显示一个文件的末尾1kb的数据

hadoop fs -tail /sanguo/kongming.txt -

-rm:删除文件或文件夹

hadoop fs -rm /user/atguigu/test/jinlian2.txt

hadoop fs -rm -r 删文件夹 -

-rmdir:只能删除空目录

hadoop fs -rmdir /test -

-setrep:设置HDFS中文件的副本数量(这里设置的副本数只是记录在NameNode的元数据中 是否真的会有这么多副本 还得看DataNode的数量 因为目前只有3台设备 最多也就3个副本 只有节点数的增加到10台时 副本数才能达到10)

hadoop fs -setrep 10 /sanguo/kongming.txt

![[LLM]大语言模型文本生成—解码策略(Top-k Top-p Temperature)](https://img-blog.csdnimg.cn/direct/86f9ea13949944a69dfcb13f86e65def.png)