0. 简介

精确且长期稳定的定位对于停车场内的行车任务,如自动驾驶或自动代客泊车等,至关重要。现有方法依赖于固定且内存效率低下的地图,缺乏强大的数据关联方法,不适用于精确的定位或长期地图维护。《LESS-Map: Lightweight and Evolving Semantic Map in Parking Lots for Long-term Self-Localization》一文提出了一种基于地面语义特征、利用低成本摄像头的新型地图制作、定位和地图更新系统,提出了一种精确且轻量级的参数化方法,用于建立改进的数据关联,实现厘米级别的精确定位。此外还提出了一种新颖的地图更新方法,通过对参数化的语义特征实现高质量的数据关联,允许在重新定位过程中进行连续地图更新和细化,同时保持厘米级别的准确性。

1. 主要贡献

现有方法缺乏对地面语义信息的强大参数化,导致在制图和定位过程中缺乏强大的数据关联,这个不足会对定位的准确性产生不利影响,同时对地图的长期更新能力有所限制。因此,在这项工作中,我们提出了一种用于地面语义特征的准确且轻量级的参数化方法,以帮助提高制图和定位的准确性和效率。此外提出了一种新颖的地图更新方法,允许在重新定位过程中进行连续地图更新和细化,同时保持厘米级别的准确性。本工作的贡献总结如下:

-

提出了一种用于地面语义特征的新型参数化方法,以实现更高效的位姿估计和更强大的数据关联。

-

提出了一种轻量级的地图维护方法,可以通过后续车辆的定位结果进行更新,实现厘米级别的定位精度。

-

提供了一个完整而实用的地图制作、定位和地图更新流程,通过实际实验在室外和室内场景中表现出可靠性。

2. 系统概述

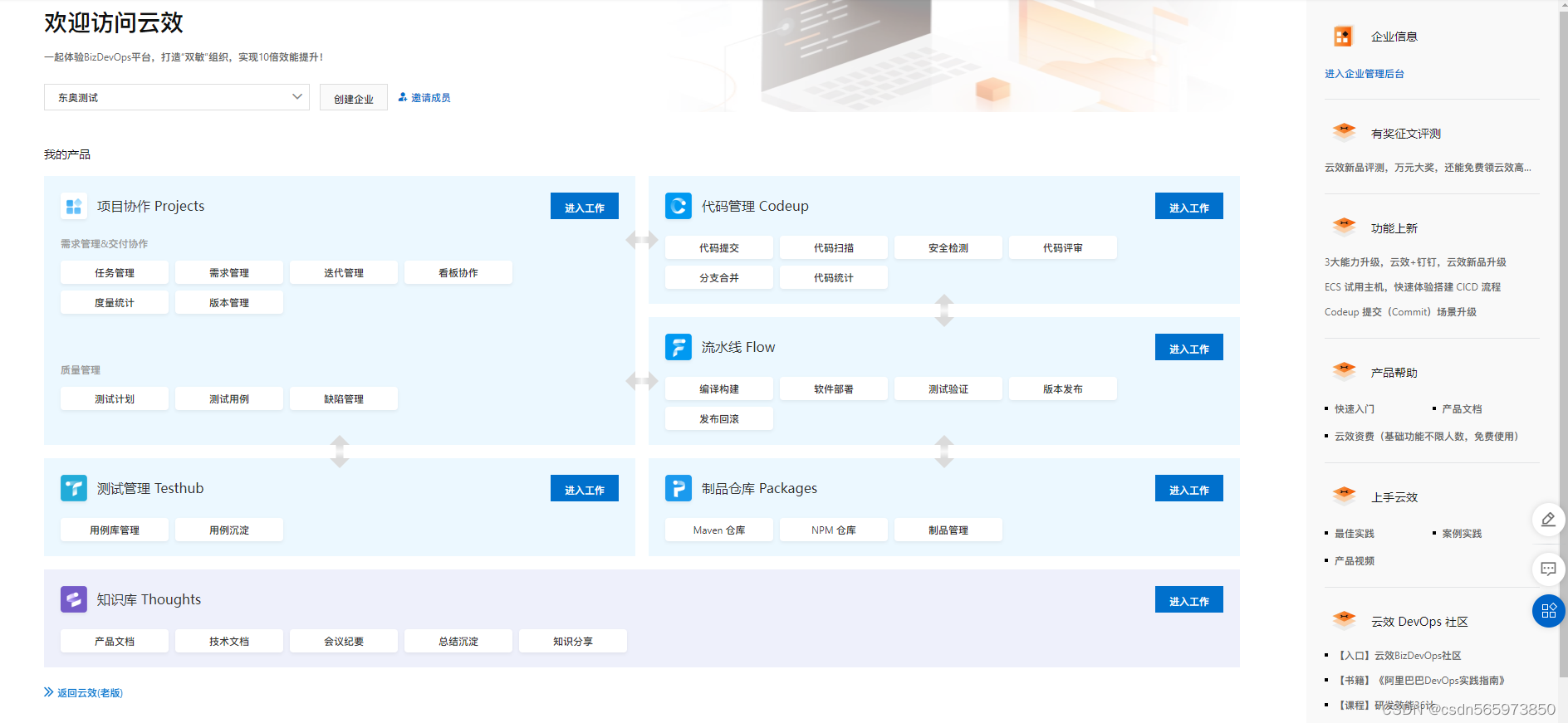

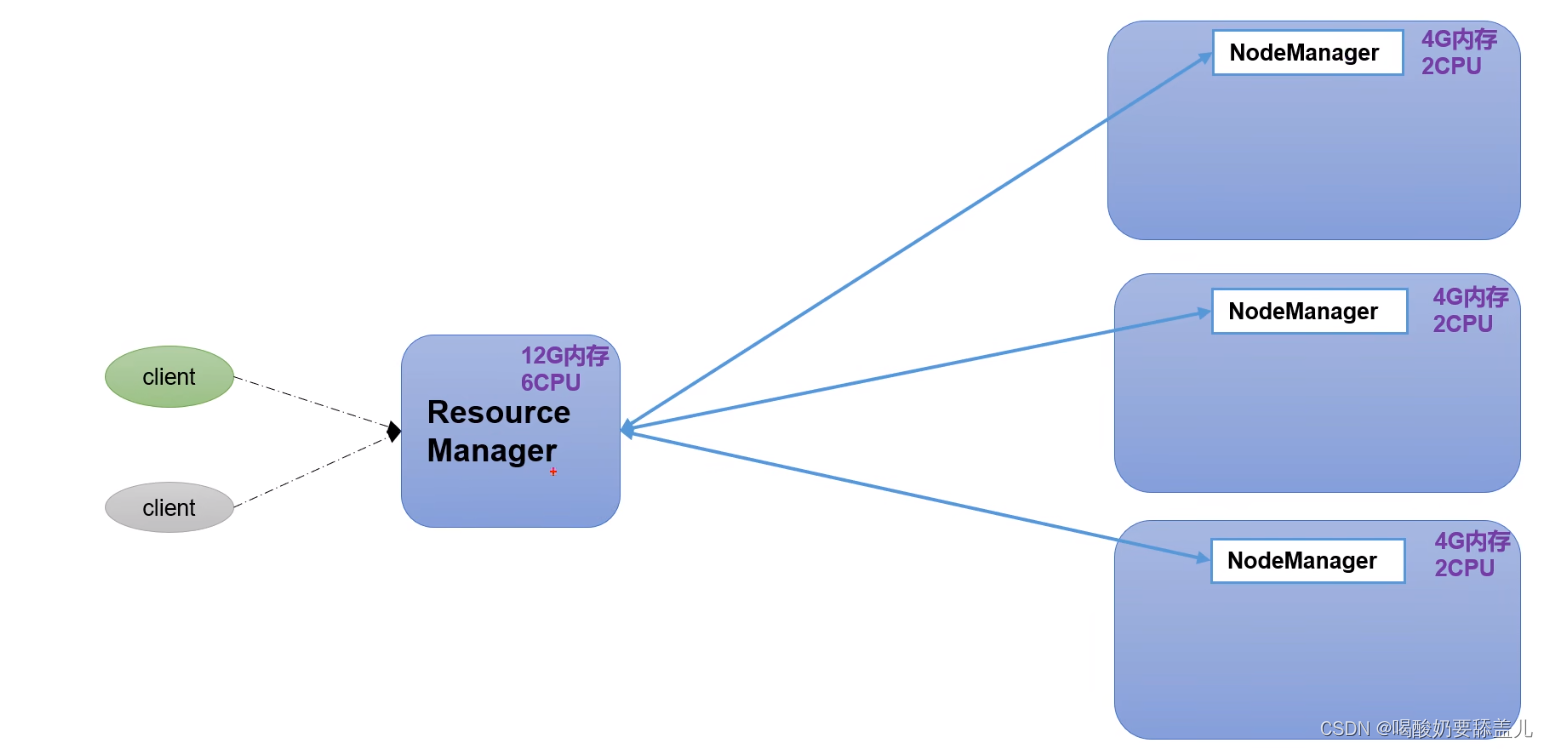

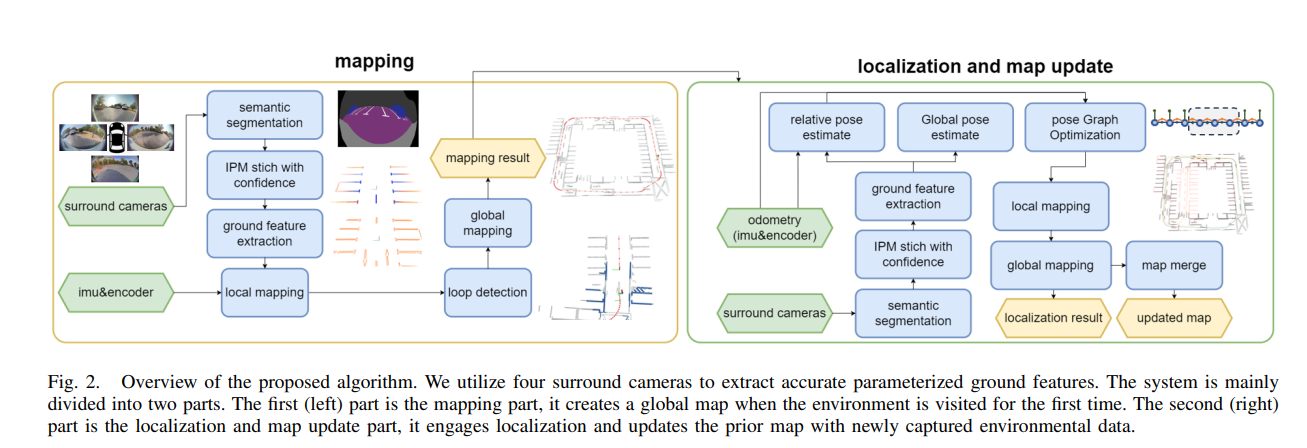

我们利用四个环视鱼眼摄像头、惯性测量单元(IMU)和轮子编码器来捕捉周围环境并估计车辆的轨迹。所提出的算法包括两个主要组成部分:建图和定位,如图2所示。

图2. 提出算法的概述。我们利用四个周围摄像头提取准确的参数化地面特征。系统主要分为两个部分。第一个(左侧)部分是建图部分,当首次访问环境时,它创建一个全局地图。第二个(右侧)部分是定位和地图更新部分,它进行定位并使用新捕获的环境数据更新先前的地图。

建图:当车辆首次进入环境时,一个基本任务是构建一个全局地图,作为后续定位和地图更新的基础。我们从环视摄像头中提取地面语义特征,并将其投影到三维空间中。通过估计这些观测的不确定性来增强地图融合。然后,我们使用第III-C节中详细介绍的方法对这些特征进行参数化。结果,全局地图通过姿态估计和闭环的精化而生成。

定位和地图更新:在构建全局地图之后,当车辆返回环境时,可以利用新捕获的环境数据进行定位和地图更新。考虑到环境的动态性和可能进入未映射区域的可能性,我们构建了一个因子图来融合里程计和定位结果,得到一个经过微调的全局轨迹和一个新生成的地图。然后,新生成的地图与现有地图无缝合并,确保地图更新过程的稳健性和一致性。

3. 义分割和云投影

我们采用一个强大的分割网络[23],从原始的鱼眼图像中有效地检测地面、车道线和道路标记。在语义分割之后,我们将鱼眼图像转换为车辆坐标系内的语义点云。这个转换过程包括对鱼眼图像进行去畸变处理和执行逆透视映射(IPM)[24]。

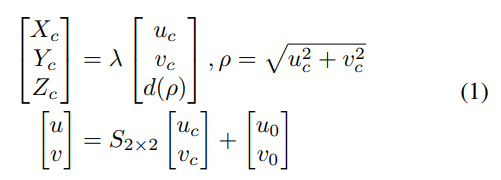

鱼眼相机使用实用的鱼眼相机模型[25]进行建模,该模型将相机的投影模型表示如下:

在图像中, u u u和 v v v是像素坐标, u c u_c uc和 v c v_c vc是以相机光轴为原点的像素坐标, u 0 u_0 u0和 v 0 v_0 v0是像素坐标系中光轴中心的坐标, λ λ λ是一个比例因子, d ( ρ ) d(ρ) d(ρ)表示畸变多项式 d ( ρ ) = a 0 + a 2 ρ 2 + a 3 ρ 3 + a 4 ρ 4 d(ρ) = a_0 + a_2ρ^2 + a_3ρ^3 + a_4ρ^4 d(ρ)=a0+a2ρ2+a3ρ3+a4ρ4, S S S是拉伸矩阵。因此,与鱼眼图像中像素坐标 u u u、 v v v对应的无畸变坐标 u ′ u^′ u′、 v ′ v^′ v′可以表示为: