文章目录

- TCL: Triplet Consistent Learning for Odometry Estimation of Monocular Endoscope

- 摘要

- 方法

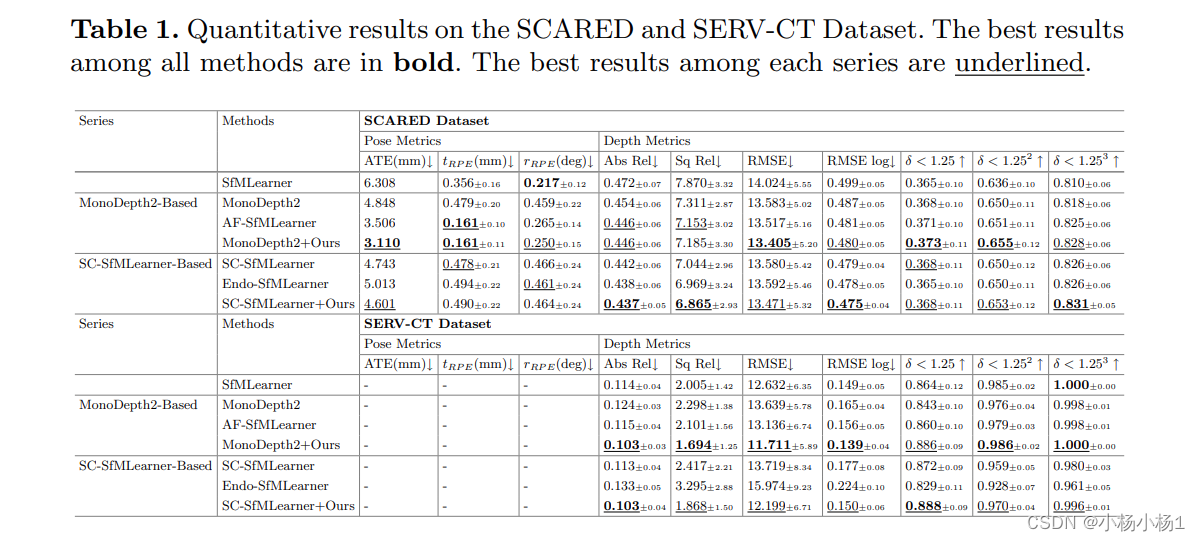

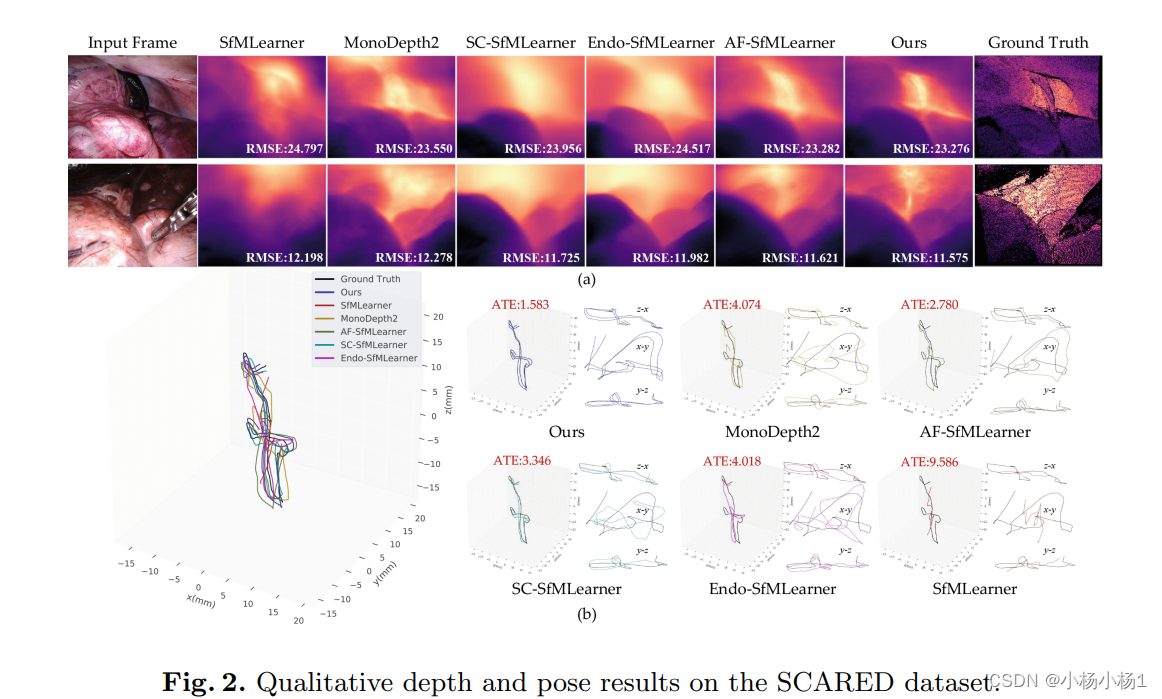

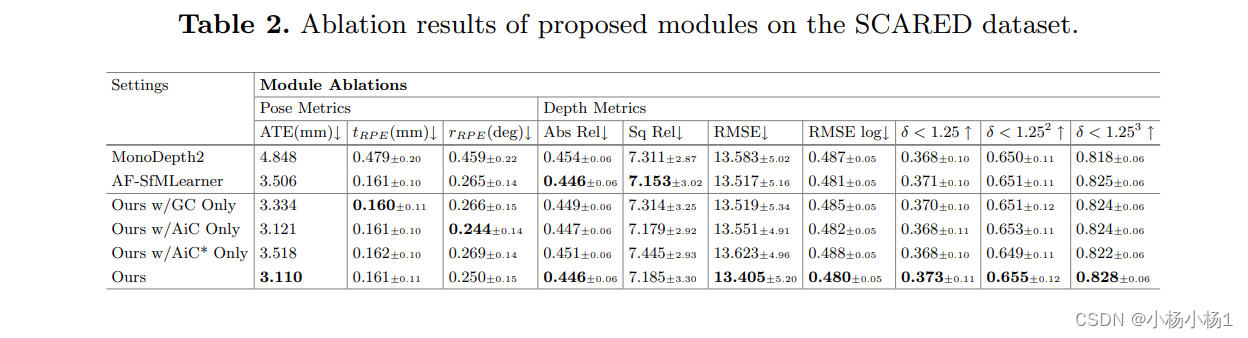

- 实验结果

TCL: Triplet Consistent Learning for Odometry Estimation of Monocular Endoscope

摘要

单目图像中深度和姿态的估计对于计算机辅助导航至关重要。由于很难获得深度和姿态的真值标注,无监督训练方法在内窥镜场景中具有广阔的前景。然而,内窥镜数据集缺乏足够的视觉变化多样性,图像三元组中也频繁出现外观不一致的问题。

本文提出了一种三元组一致性学习框架(TCL),包括两个模块:几何一致性模块(GC)和外观不一致模块(AiC)。为丰富内窥镜数据集的多样性,GC模块生成合成三元组并通过特定损失函数强制实现几何一致性。为减少图像三元组中的外观不一致,AiC模块引入三元组遮蔽策略来作用于光度损失。

代码地址

方法

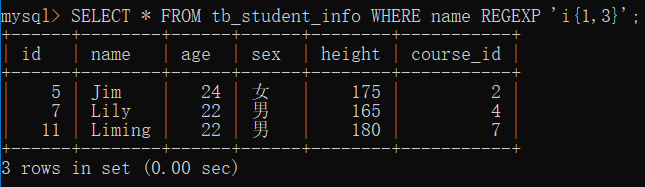

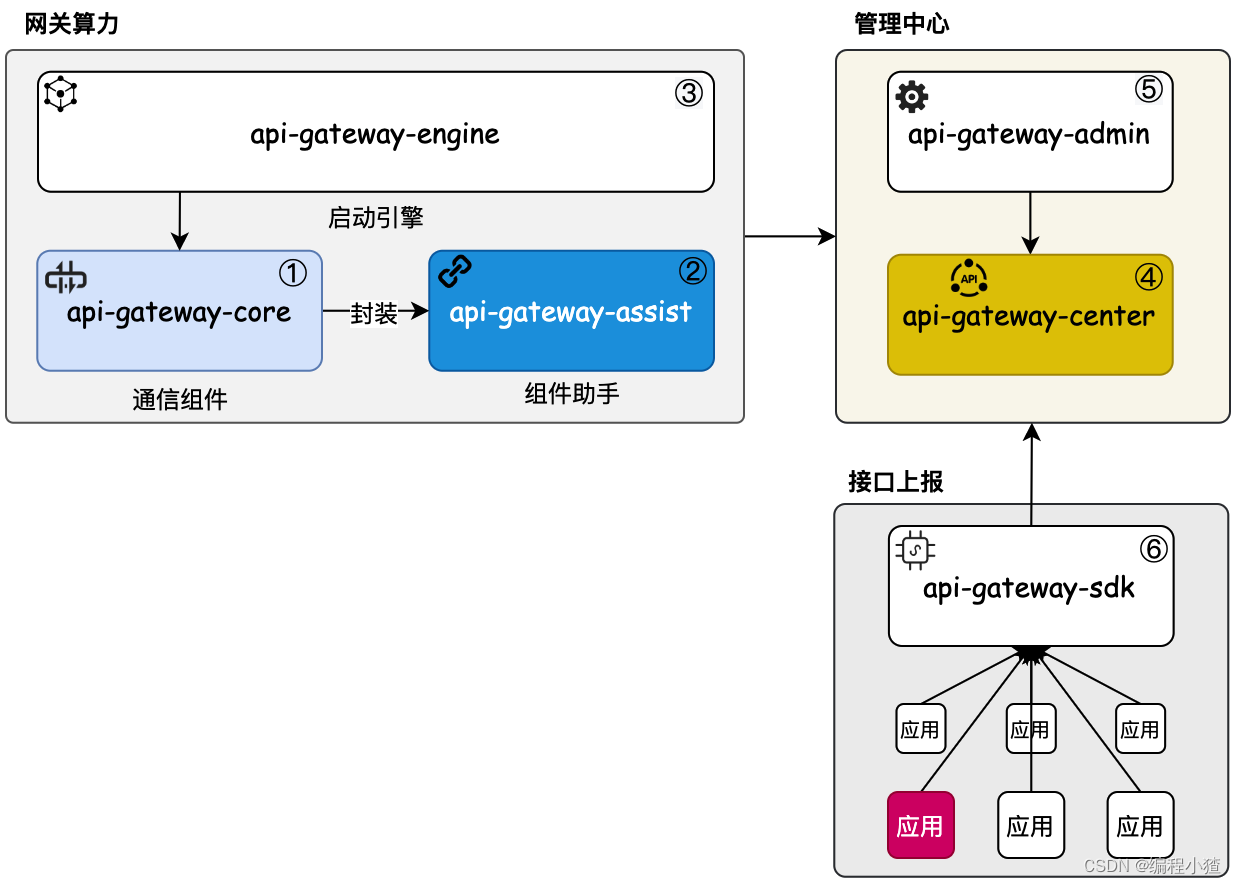

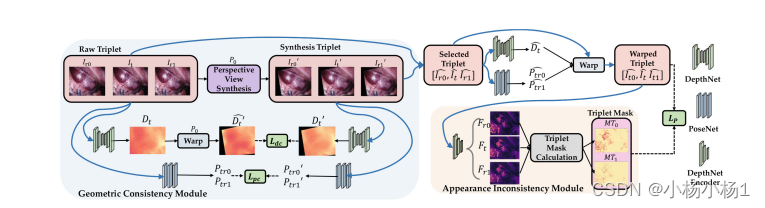

图1描述三元组一致性学习框架(TCL)的总体架构,包含两个模块:

- 几何一致性模块(GC):

- 利用透视视图合成技术生成合成三元组

- 通过深度一致性损失Ldc和姿态一致性损失Lpc来强制实现几何一致性

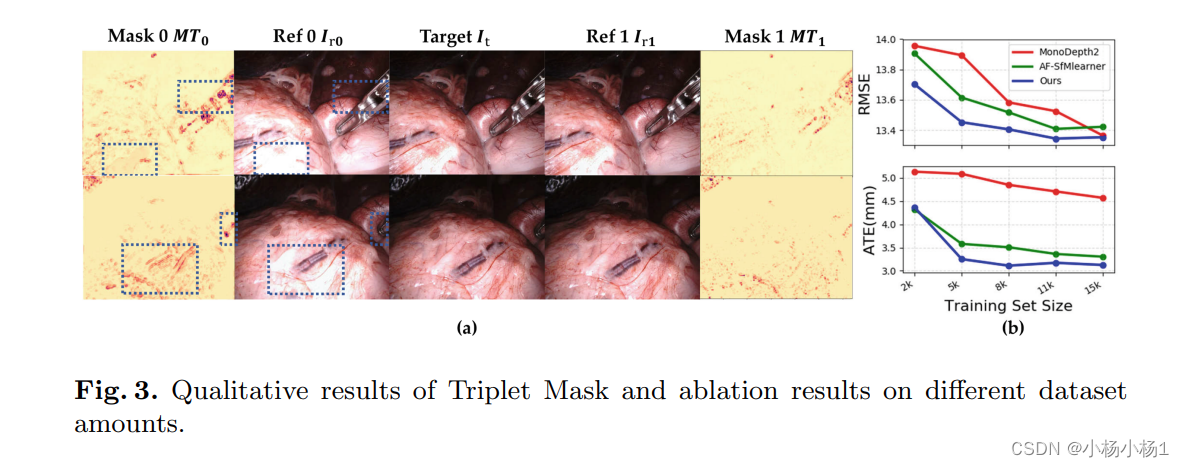

- 外观不一致模块(AiC):

- 基于翘曲三元组生成三元组掩码

- 将掩码应用于光度损失Lp,以减少外观不一致的影响

该框架可以轻松嵌入到无监督的结构从运动(SfM)方法中,无需增加额外的模型参数。这种设计旨在提高单目内窥镜里程计估计的精度,特别是在内窥镜数据集缺乏视觉变化和存在外观不一致的情况下。

实验结果