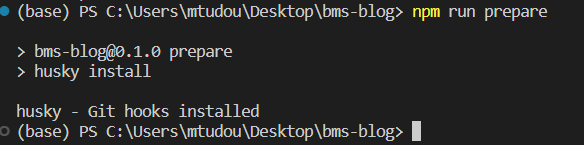

【Pytorch】一文向您详细介绍 torch.tensor() 的常见用法

下滑即可查看博客内容

🌈 欢迎莅临我的个人主页 👈这里是我静心耕耘深度学习领域、真诚分享知识与智慧的小天地!🎇

🎓 博主简介:985高校的普通本硕,曾有幸发表过人工智能领域的 中科院顶刊一作论文,熟练掌握PyTorch框架。

🔧 技术专长: 在CV、NLP及多模态等领域有丰富的项目实战经验。已累计提供近千次定制化产品服务,助力用户少走弯路、提高效率,近一年好评率100% 。

📝 博客风采: 积极分享关于深度学习、PyTorch、Python相关的实用内容。已发表原创文章600余篇,代码分享次数逾七万次。

💡 服务项目:包括但不限于科研辅导、知识付费咨询以及为用户需求提供定制化解决方案。

🌵文章目录🌵

- 🧮 一、引言

- 🔬 二、`torch.tensor` 的基本概念

- 📜 三、`torch.tensor` 的常见用法

- 3.1 创建张量

- 3.2 张量的操作

- 3.3 张量与NumPy的互操作性

- 💡 四、`torch.tensor` 的进阶用法

- 4.1 使用GPU加速张量运算

- 4.2 自动微分与梯度

- 🚀 五、`torch.tensor` 的高级特性

- 5.1 稀疏张量

- 5.2 分布式张量

- 🔍 六、注意事项和常见问题

- 6.1 内存管理

- 6.2 数据类型

- 6.3 GPU与CPU之间的数据传输

- 🌈 七、总结与展望

下滑即可查看博客内容

🧮 一、引言

在PyTorch中,torch.tensor 是核心数据结构,用于存储和操作多维数组(即张量)。无论是进行简单的数学运算还是复杂的深度学习模型训练,torch.tensor 都是不可或缺的。本文将带您深入了解 torch.tensor 的常见用法,让您轻松掌握这个强大的工具。

🔬 二、torch.tensor 的基本概念

torch.tensor 是一个多维数组,可以包含任意数量的维度(也称为轴或秩)。在PyTorch中,张量可以是任何数据类型(如浮点数、整数、布尔值等),但最常见的是浮点数张量,用于存储神经网络中的权重和激活值。

张量的形状(shape)是一个元组,表示每个维度的大小。例如,一个形状为 (3, 4) 的二维张量可以看作是一个 3x4 的矩阵。

📜 三、torch.tensor 的常见用法

3.1 创建张量

在PyTorch中,有多种方法可以创建张量。以下是一些常见的示例:

import torch# 从数据创建张量

x = torch.tensor([1, 2, 3])

print(x) # tensor([1, 2, 3])# 从NumPy数组创建张量

import numpy as np

y = np.array([[1, 2], [3, 4]])

z = torch.from_numpy(y)

print(z) # tensor([[1, 2],# [3, 4]])# 使用特定数据类型创建张量

a = torch.tensor([1.0, 2.0, 3.0], dtype=torch.float64)

print(a) # tensor([1., 2., 3.], dtype=torch.float64)# 使用形状和数据类型创建全零张量

b = torch.zeros((2, 3), dtype=torch.int64)

print(b) # tensor([[0, 0, 0],# [0, 0, 0]])# 使用形状和数据类型创建全1张量

c = torch.ones((2, 3), dtype=torch.float32)

print(c) # tensor([[1., 1., 1.],# [1., 1., 1.]])# 使用形状和数据类型创建随机初始化张量

d = torch.randn((2, 3))

print(d) # 输出将是一个形状为(2, 3)的随机浮点数张量

3.2 张量的操作

PyTorch提供了丰富的张量操作函数,包括数学运算、索引、切片、重塑等。以下是一些示例:

# 张量加法

e = x + z # 假设x是一个一维张量,z是一个二维张量,这里会发生广播(broadcasting)

print(e)# 张量乘法(逐元素相乘)

f = x * z[:, 0] # 假设我们想要将x与z的第一行逐元素相乘

print(f)# 索引和切片

g = z[0, :] # 获取z的第一行

print(g)# 重塑张量

h = g.reshape((1, 2)) # 将g重塑为一个形状为(1, 2)的二维张量

print(h)

3.3 张量与NumPy的互操作性

PyTorch和NumPy之间有着良好的互操作性。您可以将PyTorch张量转换为NumPy数组,也可以将NumPy数组转换为PyTorch张量。这种互操作性使得在PyTorch和NumPy之间迁移代码变得非常容易。

# 将PyTorch张量转换为NumPy数组

i = z.numpy()

print(i) # 输出一个NumPy数组# 将NumPy数组转换为PyTorch张量

j = torch.from_numpy(i)

print(j) # 输出一个PyTorch张量

💡 四、torch.tensor 的进阶用法

4.1 使用GPU加速张量运算

如果您的计算机上安装了NVIDIA GPU并安装了CUDA支持的PyTorch版本,则可以使用GPU来加速张量运算。这可以通过将张量移动到GPU上来实现。

# 检查是否有可用的GPU

if torch.cuda.is_available():device = torch.device('cuda')# 将张量移动到GPUk = x.to(device)print(k) # 输出将显示张量位于哪个GPU上# 在GPU上进行运算l = k * 2print(l) # 结果也在GPU上

else:print('No GPU available.')

4.2 自动微分与梯度

在PyTorch中,torch.tensor 支持自动微分,这对于深度学习模型的训练至关重要。通过调用 .requires_grad_() 方法,您可以告诉PyTorch跟踪对张量的所有操作,以便稍后可以自动计算梯度。

# 创建一个需要梯度的张量

m = torch.tensor([1.0, 2.0, 3.0], requires_grad=True)# 对张量进行运算

n = m * m# 计算梯度(需要先调用backward方法)

n.backward()# 输出梯度

print(m.grad) # tensor([2., 4., 6.])

🚀 五、torch.tensor 的高级特性

5.1 稀疏张量

对于某些应用,如自然语言处理中的词嵌入或推荐系统中的稀疏矩阵,稀疏张量是非常有用的。PyTorch提供了对稀疏张量的支持,允许您以更有效的方式存储和操作这些数据。

5.2 分布式张量

随着数据集和模型变得越来越大,分布式计算变得越来越重要。PyTorch提供了分布式张量(torch.distributed.tensor)的支持,允许您在不同的设备或节点之间分发张量数据,以实现并行计算和加速训练。

🔍 六、注意事项和常见问题

6.1 内存管理

使用大型张量时,内存管理变得非常重要。请确保在不再需要张量时及时释放其占用的内存,以避免内存泄漏和性能下降。您可以使用 del 语句或将张量设置为 None 来释放内存。

6.2 数据类型

选择正确的数据类型对于性能和精度至关重要。请根据您的需求和数据集选择适当的数据类型(如 torch.float32、torch.float64、torch.int32 等)。

6.3 GPU与CPU之间的数据传输

在GPU和CPU之间传输数据可能会产生性能瓶颈。请尽量减少这种传输,并尝试将尽可能多的计算和数据保持在同一设备上。

🌈 七、总结与展望

通过本文的介绍,您应该对 torch.tensor 的常见用法和高级特性有了更深入的了解。torch.tensor 是PyTorch中的核心数据结构,它提供了丰富的功能和灵活性,使您能够轻松地构建和训练深度学习模型。随着PyTorch的不断发展和完善,我们期待看到更多关于 torch.tensor 的新功能和优化。在未来的学习和实践中,请继续关注这个强大的工具,并探索其更多的可能性!#PyTorch #tensor #深度学习 #自动微分 #GPU加速