这篇文章来自华为的渥太华无线先进系统能力中心和无线技术实验室,作者中有大名鼎鼎的童文。

一、自编码架构的全局收发机面临的主要问题

文章对我比较有启发的地方,是提到自编码架构的全局收发机面临的主要问题:

问题一:基于随机梯度下降法,使用反向传播算法训练自编码器,需要一个或多个可微信道模型层,用于连接发射机的深度神经层和接收机的深度神经层。由于真实信道必须包含很多非线性分量(如数字或模拟的预失真与转换),又涉及上采样、下采样等不可微阶段,因此收发机深度神经层训练出来的模型是基于构造的信道而非真实信道。在真实信道场景下,这样得到的模型可能会在推理阶段带来性能损失。

问题二:所有隐藏层或中间层均根据输入信号的后验概率进行训练。在自编码器全局收发机中,接收机深度神经层的第一层是一个中间层,该中间层的输入信号易受当前信道失真的影响。这种影响会不可避免地渗透到接收机的所有深度神经层。如果信道变化的程度大到超出了训练期望,会导致接收机在推理阶段失效。

问题三:神经层之间缺乏可解释性,无法获知哪些神经元以及神经层之间的哪些连接会有效影响最终的学习准确度。 Goodfellow等人举了一个深度神经网络分类器的例子,虽然该分类器通过非噪声图像完成了良好的训练,但仍可能将带噪声的熊猫图像误判为长臂猿。这个例子表明,基于深度神经网络的分类器进行最终决策时,很大程度上依赖于一些“关键路径”(指熊猫图像中的部分像素,也称为“局部特征”)。如果关键路径完好无损,就能做出正确的分类;如果关键路径受到干扰,则会做出错误的分类。同时,这种由噪声导致的分类误判,只是在存在加性随机噪声的前提下出现的偶发情况,这表明深度神经网络依赖于这样一种假设——即 “关键路径”经过噪声信道处理后仍然保持完好。深度神经网络易受加性随机噪声的影响,这对它在无线收发机设计中的应用几乎是致命打击。

这三个问题的本质可以归结为同一个核心问题,即面临无线信道的随机变化时,深度神经网络的泛化性能太差。没有任何模型(即便是十分优越的信道模型)能够完全捕获无线电传播的所有可能场景,因此分布外(Out-of-Distribution, OOD)样本或离群点的处理是自编码器始终要面对的现实问题。

更糟糕的是,针对这些问题的现有解决方案还面临许多阻碍,因为所提出的解决方案必须满足无线通信设备和基础设施的低能耗、低时延、低开销等实际要求。一方面,在动态环境中,自编码器收发机对自身进行累加、增强以及重训练的成本过高;另一方面,进行累加、增强和重训练的整个过程本身也违反了深度神经网络的“Once-for-All”策略——即一次学习、长期有效,进而无法很好地满足现实需要和能耗要求。

在无线场景中,离群点通常由信道的随机变化引起。在推理阶段,如果信道正在发生变化,偏离了训练阶段所使用的信道模型,这时离群点的问题表现得尤为突出。随着推理的进行,会出现更多的离群点,进而影响到接收信号的分布形状, Bengio就将深度学习泛化性能差的原因归咎于这一点。目前有一些补救方法,比如进行额外的训练,包括迁移训练、基于注意力的循环网络,或强化学习。然而,面对未来无线通信低能耗、低时延和低控制开销的要求,这些补救方法变得不切实际,缺乏可行性。

对于文章提出的MPA方法,文章也分析解决思路,重点是下面我标黑的部分:

“首先,为实现可微性,需要简化信道模型,但这种简化会损害自编码器收发机的性能。造成性能损害的原因在于,用来训练自编码器的信道模型是一种简化模型,而非真实模型。也就是说,训练阶段使用的简化信道模型与推理阶段处理的真实信道之间存在偏移,这种偏移带来了性能损失。如果偏移量增加到超出期望的程度,整个自编码器收发机将会失效。有两种补救方法可以缓解这种性能下降。第一种是利用强化学习,不间断地记录信道状态,并对策略DNN和(或)评估 DNN进行持续训练。不过,从维度的复杂程度上讲,强化学习对无线系统来说过于复杂,因为强化学习处理的维度实际上比AlphaGo围棋还要大得多。因此,基于强化学习的调整机制并不可行。第二种是利用生成对抗网络(Generative Adversary Network,GAN),将尽可能多的信道场景学习到一个大的深度神经网络模型中。然而,这是一种经验方法,无法证明该方法能够涵盖所有信道场景。

出于对上述问题的考虑,带MPA的自编码器采取不同的技术路径。在推理阶段,MPA会针对每次数据传输,调整当前信道测量函数中的降维层系数,因此自适应推理会在训练阶段使用一个粗信道模型,我们称之为“粗学习”。如果粗学习对训练和推理两个阶段模拟了相同或相似的信道模型,则很难证明粗学习的优势,不过这种优势可以在实际的现场测试中得到证明。

其次,带MPA的自编码器可以与基于生成对抗网络的信道模型联合工作。从经验来讲,大部分信道的实际条件依赖于用户位置和环境拓扑,比如高层建筑、山丘、道路等。参考文献提出利用条件生成对抗网络,对未知信道建模,并获得了良好的性能。我们可以利用该方法建立一个信道模型,为训练阶段提供良好的支持。

在推理阶段,我们建议依靠导频的信道估计、信道测量反馈或信道互易来获得最新的信道条件。众所周知,MPA还受益于稀疏性,能够较好地容忍偏置与偏移(这也是LDPC解码器可以有效工作的原因)。从这一角度来看,没有必要进行全维信道测量,只需测量部分维度,即使存在一定的估计误差,我们的方案在整体性能上仍具备较好的鲁棒性。另外,残差可以通过误差容忍度较高的接收深度神经层得到处理。由于在推理和训练阶段已经做好了降维层的调整,我们可以将降维层作为整个传输链的预编码器,因而不必在接收深度神经层再做训练。这样不但带来节能效益,而且对延长用户设备的电池寿命也是一种巨大的优势。”

二、文章速读

其实,对文章提出的方法,我个人还是持一种怀疑态度。来简单看看文章的方法。

文章摘要

文章提出了一种基于消息传递算法(Message Passing Algorithm, MPA)的自编码器收发机,以解决传统自编码器在处理随机信道变化时泛化性能较差的问题。作者通过在自编码器中引入MPA,实现了一种灵活的收发机,能够在不同使用场景下提供较好的泛化性能。该方法允许在训练阶段进行粗学习,并在推理阶段实现自适应推理。

解决的主要问题

- 泛化性能问题:传统自编码器收发机在面对随机信道变化时,由于神经元一旦训练完成就固定,导致泛化性能较差。

- 模型与真实信道的偏差:使用基于随机梯度下降法和反向传播算法训练的自编码器,依赖于构造的信道模型而非真实信道,可能导致推理阶段性能损失。

- 信道变化的适应性问题:自编码器全局收发机在信道变化超出训练期望时,可能导致接收机失效。

- 分布外样本处理:无线信道的随机变化导致分布外样本或离群点问题,现有解决方案难以满足无线通信设备的低能耗、低时延、低开销要求。

主要方法

- 消息传递算法(MPA):引入MPA功能,通过预编码器层实现自适应调整,提升收发机在信道动态变化时的泛化性能。

- 降维层:将降维层插入自编码器框架中,进行线性降维转换,并通过MPA对降维层系数进行迭代调整。

- 独立式MPA迭代:采用前向迭代(类似非线性支持向量机)和反向迭代(类似注意力深度神经网络)来独立调整降维层,不依赖于原始自编码器的反向传播。

- 全局串联学习:通过串联训练方案,分别训练降维层和深度神经层,实现粗学习和自适应推理。

- 粗学习与自适应推理:在训练阶段使用简化信道模型进行粗学习,而在推理阶段通过MPA调整降维层以适应当前信道测量情况。

通过这些方法,文章旨在提高自编码器收发机在随机信道变化条件下的性能和泛化能力。

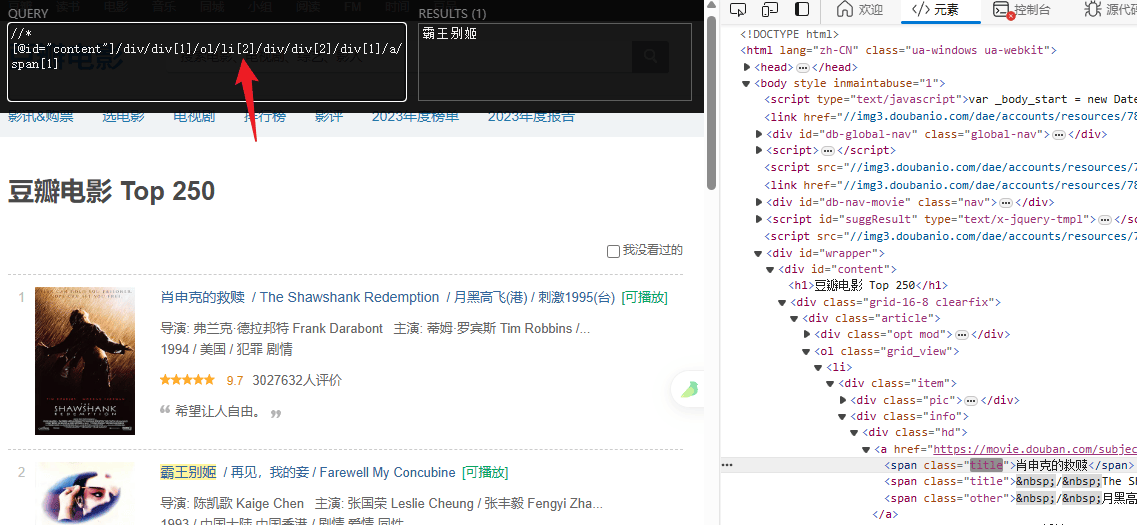

对于文章的MPA方法,看图16和17可以了解大概。

主要是加入了MPA层,完成了发射向量到信道之间的一个维度变换,然后训练的时候先冻结MPA层,完成整体收发的训练后,再迭代训练MPA层。MPA层可以看作是发射的一个预编码映射,具体的维度可以通过对信道的测量获得,这里还是对信道采取了常见的多径假设。MPA层的训练,是依靠接收信号和发射向量之间的注意力。注意力深度神经网络是测量不同维度间两个特征相似度的一种有效方法。应当注意,注意力的数量小于接收信号的数量,即L < N。注意力深度神经网络可以用于降维层的反向传播。

上图显示了带MPA层与传统方式的差异,MPA层可以实现在线学习,而接收信号可以通过信道互易性获得。