基本信息

| 作者 | Jeffrey Pennington | doi | 10.3115/v1/D14-1162 |

|---|---|---|---|

| 发表时间 | 2014 | 期刊 | EMNLP |

| 网址 | https://aclanthology.org/D14-1162.pdf |

研究背景

1. What’s known 既往研究已证实

全局矩阵分解方法:LSA,考虑整个语料库词频的统计信息得到共现矩阵,通过矩阵分解得到潜在语义信息。【有效地利用了统计信息,但它们在单词类比任务上做得相对较差,这表明向量空间结构不是最优的。】

局部上下文窗口方法:skip-gram (以及cbow)。【在类比任务上做得更好,但它们很少利用语料库的统计数据,因为它们在单独的局部上下文窗口上训练,而不是在全局共出现计数上训练。】

2. What’s new 创新点

Glove模型:融合了当时最新的全局矩阵分解方法和局部文本框捕捉方法,即全局词向量表达,利用了全局词词共现矩阵中的非0数据来训练。

3. What’s are the implications 意义

这种新的词向量表达方法提高了很多NLP基础任务的准确率。

研究方法

1. GloVe

α 取值为0.75能得到最好的模型效果。

结果与讨论

- 该模型训练的高效性,且在语料库较小时,也能取得不错的效果。

- 窗口大小逐渐变大,GloVe词向量在语义任务表现最佳。

- 同时使用对称上下文对GloVe词向量在各个任务的表现有益处。

个人思考与启发

拓展学习:论文阅读 - Distributed Representations of Words

用来表示 word 的向量被称为 Embedding,因为这个词被嵌入到(embedded)了向量空间中。

重要图

文献中重要的图记录下来

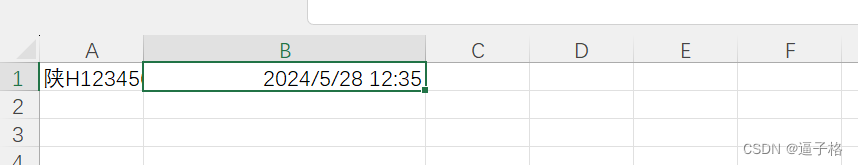

展示了三个不同超参数对最终结果的影响。

第一个是保持窗口对称,且窗口大小固定的情况下,向量维度对最终模型表现的影响。可以看到最初随着维度增加,模型表现也愈佳,但是当维度增加到300以上后,模型表现没有很明显的变化。虽然semantic评估有略微增长,但是维度增加,对资源的消耗也会增加,所以考虑到成本,一般会选择300作为最终的维度。

第二个是指保持窗口对称,维度固定的情况下,窗口大小对模型的影响。

第三个是指窗口不对称,也就是说只考虑前面或者后面的单词,维度固定的情况下,窗口大小对模型的影响。

迭代次数越多越小,效果很稳定。

补充内容: 复习word2vec的核心思路