文章目录

- ==有需要本项目的代码或文档以及全部资源,或者部署调试可以私信博主==

- 项目介绍

- 总体研究方向

- 数据集介绍

- 配置flume文件

- HIve建表

- HIveSQL大数据分析

- MySQL建表

- Sqoop命令导出数据到MySQL

- 数据可视化

- 店铺销售情况.......等

- 总结

- 每文一语

有需要本项目的代码或文档以及全部资源,或者部署调试可以私信博主

项目介绍

本研究基于服装电商用户行为的开源数据展开大数据分析研究,通过Hadoop大数据分析平台对某大型服装电商平台公开的开源数据集进行多维度的用户行为分析,为服装电商销售提供可行性决策。

本次研究选取了2021年12月1日-18号的服装电商数据,其中每一行数据集包含用户的每一次服装相关的行为。首先我们将服装数据集上传到Hadoop中的HDFS存储,之后利用Hadoop的Flume组件,配置好自动加载数据的环境,将服装数据加载到hive数据库中进行大数据分析。通过对常见的服装电商指标:PV、UV、跳失率、复购率等进行统计分析,按照时间维度对服装用户的行为、活跃度等指标进行多维度透视分析,然后对服装电商数据中的热销服装ID及热销服装类别、用户地理位置进行统计分析。将分析出来的服装相关结果表,存入到hive数据库中,然后利用sqoop组件,将hive数据库中的服装分析结果表自动导出到关系型数据库MySQL中,便于服装数据的存储和分析展示。

之后对于分析的服装结果数据表,采用Python的pyecharts可视化库进行前端可视化展示,通过调用MySQL中的服装数据集,绘制多维度的服装相关可视化图表类型,便于理解和展示。最后,结合pyecharts中page方法对这些服装数据可视化利用前后端交互的大屏可视化展示设计,并结合HTML大屏可视化进行静态服装数据的写入,搭建一个炫酷的服装数据可视化大屏。将这些服装分析结果通过丰富的图表展示出来可以帮助服装电商决策者可以快速做出决策。

总体研究方向

本研究的主要目的是利用服装电商用户行为的开源数据展开大数据分析研究,以提供对于服装电商销售的可行性决策。为此,本研究选择了某大型服装电商平台公开的开源数据集,并将其上传到Hadoop的HDFS存储中进行存储。之后,利用Hadoop的Flume组件对服装数据进行自动加载,将数据加载到hive数据库中进行大数据分析。

在分析的过程中,本研究首先针对常见的服装电商指标,如PV、UV、跳失率、复购率等进行统计分析,以了解服装用户行为的基本情况。然后,按照时间维度对服装用户的行为、活跃度等指标进行多维度透视分析,进一步了解服装用户行为的变化趋势和规律。此外,本研究还对服装电商数据中的热销服装ID及热销服装类别、用户地理位置等因素进行统计分析,以了解服装用户购买行为的特点和偏好。

为了便于服装数据的存储和分析展示,本研究将分析出来的服装结果表存入到hive数据库中,并利用sqoop组件将其自动导出到关系型数据库MySQL中。在此基础上,本研究采用Python的pyecharts可视化库进行前端可视化展示,通过调用MySQL中的服装数据集,绘制多维度的服装相关可视化图表类型,便于理解和展示。最后,结合pyecharts中page方法对这些服装数据可视化利用前后端交互的大屏可视化展示设计,并结合HTML大屏可视化进行静态服装数据的写入,搭建一个炫酷的服装数据可视化大屏。这些服装分析结果通过丰富的图表展示出来可以帮助服装电商决策者可以快速做出决策。

综上所述,本研究的总体研究路线可以概括为:首先,对于服装电商用户行为的开源数据进行大数据分析,包括基本指标、多维度透视分析以及服装用户购买行为的特点和偏好。然后,将服装分析结果存储到hive数据库中,并导出到MySQL数据库,便于服装数据的存储和分析展示。最后,采用Python的pyecharts可视化库进行前端可视化展示,通过调用MySQL中的服装数据集,绘制多维度的服装相关可视化图表类型,搭建一个炫酷的服装数据可视化大屏,以便于理解和展示服装分析结果,帮助服装电商决策者快速做出决策。

本研究的研究路线的详细描述如下:

(1)数据准备和存储

本研究选择了某大型服装电商平台公开的服装用户行为开源数据集作为研究对象。首先将服装数据集上传到Hadoop的HDFS存储中,并利用Hadoop的Flume组件配置好自动加载数据的环境,将服装数据加载到hive数据库中进行大数据分析。

(2)数据分析和统计

本研究采用多维度的数据分析方法,针对常见的服装电商指标,如PV、UV、跳失率、复购率等进行统计分析。同时,按照时间维度对服装用户的行为、活跃度等指标进行多维度透视分析,了解服装用户行为的变化趋势和规律。此外,还对服装电商数据中的热销服装ID及热销服装类别、用户地理位置等因素进行统计分析,以了解服装用户购买行为的特点和偏好。

(3)数据存储和可视化展示

为了便于服装数据的存储和分析展示,本研究将分析出来的服装结果表存入到hive数据库中,并利用sqoop组件将其自动导出到关系型数据库MySQL中。在此基础上,本研究采用Python的pyecharts可视化库进行前端可视化展示,通过调用MySQL中的服装数据集,绘制多维度的服装相关可视化图表类型。结合pyecharts中page方法对这些服装数据可视化进行前后端交互的大屏可视化展示设计,并结合HTML大屏可视化进行静态服装数据的写入,搭建一个炫酷的服装数据可视化大屏。这些服装分析结果通过丰富的图表展示出来可以帮助服装电商决策者可以快速做出决策。

(4)结果分析和决策制定

最后,本研究将服装分析结果进行汇总和分析,形成对于服装电商销售的可行性决策。根据分析结果,服装电商决策者可以了解服装用户行为的特点和偏好,针对性地制定服装营销策略和推广方案,以提高服装销售效果和客户满意度。

综上所述,本研究采用服装电商用户行为的开源数据进行大数据分析研究,通过Hadoop大数据分析平台进行多维度的服装用户行为分析,最终形成对于服装电商销售的可行性决策。这个研究路线结合了大数据存储和处理技术、数据分析和统计方法以及数据可视化展示技术,为服装电商销售提供了一个有力的支持。

数据集介绍

本数据集选取自某大型服装电商平台的开源数据,涵盖了该平台上一家服装商家在2021年12月1日至18日的用户行为数据。该数据集包含了服装用户的ID、服装商品的ID、服装相关行为类型、用户地理位置、服装类别、日期和小时等多个字段,共计数万行数据,是一个具有代表性的服装电商用户行为数据集。

在该数据集中,user_id表示服装用户的唯一标识符,item_id表示服装商品的唯一标识符,behavior_type表示用户对服装商品的行为类型,包括浏览、收藏、加购物车和购买等四种类型。user_geohash表示服装用户的地理位置信息,item_category表示服装商品的类别信息,date和hour分别表示服装用户行为发生的日期和小时。

通过对该服装数据集的分析,可以了解用户在服装电商平台上的购买行为和偏好,了解服装商品的销售情况和服装用户的地理分布特点,为服装电商平台的决策制定提供参考。同时,该服装数据集也具有一定的数据挖掘和机器学习的应用价值,例如预测服装用户的购买行为、服装商品的销售趋势等。

这个服装电商数据集提供了丰富的信息,可以帮助我们深入理解服装用户的行为模式和服装市场的动态。通过分析用户对不同服装类别的偏好、不同地理位置的服装购买习惯、以及服装购买行为随时间的变化等,可以为服装电商平台制定更精准的营销策略和库存管理方案提供数据支持。

配置flume文件

这个配置文件是用于Flume的,用于定义一个名为agent3的数据采集器。它定义了三个元素:source、channel和sink。其中,source3指定了一个名为source3的采集源,使用了spooling directory模式,数据目录为/home/hadoop/taobao/data,且没有文件头信息。channel3指定了一个名为channel3的存储通道,使用了file模式,checkpoint文件的路径为/home/hadoop/taobao/tmp/point。

data文件的路径为/home/hadoop/taobao/tmp。sink3指定了一个名为sink3的数据输出端,使用了hive模式,hive的metastore地址为thrift://hadoop:9083,数据库名称为taobao,表名为taobao_data,数据格式为DELIMITED,分隔符为逗号,字段名称为user_id、item_id、behavior_type、user_geohash、item_category、date、hour,每次提交数据的批量大小为90。

最后,通过将source、channel、sink组装起来,将数据从source采集到channel中,然后再将数据从channel中导出到sink中,最终将数据写入Hive表中。整个过程中,Flume会自动将source中的数据传输到channel中,然后将channel中的数据传输到sink中。通过这种方式,可以实现高效可靠的数据采集和导入操作。

HIve建表

这一步应该在上一步操作之前完成,并分别在hive中创建数据库,创建数据接收表和数据结果表格,数据接收表用于接收flume中的流数据,数据结果表用于存放hive分析的结果。

HIveSQL大数据分析

创建好表格之后,完成了数据集的导入和加载,接下来就是大数据分析了,采用hivesql进行编写查询语句,在hive中分析的时候,每次将分析结果都插入到先前我们已经创建好的数据表中。

在完成好上述的数据分析之后,在hive数据仓库中产生了很多的数据结果表,现在我们需要将这些结果表导出到Hadoop中mysql关系型数据库中,这样的好处:

(1)MySQL是常见的关系型数据库,具有广泛的应用场景和开发工具,对于数据的存储和管理具有很好的支持。而Hive虽然具有SQL语言的查询接口,但是其底层存储和查询引擎与MySQL等关系型数据库不同,因此需要通过数据导出的方式将分析结果表转换成MySQL的表格形式,方便进一步的数据处理和可视化展示。

(2)MySQL具有较好的性能和扩展性,可以支持大规模的数据存储和高并发的查询操作。而Hive对于大数据处理和查询的支持更为优秀,但是对于一些低频度的查询或者小规模数据的处理,MySQL可能更为适合。因此,通过将Hive中的分析结果表导出到MySQL中,可以更好地发挥两个数据库的优势,满足不同场景的数据处理和查询需求。

(3)MySQL可以更好地支持前端可视化工具的使用,例如Tableau、PowerBI、Metabase等,可以通过连接MySQL数据库直接进行数据查询和图表展示。而Hive虽然也具有类似的工具支持,但是需要额外的配置和部署工作,不如MySQL直接支持更加方便和高效。

综上所述,将Hive中的分析结果表导出到MySQL中可以更好地发挥两个数据库的优势,同时也方便了数据的存储和查询操作,以及数据可视化的展示。

但是在这之前需要在mysql中创建接收表,这样才能使用sqoop进行导出到mysql中。

MySQL建表

上面的这些代码是MySQL的DDL语句,用于创建一个名为taobao_result的表或者是其他类型的。该表包括两个字段:key和value,均为varchar(255)类型。另外,这两个字段使用了字符集为utf8、排序规则为utf8_general_ci的编码方式,支持中文和其他多字节字符集。同时,key和value字段的默认值为NULL。

此外,这个表使用了InnoDB引擎,支持事务管理和外键约束等功能。ROW_FORMAT属性为Dynamic,表示行格式是动态的,可以根据行数据的大小进行动态调整,以提高数据存储效率。

总的来说,这个DDL语句定义了一个基本的表结构,可以用于存储不同维度的统计结果。如果需要存储更多的字段或者定义更复杂的数据类型,需要在该语句的基础上进行扩展和修改。

Sqoop命令导出数据到MySQL

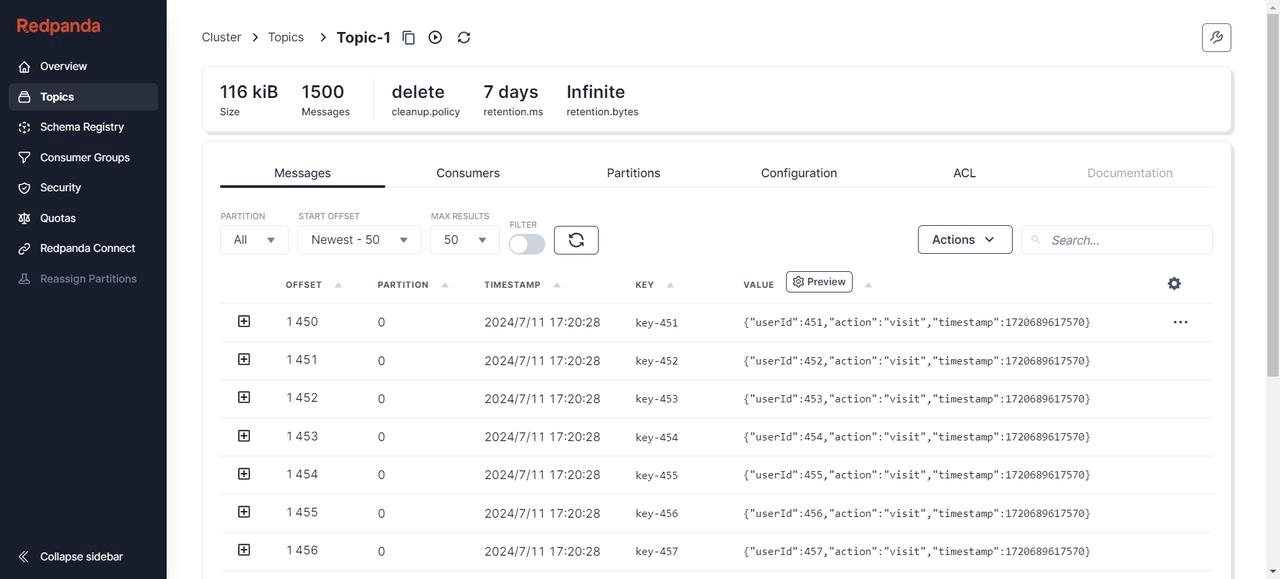

这是一个使用Sqoop导出数据的命令,主要作用是将Hive中的taobao_result表中的数据导出到MySQL中的taobao_result表中。

具体命令参数解释如下:

(1)sqoop export:表示执行导出命令。

(2)–connect jdbc:mysql://localhost:3306/taobao:表示连接到MySQL的taobao数据库,端口为3306。

(3)–username root -P:表示使用root用户进行登录,-P选项表示需要输入密码。

(4)–table taobao_result:表示导出数据到MySQL中的taobao_result表中。

(5)–export-dir /user/hive/warehouse/taobao.db/taobao_result:表示从Hive中的taobao_result表中导出数据,其存储路径为/user/hive/warehouse/taobao.db/taobao_result。

(6)-m 1:表示使用一个Mapper任务进行导出操作。

(7)–input-fields-terminated-by ‘\001’:表示输入数据的字段分隔符为\001。

综上所述,这条命令将Hive中的taobao_result表中的数据通过Sqoop导出到MySQL的taobao_result表中,方便后续对数据进行存储和查询。

数据可视化

店铺销售情况…等

通过这里可以看出,该店家的数据用户访问量比较的大,有接近6W多条数据,但是通过对用户进行透视分析发现只有981位用户,其次就是对于用户购买次数进行分析,发现数据只有273条,这里的分析结果可以保证我们在对一个店铺数据有一个整体的了解,知道该店铺的一个整体销售情况。

总结

本项目基于服装电商数据,通过Hadoop大数据分析,从数据预处理,环境配置,数据导入,数据分析,数据导出,数据分析等多维度进行实现,充分展现了Hadoop在大数据集上的优势和特点。

每文一语

变通自我