目录

Llama 3.1发布简介

Llama 3.1模型规模与训练

大模型企业发展面临的问题与困境

算力和能耗算力方面

数据和资金方面

技术和人才方面

Llama 3.1发布简介

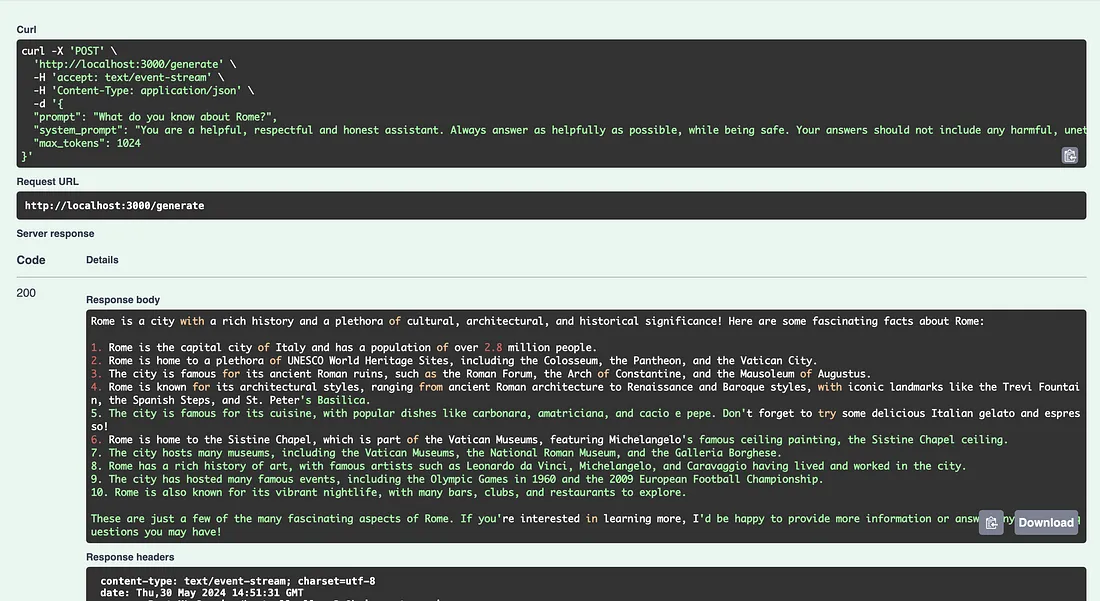

当地时间 2024年 7月 23号,Meta 公司发布了迄今为止最强大的开源 AI 模型 Llama 3.1。该模型不仅规模庞大,性能也堪比最强大的闭源模型。这称得上是开源 AI 领域的一个重要里程碑。

Llama 3.1 模型家族总共有三个版本,规模最大的旗舰版本拥有 405B(4050 亿)参数,是近年来最大的开源 AI 模型。其余两个较小版本的参数量分别是 700 亿和 80 亿。

”模型评估“ 和 ”模型能力与应用“ 等具体介绍可以参考官方文档。

总体而言,Llama 3.1 405B 模型在推理、数学等多项任务中的表现与 GPT-4、GPT-4o 和 Claude 3.5 Sonnet 相当,在长文本、多语言等领域甚至更胜一筹。不过在代码基准测试中,Llama 3.1 405B 模型的表现不如 Claude 3.5 Sonnet。

Llama 3.1模型规模与训练

Llama 3.1 405B 模型的训练规模令人惊叹。

Meta 使用了超过 1.6 万个英伟达 H100 GPU,在超过 15 万亿个 tokens(的数据集)上进行训练,相当于 7500 亿个单词。尽管 Meta 没有透露具体的开发成本,但仅根据其使用的英伟达芯片价格估算,成本就已高达数亿美元。

Meta 对其整个训练堆栈进行了重大优化,以达到如此大规模的训练目标。

在模型架构方面,他们选择了标准的仅解码器 transformer 模型,而非混合专家模型,以最大化训练稳定性。

训练数据方面,Meta 通过改进处理和数据筛选流程,提高了训练数据的质量。

此外,他们还选取了迭代式的后训练程序,“每轮都使用监督微调和直接偏好优化,用高质量的合成数据不断提升模型性能”。

参考:从国内某平台上看,一张H100 80G的GPU显卡售价25万元左右。

大模型企业发展面临的问题与困境

算力和能耗算力方面

- 大模型需要大量计算资源,导致全球算力需求指数级增长,对全社会信息基础设施和众多企业、科研机构的大模型研发带来巨大压力。

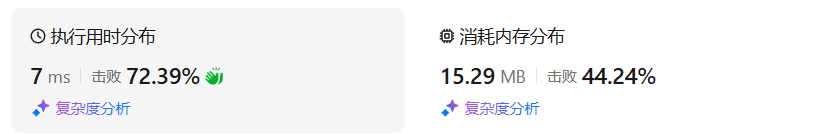

算力紧缺:大模型通常包含数十亿至上万亿个参数,训练时需要处理数万亿个Token,这对算力提出了极高的要求。随着大模型的快速发展,算力需求呈指数级增长,极大地推动了全球算力规模的扩展。大型预训练模型的训练和调优过程消耗了海量的算力资源。例如,训练ChatGPT所需的算力相当于64台英伟达A100 GPU持续训练一年的时间。此外,大模型的日常运营和优化也需要大量算力支持。预计到2030年,全球算力总规模将达到56ZFlops,其中智能算力成为主要驱动力。

- 能耗方面,大模型对能源的巨大需求导致人工智能能源消耗占全球能源消耗的3%左右,到2025年将消耗全球15%的电能,给全球环境治理带来挑战。我国大模型发展带来的高能耗可能增加碳达峰、碳中和压力。

能耗巨大:大模型对算力的巨大需求带来了能源消耗的激增。人工智能服务器的功率是普通服务器的6至8倍,训练大模型的能耗是常规云计算工作的3倍。据估计,当前人工智能的能源消耗已占全球总能耗的约3%,预计到2025年,这一比例将上升至15%。人工智能的快速发展对能源消耗和环境将产生深远的影响。

据估算,GPT-4一次训练的耗电量相当于1200名中国人一年的用电量,且这仅占模型实际使用时能耗的40%,实际运行阶段的能源消耗更为庞大。一些大型模型在运行时会产生大量碳排放,给全球环境治理带来严峻挑战。我国大模型发展的高能耗可能进一步加剧碳达峰和碳中和的压力。

数据和资金方面

- 大模型面临的挑战包括数据获取便利性、数据来源合法性、数据质量可靠性、数据使用安全性、资金投入等方面的挑战。

数据规模与质量待提高:

- 数据获取方面,专用类大模型需要专业数据,而这些数据往往属于企业、研究机构等实体,增加了训练难度。

- 数据来源合法性方面,个人信息保护意识的提高使得数据合法使用成为问题。

- 数据质量可靠性方面,开源数据集虽然数量巨大,但质量良莠不齐,从中提取符合预训练要求的高质量数据面临很大挑战。

- 数据使用安全性方面,如何保证使用的数据不带偏见,以及如何保证人工智能制造的数据本身的安全性,都是需要解决的问题。

- 资金投入方面,大模型成本高昂,包括模型开发成本、训练成本、算力成本、数据成本、运维成本等,对普通企业和科研机构而言,资金成为难以逾越的“门槛”。

资金紧缺:

- 大模型的训练与开发成本极为高昂,主要由模型开发、训练、算力、数据和运维成本等多方面构成。仅训练成本就动辄达到数百万美元。以Meta的LLaMA大语言模型为例,在1.4万亿的数据集上,使用2000多个英伟达A100 GPU,进行了21天的训练,花费高达1000万美元。根据华为公布的信息,开发和训练一次人工智能大模型的成本高达1200万美元。

- 这种巨额的资金投入将许多小型研究机构和中小型企业排除在外,使得大模型的研发集中于少数头部企业和研究机构,进一步加剧了行业的不平等。

技术和人才方面

- 针对大模型技术,与国际最先进的水平存在一定差距,主要体现在底层架构设计和硬件技术方面。在底层架构设计方面,国内尚无类似的底层架构,大模型的预训练方面只能“在别人的地基上盖子”;在硬件技术方面,存在“卡脖子”风险。(具体不能展开,不然无法审核通过......)