transformer的基础知识

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.rhkb.cn/news/450576.html

如若内容造成侵权/违法违规/事实不符,请联系长河编程网进行投诉反馈email:809451989@qq.com,一经查实,立即删除!相关文章

TSmaster CAN的E2E检验配置

文章目录 一. 自定义E2E校验算法1. 导入DBC文件2. 模拟报文发送3. 自定义E2E算法 问题:C代码编辑器中 数据库头文件为空问题:C代码编辑器中 程序启动和暂停按钮为灰色 一. 自定义E2E校验算法

1. 导入DBC文件 点击载入CAN数据库,在弹窗中选择…

添加卡巴斯基杀毒软件(KES)的更新源

最近不知道怎么了,家里的电脑卡巴斯基(KES)怎么更新都更新不了,在网上找到了几个卡巴斯基的服务器: 添加步骤: 1.双击右下角的卡巴斯基图标。 2.依次按如下图示添加: 以下这步是最关键的,一定要…

HDU Ignatius‘s puzzle

题目大意:f(x)5*x^1313*x^5k*a*x,输入一个无负整数 k(k<10000),要找到最小的非负整数 a,将任意整数 x ,65|f(x),如果不存在该 a&am…

linux环境下的程序设计与git操作

目录 前言:

进度条小程序:

先介绍几个背景知识

代码实现

Git操作

总结

其他指令 前言:

本文将重点介绍1. linux下的程序设计,并使用linux下的几个函数接口。实现一个简单的小程序

2.本着开源精神,进行git操作。…

数据同步工具Sqoop原理及场景优化

目录

0 数据同步策略 1 数据同步工具

编辑 2 Sqoop同步数据原理分析

2.1 原理分析

2.2 Sqoop基本使用分析

3 切片逻辑

3.1 MR切片逻辑

3.2 Hive CombineInputformat切片逻辑

3.3 实验1:Map任务并行度分析1

3.4 实验2: Map任务并行度分析2 3.5 实验3:Map任务并行…

SDIO - DWC MSHC 电压切换和频率切换

背景

我们的sdio访问sd card过去一直跑在低频上,HS50M。前段时间给eMMc添加了HS200模式,eMMc的总线模式定义是这样的: 可以看到1.8V的IO 电压可以支持所有模式,我们过去的芯片,由硬件部门放到evb上,其IO …

【学习笔记】什么是MongoDB

文章目录 MongoDB 简介体系结构数据模型MongoDB 的特点 MongoDB 简介

学习一个东西就跟认识一个人一样,下面有情MongoDB来做个自我介绍 大家好,俺是MongoDB,是一个开源、高性能、无模式的文档型数据库,当初的设计俺就是用于简化开…

Redis-03 持久化(RDB, AOF,混合持久化)及原理

1,持久化 Redis的持久化是必须的,当Redis服务宕机后,如果没有持久化,重启服务后redis中的数据都将丢失,所有的数据操作都将直连数据库,系统性能会大幅降低,所以在使用Redis做缓存服务时必须持久…

LabVIEW离心泵振动监控与诊断系统

利用LabVIEW结合数据采集与处理技术,构建了一套高效、低成本的振动监测与诊断系统,有效提升了测试精度与设备可靠性。 项目背景

在化工生产中,离心泵作为关键设备,其稳定运行对保障生产安全与效率至关重要。由于传统振动测试系统…

LabVIEW提高开发效率技巧----VI继承与重载

在LabVIEW开发中,继承和重载是面向对象编程(OOP)中的重要概念。通过合理运用继承与重载,不仅能提高代码的复用性和灵活性,还能减少开发时间和维护成本。下面从多个角度介绍如何在LabVIEW中使用继承和重载,并…

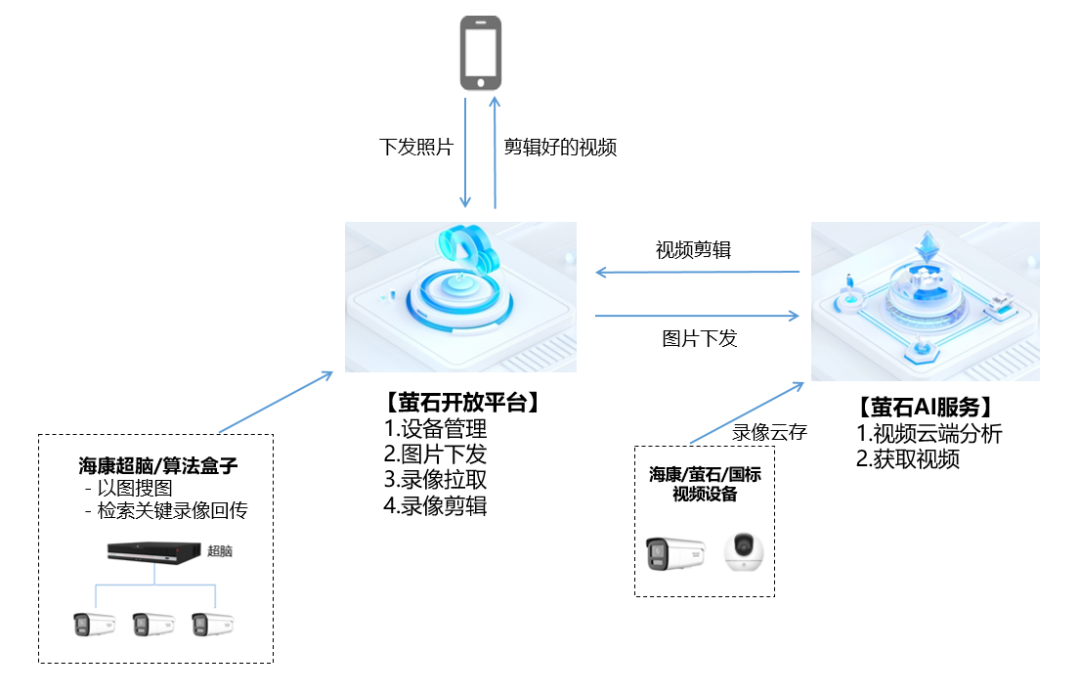

萤石云服务支持云端视频AI自动剪辑生成

萤石视频云存储及媒体处理服务是围绕IoT设备云端存储场景下的音视频采集、媒体管理、视频剪辑和分发能力的一站式、专业云服务,并可面向广大开发者提供复杂设备存储场景下的完整技术方案。目前该服务新增了视频剪辑功能,支持将视频片段在云端进行裁剪并拼…

sentinel dashboard分布式改造落地设计实现解释(二)-分布式discovery组件

discovery

discovery负责维护app/机器资料库,transport健康检测, transport上下线处理。discovery关键是分布式存储,后续研究一下raft,其复制,状态机,快照技术,但个人觉得,discover…

胤娲科技:AI短视频——创意无界,即梦启航

在这个快节奏的时代,你是否曾梦想过用几秒钟的短视频,捕捉生活中的每一个精彩瞬间?是否曾幻想过,即使没有专业的摄影和剪辑技能,也能创作出令人惊艳的作品? 现在,这一切都不再是遥不可及的梦想。…

基于光度学的小型视触觉传感器的开发

近年来,视觉触觉传感器(VTS)在机器人领域得到了广泛关注。传统的触觉传感器如压阻式、压电式和电容式触觉传感器在机器人感知方面有显著优势,但其分辨率相对较低。视触觉传感器使用相机获取触觉信息,能够提供高分辨率和…

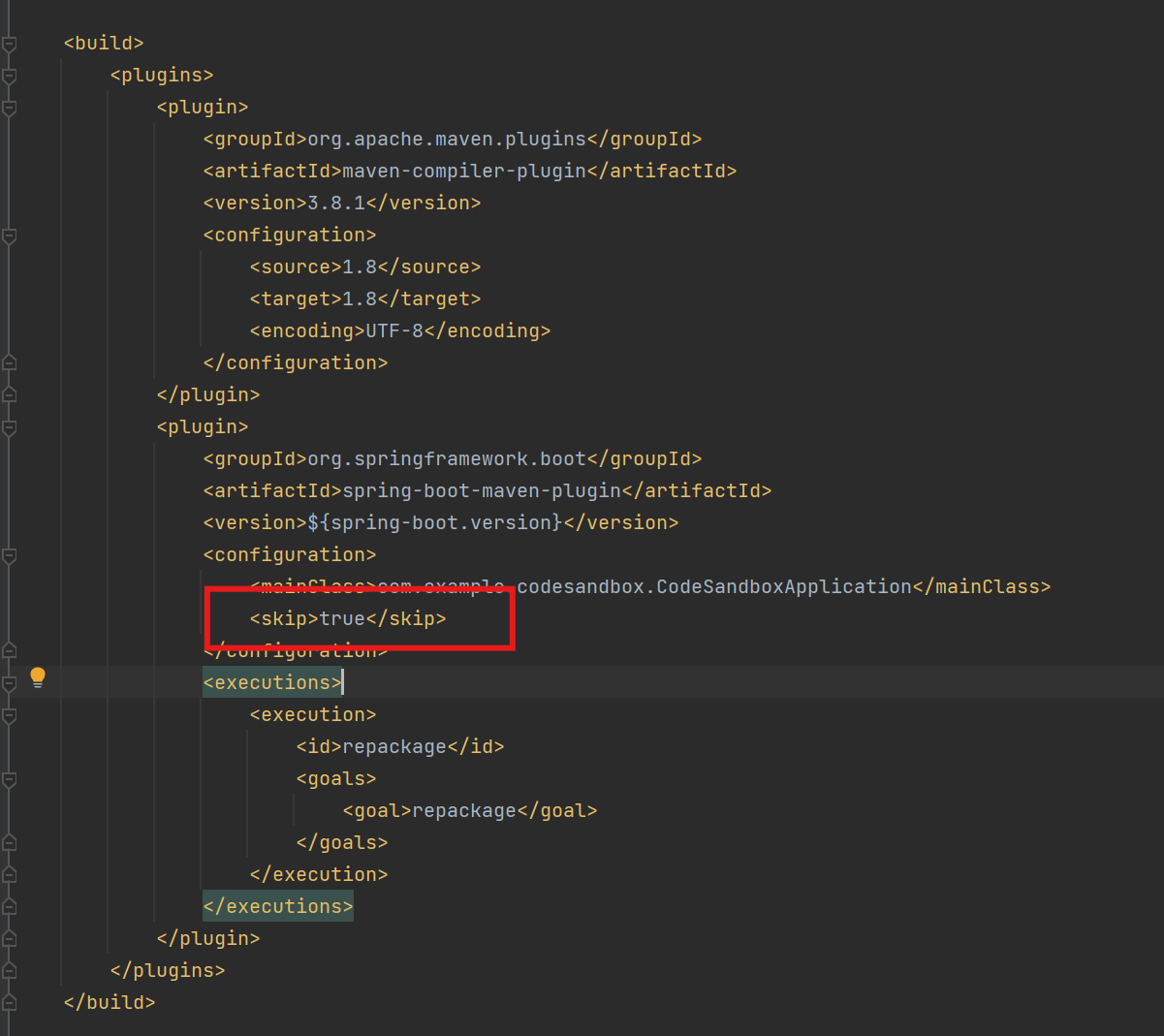

执行jar文件no main manifest attribute错误

执行jar文件no main manifest attribute错误 问题是由于maven打包时候没有指定主启动程序,或下方配置中多余true配置跳过主程序配置 对应找到build中的所有有关true的删除,再重新打包即可

open-cd中的changerformer网络结构分析

open-cd 目录 open-cd1.安装2.源码结构分析主干网络1.1 主干网络类2.neck2.Decoder3.测试模型6. changer主干网络 总结 该开源库基于: mmcv mmseg mmdet mmengine 1.安装

在安装过程中遇到的问题: 1.pytorch版本问题,open-cd采用的mmcv版本比…

Axure重要元件一——动态面板

亲爱的小伙伴,在您浏览之前,烦请关注一下,在此深表感谢!

本节课:动态面板

课程内容:认识动态面板、动态面板基本操作

应用场景:特定窗口、重要交互、长页面、容器等

一、认识动态面板

动态…

flutter TabBar自定义指示器(带文字的指示器、上弦弧形指示器、条形背景指示器、渐变色的指示器)

带文字的TabBar指示器 1.绘制自定义TabBar的绿色带白色文字的指示器 2.将底部灰色文字与TabrBar层叠,并调整高度位置与胶囊指示器重叠

自定义的带文字的TabBar指示器

import package:atui/jade/utils/JadeColors.dart;

import package:flutter/material.dart;

im…

推荐文章

- 6.17黄金早评美联储利率决议利空金银后市布局

- ArcGIS Pro怎么生成山顶点

- 补充经纬恒润一面

- 旅行季《乡村振兴战略下传统村落文化旅游设计》许少辉八一著作想象和世界一样宽广

- # Redis 入门到精通(七)-- redis 删除策略

- #include<string>和#include<string.h>有什么区别

- #中国版chatGPT来了# 2023年开年,

- (C++)成绩排序

- (delphi11最新学习资料) Object Pascal 学习笔记---第12章操作类(类方法和类数据)

- (delphi11最新学习资料) Object Pascal 学习笔记---第4章第2.3节(常量参数)

- (八)vtk常用类的常用函数介绍(附带代码示例)

- (笔记)第三期书生·浦语大模型实战营(十一卷王场)–书生基础岛第2关---8G 显存玩转书生大模型 Demo