AIGC与人机协作:新的创作模式

引言

人工智能生成内容(AIGC)正在以惊人的速度渗透到创作的各个领域。从生成文本、音乐、到图像和视频,AIGC使得创作过程变得更加快捷和高效。然而,AIGC并非完全取代了人类的创作角色,更多的是与人类协作形成一种新的创作模式。在这篇博客中,我们将探讨AIGC与人类如何在创作中紧密协作,并通过代码示例展示如何将这种协作应用到实际的创作场景中。

AIGC与人机协作的意义

在传统的创作模式中,创作者需要从无到有地构思、创作和调整作品,整个过程费时费力。而AIGC通过利用机器学习模型帮助人类在特定的创作阶段提供灵感、辅助内容生成或者自动化地进行某些重复性任务,从而降低了创作的门槛,提高了效率。人类和AIGC之间的协作,可以最大化地融合机器的运算能力和人类的创造性思维。

应用场景

- 文本创作:通过AIGC模型生成草稿,人类创作者进行润色和编辑。

- 音乐创作:AI生成背景旋律,人类进行演奏或编曲。

- 图像创作:AI生成图像,人类艺术家进行后期调整和风格化处理。

- 视频创作:AI生成短视频剪辑,人类创作者对视频进行编辑,增强故事性。

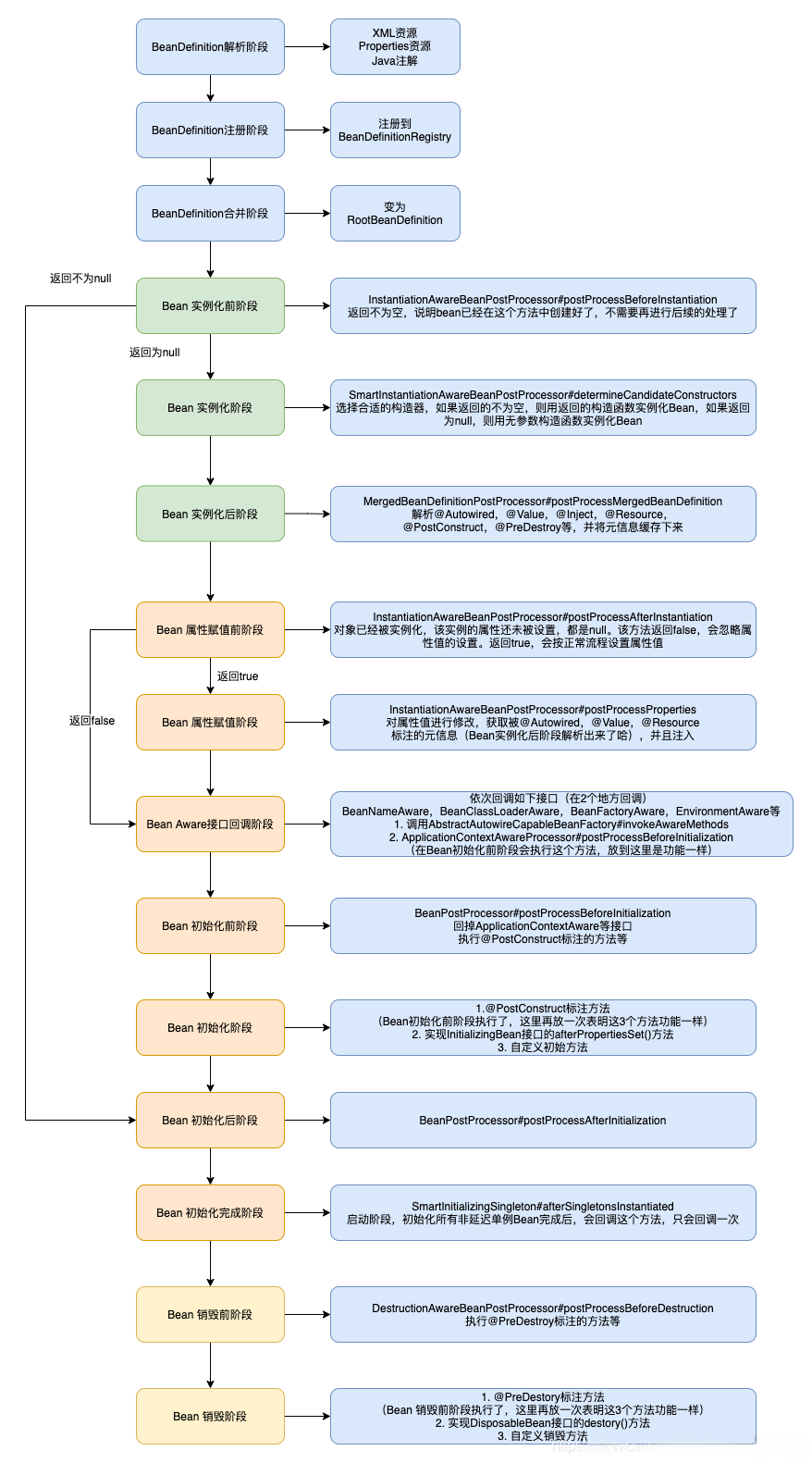

AIGC与人机协作的核心技术

AIGC与人机协作的核心技术包括生成对抗网络(GAN)、自然语言处理(NLP)、Transformer、强化学习等,这些技术使得AI在理解和生成内容方面取得了巨大的突破。下面我们将通过代码示例展示如何利用这些技术实现人机协作的具体应用。

1. 使用Transformer进行文本协作创作

Transformer架构的出现极大地提升了自然语言处理的效果,尤其是在文本生成和理解方面。以下是一个基于GPT-2模型与人类协作进行文本创作的示例,利用GPT-2生成文本内容,创作者可以进一步进行修改和扩展。

from transformers import GPT2LMHeadModel, GPT2Tokenizer

import torch# 加载GPT-2模型和分词器

tokenizer = GPT2Tokenizer.from_pretrained("gpt2")

model = GPT2LMHeadModel.from_pretrained("gpt2")# 输入起始文本,作为AI生成的基础

prompt = "In a world where artificial intelligence collaborates with humans,"

input_ids = tokenizer.encode(prompt, return_tensors='pt')# 使用GPT-2生成后续文本

output = model.generate(input_ids, max_length=200, num_return_sequences=1, temperature=0.7)

generated_text = tokenizer.decode(output[0], skip_special_tokens=True)print("Generated Text:\n", generated_text)# 人类创作者可以在此基础上进行润色和扩展

通过这个代码,我们可以让GPT-2为创作者提供灵感或者初步的草稿。人类创作者则可以基于生成的文本进一步加工润色,从而创作出更具风格和深度的内容。

2. 使用VQ-VAE-2生成图像并进行艺术加工

VQ-VAE-2是一种先进的自编码器模型,可以生成高分辨率的图像。在图像创作中,AI可以帮助生成初步的画面,人类艺术家则可以对这些画面进行进一步的艺术加工,使其符合个人的艺术风格。

以下是一个使用VQ-VAE-2生成图像的示例:

import torch

from torchvision.utils import save_image

from vqvae import VQVAE # 假设已实现VQVAE模型# 加载预训练的VQ-VAE模型

model = VQVAE()

model.load_state_dict(torch.load("vqvae_pretrained.pth"))

model.eval()# 生成潜在向量并解码为图像

z = torch.randn(1, 256, 8, 8) # 随机生成潜在向量

with torch.no_grad():generated_image = model.decode(z)# 保存生成的图像

save_image(generated_image, 'generated_image.png')

print("Image saved as 'generated_image.png'")# 人类艺术家可以基于这个图像进一步进行艺术化处理,如调整颜色、添加细节等

在这个例子中,AI生成了一个初步的图像,艺术家可以基于这个基础进行后续创作,进一步提高作品的表现力。

3. 使用MuseGAN进行音乐协作创作

MuseGAN是一种用于音乐生成的GAN模型,可以生成多轨音乐,适合人类和AI的协作。AI生成背景旋律和伴奏,人类音乐家则可以在这个基础上进行演奏或编曲。

以下是一个使用MuseGAN生成音乐片段的代码示例:

import numpy as np

import musegan# 初始化MuseGAN模型

model = musegan.MuseGAN()

model.load_weights('musegan_weights.h5')# 随机生成噪声向量

noise = np.random.normal(0, 1, (1, 100))# 生成音乐片段

music = model.generate(noise)# 保存生成的音乐为MIDI文件

musegan.save_midi(music, 'generated_music.mid')

print("Music saved as 'generated_music.mid'")# 人类音乐家可以使用MIDI编辑工具对音乐进行进一步编曲和优化

在这个例子中,MuseGAN为创作者生成了一段音乐片段,音乐家可以基于这个片段进行创作,从而大大提高音乐创作的效率。

人机协作的优势与挑战

优势

- 提高创作效率:AIGC可以为创作者提供初步的创作内容,从而节省大量的时间和精力。

- 打破创意瓶颈:在创作遇到瓶颈时,AIGC可以提供灵感和新的视角,帮助创作者找到突破口。

- 降低创作门槛:对于没有专业技能的爱好者,AIGC提供了强有力的工具,降低了创作的技术门槛。

挑战

- 内容质量控制:AIGC生成的内容质量不一,可能需要人类创作者进行大量的后期编辑。

- 缺乏个性化:AIGC生成的内容往往缺乏独特的风格,需要人类创作者赋予其个性化特征。

- 道德与版权问题:AIGC生成的内容可能涉及版权争议,特别是在使用已有作品进行训练的情况下。

AIGC与人机协作的未来展望

- 深度融合:未来的AIGC工具将与人类的创作过程深度融合,实现真正的无缝协作。例如,通过语音指令引导AI生成指定风格的内容。

- 个性化创作:AI将能够更好地理解个人创作者的偏好和风格,生成符合个人需求的内容,减少后期编辑的工作量。

- 实时交互创作:在音乐、绘画和写作等领域,AI可以实现与人类的实时互动,提供即时反馈,从而让创作过程更加顺畅和富有乐趣。

结论

AIGC与人机协作正在重新定义创作的方式。通过利用AI的计算能力和生成能力,人类创作者可以将更多的时间和精力放在作品的构思和艺术表现上,而将重复性和耗时的工作交给AI处理。这种协作模式不仅提高了创作效率,还为创作者带来了新的灵感和创作机会。