目录

一、ELK 简介

1.1 ELK各组件介绍

ElasticSearch:

Kiabana:

Logstash:

1.2 可以添加的其它组件:

Filebeat:

缓存/消息队列(redis、kafka、RabbitMQ等):

Fluentd:

1.3 ELK、ELFK、EFLKL

二、为什么要使用 ELK

三、完整日志系统基本特征

四、ELK 的工作原理

五、ELK集群部署

实验环境:

实验步骤:

5.1 Elasticsearch部署(在Node1、Node2节点上操作)

1、环境准备,设置Java环境

2、部署 Elasticsearch 软件

3、修改主机名,在/etc/hosts文件中添加映射关系

4、修改 Elasticsearch主配置文件

5、ES 性能调优参数

优化elasticsearch用户拥有的内存权限:

6、启动elasticsearch是否成功开启

7、查看节点信息

8、安装 Elasticsearch-head 插件

5.2 Logstash 部署(在 Apache 节点上操作)

1、更改主机名

2、安装Apahce服务(httpd)

3、安装Java环境

4、安装logstash

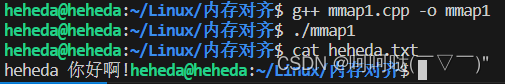

5、测试 Logstash

6、定义 logstash配置文件

5.3 Kiabana 部署(在 Node1 节点上操作)

1、安装 Kiabana

2、设置 Kibana 的主配置文件

3、创建日志文件,启动 Kibana

服务

4、验证 Kibana

5、将 Apache 服务器的日志(访问的、错误的)添加到 Elasticsearch 并通过 Kibana 显示

一、ELK 简介

ELK平台是一套完整的日志集中处理解决方案,将 ElasticSearch、Logstash 和 Kiabana 三个开源工具配合使用, 完成更强大的用户对日志的查询、排序、统计需求。

1.1 ELK各组件介绍

ElasticSearch:

- 是基于Lucene(一个全文检索引擎的架构)开发的分布式存储检索引擎,用来存储各类日志。

- Elasticsearch 是用 Java 开发的,可通过 RESTful Web 接口,让用户可以通过浏览器与Elasticsearch 通信。

- Elasticsearch是一个实时的、分布式的可扩展的搜索引擎,允许进行全文、结构化搜索,它通常用于索引和搜索大容量的日志数据,也可用于搜索许多不同类型的文档。

Kiabana:

- Kibana 通常与 Elasticsearch 一起部署,Kibana 是 Elasticsearch 的一个功能强大的数据可视化 Dashboard,Kibana 提供图形化的 web 界面来浏览 Elasticsearch 日志数据,可以用来汇总、分析和搜索重要数据。

Logstash:

- 作为数据收集引擎。它支持动态的从各种数据源搜集数据,并对数据进行过滤、分析、丰富、统一格式等操作,然后存储到用户指定的位置,一般会发送给 Elasticsearch。

- Logstash 由 Ruby 语言编写,运行在 Java 虚拟机(JVM)上,是一款强大的数据处理工具, 可以实现数据传输、格式处理、格式化输出。Logstash 具有强大的插件功能,常用于日志处理。

过滤模块是logstash的核心功能。

1.2 可以添加的其它组件:

Filebeat:

- 轻量级的开源日志文件数据搜集器。通常在需要采集数据的客户端安装 Filebeat,并指定目录与日志格式,Filebeat 就能快速收集数据,并发送给 logstash 进行解析,或是直接发给 Elasticsearch 存储,性能上相比运行于 JVM 上的 logstash 优势明显,是对它的替代。常应用于 EFLK 架构当中。(如果要使用过滤功能的话,Filebeat不能完全替代logstash,Filebeat没有过滤功能,收集数据后需要发送给 logstash 进行处理)

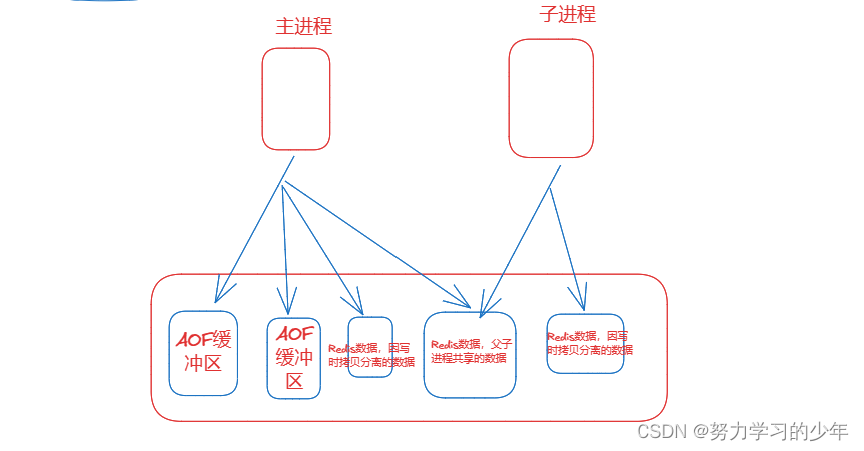

filebeat 结合 logstash 带来好处:

- 通过 Logstash 具有基于磁盘的自适应缓冲系统,该系统将吸收传入的吞吐量,从而减轻 Elasticsearch 持续写入数据的压力。

- 从其他数据源(例如数据库,S3对象存储或消息传递队列)中提取。

- 将数据发送到多个目的地,例如S3,HDFS(Hadoop分布式文件系统)或写入文件。

- 使用条件数据流逻辑组成更复杂的处理管道。

缓存/消息队列(redis、kafka、RabbitMQ等):

- 可以对高并发日志数据进行流量削峰和缓冲,这样的缓冲可以一定程度的保护数据不丢失,还可以对整个架构进行应用解耦。

Fluentd:

- 是一个流行的开源数据收集器。由于 logstash 太重量级的缺点,Logstash 性能低、资源消耗比较多等问题,随后就有 Fluentd 的出现。相比较 logstash,Fluentd 更易用、资源消耗更少、性能更高,在数据处理上更高效可靠,受到企业欢迎,成为 logstash 的一种替代方案,常应用于 EFK 架构当中。在 Kubernetes 集群中也常使用 EFK 作为日志数据收集的方案。

- 在 Kubernetes 集群中一般是通过 DaemonSet 来运行 Fluentd,以便它在每个 Kubernetes 工作节点上都可以运行一个 Pod。 它通过获取容器日志文件、过滤和转换日志数据,然后将数据传递到 Elasticsearch 集群,在该集群中对其进行索引和存储。

1.3 ELK、ELFK、EFLKL

ELK: ES+logstash+kibana

ELFK: ES+logstash+filebeat+kibana

ELFK: ES+filebeat+logstash+kafka+kibana

二、为什么要使用 ELK

日志主要包括系统日志、应用程序日志和安全日志。系统运维和开发人员可以通过日志了解服务器软硬件信息、检查配置过程中的错误及错误发生的原因。经常分析日志可以了解服务器的负荷,性能安全性,从而及时采取措施纠正错误。

往往单台机器的日志我们使用grep、awk等工具就能基本实现简单分析,但是当日志被分散的储存不同的设备上。如果你管理数十上百台服务器,你还在使用依次登录每台机器的传统方法查阅日志。这样是不是感觉很繁琐和效率低下。当务之急我们使用集中化的日志管理,例如:开源的syslog,将所有服务器上的日志收集汇总。集中化管理日志后,日志的统计和检索又成为一件比较麻烦的事情,一般我们使用 grep、awk和wc等Linux命令能实现检索和统计,但是对于要求更高的查询、排序和统计等要求和庞大的机器数量依然使用这样的方法难免有点力不从心。

一般大型系统是一个分布式部署的架构,不同的服务模块部署在不同的服务器上,问题出现时,大部分情况需要根据问题暴露的关键信息,定位到具体的服务器和服务模块,构建一套集中式日志系统,可以提高定位问题的效率。

三、完整日志系统基本特征

收集: 能够采集多种来源的日志数据。

传输: 能够稳定的把日志数据解析过滤并传输到存储系统。

存储: 存储日志数据。

分析: 支持 UI 分析。

警告: 能够提供错误报告,监控机制。

四、ELK 的工作原理

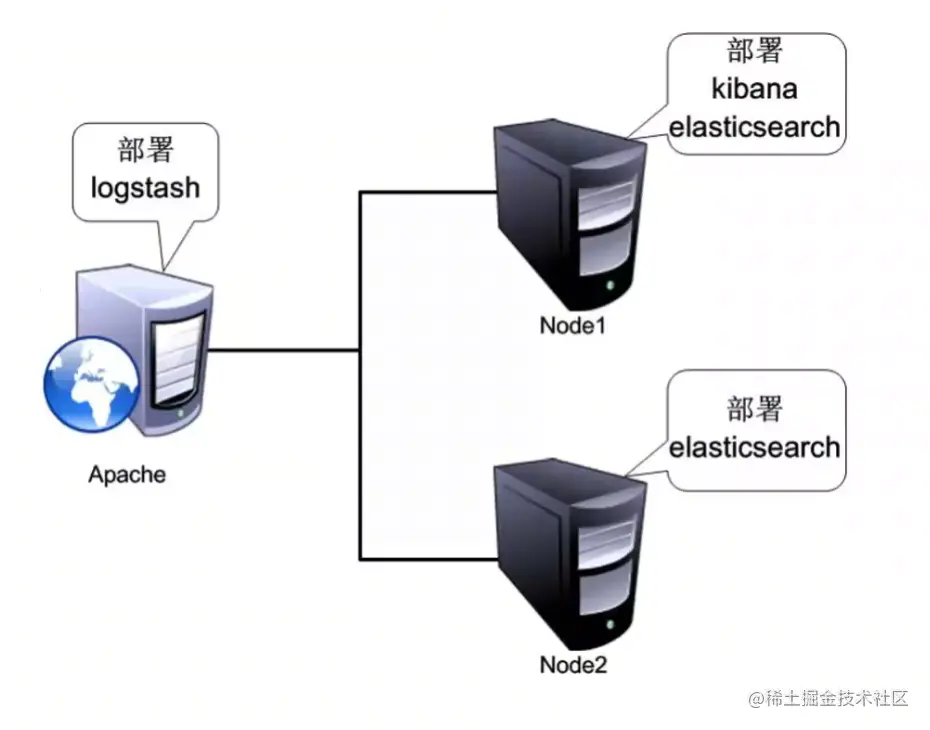

(1)在所有需要收集日志的服务器上部署Logstash;或者先将日志进行集中化管理在日志服务器上,在日志服务器上部署 Logstash。

(2)Logstash 收集日志,将日志格式化并输出到 Elasticsearch 群集中。

(3)Elasticsearch 对格式化后的数据进行索引和存储。

(4)Kibana 从 ES 群集中查询数据生成图表,并进行前端数据的展示。

总结:logstash作为日志搜集器,从数据源采集数据,并对数据进行过滤,格式化处理,然后交由Elasticsearch存储,kibana对日志进行可视化处理。

五、ELK集群部署

实验环境:

| 服务器类型 | 系统和IP地址 | 需要安装的组件 | 硬件方面 |

|---|---|---|---|

| node01节点 | CentOS7.4(64 位) 192.168.121.10 | Elasticsearch 、Kibana | 2核4G |

| node02节点 | CentOS7.4(64 位) 192.168.121.20 | Elasticsearch | 2核4G |

| Apache节点 | CentOS7.4(64 位) 192.168.121.30 | Logstash、Apache | 2核4G |

实验步骤:

初始化环境,关闭所有节点的防火墙

systemctl stop firewalld setenforce 0

5.1 Elasticsearch部署(在Node1、Node2节点上操作)

1、环境准备,设置Java环境

#设置Java环境

java -version #如果没有安装,yum -y install java

openjdk version "1.8.0_131"

OpenJDK Runtime Environment (build 1.8.0_131-b12)

OpenJDK 64-Bit Server VM (build 25.131-b12, mixed mode)

2、部署 Elasticsearch 软件

#安装elasticsearch—rpm包,上传elasticsearch-6.7.2.rpm到/opt目录下

cd /opt

rpm -ivh elasticsearch-6.7.2.rpm

3、修改主机名,在/etc/hosts文件中添加映射关系

#node01节点

hostnamectl set-hostname node01

su

vim /etc/hosts

192.168.121.10 node01

192.168.121.20 node02

#node02节点

hostnamectl set-hostname node02

su

vim /etc/hosts

192.168.121.10 node01

192.168.121.20 node02

4、修改 Elasticsearch主配置文件

#修改主配置文件前先备份

cp /etc/elasticsearch/elasticsearch.yml /etc/elasticsearch/elasticsearch.yml.bak

#修改主配置文件

vim /etc/elasticsearch/elasticsearch.yml

--17--取消注释,指定集群名字

cluster.name: my-elk-cluster

--23--取消注释,指定节点名字:Node1节点为node1,Node2节点为node2

node.name: node1

node.master: true #是否master节点,false为否

node.data: true #是否数据节点,false为否

--33--取消注释,指定数据存放路径

path.data: /var/lib/elasticsearch

--37--取消注释,指定日志存放路径

path.logs: /var/log/elasticsearch

--43--取消注释,避免es使用swap交换分区

bootstrap.memory_lock: true

--55--取消注释,设置监听地址,0.0.0.0代表所有地址

network.host: 0.0.0.0

--59--取消注释,ES 服务的默认监听端口为9200

http.port: 9200 #指定es集群提供外部访问的接口

transport.tcp.port: 9300 #指定es集群内部通信接口

--68--取消注释,集群发现通过单播实现,指定要发现的节点

discovery.zen.ping.unicast.hosts: ["192.168.121.40:9300", "192.168.121.50:9300"]

grep -v "^#" /etc/elasticsearch/elasticsearch.yml

5、ES 性能调优参数

#(1)优化最大内存大小和最大文件描述符的数量

vim /etc/security/limits.conf

......

* soft nofile 65536

* hard nofile 131072

* soft memlock unlimited

* hard memlock unlimited #不锁内存,即不限制内存(一半给ES,一半给操作系统)

#需重启生效

#临时生效可以通过"ulimit -n 数量"命令来修改每个进程可打开的最大文件数

#(2)优化elasticsearch用户拥有的内存权限

vim /etc/sysctl.conf

#一个进程可以拥有的最大内存映射区域数,参考数据(分配 2g/262144,4g/4194304,8g/8388608)

vm.max_map_count=262144 #一个进程能够分配的最大内存大小

sysctl -p

sysctl -a | grep vm.max_map_count

优化elasticsearch用户拥有的内存权限:

由于ES构建基于lucene, 而lucene设计强大之处在于lucene能够很好的利用操作系统内存来缓存索引数据,以提供快速的查询性能。lucene的索引文件segements是存储在单文件中的,并且不可变,对于OS来说,能够很友好地将索引文件保持在cache中,以便快速访问;因此,我们很有必要将一半的物理内存留给lucene ; 另一半的物理内存留给ES(JVM heap )。所以, 在ES内存设置方面,可以遵循以下原则:

- 当机器内存小于64G时,遵循通用的原则,50%给ES,50%留给操作系统,供lucene使用。

- 当机器内存大于64G时,遵循原则:建议分配给ES分配 4~32G 的内存即可,其它内存留给操作系统,供lucene使用。

6、启动elasticsearch是否成功开启

systemctl start elasticsearch.servicesystemctl enable elasticsearch.servicenetstat -antp | grep 9200

7、查看节点信息

浏览器访问

http://192.168.121.10:9200

http://192.168.121.20:9200

查看节点 Node1、Node2 的信息。

浏览器访问

http://192.168.121.10:9200/_cluster/health?pretty http://192.168.121.20:9200/_cluster/health?pretty

查看群集的健康情况,可以看到 status 值为 green(绿色), 表示节点健康运行。

浏览器访问 http://192.168.121.10:9200/_cluster/state?pretty 检查群集状态信息。

8、安装 Elasticsearch-head 插件

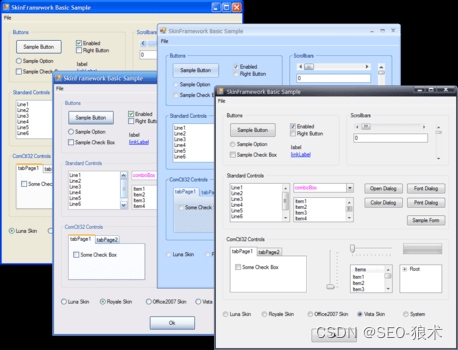

使用上述方式查看群集的状态对用户并不友好,可以通过安装 Elasticsearch-head 插件,可以更方便地管理群集。

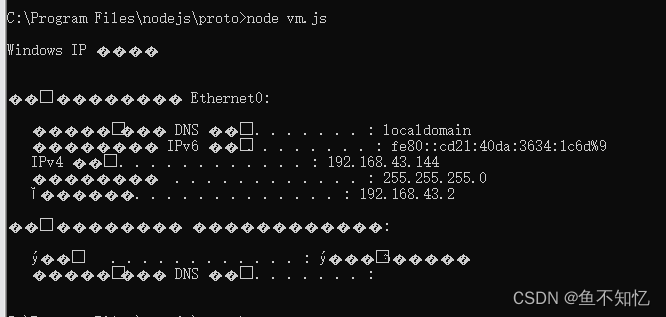

Elasticsearch 在 5.0 版本后,Elasticsearch-head 插件需要作为独立服务进行安装,需要使用npm工具(NodeJS的包管理工具)安装。

- 安装 Elasticsearch-head 需要提前安装好依赖软件 node 和 phantomjs。

- node:是一个基于 Chrome V8 引擎的 JavaScript 运行环境。

- phantomjs:是一个基于 webkit 的JavaScriptAPI,可以理解为一个隐形的浏览器,任何基于 webkit 浏览器做的事情,它都可以做到。

(1)编译安装 node

#上传软件包 node-v8.2.1.tar.gz 到/opt

yum install gcc gcc-c++ make -y

cd /opt

tar zxvf node-v8.2.1.tar.gz

cd node-v8.2.1/

./configure

make && make install

(2)安装 phantomjs

#上传软件包 phantomjs-2.1.1-linux-x86_64.tar.bz2 到

cd /opt

tar jxvf phantomjs-2.1.1-linux-x86_64.tar.bz2 -C /usr/local/src/

cd /usr/local/src/phantomjs-2.1.1-linux-x86_64/bin

cp phantomjs /usr/local/bin

(3)安装 Elasticsearch-head 数据可视化工具

#上传软件包 elasticsearch-head.tar.gz 到/opt

cd /opt

tar zxvf elasticsearch-head.tar.gz -C /usr/local/src/

cd /usr/local/src/elasticsearch-head/

npm install

(4)修改 Elasticsearch 主配置文件

vim /etc/elasticsearch/elasticsearch.yml

......

--末尾添加以下内容--

http.cors.enabled: true #开启跨域访问支持,默认为 false

http.cors.allow-origin: "*" #指定跨域访问允许的域名地址为所有

systemctl restart elasticsearch

(5)启动 elasticsearch-head 服务

#必须在解压后的 elasticsearch-head 目录下启动服务,进程会读取该目录下的 gruntfile.js 文件,否则可能启动失败。

cd /usr/local/src/elasticsearch-head/

npm run start &

> elasticsearch-head@0.0.0 start /usr/local/src/elasticsearch-head

> grunt server

Running "connect:server" (connect) task

Waiting forever...

Started connect web server on http://localhost:9100

#elasticsearch-head 监听的端口是 9100

netstat -natp |grep 9100

(6)通过 Elasticsearch-head 查看 Elasticsearch 信息

通过浏览器访问 http://192.168.121.10:9100/ 地址并连接群集。如果看到群集健康值为 green 绿色,代表群集很健康。

(7)插入索引

#通过命令插入一个测试索引,索引为 index-demo,类型为 test。

curl -X PUT 'localhost:9200/index-demo/test/1?pretty&pretty' -H 'content-Type: application/json' -d '{"user":"zhangsan","mesg":"hello world"}'

//输出结果如下:

{

"_index" : "index-demo",

"_type" : "test",

"_id" : "1",

"_version" : 1,

"result" : "created",

"_shards" : {

"total" : 2,

"successful" : 2,

"failed" : 0

},

"created" : true

}

浏览器访问 http://192.168.121.10:9100/ 查看索引信息,可以看见索引默认被分片5个,并且有一个副本。

点击“数据浏览”,会发现在node1上创建的索引为 index-demo,类型为 test 的相关信息。

5.2 Logstash 部署(在 Apache 节点上操作)

Logstash 一般部署在需要监控其日志的服务器。在本案例中,Logstash 部署在 Apache 服务器上,用于收集 Apache 服务器的日志信息并发送到 Elasticsearch。

1、更改主机名

hostnamectl set-hostname apache

2、安装Apahce服务(httpd)

yum -y install httpd

systemctl start httpd

3、安装Java环境

yum -y install javajava -version

4、安装logstash

#上传软件包 logstash-5.5.1.rpm 到/opt目录下

cd /opt

rpm -ivh logstash-5.5.1.rpm

systemctl start logstash.service

systemctl enable logstash.service

#将logstash放入PATH环境变量的目录中,便于系统识别

ln -s /usr/share/logstash/bin/logstash /usr/local/bin/

5、测试 Logstash

(1)Logstash 命令常用选项:

| 选项 | 作用 |

|---|---|

| -f | 通过这个选项可以指定 Logstash 的配置文件,根据配置文件配置 Logstash 的输入和输出流。 |

| -e | 从命令行中获取,输入、输出后面跟着字符串,该字符串可以被当作 Logstash 的配置(如果是空,则默认使用 stdin 作为输入,stdout 作为输出)。 |

| -t | 测试配置文件是否正确,然后退出。 |

(2)定义输入和输出流:

#1.输入采用标准输入,输出采用标准输出(类似管道)

logstash -e 'input { stdin{} } output { stdout{} }'

......

www.baidu.com #键入内容(标准输入)

2020-12-22T03:58:47.799Z node1 www.baidu.com #输出结果(标准输出)

www.sina.com.cn #键入内容(标准输入)

2017-12-22T03:59:02.908Z node1 www.sina.com.cn #输出结果(标准输出)

//执行 ctrl+c 退出

#2.使用 rubydebug 输出详细格式显示,codec 为一种编解码器

logstash -e 'input { stdin{} } output { stdout{ codec=>rubydebug } }'

......

www.baidu.com #键入内容(标准输入)

{

"@timestamp" => 2020-12-22T02:15:39.136Z, #输出结果(处理后的结果)

"@version" => "1",

"host" => "apache",

"message" => "www.baidu.com"

}

#3.使用 Logstash 将信息写入 Elasticsearch 中

logstash -e 'input { stdin{} } output { elasticsearch { hosts=>["192.168.80.10:9200"] } }'

输入 输出 对接

......

www.baidu.com #键入内容(标准输入)

www.sina.com.cn #键入内容(标准输入)

www.google.com #键入内容(标准输入)

//结果不在标准输出显示,而是发送至 Elasticsearch 中,可浏览器访问 http://192.168.121.10:9100/ 查看索引信息和数据浏览。

6、定义 logstash配置文件

Logstash 配置文件基本由三部分组成:input、output 以及 filter(可选,根据需要选择使用)。

- input:表示从数据源采集数据,常见的数据源如Kafka、日志文件等。

- filter:表示数据处理层,包括对数据进行格式化处理、数据类型转换、数据过滤等,支持正则表达式。

- output:表示将Logstash收集的数据经由过滤器处理之后输出到Elasticsearch。

#格式如下:

input {...}

filter {...}

output {...}

#在每个部分中,也可以指定多个访问方式。例如,若要指定两个日志来源文件,则格式如下:

input {

file { path =>"/var/log/messages" type =>"syslog"}

file { path =>"/var/log/httpd/access.log" type =>"apache"}

}

修改Logstash 配置文件:

#修改 Logstash 配置文件,让其收集系统日志/var/log/messages,并将其输出到 elasticsearch 中。

chmod +r /var/log/messages #让 Logstash 可以读取日志

vim /etc/logstash/conf.d/system.conf

input {

file{

path =>"/var/log/messages" #指定要收集的日志的位置

type =>"system" #自定义日志类型标识

start_position =>"beginning" #表示从开始处收集

}

}

output {

elasticsearch { #输出到 elasticsearch

hosts => ["192.168.121.10:9200","192.168.121.20:9200"] #指定 elasticsearch 服务器的地址和端口

index =>"system-%{+YYYY.MM.dd}" #指定输出到 elasticsearch 的索引格式

}

}

systemctl restart logstash

浏览器访问 http://192.168.121.10:9100/ 查看索引信息

5.3 Kiabana 部署(在 Node1 节点上操作)

1、安装 Kiabana

2、设置 Kibana 的主配置文件

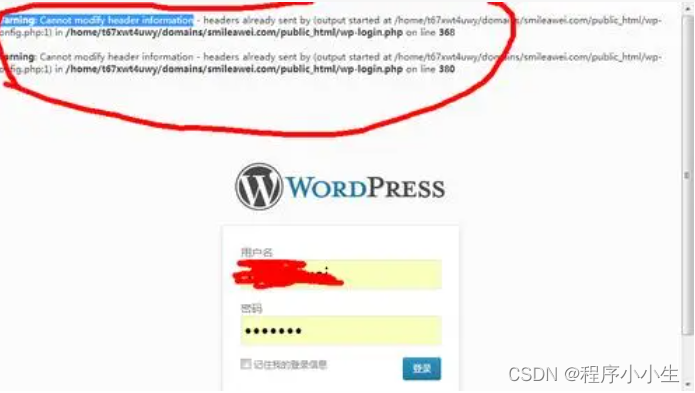

vim /etc/kibana/kibana.yml

#--第2行--取消注释,Kiabana 服务的默认监听端口为5601

server.port: 5601

#--第7行--取消注释,设置 Kiabana 的监听地址,0.0.0.0代表所有地址

server.host: "0.0.0.0"

#--第28行--取消注释,配置es服务器的ip,如果是集群则配置该集群中master节点的ip

elasticsearch.url: ["http://192.168.121.10:9200","http://192.168.121.20:9200"]

#--第37行--取消注释,设置在 elasticsearch 中添加.kibana索引

kibana.index: ".kibana"

#--第96行--取消注释,配置kibana的日志文件路径(需手动创建),不然默认是messages里记录日志

logging.dest: /var/log/kibana.log

3、创建日志文件,启动 Kibana

服务

touch /var/log/kibana.log

chown kibana:kibana /var/log/kibana.log

systemctl start kibana.service

systemctl enable kibana.service

netstat -natp | grep 5601

4、验证 Kibana

浏览器访问 http://192.168.121.10:5601

第一次登录需要添加一个 Elasticsearch 索引:

Index name or pattern

//输入:system-* #在索引名中输入之前配置的 Output 前缀“system”

单击 “create” 按钮创建,单击 “Discover” 按钮可查看图表信息及日志信息。

数据展示可以分类显示,在“Available Fields”中的“host”,然后单击 “add”按钮,可以看到按照“host”筛选后的结果

5、将 Apache 服务器的日志(访问的、错误的)添加到 Elasticsearch 并通过 Kibana 显示

vim /etc/logstash/conf.d/apache_log.conf

input {

file{

path => "/etc/httpd/logs/access_log" #指定访问日志存放位置录

type => "access"

start_position => "beginning" #beginning表示从开头收集,如果只需收集最新的,此处改为latest

}

file{

path => "/etc/httpd/logs/error_log" #指定错误日志存放位置

type => "error"

start_position => "beginning"

}

}

output {

if [type] == "access" {

elasticsearch {

hosts => ["192.168.121.10:9200","192.168.121.20:9200"]

index => "apache_access-%{+YYYY.MM.dd}" #索引后缀加上当天的日期

}

}

if [type] == "error" {

elasticsearch {

hosts => ["192.168.121.10:9200","192.168.121.20:9200"]

index => "apache_error-%{+YYYY.MM.dd}" #索引后缀加上当天的日期

}

}

}

cd /etc/logstash/conf.d/

/usr/share/logstash/bin/logstash -f apache_log.conf