本资料转载于B站up主:大模型成长之路,仅用于学习和讨论,如有侵权请联系

动画解析神经网络为什么可以学习_哔哩哔哩_bilibilis

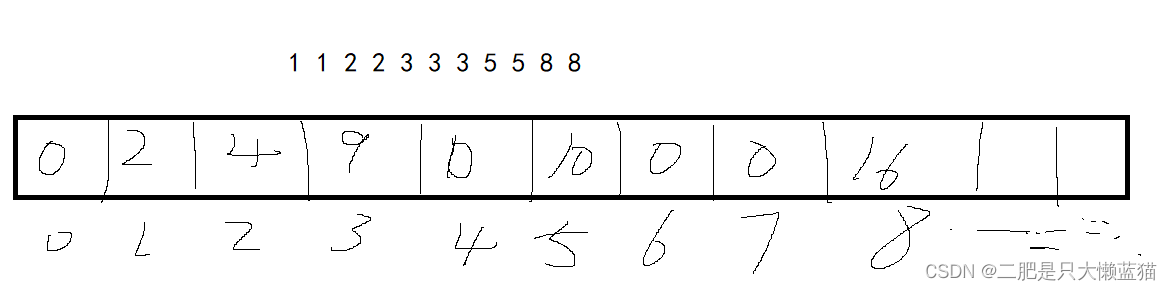

1、一个神经网络是由很多神经元形成的

1.1 也可以是一层,也可以是多层

2 层和层之间的连接就跟一张网一样

2.1 每两个神经元之间有两个参数,我们称之为权重

3 在同一层神经元之间是没有链接的

3.1

4 每两个神经元之间有一些参数

4.1

5、神经网络的第一层称为输入层,主要获取输入信息

5.1

6、中间称为隐藏层,用于特征提取调整权重,让隐藏层的某种神经单元,对某种模式形成反应

6.1

7、最后一层 输出层,最终任务是输出最终结果

7.1

8 为了学习后面的模式,神经网络首先会定义一个损失函数

8.1

9 训练的过程就是将数据不断输入到模型里

9.1

10 利用梯度下降和方向传播的方法

10.1

11、不断优化模型的参数,上面反向传播,以便更好的优化背后的规律,使得损失函数的值越来越小,最终达到学习到背后规律的目的

11.1

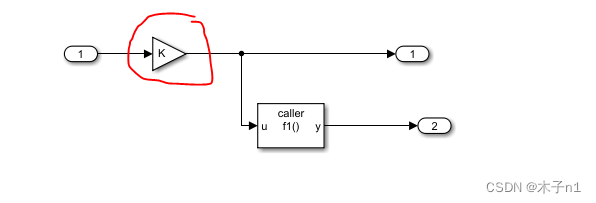

12 最简单的神经元,只有一个输入X

12.1

13 一个参数W,经过神经元的输入之后,可以输出y

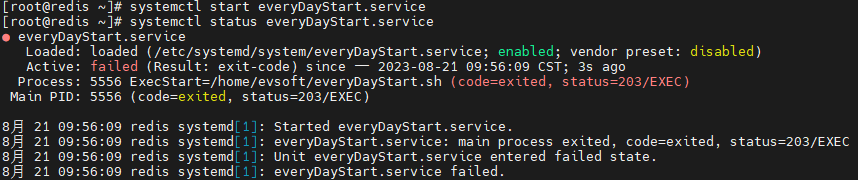

13.1

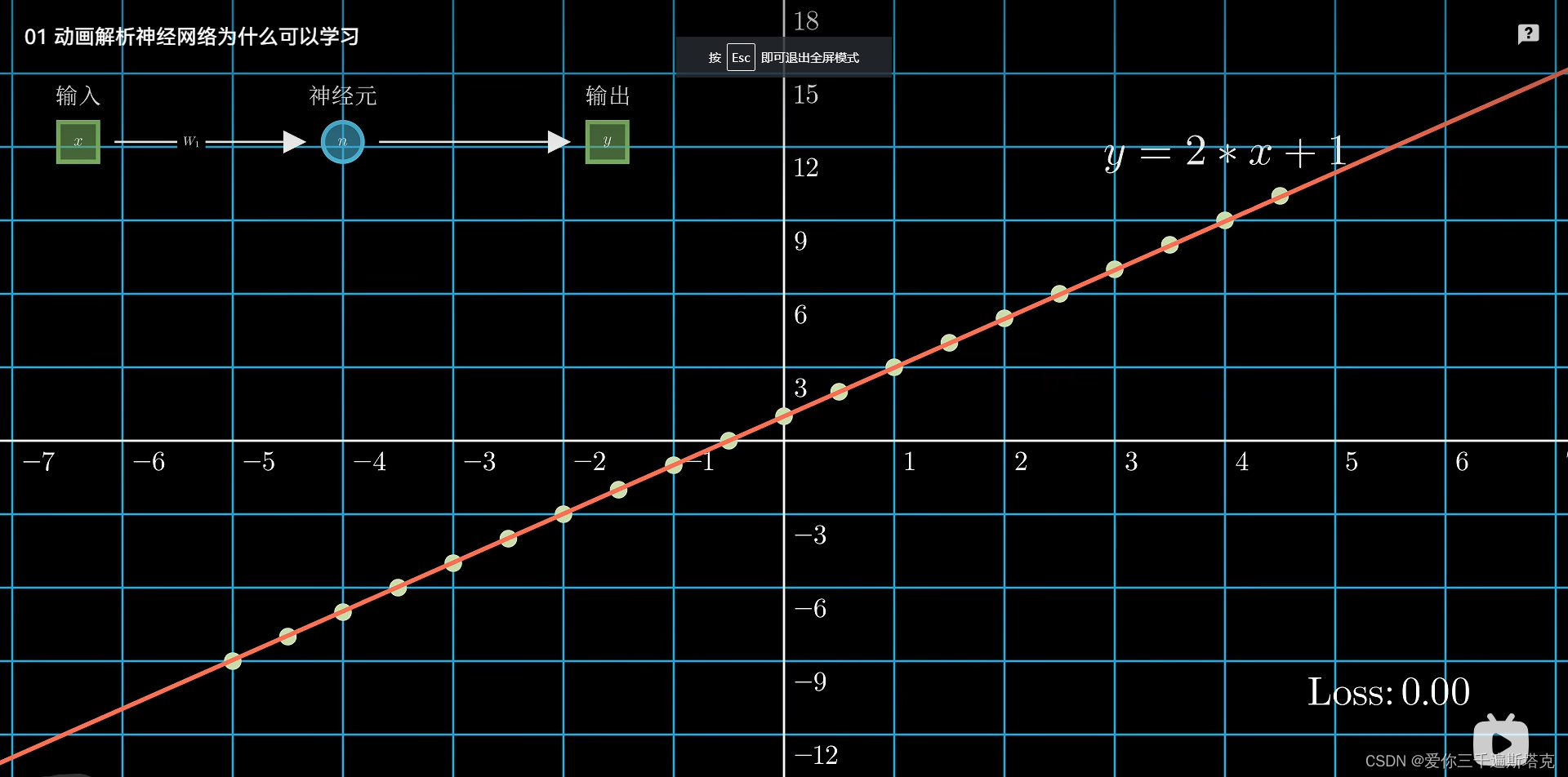

14、由一个神经元,一个输入,一个输出组成的,到底是一个什么样的模型

14.1

15 表示了一个很简单的关系y=w*x +b

15.1

16 这里w和b是需要训练学习的参数

16.1

17 举个例子,当W=0.6,b=e的时候

17.1

17.1

18 学习神经网络如何学习输入和输出数据反应的模型

18.1

19 我们的训练数据都是一些点,这些点都位于一条直线上

19.1

20 我们采用的模型非常简单

20.1

##

21、我们采用的神经元网络模型非常简单,线性关系

21.1

22 我们希望这个数据能够很好的拟合我们的网络数据

22.1

23 用π托迟来训练这个模型

23.1

24 损失函数是MSE,均方误差,均方误差是一种非常常见的损失函数

24.1

25 用来衡量真实值和误差值之间的差异,我们使用了linear输入,linear模型,他只有一个模型,他只有一个输入,和一个输出,在这里输出的个数代表神经元的个数

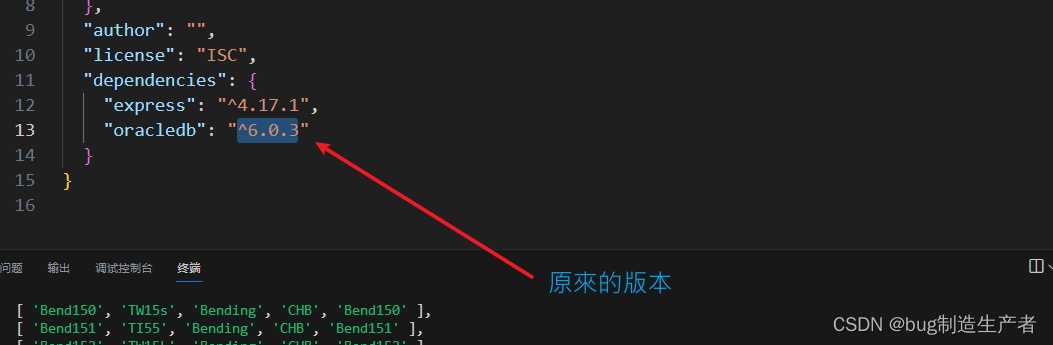

26、我们使用了Linear模型,他只有一个输入,我们使用了Adma优化器来进行了优化

27、下面代码是输入数据,梯度下降,T度下降,优化网络参数的代码

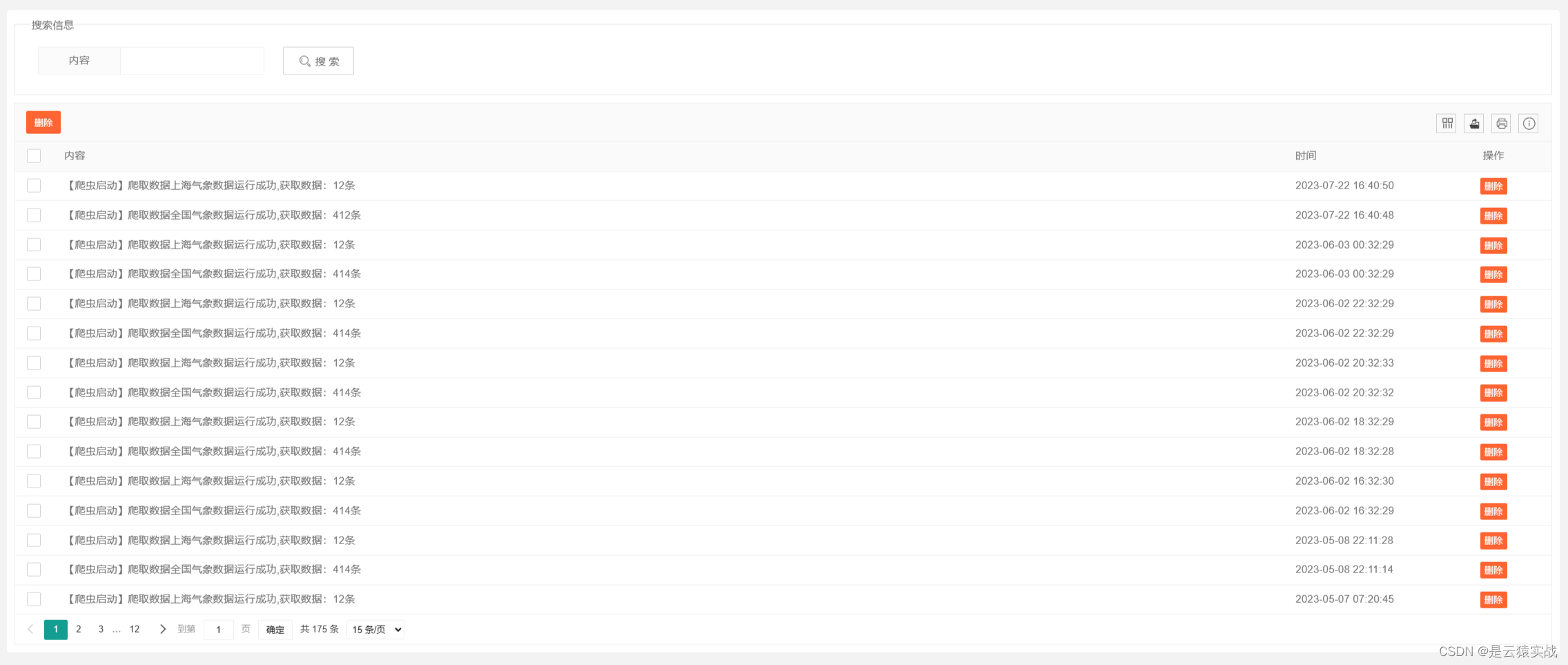

28、刚开始的时候,只是呈线性关系,随着训练进行,数据逐渐找到规律,不断拟合数据,损失函数的值不断减小

29、直到完全拟合数据的线性关系,这表明我们神经网络已经学习到了输入和输出之间的关系

29.1

30

30.1

31、

31.1

32

32.1

33

33.1

34

34.1

35

35.1

36

36.1

37

37.1

38

38.1

39

39.1

40

40.1

41、

41.1

42

42.1

43

43.1

44

44.1

45

45.1

46

46.1

47

47.1

48

48.1

49

49.1

50

50.1