想知道如何使用Python轻松高效地获取网络上的信息? 本篇文章将探索Python自动化爬虫,并展示如何编写实用的脚本。

1. 什么是Python爬虫?

爬虫顾名思义,就是像蜘蛛一样在网络上爬行,抓取各种有用信息的一种程序。而Python爬虫,就是用Python语言编写的爬虫程序。

为什么选择Python来编写爬虫呢?其实,Python有许多优势,比如简单易学、丰富的库支持等。而且,Python的网络爬虫生态非常完整,能帮助你快速实现各种自动化功能。

2. 爬虫的基本原理

爬虫的核心工作原理包括请求网页、解析网页、抓取数据三个步骤。接下来,我们用代码实例演示爬虫的基本原理。

先安装必要的库:

pip install requests

pip install beautifulsoup4

然后编写一个简单的Python脚本,用来抓取一个网页的HTML源码:

import requestsurl = "https://www.example.com"

response = requests.get(url)

html_content = response.textprint(html_content)

这个脚本就实现了爬虫的第一步:请求网页。接下来需要解析网页,抓取我们关心的数据。

3. BeautifulSoup

在解析网页上,Python有一个神奇的库叫BeautifulSoup。它可以让你轻松地从HTML中提取数据。

下面,我们用BeautifulSoup解析刚才抓取到的网页源码,并提取网页标题:

from bs4 import BeautifulSoupsoup = BeautifulSoup(html_content, "html.parser")

title = soup.title.stringprint(title)

这段代码演示了爬虫的第二、三步:解析网页、抓取数据。接下来我们来看一个实战案例。

4. 实战:用Python自动抓取某瓣电影Top 250榜单

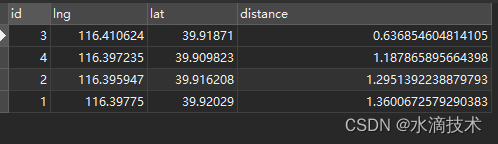

首先,分析某瓣电影Top 250页面的结构。在这个页面,我们关心的数据有:电影名称、评分、导演、主演等。接下来,我们用BeautifulSoup抓取这些数据。

import requests

from bs4 import BeautifulSoupdef get_movie_info(url):response = requests.get(url)soup = BeautifulSoup(response.text, "html.parser")movie_list = soup.find_all("div", class_="item")for movie in movie_list:title = movie.find("span", class_="title").stringrating = movie.find("span", class_="rating_num").stringinfo = movie.find("div", class_="bd").p.text.strip()director, actors = info.split("\n")[0].split("主演", 1)director = director.strip().replace("导演: ", "")actors = actors.strip()print(f"电影:{title}\n评分:{rating}\n导演:{director}\n主演:{actors}\n")base_url = "https://movie.mouban.com/top250?start={}&filter="

for i in range(0, 250, 25):url = base_url.format(i)get_movie_info(url)

这个脚本会自动抓取某瓣电影Top 250榜单的所有页面,并提取我们关心的数据(电影名、评分、导演、主演)。

5. Python爬虫的进阶应用与技巧

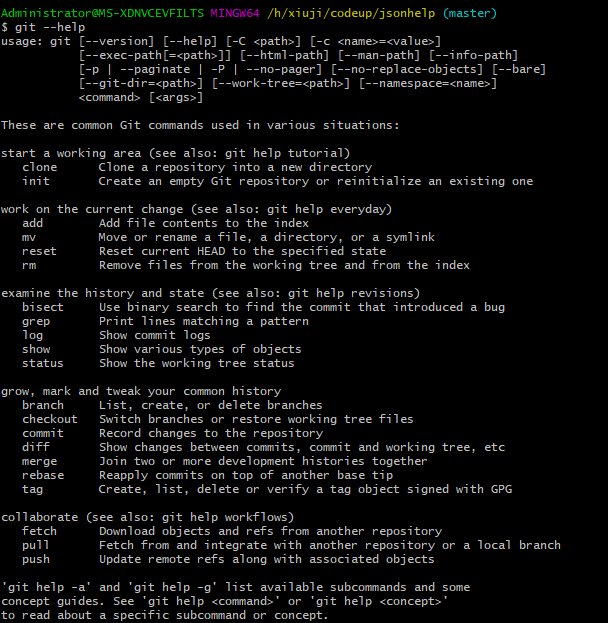

除了以上简单的应用外,还可以使用Selenium库实现动态页面的抓取,或者使用Scrapy框架构建更复杂的爬虫项目。此外,还要学会处理各种反爬策略,如设置代理、伪装User-Agent等。

Python爬虫,只有你想不到,没有它做不到的!仅供学习使用,切勿用于非法目的。

![高并发内存池(centralcache)[2]](https://img-blog.csdnimg.cn/e0027340907b4c3aa5c6285d4cc6c4bc.png)