分类预测 | MATLAB实现基于RF-Adaboost随机森林结合AdaBoost多输入分类预测

目录

- 分类预测 | MATLAB实现基于RF-Adaboost随机森林结合AdaBoost多输入分类预测

- 预测效果

- 基本介绍

- 模型描述

- 程序设计

- 参考资料

预测效果

基本介绍

1.MATLAB实现基于RF-Adaboost随机森林结合AdaBoost多输入分类预测;

2.运行环境为Matlab2018b;

3.输入多个特征,分四类预测;

4.data为数据集,excel数据,前多列输入,最后输出四类标签,主程序运行即可,所有文件放在一个文件夹;

5.可视化展示分类准确率。

模型描述

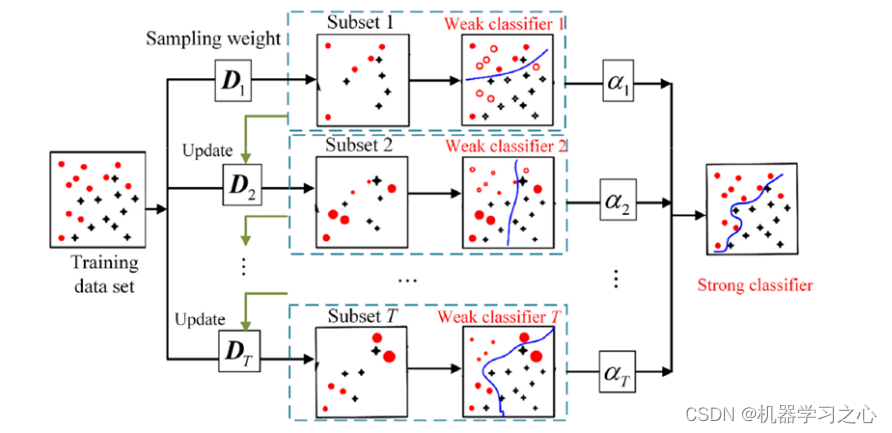

RF-Adaboost随机森林结合AdaBoost多输入分类预测是一种基于机器学习和集成学习的预测方法,其主要思想是将t随机森林(RF)和AdaBoost算法相结合,通过多输入模型进行预测。

具体流程如下:

数据预处理:对原始数据进行清洗、归一化和分割等预处理步骤。

特征提取:利用RF模型对数据进行特征提取,得到多个特征向量作为AdaBoost算法的输入。

AdaBoost模型训练:利用AdaBoost算法对多个特征向量进行加权组合,得到最终的预测结果。

模型评估:对预测结果进行评估。

模型优化:根据评估结果对模型进行优化,可以尝试调整模型的参数、改变AdaBoost算法的参数等。

预测应用:将优化后的模型应用于实际预测任务中,进行实时预测。

该方法的优点在于,RF模型可以提取数据特征,而AdaBoost算法可以有效地利用多个特征向量进行加权组合,提高预测准确率。同时,该方法不仅适用于单一数据源的预测任务,也可以应用于多数据源的集成预测任务中。缺点在于,该方法对数据量和计算资源的要求较高,需要大量的训练数据和计算能力。

程序设计

- 完整源码和数据获取方式:私信回复RF-Adaboost随机森林结合AdaBoost多输入分类预测。

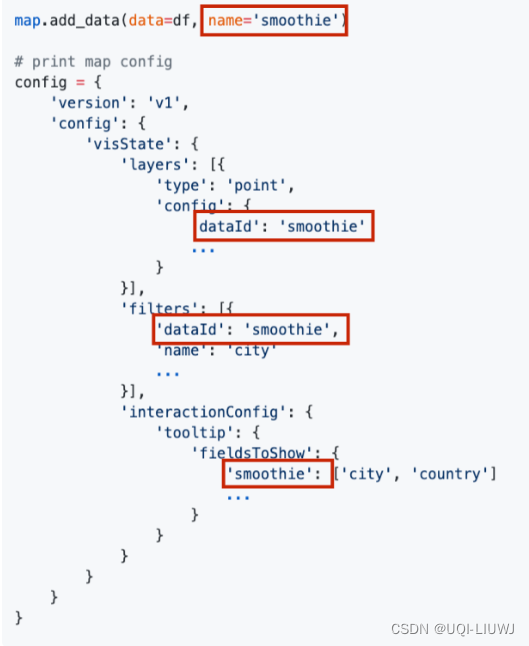

%% 预测

t_sim1 = predict(net, p_train);

t_sim2 = predict(net, p_test ); %% 数据反归一化

T_sim1 = mapminmax('reverse', t_sim1, ps_output);

T_sim2 = mapminmax('reverse', t_sim2, ps_output);%% 均方根误差

error1 = sqrt(sum((T_sim1' - T_train).^2) ./ M);

error2 = sqrt(sum((T_sim2' - T_test ).^2) ./ N);%% 相关指标计算

% R2

R1 = 1 - norm(T_train - T_sim1')^2 / norm(T_train - mean(T_train))^2;

R2 = 1 - norm(T_test - T_sim2')^2 / norm(T_test - mean(T_test ))^2;disp(['训练集数据的R2为:', num2str(R1)])

disp(['测试集数据的R2为:', num2str(R2)])% MAE

mae1 = sum(abs(T_sim1' - T_train)) ./ M ;

mae2 = sum(abs(T_sim2' - T_test )) ./ N ;disp(['训练集数据的MAE为:', num2str(mae1)])

disp(['测试集数据的MAE为:', num2str(mae2)])%% 平均绝对百分比误差MAPE

MAPE1 = mean(abs((T_train - T_sim1')./T_train));

MAPE2 = mean(abs((T_test - T_sim2')./T_test));disp(['训练集数据的MAPE为:', num2str(MAPE1)])

disp(['测试集数据的MAPE为:', num2str(MAPE2)])% MBE

mbe1 = sum(abs(T_sim1' - T_train)) ./ M ;

mbe2 = sum(abs(T_sim1' - T_train)) ./ N ;disp(['训练集数据的MBE为:', num2str(mbe1)])

disp(['测试集数据的MBE为:', num2str(mbe2)])%均方误差 MSE

mse1 = sum((T_sim1' - T_train).^2)./M;

mse2 = sum((T_sim2' - T_test).^2)./N;disp(['训练集数据的MSE为:', num2str(mse1)])

disp(['测试集数据的MSE为:', num2str(mse2)])

参考资料

[1] https://blog.csdn.net/kjm13182345320/article/details/128577926?spm=1001.2014.3001.5501

[2] https://blog.csdn.net/kjm13182345320/article/details/128573597?spm=1001.2014.3001.5501