码云的网址:Gitee - 基于 Git 的代码托管和研发协作平台

这是一个国内的托管代码平台,速度要比国外的快

1.0 注册

如何注册码云?

查考文章:https://jingyan.baidu.com/article/425e69e6a8cad6ff14fc1615.html

2.0 使用

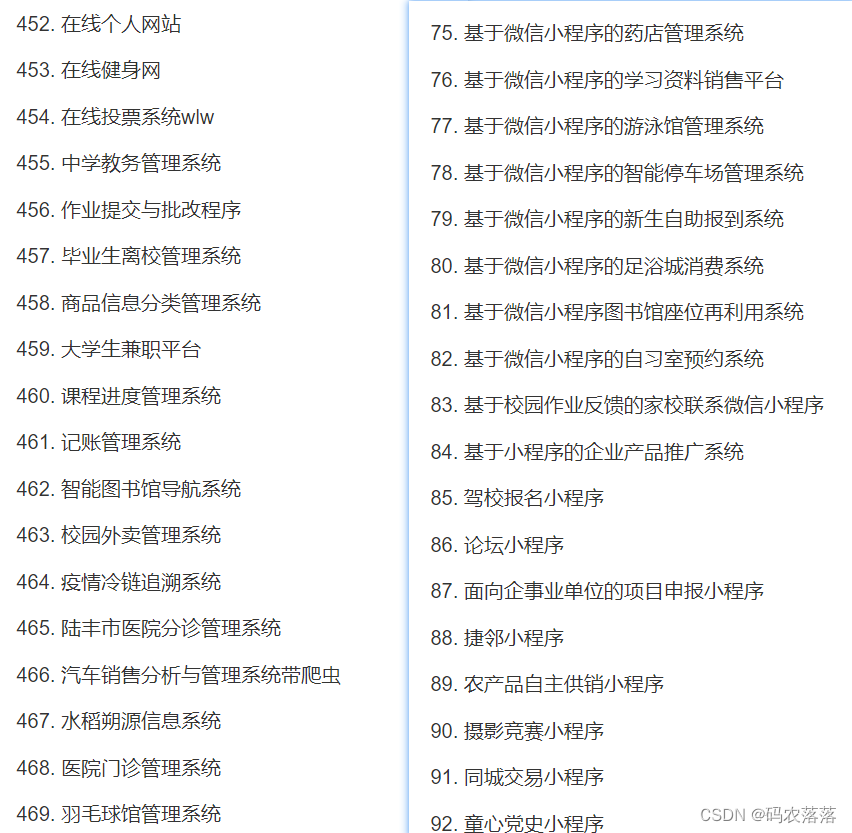

使用码云进行代码管理,以下是博主自己写的博客列表,仅供参考,后续更多实用功能陆续更新

1.0 https://jingyan.baidu.com/article/425e69e6a8cad6ff14fc1615.html

2.0 1-2 gitee创建远程仓库-CSDN博客

3.0 1-3 gitee删除远程仓库-CSDN博客

4.0 1-4 克隆远程仓库到本地-CSDN博客

5.0 1-6 gitee提交后绿点-CSDN博客

6.0 1-7 gitee代码推送问题-CSDN博客

......