风定落花生,歌声逐流水,大家好我是风歌,混迹在java圈的辛苦码农。今天要和大家聊的是一款基于ssm的医院门诊挂号系统。项目源码以及部署相关请联系风歌,文末附上联系信息 。

项目简介:

医院门诊挂号系统的主要使用者分为:

管理员对系统所有的信息进行管理,主要对主页、个人中心、用户管理、就诊人建档管理、医院介绍管理、科室管理、医生管理、预约挂号管理、用户退号管理、异常提醒管理、留言板、系统管理的实现。

另外系统前台还需要:首页、医院介绍、医生、公告栏、留言板、个人中心、后台管理等内容进行配合管理。

💕💕作者:风歌(风定落花生,歌声逐流水的风歌)

💕💕个人简介:混迹在java圈十年有余,擅长Java、微信小程序、Python、Android等,大家有这一块的问题可以一起交流!

💕💕各类成品java毕设 。javaweb,ssh,ssm,springboot等等项目框架,源码丰富,欢迎咨询。学习资料、程序开发、技术解答、代码讲解、文档报告,需要请看文末联系方式

开发环境:

后端:

开发语言:Java

框架:ssm,mybatis

JDK版本:JDK1.8

数据库:mysql 5.7+

数据库工具:Navicat11+

开发软件:eclipse/idea

tomcat:7+

Maven包:Maven3.3+

前端:

jsp

数据库:

mysql

系统架构:

主要功能:

系统功能模块

医院门诊挂号系统

在系统首页可以查看首页、医院介绍、医生、公告栏、留言板、个人中心、后台管理等内容,并进行详细操作。

用户注册

在用户注册页面通过填写账号、姓名、密码、确认密码、数量、手机等信息进行注册操作。

医院介绍

在医院介绍页面可以查看医院名称、封面、医院地址、医院资源、科室分布、主营业务、更新时间、医院介绍等信息,并进行评论、收藏操作。

医生

在医生页面可以查看医生姓名、医生工号、科室、性别、职称、挂号、职称、挂号费用、剩余号源、出诊时间、电话、特长、业务介绍、照片等信息,并进行评论、挂号操作。

个人中心

在个人中心页面通过填写账号、姓名、密码、性别、年龄、手机等信息进行个人信息更新,还可以对我的收藏进行详细操作。

后台功能模块

后台登录进入系统前在登录页面根据要求填写用户名和密码,选择角色等信息,点击登录进行登录操作。

管理员功能模块

管理员登录系统后,可以对主页、个人中心、用户管理、就诊人建档管理、医院介绍管理、科室管理、医生管理、预约挂号管理、用户退号管理、异常提醒管理、留言板、系统管理等功能进行相应的操作管理。

用户管理

在用户管理页面可以对账号、姓名、性别、年龄、手机等内容进行查看,修改和删除等操作。

就诊人建档管理

在就诊人建档管理页面可以对就诊卡号、身份证、建档时间、账号、姓名、性别、年龄、手机等内容进行查看,修改和删除等操作。

医院介绍管理

在医院介绍管理页面可以对医院名称、封面、医院地址、医师资源、科室分布、主营业务、更新时间等内容进行查看、修改、查看评论和删除等操作。

医生管理

在医生管理页面可以对医生工号、医生姓名、科室、头像、性别、职称、挂号费用、剩余号源、出诊时间、电话、特长等信息进行查看、修改、查看评论和删除等操作。

用户退号管理

在用户退号管理页面可以对挂号单号、医生工号、医生姓名、科室、挂号费用、预约时间、退号原因、退号时间、账号、姓名、手机、是否审核、审核回复等信息进行查看,修改和删除等操作。

异常提醒管理

在异常提醒管理页面可以对账号、姓名、手机、提醒内容、提醒时间等信息进行查看,修改和删除等操作。

留言板

在留言板页面可以对用户名、留言内容、留言图片、回复内容、回复图片等内容进行查看、修改、回复和删除操作。

系统管理

在轮播图管理页面可以对名称 、值等内容进行查看、修改操作,并根据需要公告栏进行操作。

用户功能模块

用户登录进入系统可以对主页、个人中心、就诊人建档管理、预约挂号管理、用户退号管理、异常提醒管理、我的收藏管理等功能进行相应操作。

个人中心

在个人中心页面通过填写账号、姓名、性别、年龄、手机等信息进行个人信息提交。

预约挂号管理

在预约挂号管理页面可以对挂号单号、医生工号、医生姓名、科室、挂号费用、预约时间、挂号时间、账号、姓名、性别、年龄、手机、是否审核、审核回复、是否支付等内容进行退号、查看、修改和删除操作。

用户退号管理

在用户退号管理页面可以对挂号单号、医生工号、医生姓名、科室、挂号费用、预约时间、退号原因、退号时间、账号、姓名、手机、是否审核、审核回复等内容进行查看、修改和删除操作。

异常提醒管理

在异常提醒管理页面可以对账号、姓名、手机、提醒内容、提醒时间等内容进行查看或删除操作。

我的收藏管理

在我的收藏管理页面可以对收藏名称、收藏图片、推荐类型等内容进行查看、删除操作。

医生功能模块

医生登录进入系统可以对主页、个人中心、预约挂号管理、用户退号管理、留言板、系统管理等功能进行相应操作。

预约挂号管理

在预约挂号管理页面可以对挂号单号、医生工号、医生姓名、科室、挂号费用、预约时间、挂号时间、账号、姓名、性别、年龄、手机、是否审核、审核回复、是否支付等内容进行审核、查看操作。

用户退号管理

在用户退号管理页面可以对挂号单号、医生工号、医生姓名、科室、挂号费用、预约时间、退号原因、退号时间、账号、姓名、手机、是否审核、审核回复等内容进行审核、查看操作。

以上就是项目的一些基本信息了。

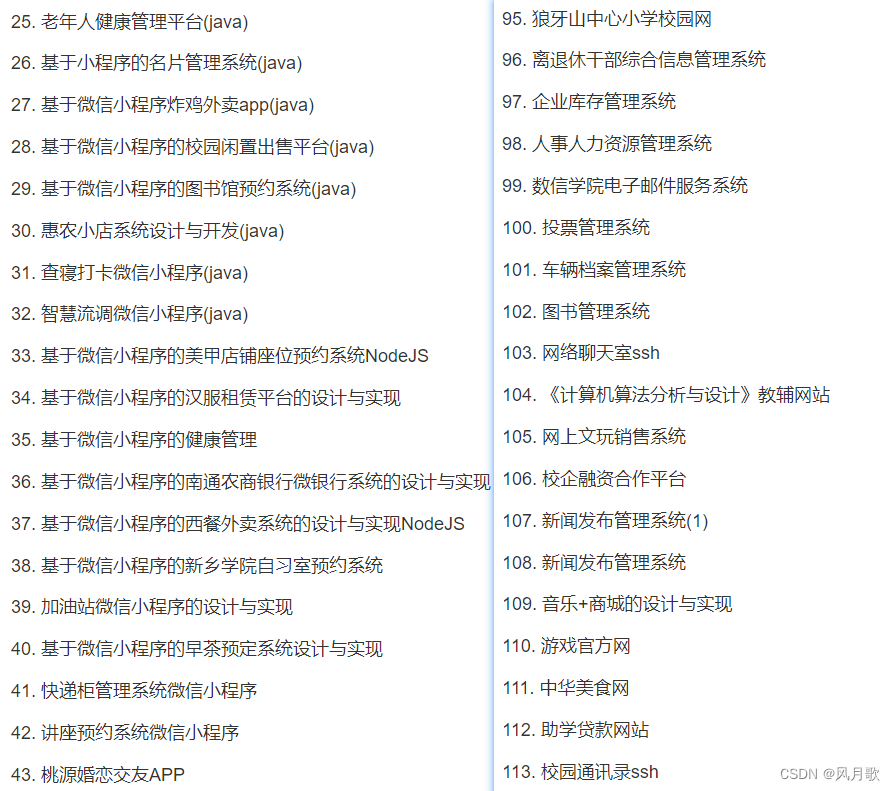

更多项目:

另有2000+份项目源码,项目有java(包含springboot,ssm,jspm等),小程序,python,php,net等语言项目。项目均包含完整前后端源码,可正常运行!