在这篇博文中,我们将介绍如何在Mac上更新Cursor应用程序,以及一些相关的使用技巧和功能。

什么是Cursor?

Cursor是一款强大的工具,旨在帮助用户更好地编写、编辑和讨论代码。它结合了AI技术,使得编程过程更加高效和便捷。Cursor不仅支持代码编辑,还可以与团队成员进行实时协作。

如何安装Cursor

如果你还没有安装Cursor,可以通过以下步骤进行安装:

-

使用Homebrew安装:

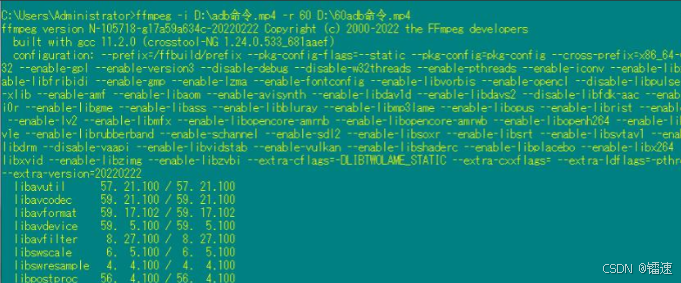

如果你已经配置好Homebrew,可以通过终端快速安装Cursor。打开终端并输入以下命令:brew install --cask cursor -

从官方网站下载:

你也可以直接访问Cursor的官方网站,下载适用于macOS的安装包,通常为.dmg格式。

如何更新Cursor

更新Cursor非常简单,以下是具体步骤:

-

检查当前版本:

打开Cursor应用,点击“帮助”菜单,然后选择“关于”,可以看到当前版本信息。 -

使用Homebrew更新:

如果你是通过Homebrew安装的,可以在终端中运行以下命令:brew upgrade --cask cursor -

手动更新:

如果你发现自动更新不工作,可以考虑直接从官方网站重新下载最新版本的Cursor。你无需先卸载旧版本,直接覆盖安装即可。

Cursor的主要功能

- 智能代码编辑:支持多种编程语言的语法高亮和自动补全。

- 实时协作:可以与其他用户共享代码,并进行实时讨论。

- AI助手:内置AI助手可以提供代码建议和修复方案,提高编程效率。

总结

随着技术的发展,工具的更新也变得越来越重要。保持Cursor的最新版本,不仅能享受到新功能,还能提高工作效率。如果你在使用过程中遇到任何问题,可以随时参考官方文档或社区支持。

希望这篇博文能帮助你更好地理解和使用Cursor!

Citations:

[1] https://wenku.csdn.net/answer/3bqif1obkd

[2] https://www.macat.vip/13925.html

[3] https://www.cnblogs.com/xuanyu-10-18/p/12901954.html

[4] https://forum.cursor.com/t/how-to-update-cursor-in-macos-i-dont-see-any-option/1471

[5] https://macoshome.com/app/productivity/14683.html

[6] https://www.imymac.com/zh-CN/mac-tips/change-cursor-mac.html

[7] https://linux.do/t/topic/292380