读所罗门的密码笔记16_直通心智

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.rhkb.cn/news/304383.html

如若内容造成侵权/违法违规/事实不符,请联系长河编程网进行投诉反馈email:809451989@qq.com,一经查实,立即删除!相关文章

Nginx日志格式化和追踪

背景

Nginx是一款功能强大的Web服务器,对于网络环境中的日志记录和配置至关重要。定制化Nginx日志格式可以帮助管理员更好地监控服务器性能、分析用户行为并做出相应优化。在本文中,我们将深入探讨Nginx日志格式的高级定制化策略,包括理解基…

【多线程】Thread的常见属性 | 终止线程 | 等待线程 | 休眠线程 | 线程安全

文章目录 一、Thread的方法Thread的常见属性后台线程(守护线程)设置后台线程是否存活 启动线程终止\打断一个线程1.创建标志位2.调用 interrupt() 方法 等待一个线程 join()t.join()的工作过程: 休眠一个进程sleep 二、…

ppt从零基础到高手【办公】

第一章:文字排版篇01演示文稿内容基密02文字操作规范03文字排版处理04复习&作业解析第二章:图形图片图表篇05图形化表达06图片艺术化07轻松玩转图表08高效工具&母版统一管理09复习&作业解析10轻松一刻-文字图形小技巧速学第三章:…

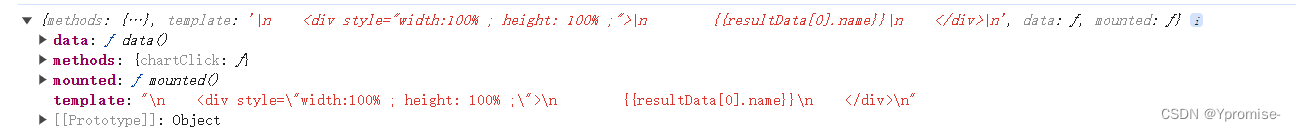

vue模版字符串解析成vue模版对象

模版字符串

this.code

<template><div style"width:100% ; height: 100% ;">{{resultData[0].name}}</div>

</template>

<script>

export default {data() {return {resultData: [{ name: 图幅, value: 20 },]}},mounted(){},method…

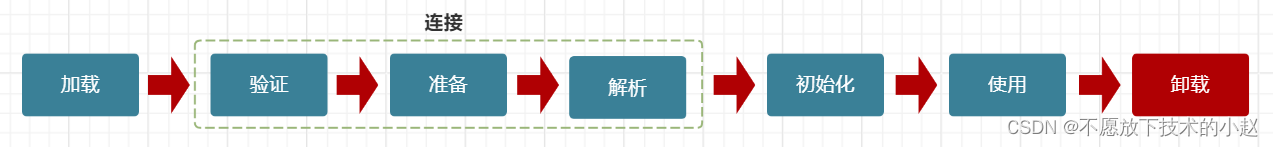

JVM虚拟机(二)类加载器、双亲委派模型、类装载的执行过程

目录 一、类加载器1.1 什么是类加载器?1.2 类加载器的分类 二、双亲委派模型2.1 什么是双亲委派模型?1) 示例一:加载自己创建的类2)示例二:加载JDK原有的类 2.2 JVM 为什么采用双亲委派模型? 三…

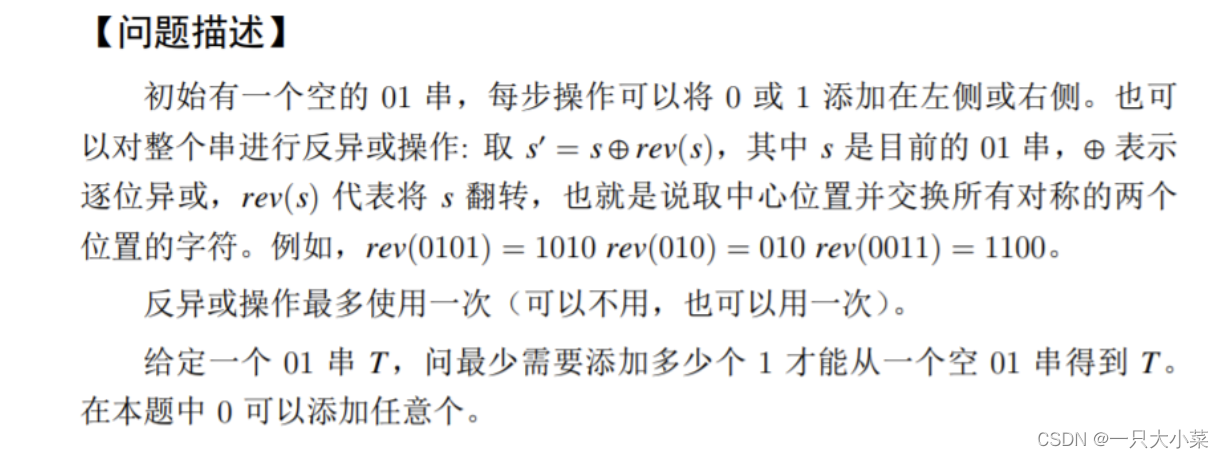

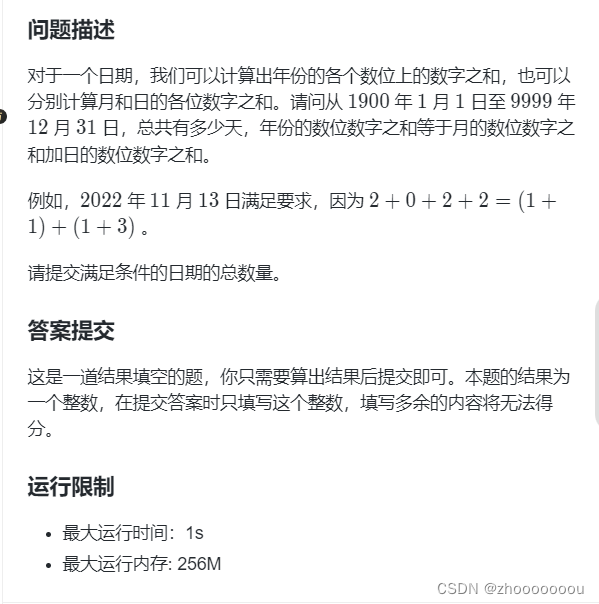

第14届java A组蓝桥杯做题记录

A题 特殊日期 package Java14省赛.Java研究生组;import java.time.Year;

//特殊判断一下2月份,leaf 为true 1

import java.util.*;import 蓝桥杯.dfs_n皇后;

public class 特殊日期 {static int sum(int d){int res 0;while(d > 0){res d % 10;d / 10;}return…

备战蓝桥杯Day40 - 第11届python组真题 - C跑步锻炼

一、题目描述 二、思路

1、使用datetime库中的方法可以很好的解决这个问题。

2、定义起始时间和结束时间,判断是否是周一或者是1号,结果res加上相应的里程数。

3、最后输出 res 即为本题答案。

三、代码实现

import datetimestart datetime.date(2…

NzN的数据结构--选择排序

接上文,本章我们来介绍选择排序。先三连后看才是好习惯~~~ 目录

一、基本思想

二、直接选择排序

三、堆排序 一、基本思想 每一次从待排序的数据元素中选出最小(或最大)的一个元素,存放在序列的起始位置,直到全部待…

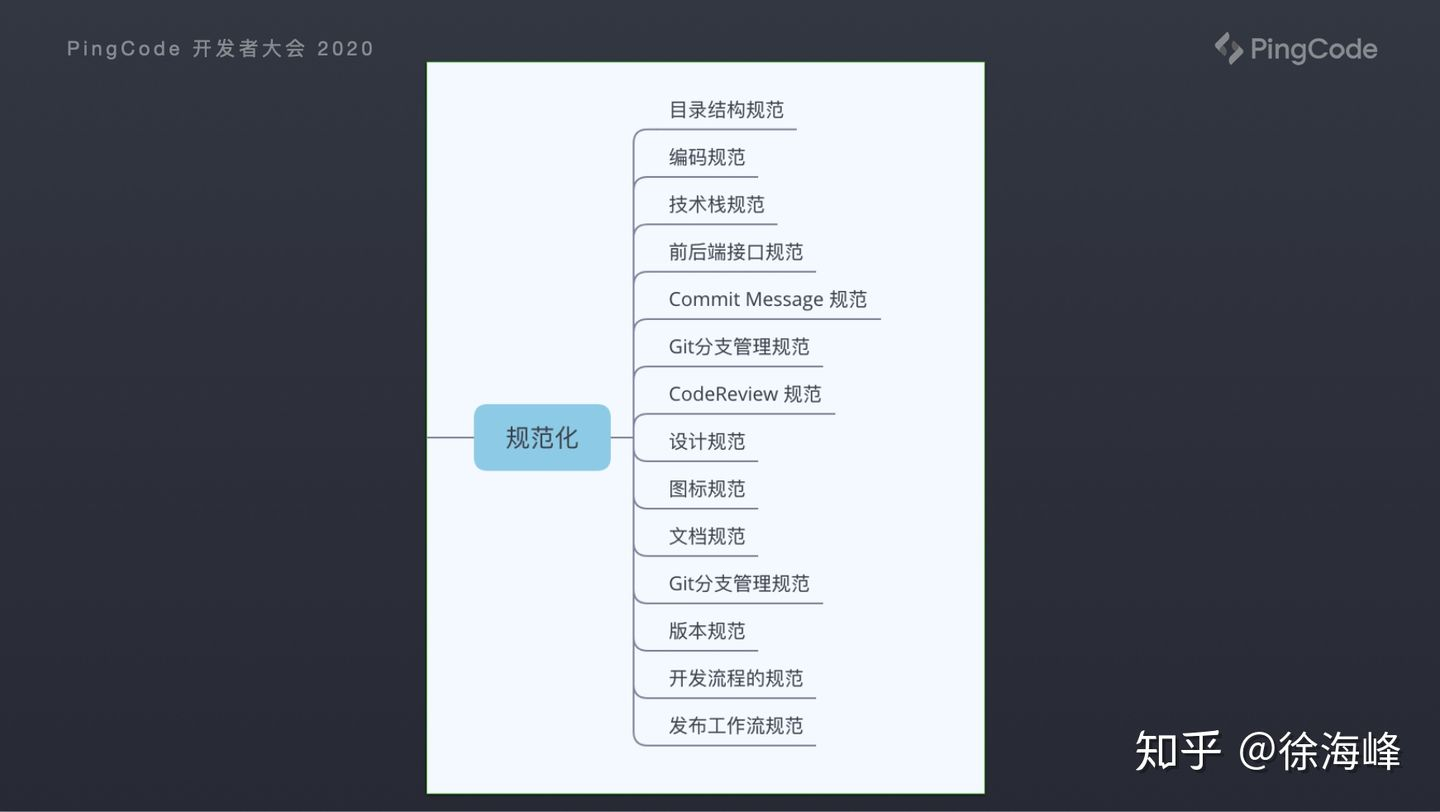

前端工程化理解 (2024 面试题)

最好介绍远古世界最好随性一点,不要太刻板 ,不然像背书

什么是前端工程化? - 知乎

前端工程化的历史

互联网初期,09 年以前,页面只需要展示一些列表、表格、文章内容以及简单图片即可,其目的是为了传送信…

SHOPFA:APP定制开发的哪种二开项目容易交付,哪些不可以接?

在商城系统开发领域,定制开发与二次开发(二开)是两种截然不同的项目类型。它们之间的主要差异体现在项目起点、灵活性、成本、时间以及风险等多个方面。 一、项目起点

商城定制开发通常是从零开始,根据客户的实际需求,…

电介质材料(四)——复合电介质材料

本篇为西安交通大学本科课程《电气材料基础》的笔记。

本篇为这一单元的第四篇笔记,上一篇传送门。

复合电介质材料

是由多种成分共同组成,例如油纸复合绝缘、云母层压板、环氧浸渍玻璃纤维布等。即便是没有添加的材料,材料也会存在杂质和…

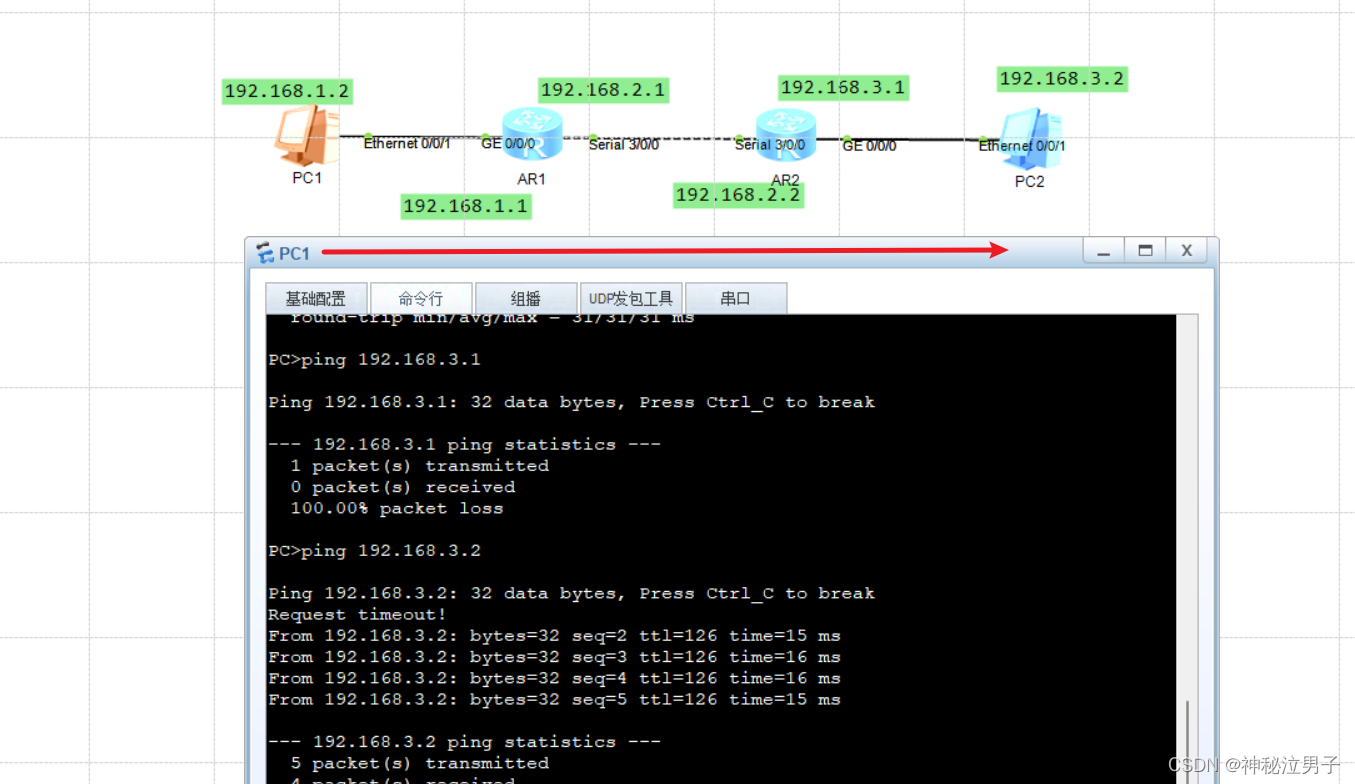

华为ensp中PPP(点对点协议)中的CHAP认证 原理和配置命令

作者主页:点击!

ENSP专栏:点击!

创作时间:2024年4月11日6点00分 PPP协议(Point-to-Point Protocol)是点到点协议,是一种常用的串行链路层协议,用于在两个节点之间建立点…

地表蒸散发遥感产品信息提取验证与融合

原文链接:地表蒸散发遥感产品信息提取验证与融合https://mp.weixin.qq.com/s?__bizMzUzNTczMDMxMg&mid2247600962&idx4&sncb995f8ac85c3c0759da82a15520c118&chksmfa820aa5cdf583b306988fbb5795c6370dab52a2fde5cfa5a8566dd7ba2864cb651c9230c6f3&…

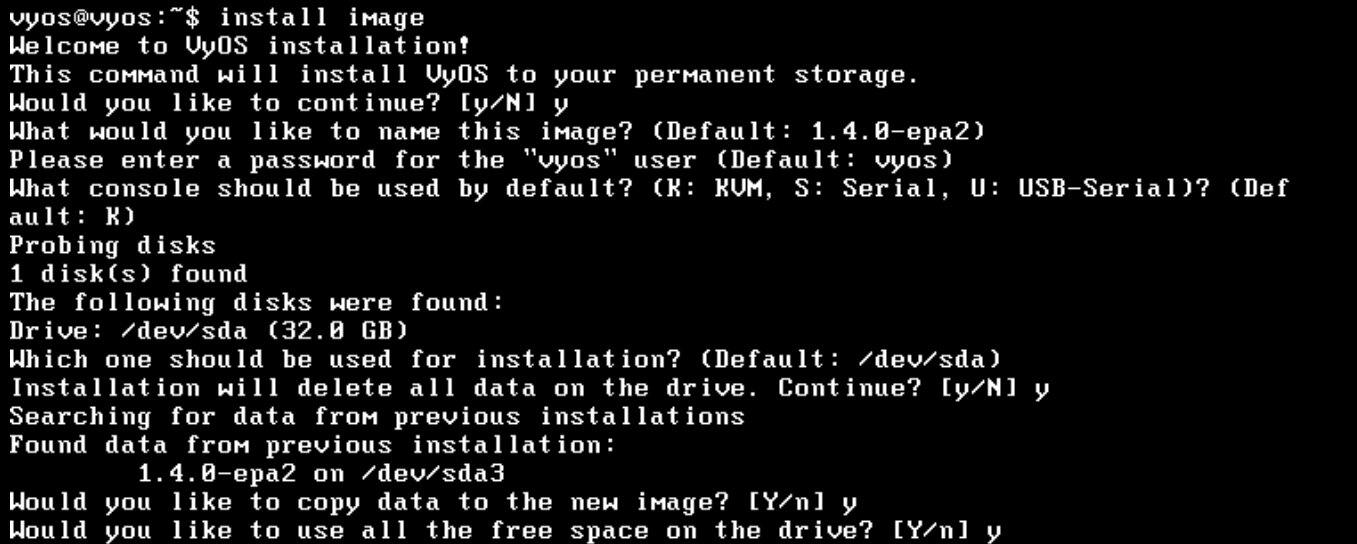

企业级开源路由系统VyOS-构建和使用

介绍

VyOS是一个基于Linux的企业级路由器操作系统,被许多公司和个人用来驱动物理网络设备,如路由器和防火墙。它有一个统一的命令行界面来管理其所有的网络相关功能(和Juniper Junos操作很像)。VyOS使用Debian GNU/Linux作为其基…

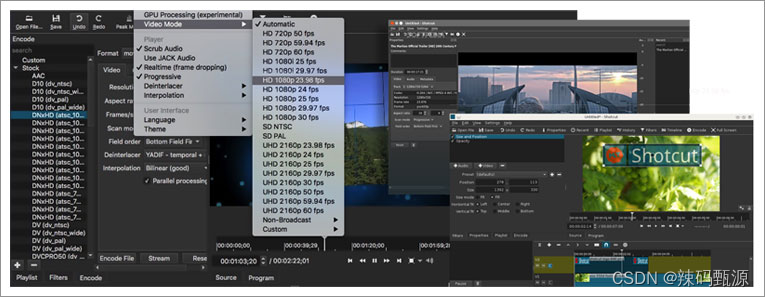

Shotcut:免费且开源的优质视频剪辑工具

Shotcut:您的专业级免费开源视频编辑利器,助您轻松实现创意无限的剪辑梦想!- 精选真开源,释放新价值。 概览

Shotcut,一款广受赞誉的免费、开源跨平台视频编辑软件,以其卓越的功能性和易用性赢得了全球用户…

打造智能健身时代:健身房会员管理系统解析

随着健康意识的提升和生活水平的提高,健身行业正迎来蓬勃发展的时代。健身房作为人们锻炼身体的重要场所,其会员管理系统的优劣直接影响到健身房的运营效率和服务质量。本文将探讨健身房会员管理系统的重要性以及如何打造智能化的健身时代。

1. 会员信息…

【今日刷题】LeetCode 199.二叉树的右视图(中等)

今日刷题:LeetCode 199.二叉树的右视图(中等) 题目描述: 给定一个二叉树的 根节点 root,想象自己站在它的右侧,按照从顶部到底部的顺序,返回从右侧所能看到的节点值。

示例 1:

输入: [1,2,3,…

推荐文章

- 男子用ChatGPT编假新闻被采取刑事强制措施;苹果M3芯片下半年量产;Safari超Edge,成第二大桌面浏览器|极客头条...

- MySQL 5.7和8.0版本在多个方面存在显著区别,主要包括性能优化、新特性引入以及安全性提升

- # SpringBoot 如何让指定的Bean先加载

- ### 通达信数据之实时机构持股数据接口

- #从零开始# 在深度学习环境中,如何用 pycharm配置使用 pipenv 虚拟环境

- (013)window的Idea运行程序 Amazon java.nio.file.AccessDeniedException

- (ISPRS,2023)深度语义-视觉对齐用于zero-shot遥感图像场景分类

- (动手学习深度学习)第13章 计算机视觉---图像增广与微调

- (函数)颠倒字符串顺序(C语言)

- (九)Pandas表格样式 学习简要笔记 #Python #CDA学习打卡

- (数据结构练习题)合并两个有序数组

- (我的创作纪念日)[MySQL]数据库原理7——喵喵期末不挂科