1. Whisper-cli:可本地部署的开源语音识别系统

近日,Ruff的开发团队发布了一款名为Whisper cpp cli的全新语音识别系统,该系统已在GitHub Repo上开源。这是一款完全自主研发的语音转文字系统,基于Whisper技术构建。Ruff团队一直以创新技术和高品质服务闻名于业界,本次发布的Whisper cpp cli无疑将为语音识别技术提供一种新的可能性。这款系统的主要特点在于,它完全自我包含,不依赖于任何外部系统或服务。这意味着,用户可以直接在自己的设备上运行这个系统,无需连接到互联网或使用特定的硬件。这使得Whisper cpp cli非常适合于需要高度自主,安全和私密的应用场景。

划重点

-

Ruff的开发团队发布了一款名为Whisper cpp cli的全新语音识别系统

-

该系统是一款完全自主研发的语音转文字系统,基于Whisper技术构建

-

Whisper cpp cli完全自我包含,不依赖于任何外部系统或服务,适合于需要高度自主,安全和私密的应用场景

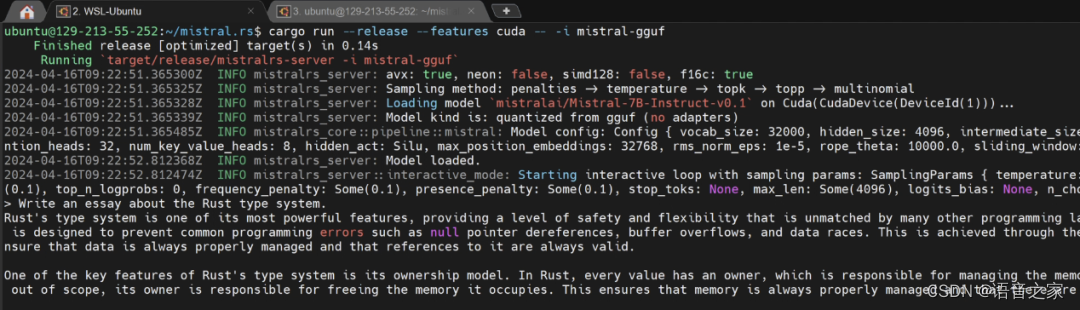

2. Mistral.rs:一款快速的LLM开源推理平台

近日,一款名为Mistral.rs的LLM推理平台在GitHub上备受关注。它可以支持多种设备上的推理,支持量化,并且具有易于使用的应用程序,带有OpenAI API兼容的HTTP服务器和Python绑定。无论是在深度学习推理、设备兼容性,还是在工具的易用性方面,Mistral.rs都展现出了其强大的实力。同时,它还提供了OpenAI API兼容的HTTP服务器,使得开发者在进行模型部署和推理时更为方便。此外,Mistral.rs还提供了Python绑定,这使得开发者可以更方便地在Python环境下使用这个平台,进一步提高了开发效率。Mistral.rs的出现,无疑为AI开发者提供了一个全新的、高效的开发工具。

划重点

-

Mistral.rs是一款在GitHub上的快速LLM推理平台

-

Mistral.rs支持在多种设备上进行推理,并支持量化

-

Mistral.rs提供了OpenAI API兼容的HTTP服务器和Python绑定,使得开发者可以更方便地使用

3. Dokploy:开源版Vercel,应用云托管PaaS平台

Dokploy是一个免费的、可自我托管的平台即服务(PaaS)解决方案。它简化了应用程序和数据库的部署和管理。Dokploy允许开发者在任意的虚拟私有服务器(VPS)上高效、安全地部署应用程序。其主要特性包括整合Traefik,实时监控,数据库备份等。透过Dokploy,开发者可以更方便地进行各种应用的部署和维护,大大提高开发效率和系统的稳定性。

划重点

-

Dokploy是一个免费的、可自我托管的平台即服务(PaaS)解决方案

-

Dokploy允许开发者在任意的虚拟私有服务器(VPS)上高效、安全地部署应用程序

-

Dokploy的主要特性包括整合Traefik,实时监控,数据库备份等

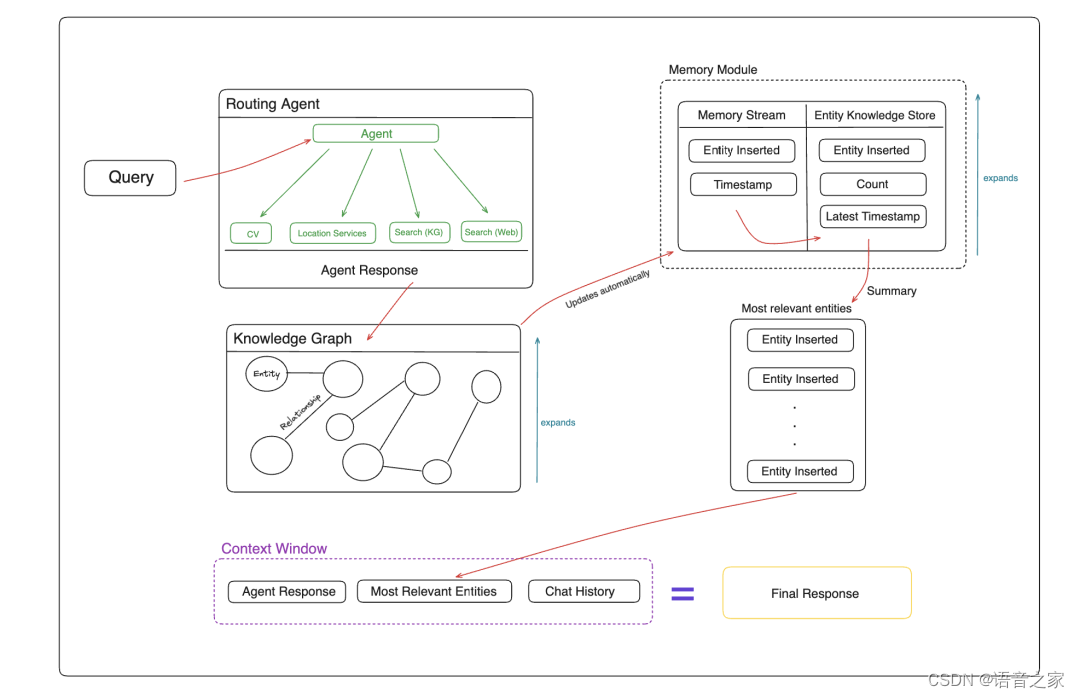

4. Memary开源:长记忆Agent开启大规模知识图谱存储新篇章

近日,GitHub上出现了一个名为Memary的新项目。该项目允许Agent在知识图谱中存储大量信息,通过我们的记忆模块推断用户知识,只检索与结果相关的信息。Memary的核心是其强大的知识图谱,这是一种可以存储和组织大量信息的数据结构。这种结构可以用来表示对象、概念、事件和它们之间的关系,使得信息检索变得更为便捷高效。它旨在通过对知识图谱的分析,理解用户的知识,并仅提供与用户当前需求相关的信息,避免信息冗余和混乱。这种智能化的信息管理方式,将有助于提高信息检索的效率和准确性,从而为用户提供更高质量的服务。

划重点

-

Memary是一个新的GitHub项目,允许在知识图谱中存储大量信息

-

Memary通过记忆模块推断用户知识,只检索相关信息

-

Memary的应用有助于提高信息检索的效率和准确性

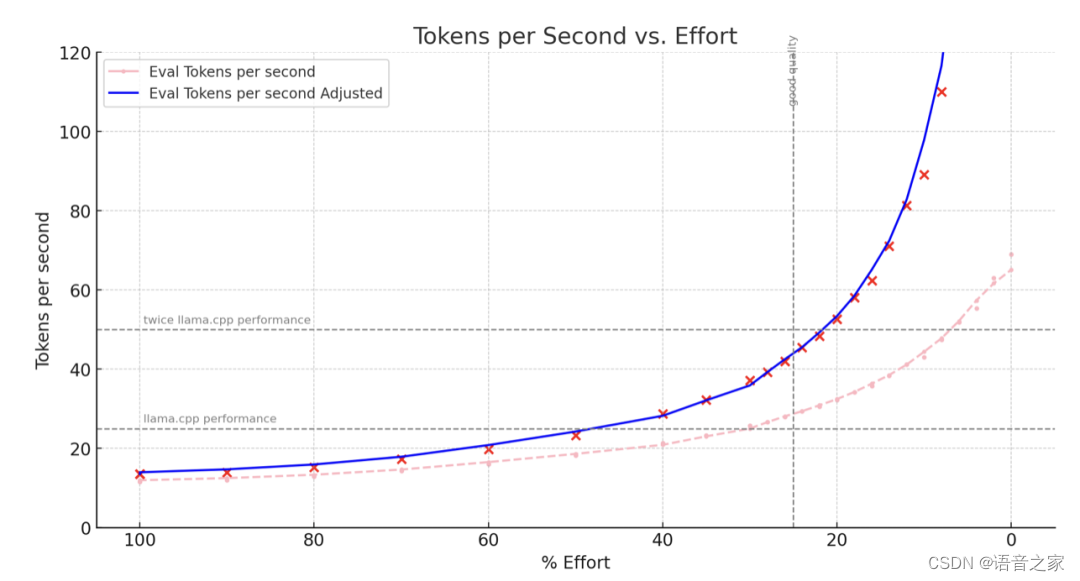

5. Effort引擎实现Apple硅芯片上LLM模型推断的实时调整

Effort引擎为Apple硅芯片上的LLM模型推断提供了实时调整的可能,从而在速度和质量之间找到了平衡。这种方法无需重新训练,但需要转换和预计算,可以通过加载更少的权重使模型运行得更快。开发者正在寻求Swift/Metal工程师的帮助,以优化这个实现,该实现已在GitHub上提供下载。

划重点

-

Effort引擎实现了在Apple硅芯片上进行LLM模型推断的实时调整,平衡了速度和质量的关系

-

该方法无需重新训练,但需要转换和预计算,能通过加载更少的权重使模型运行得更快

-

开发者正在寻求Swift/Metal工程师的帮助,以优化这个在GitHub上可下载的实现

6. 论文:以FP6-LLM新装包格式加速训练,实现全张量核心利用

浮点精度的降低能够提高训练速度,但可能会导致不稳定的现象。最新的研究论文展示,通过新的装包格式FP6-LLM,可以在不引发常见不稳定性或由于尝试不当引发的训练速度下降的情况下,实现全张量核心的利用。这一突破性的成果,将有望为深度学习和人工智能等领域的计算任务带来显著的效率提升。

划重点

-

FP6-LLM新装包格式能够实现全张量核心的利用

-

降低浮点精度可以加速训练

-

FP6-LLM新装包格式能够避免常见的不稳定性和训练速度下降

7. Moondream 2模型驱动的llamafile全功能VLM可执行文件

Moondream 2模型作为一种高效的AI模型,其性能强大且体积小巧,现已发布其全功能的VLM可执行文件,名为llamafile。这款全功能的VLM可执行文件是一种完全自包含的程序,可以在边缘设备上运行。这意味着,即使在没有网络连接的情况下,用户也可以利用这款产品在本地设备上进行高效的AI运算。Moondream 2模型的这一创新应用,使得AI技术的使用更加便捷和高效,为未来的AI边缘计算开辟了新的可能。

划重点

-

Moondream 2模型发布全功能的VLM可执行文件,名为llamafile

-

llamafile可在边缘设备上运行,进一步提高AI运算的便捷性和效率

-

Moondream 2模型的这一创新应用为AI边缘计算开辟了新的可能

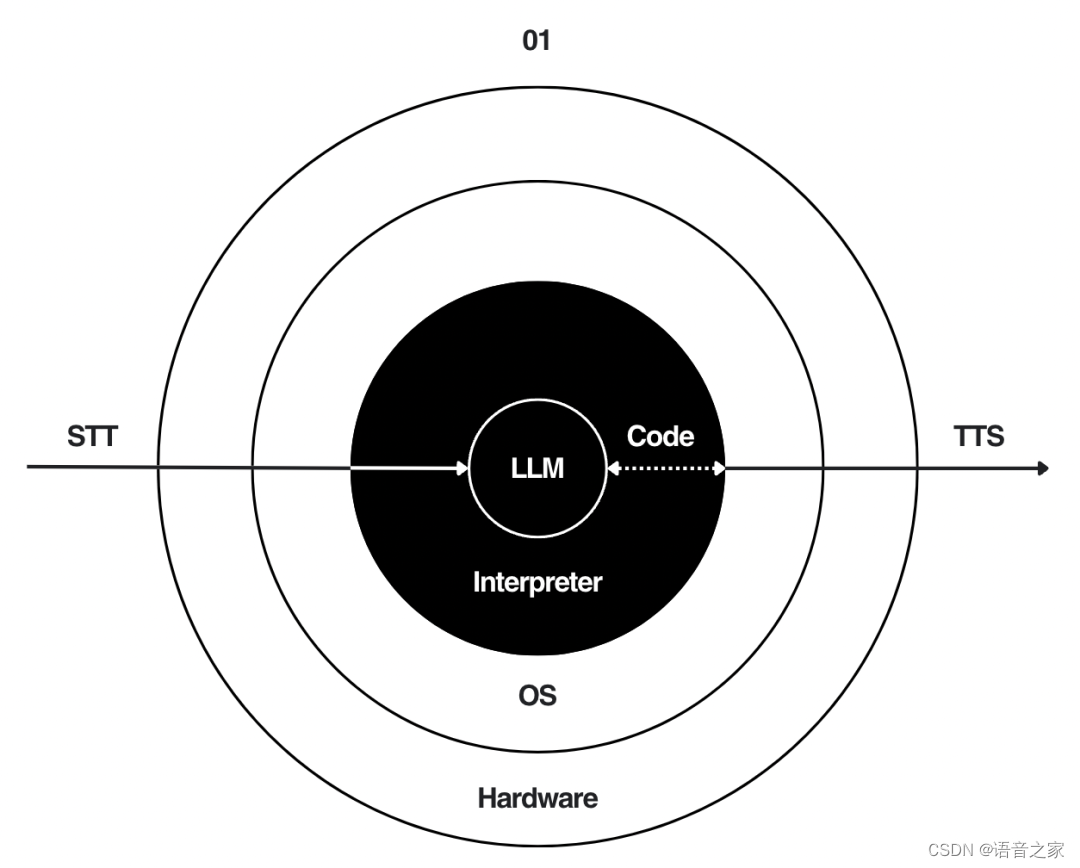

8. 探索建设AI设备的开源生态系统—01

近日,一项旨在为AI设备构建开源生态系统的尝试引起了大众的广泛关注。这个项目被命名为“01”,并已在GitHub Repo上公开。它的目标是通过提供一个开放的平台,使得全球的开发者和研究人员可以更好地进行AI设备的开发和研究。这个项目希望能够推动AI设备的发展,从而使得AI技术能更好地服务于社会。项目的开源性质将有助于推动技术的创新,通过全球开发者的共同努力,可以推动AI设备的技术进步。开放性、协作性和创新性是这个项目的核心理念。

划重点

-

“01”项目是一个旨在为AI设备构建开源生态系统的尝试

-

该项目已在GitHub Repo上公开,欢迎全球的开发者和研究人员参与其中

-

项目的开源性质将有助于推动AI设备的技术创新和进步