- 💂 个人网站:【 摸鱼游戏】【神级代码资源网站】【工具大全】

- 🤟 一站式轻松构建小程序、Web网站、移动应用:👉注册地址

- 🤟 基于Web端打造的:👉轻量化工具创作平台

- 💅 想寻找共同学习交流,摸鱼划水的小伙伴,请点击【全栈技术交流群】

Stable Diffusion 是近年来备受关注的一种AI绘画技术,它能够根据文本提示生成高质量的图像。本文将详细介绍Stable Diffusion 的工作原理、技术架构以及如何使用该技术从提示词生成图像,并附上示例代码,帮助你更好地理解和应用这项技术。

什么是 Stable Diffusion?

Stable Diffusion 是一种基于扩散模型(Diffusion Models)的图像生成技术。扩散模型通过逐步添加和去除噪声来训练神经网络,从而生成高质量的图像。这种方法在图像生成任务中表现出色,能够根据输入的文本提示生成符合描述的图像。

Stable Diffusion 的工作原理

Stable Diffusion 的核心原理是扩散过程,它包括两个主要阶段:

-

正向扩散过程:将训练数据中的图像逐步添加噪声,直到图像变成纯噪声。这一过程帮助模型学习如何在不同的噪声水平下还原图像。

-

逆向扩散过程:训练好的模型根据输入的噪声图像逐步去除噪声,最终生成高质量的图像。在生成过程中,模型会结合输入的文本提示,生成与提示相符的图像。

Stable Diffusion 的技术架构

Stable Diffusion 的技术架构主要由以下几个部分组成:

-

编码器(Encoder):将输入的文本提示编码成向量表示,作为生成图像的条件输入。

-

噪声预测网络(Noise Prediction Network):基于U-Net架构,预测并去除图像中的噪声。

-

调度器(Scheduler):控制扩散过程中的噪声添加和去除步骤,确保生成过程的稳定性和效果。

从提示词到模型出图的流程

以下是使用 Stable Diffusion 从提示词生成图像的完整流程:

1. 安装必要的依赖

首先,需要安装必要的Python库和 Stable Diffusion 模型的依赖项。可以使用以下命令:

pip install torch torchvision transformers diffusers

2. 加载模型和其他组件

接下来,加载预训练的 Stable Diffusion 模型和相关组件。以下是示例代码:

import torch

from transformers import CLIPTextModel, CLIPTokenizer

from diffusers import StableDiffusionPipeline# 加载CLIP文本编码器和分词器

tokenizer = CLIPTokenizer.from_pretrained("openai/clip-vit-base-patch32")

text_encoder = CLIPTextModel.from_pretrained("openai/clip-vit-base-patch32")# 加载Stable Diffusion模型

model_id = "CompVis/stable-diffusion-v1-4"

pipeline = StableDiffusionPipeline.from_pretrained(model_id, torch_dtype=torch.float16)

pipeline = pipeline.to("cuda")

3. 编码文本提示

使用CLIP文本编码器将输入的文本提示编码成向量表示:

prompt = "A futuristic cityscape at sunset"

inputs = tokenizer(prompt, return_tensors="pt")

text_embeddings = text_encoder(**inputs).last_hidden_state

4. 生成图像

使用 Stable Diffusion 模型生成图像:

# 生成图像

num_images_to_generate = 1

generated_images = pipeline(prompt, num_images_to_generate=num_images_to_generate, guidance_scale=7.5).images# 保存或显示生成的图像

generated_images[0].save("generated_image.png")

5. 完整示例代码

以下是完整的示例代码,展示了如何使用 Stable Diffusion 从提示词生成图像:

import torch

from transformers import CLIPTextModel, CLIPTokenizer

from diffusers import StableDiffusionPipeline

from PIL import Image# 加载CLIP文本编码器和分词器

tokenizer = CLIPTokenizer.from_pretrained("openai/clip-vit-base-patch32")

text_encoder = CLIPTextModel.from_pretrained("openai/clip-vit-base-patch32")# 加载Stable Diffusion模型

model_id = "CompVis/stable-diffusion-v1-4"

pipeline = StableDiffusionPipeline.from_pretrained(model_id, torch_dtype=torch.float16)

pipeline = pipeline.to("cuda")# 编码文本提示

prompt = "A futuristic cityscape at sunset"

inputs = tokenizer(prompt, return_tensors="pt")

text_embeddings = text_encoder(**inputs).last_hidden_state# 生成图像

num_images_to_generate = 1

generated_images = pipeline(prompt, num_images_to_generate=num_images_to_generate, guidance_scale=7.5).images# 保存或显示生成的图像

generated_images[0].save("generated_image.png")# 显示生成的图像

Image.open("generated_image.png").show()

未来展望

Stable Diffusion 作为一种先进的AI绘画技术,展现了巨大的潜力和广泛的应用前景。随着模型的不断优化和扩展,未来将能够生成更高质量、更符合用户需求的图像。无论是艺术创作、广告设计,还是游戏开发,Stable Diffusion 都将成为重要的技术工具。

通过本文的介绍,相信你已经对 Stable Diffusion 的工作原理和实际应用有了全面的了解。希望这些示例代码能够帮助你在实际项目中更好地应用这项技术,创造出更多精彩的图像作品。

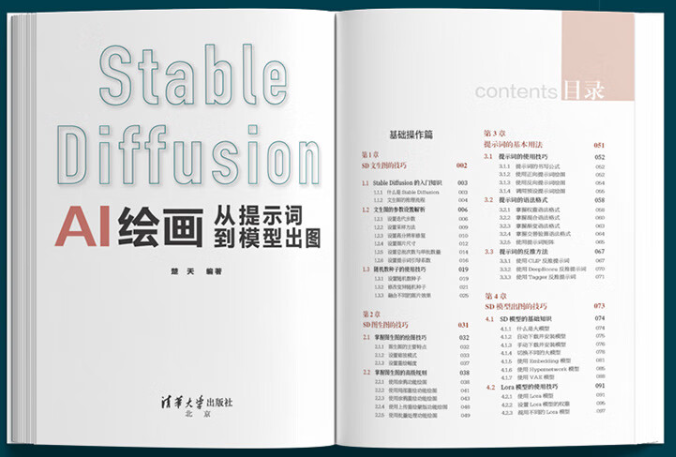

⭐️ 好书推荐

《Stable Diffusion AI绘画从提示词到模型出图》

【内容简介】

本书从ChatGPT的基础知识讲起,针对运营工作中的各种痛点,结合实战案例,如文案写作、图片制作、社交媒体运营、爆款视频文案、私域推广、广告策划、电商平台高效运营等,手把手教你使用ChatGPT进行智能化工作。此外,还介绍了通过ChatGPT配合Midjourney、D-ID等AI软件的使用,进一步帮助提高运营工作的效率。

📚 京东购买链接:《Stable Diffusion AI绘画从提示词到模型出图》