目录

## 时钟

## 带边缘触发的寄存器

## 优化内存走线

## 画16位的内存

## 时钟

波特率:一分钟说几个字

clock统一计算机内部的节奏,clock频率越高cpu速度越快

触发:电压的突变;下降沿:高变低;上升沿:低变高

注意不同外设的时钟数不同,在编写芯片的时候需要注意这一点,分配clock

上升沿生效(边缘触发)的锁存器:

下降沿生效(边缘触发)的锁存器:

## 带边缘触发的寄存器

## 优化内存走线

计算机优化的条件

1、时间换空间:串行输出,一个个输出

2、空间换时间:并行输出,并口屏

3、时间换时间:调度算法

4、空间换空间:不用的空间回收回来

## 画16位的内存

1、设计内存单元格

2、内存单元格有row和col --> 内存地址

3、ld(load)读的控制

4、str(store)存的控制

5、数据的输入 --> Din

最小内存单元:

第一个与门:负责选中地址的行和列

第二个与门:在确保地址选对的情况下,点下开关

第三个锁存器:在确保地址选对的情况下,点击开关开启WE,并入Din开始写入数据

第四个与门:确定某一行某一列输出控制

第五接入驱动器:

数据存入:

数据输出:

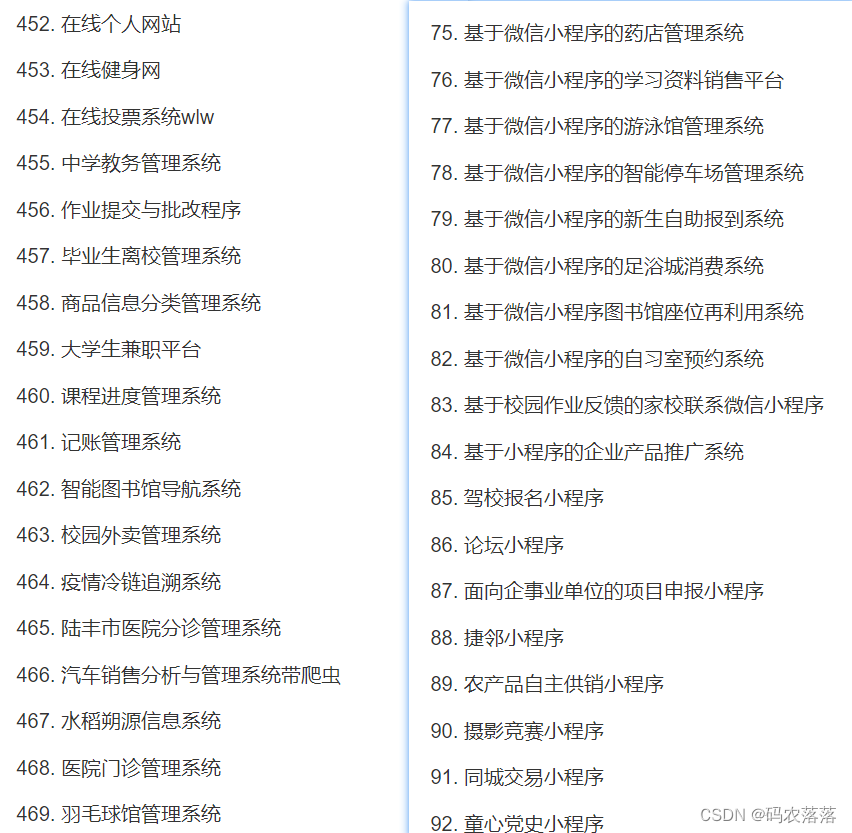

画16位内存单元:

时间换空间做法:

## 解码器

可指定数据位和输出位:将数据位映射到各个端口上

加入解码器后实现的16位内存单元

## EEPROM抽象图