目录

池化层

二维最大池化层 Max Pooling

池化层超参数

平均池化层 Mean Pooling

总结

代码实现

池化层

卷积对位置非常敏感的,但是我们在实际应用中我们需要一定程度的平移不变性。比如照明、物体位置、比例、外观等因素会导致图片发生变化。所以卷积对未知太过于敏感不是一个很好的事情。

其次池化层可以减少数据量

二维最大池化层 Max Pooling

每个窗口中最强的模式信号

可以看出,2 x 2最大池化允许输入由1像素位移(也就是在它窗口里面,允许半个窗口的偏移)。

池化层超参数

- 和卷积层类似,都具有填充和步幅

- 没有可学习的参数(与卷积不一样!!)

- 每个输入通道应用池化层以获得相应的输出通道(不会融合多个通道!!与卷积不同)

因为多通道融合我可以交给卷积来做,池化层可以不这样做

- 输出通道数 = 输入通道数

平均池化层 Mean Pooling

将最大池化层中的“最大”操作替换为“平均”

相较于最大池化层,平均池化从会有一个更柔和的结果呈现

总结

- 池化层返回窗口最大or平均值

- 主要作用:缓解卷积层对位置的敏感性

- 通常池化层会作为卷积层之后的操作

- 同样有窗口大小、填充、步幅作为超参数

- 对通道分别输出,不进行融合,也就是输入通道数 = 输出通道数

- 没有可以学习的参数

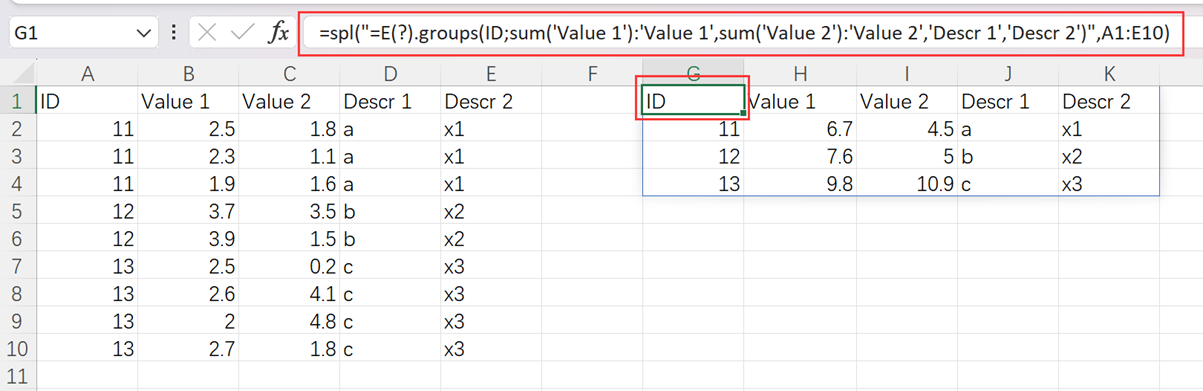

代码实现

实现池化层的正向传播

import torch

from torch import nn

from d2l import torch as d2ldef pool2d(X, pool_size, mode = 'max'):p_h, p_w = pool_sizeY = torch.zeros((X.shape[0] - p_h + 1, X.shape[1] - p_w + 1)) # 套公式算出输出大小for i in range(Y.shape[0]): # 按行迭代for j in range(Y.shape[1]): # 按列迭代if mode == 'max':Y[i, j] = X[i: i + p_h, j: j + p_w].max()elif mode == 'avg':Y[i, j] = X[i: i + p_h, j: j + p_w].mean()return Y验证二维最大池化层的输出

X = torch.tensor([[0.0, 1.0, 2.0], [3.0, 4.0, 5.0], [6.0, 7.0, 8.0]])

pool2d(X, (2, 2))# 输出

tensor([4., 5.],[7., 8.])验证平均池化层

pool2d(X, (2, 2), 'avg')# 输出

tensor([[2., 3.],[5., 6.]])填充和步幅

X = torch.arange(16, dtype = torch.float32).reshape((1, 1, 4, 4))

X# 输出

tensor([[[[0., 1., 2., 3.],[4., 5., 6., 7.],[8., 9., 10., 11.],[12., 13., 14., 15.]]]])深度学习框架中的步幅与池化窗口的大小相同,所以4 x 4的矩阵只能容纳一个窗口,结果为一个标量

pool2d = nn.MaxPool2d(3) # 一个3 x 3的窗口

pool2d(X)# 输出

tensor([[[[10.]]]])填充和步幅可以手动设定

pool2d = nn.ManPool2d(3, padding = 1, stride = 2)

pool2d(X)# 输出

tensor([[[[5., 7.],[13., 15.]]]])设定一个任意大小的矩形池化窗口,并分别设定填充和步幅的高度和宽度

pool2d = nn.MaxPool2d((2, 3), padding = (1, 1), stride = (2, 3))

pool2d(X)# 输出

tensor([[[[1., 3.],[9., 11.],[13., 15.]]]])池化层在每个输入通道上单独计算

X = np.concatenate((X, X + 1), 1)

X# 输出

tensor([[[[ 0., 1., 2., 3.],[ 4., 5., 6., 7.],[ 8., 9., 10., 11.],[12., 13., 14., 15.]],[[ 1., 2., 3., 4.],[ 5., 6., 7., 8.],[ 9., 10., 11., 12.],[13., 14., 15., 16.]]]])pool2d = nn.MaxPool2D(3, padding=1, strides=2)

pool2d(X)# 输出

array([[[[ 5., 7.],[13., 15.]],[[ 6., 8.],[14., 16.]]]])