大家好,我是木易,一个持续关注AI领域的互联网技术产品经理,国内Top2本科,美国Top10 CS研究生,MBA。我坚信AI是普通人变强的“外挂”,专注于分享AI全维度知识,包括但不限于AI科普,AI工具测评,AI效率提升,AI行业洞察。关注我,AI之路不迷路,2024我们一起变强。

LLM,全称Large Language Model,意为大型语言模型,是一种基于深度学习的AI技术,能够生成、理解和处理自然语言文本,也因此成为当前大多数AI工具的核心引擎。我在《大语言模型(LLM)工作的3个步骤,一文带你搞清楚!》一文中详细介绍过LLM的工作原理,LLM通过学习海量的文本数据,掌握了词汇、语法、语义等方面的知识,从而可以用于各种语言任务,如文本生成、翻译、摘要、问答等。这些模型通常具有数十亿、千亿甚至万亿(据传早期的GPT-4参数量为1.76万亿)的参数,能够捕捉到语言中的复杂关系,生成近似于人类语言的输出。

LLM的工作原理基于神经网络架构,尤其是基于Transformer架构的模型最为常见。这些模型通过概率计算来预测下一个词或句子的可能性,从而生成连贯的文本。训练过程中,模型会从大量的文本数据中学习语言模式,并通过不断调整模型参数,使其能够在给定输入下生成最可能的输出。而正由于其生成文本的概率性特点,模型有时会输出不准确或不适当的内容,甚至会产生所谓的“幻觉(Hallucination)”——生成虚假或不真实的信息,即一本正经的胡说八道。

那么,能否完全避免AI幻觉,让LLM输出完全可靠的结果呢?从本质上来说,没有任何一种方法能消除AI幻觉,这是由LLM的工作原理所决定的。虽然AI幻觉无法被彻底解决,但我们却能够采取一系列的方法尽可能地减少AI幻觉出现的概率,从而提高LLM的输出质量,这也正是今天文章的主题。

1. 提示工程(Prompt Engineering)

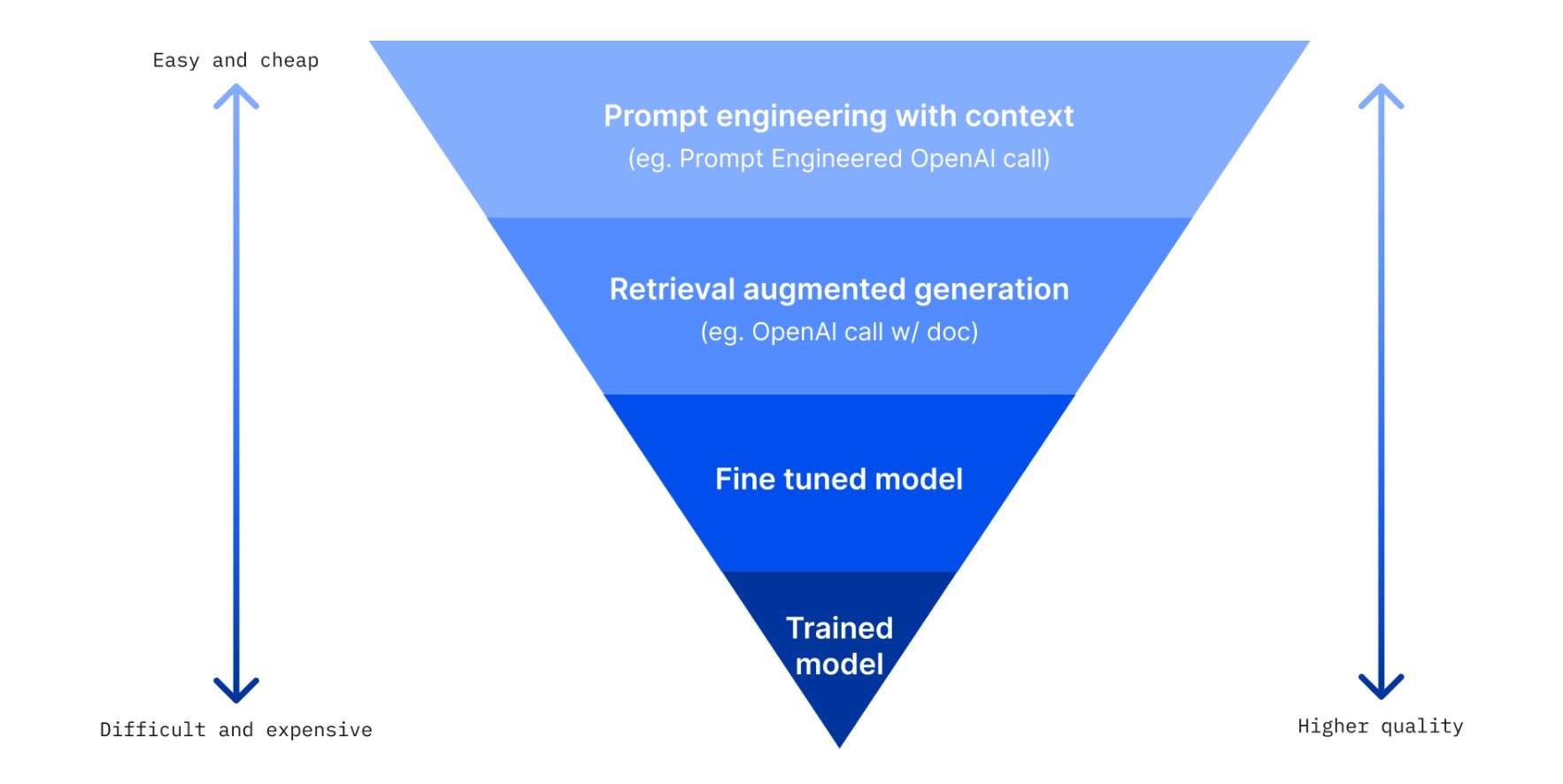

提示工程(Prompt Engineering)是指通过设计和优化输入给LLM的提示语句,以最大限度地提高模型生成输出的质量。这一技术是改善LLM输出的最便捷和经济有效的方法,特别是在不需要对模型进行复杂微调或训练的情况下。提示工程的核心是通过提供适当的上下文、示例和明确的指示,来引导LLM生成更加准确、相关和有用的结果。

提示工程的重要性在于它不仅能帮助企业和个人快速部署AI应用,还能在有限的资源和时间内获得较好的模型输出质量。通过优化提示,用户可以克服LLM的某些局限性,如文本生成中的不确定性和可能出现的“幻觉”。

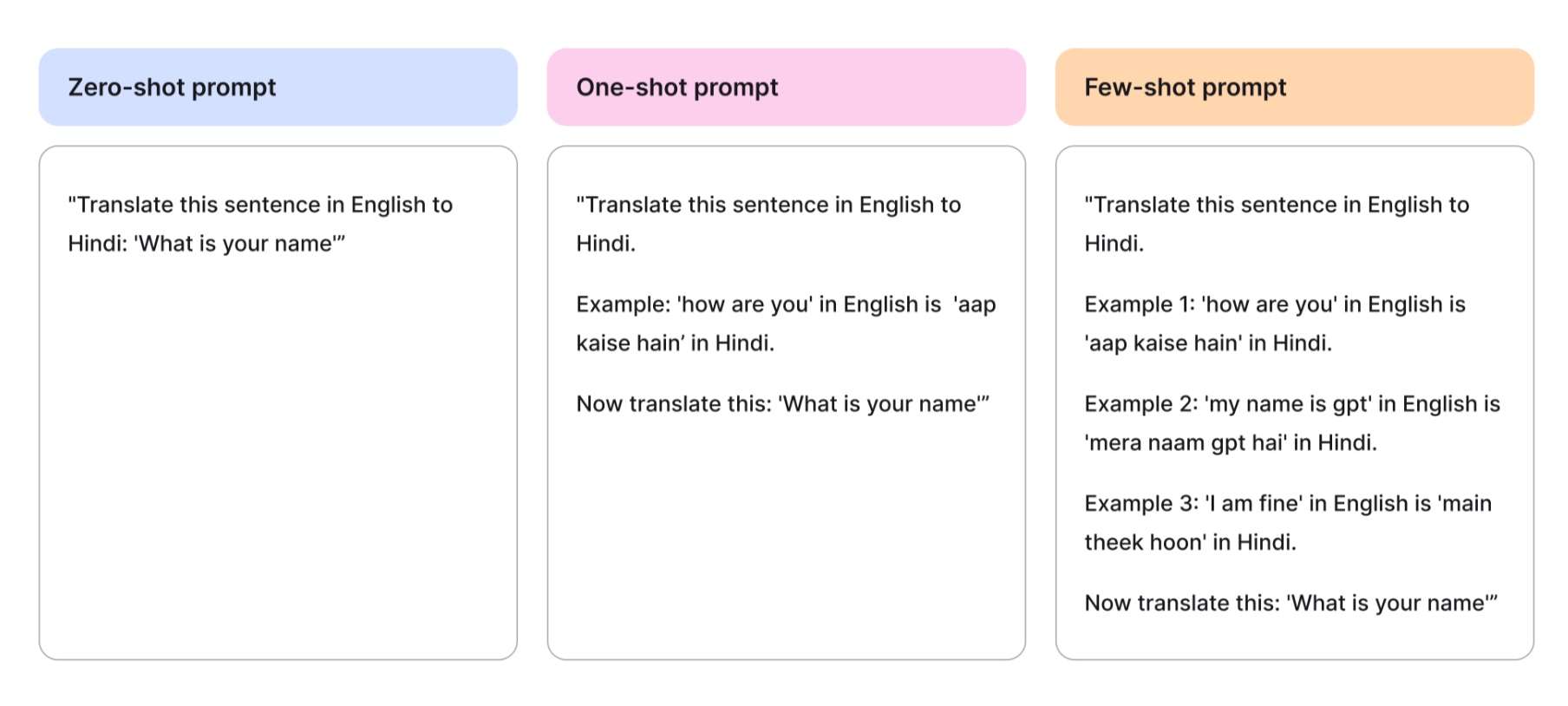

提示工程的技巧示例

-

零样本提示(Zero-Shot P