CUDA(Compute Unified Device Architecture)和OpenCL(Open Computing Language)都是用于在GPU上进行通用计算(GPGPU)的并行计算平台和编程模型。

尽管它们的目标相似,但在设计理念、编程模型、平台支持、性能优化和生态系统等方面存在一些关键区别。

1. 所有权和开发

- CUDA:由NVIDIA公司开发,专为其自家的GPU设计。这意味着CUDA程序只能在NVIDIA的GPU上运行。

- OpenCL:由Khronos Group维护,是一个开放标准,支持多种硬件平台,包括NVIDIA、AMD、Intel的GPU,以及多核CPU和FPGA等。

2. 编程模型

- CUDA:提供了一种相对简单且直观的编程模型,开发者可以使用熟悉的C/C++语言进行编程。CUDA的编程模型基于主机(CPU)和设备(GPU)的概念,代码分为主机代码和设备代码。

- OpenCL:采用了一种更加通用的编程模型,代码分为主机代码和设备代码。OpenCL使用C99语言作为基础,并引入了特定的API和内核语言来编写设备代码。

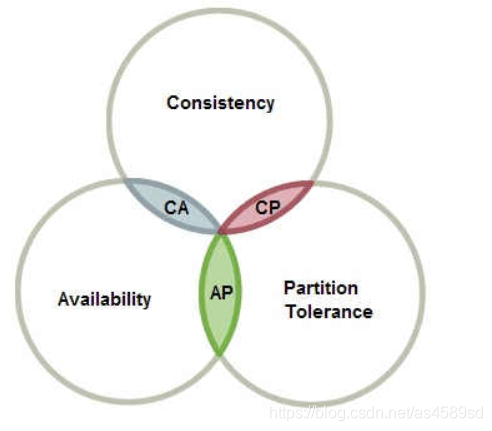

3. 平台支持

- CUDA:仅支持NVIDIA的GPU,限制了其应用范围。

- OpenCL:支持多种硬件平台,包括不同厂商的GPU、CPU和加速器等,具有更广泛的适用性。

4. 性能优化

- CUDA:由于是NVIDIA专有的,CUDA可以利用NVIDIA GPU的特定硬件特性进行深度优化,通常在NVIDIA硬件上提供更高的性能。

- OpenCL:由于需要支持多种硬件平台,OpenCL的性能优化可能不如CUDA深入,但提供了跨平台的性能一致性。

5. 生态系统

- CUDA:拥有一个成熟的生态系统,包括丰富的库(如cuBLAS、cuDNN)、工具(如Nsight)、文档和社区支持。

- OpenCL:生态系统相对分散,不同厂商提供各自的OpenCL实现和工具,文档和支持可能不如CUDA全面。

6. 学习曲线

- CUDA:对于熟悉C/C++的开发者来说,学习曲线相对平缓。

- OpenCL:由于其更通用的编程模型和API,学习曲线可能更陡峭。

7. 适用场景

- CUDA:适用于主要使用NVIDIA GPU进行高性能计算的应用,如深度学习、科学计算、图像处理等。

- OpenCL:适用于需要跨平台兼容性的应用,如在多种硬件上运行的通用计算任务。

结论

CUDA和OpenCL各有优缺点,选择哪一个取决于具体的应用需求、硬件环境和开发者的偏好。

如果应用主要在NVIDIA硬件上运行,并且追求最高性能,CUDA可能是更好的选择。

如果需要跨平台兼容性,或者在多种硬件上运行,OpenCL则更为合适。

随着硬件和软件技术的发展,两者在功能和性能上的差距可能会逐渐缩小。

联络方式:https://t.me/XMOhost26