在爬虫开发中,性能优化是确保爬虫稳定、高效运行的关键。以下是一些常见的性能优化策略,结合了搜索结果中的信息:

异步编程: 使用 asyncio 和 aiohttp 实现高并发,提高爬取效率。异步请求允许在等待一个请求完成的同时,继续执行其他任务,从而提高整体的爬取速度。

import aiohttp;

import asyncio;async def fetch(session, url) {async with session.get(url) as response:return await response.text();

}async def main() {urls = ["https://example.com/page1", "https://example.com/page2"];async with aiohttp.ClientSession() as session:tasks = [fetch(session, url) for url in urls];results = await asyncio.gather(*tasks);for result in results:print(result);

}asyncio.run(main());使用多线程或多进程: 使用 ThreadPoolExecutor 或 multiprocessing 并行化任务,可以充分利用多核CPU的优势。

from concurrent.futures import ThreadPoolExecutor;def crawl(url) {response = requests.get(url);print(response.status_code);

}urls = ["https://example.com/page1", "https://example.com/page2"];

with ThreadPoolExecutor(max_workers=5) as executor:executor.map(crawl, urls);缓存数据: 避免重复爬取相同内容,通过缓存减少请求次数。使用 requests_cache 库可以方便地实现缓存功能。

import requests_cache;requests_cache.install_cache("cache", expire_after=3600);

response = requests.get("https://example.com");-

调整代码结构: 使用模块化设计,提高代码的可读性和可维护性,从而间接提升开发效率和程序性能。

-

限流机制: 使用

RateLimiter限制每秒请求次数,防止触发反爬机制。合理设置请求间隔和重试机制,避免因请求过于频繁而导致IP被封。from ratelimit import limits;@limits(calls=10, period=60) def fetch_data():response = requests.get("https://example.com");return response; -

减少HTTP请求次数: 通过缓存、批量请求等方式减少HTTP请求次数,降低网络开销。

-

合理设置请求间隔和重试机制: 使用

time.sleep()或带有间隔参数的工具库进行设置,对于出现错误的请求,可以设置重试机制。import requests; import time; from requests.adapters import HTTPAdapter; from requests.packages.urllib3.util.retry import Retry;retry_strategy = Retry(total=3,backoff_factor=1,status_forcelist=[429, 500, 502, 503, 504] ); adapter = HTTPAdapter(max_retries=retry_strategy); session = requests.Session(); session.mount("https://", adapter);urls = ["https://example.com/page1", "https://example.com/page2"]; for url in urls:response = session.get(url);print("抓取 {} 状态码:{}".format(url, response.status_code));time.sleep(1); // 设置 1 秒的间隔 -

优化数据解析与存储: 使用高效的解析库(如

lxml解析 HTML)和批量写入数据库以提高性能。 -

使用代理IP: 使用代理IP可以绕过网站对同一IP地址的访问频率限制,提高爬虫的可持续性和稳定性。

-

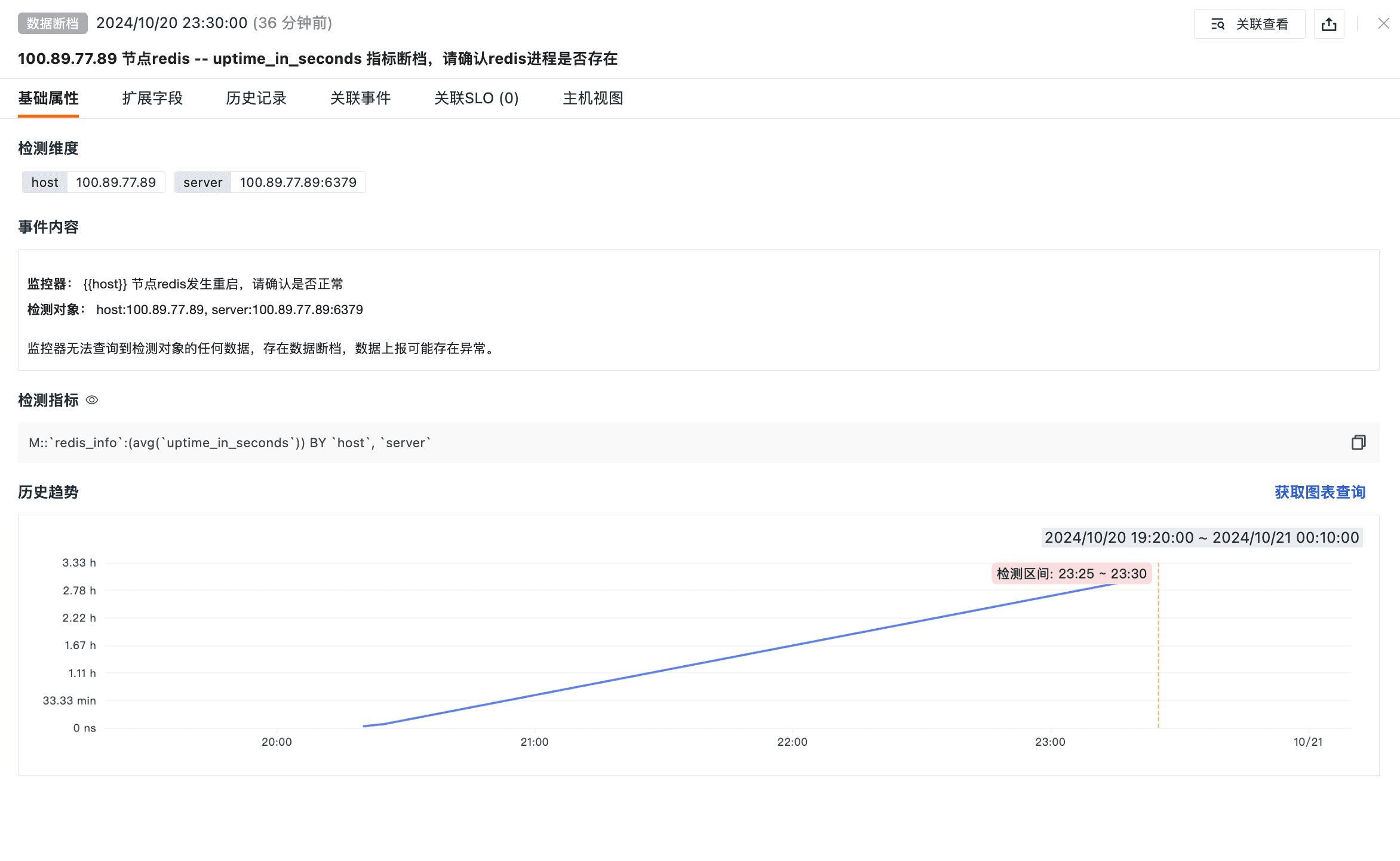

增量爬取和断点续传: 实现增量爬取和断点续传,可以节省时间和资源,并避免重复劳动。