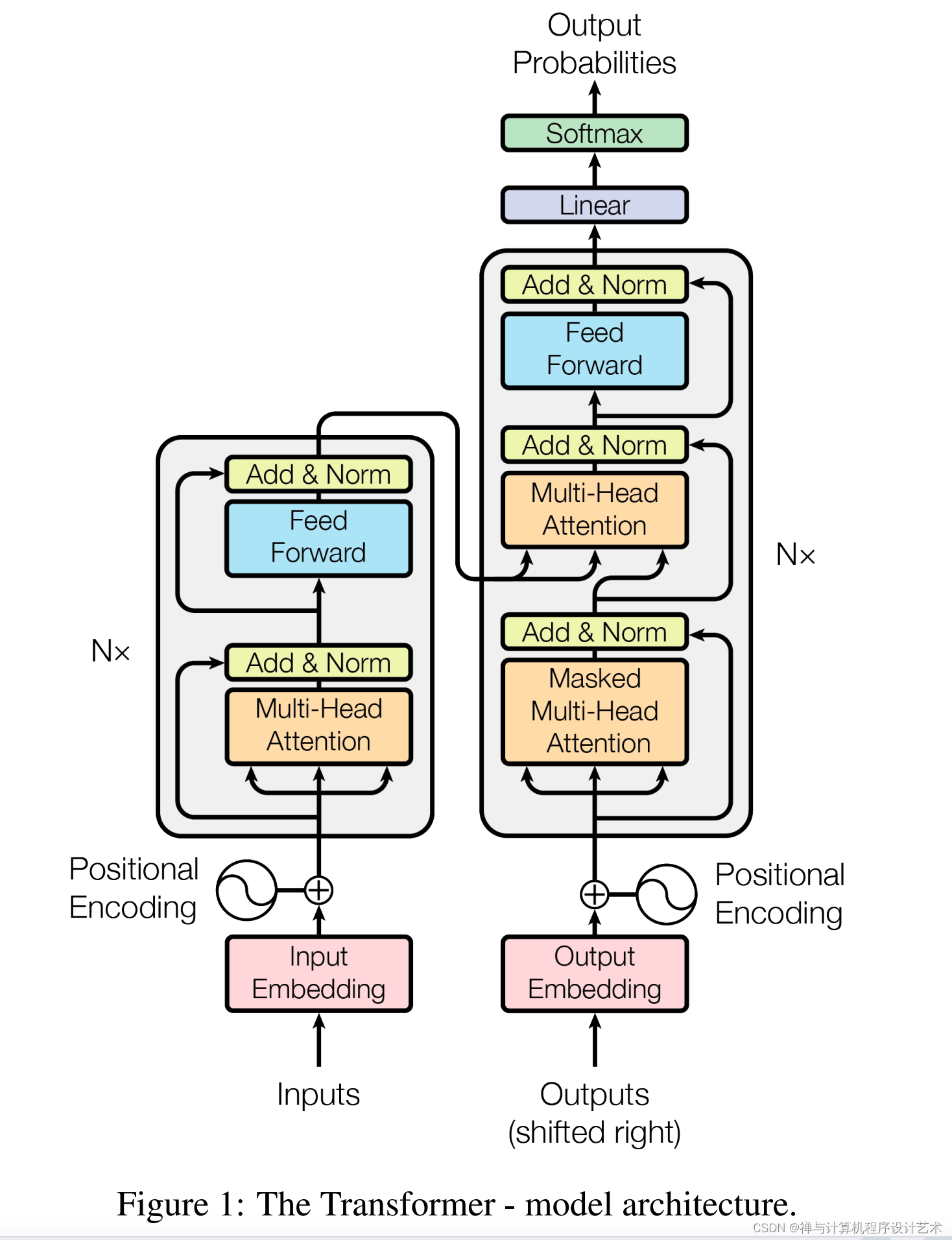

【ChatGPT】GPT 原理解析:Transformer 模型的核心思想:注意力机制(Attention Mechanism)的核心原理是什么?并给出数学公式代码实例。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.rhkb.cn/news/50654.html

如若内容造成侵权/违法违规/事实不符,请联系长河编程网进行投诉反馈email:809451989@qq.com,一经查实,立即删除!相关文章

chatgpt赋能python:Python图中打字的SEO文章:让你的图片说出更多的话

Python图中打字的SEO文章:让你的图片说出更多的话

图片是传达信息的有力工具。不过,当你在网站上发布图片的时候,这张图片就很可能会被浏览器、机器学习算法、甚至是一些视觉障碍用户忽略。为了弥补这个缺陷,我们可以使用Python来…

React流式打字效果实现(不需要CSS) - Typing Effect with out use Css

前言

最近有个云栖大会的demo展示需求,要实现个类似的打字效果,所以我找了找相关的库。找到一个还不错的~叫iTyped.js。但是最终的效果和我想要的不太一样,会有回删效果,看了下源码,所以就自己写了一个~

再夸奖下 iT…

模仿Chart GPT输出的打字效果

demo代码:

<!DOCTYPE html>

<html><head><meta charset"utf-8"><title>打字机</title><style>.text {font-size: 40px;}.content {text-align: center;font-size: 0;}.blink {font-size: 40px;animation: tia…

chatgpt赋能python:Python怎么入侵手机

Python怎么入侵手机

现在移动设备已经成为人们生活中必不可少的一部分,因此,攻击者越来越多地将目光转向移动设备。 进入移动设备的主要方式之一是通过应用程序漏洞进行攻击。而Python编程语言的出现可以让攻击者更容易地发掘和利用这些漏洞,…

中国外汇交易中心员工英语培训四次合作TutorABC

成人在线英语教育品牌TutorABC的企业英语培训方案已经受到各大企业及协会的认可,这是众所周知的事情。就在双十一前夕,TutorABC与中国外汇交易中心达成年度语言培训合作,这已经是双方连续第四年在企业英语培训领域展开合作,TutorA…

报Python培训班多少钱?报个班值得吗?

报Python培训班多少钱?报个班值得吗?报培训机构学习Python学费一般是要1~2万元之间,每个培训机构收费标准都是不一样,要根据不同的班型、学习时长等因素来收费,而且Python的学费也会受到所在城市的消费水平影响。学习时…

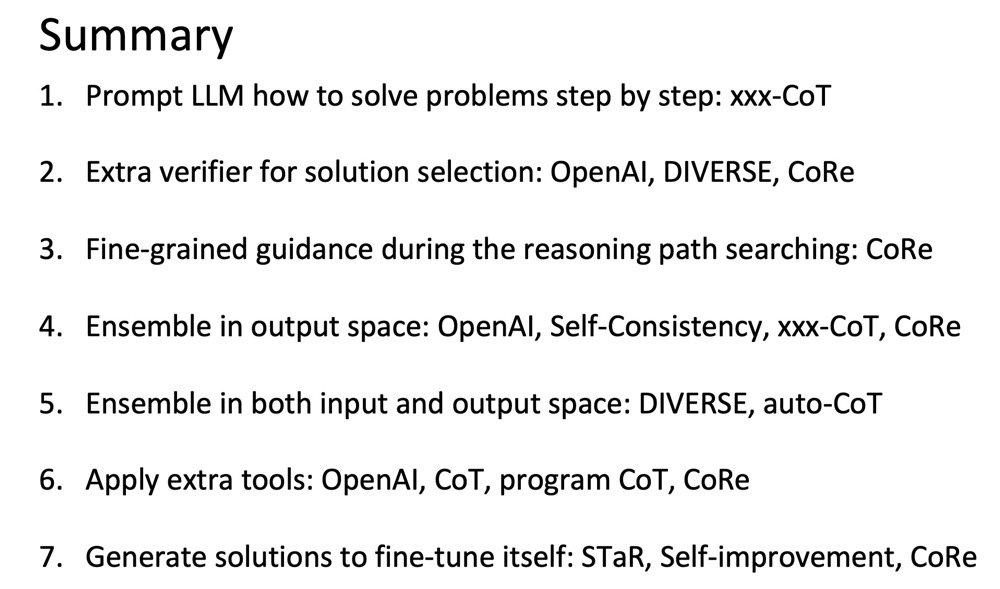

Language Model Reasoning

来自:天宏NLP 作者:tianhongzxy 自从那篇著名的《Chain of Thought Prompting Elicits Reasoning in Large Language Models》发布以来,一下子引爆了使用 Large Language Models (LLMs) 做推理任务的热潮。同时,越来越多的研究者开…

Science前沿:大语言模型涌现演化信息,加速蛋白质结构预测

导语 从蛋白质序列直接预测三维结构,AlphaFold 此前取得了突破性进展。而蛋白质与人类的语言有天然的相似性,蛋白质的氨基酸序列就像是语言的字母,语言模型有可能在整个演化过程中学习蛋白质序列的模式,是否可以用大语言模型预测蛋…

中国数字经济产业发展大会在苏州相城成功举办

中国数字经济产业发展大会(CCDE2023)于3月25日在苏州成功举办。本次大会分论坛涵盖了“大数据产业、算力发展、数字金融产业、智能网联汽车产业、数字孪生技术、数字化转型、青年创新创业”等多个方向。CCDE2023汇聚数字经济产业的专业力量,为…

清华叉院杨植麟新公司曝光:专搞大模型,组明星团队,拿了红杉真格天使投资...

衡宇 发自 凹非寺量子位 | 公众号 QbitAI 又一家AI初创大模型公司,刚刚浮出水面。 名为月之暗面,主要业务剑指AGI。 成立后已迅速完成首轮市场融资,获红杉、真格等一线VC的押注,市场估值被曝约在3亿美元。 公司拥有明星团队&#…

要么打工,要么单干,但千万别跟“陌生人”一起创业

这是头哥侃码的第285篇原创 前些天看到孟岩老师发的一篇文章《且慢,重新说再见》,里面内容主要就是讲了孟岩老师从前公司被迫离职后,我对此非常感触。在创业的过程中,选择一个合适的合伙人是多么重要。 熟悉我的小伙伴可能都知道&…

3分钟测试:你是否适合这份月薪20K的软件测试工作?

如果大家在学习中遇到困难,想找一个软件测试学习交流环境,可以加入我们的测试圈:786229024。 测试面试话题1:敏捷开发与测试

以下是我个人总结的一些经验:

传统开发模式:V模式,瀑布…

我与计算机的不解之缘

虽然在计算机方面多有涉猎,但是我纯属是业余的,我学的热能专业和计算机关联也不大。也可能是小小的缘分吧,在计算机应用领域摸爬滚打了一年多,这个过程概括来说就是:痛并快乐着。为什么会痛呢?因为软件需要…

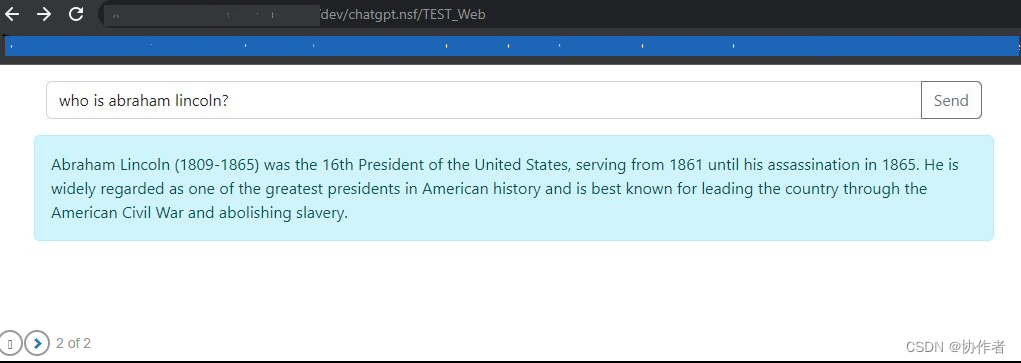

ChatGPT APIs for HCL DOMINO

大家好,才是真的好。

近期网络上最热闹的话题就是OpenAI的ChatGPT,从去年11月份到现在,一波又一波热潮蜂拥而至,以至于让我们Domino人应接不暇。

ChatGPT和Domino的缘分还真不是完全没有,毕竟刚出来时,很…

计算机应用英语app,学英语必备的9款APP,学生党都在用

原标题:学英语必备的9款APP,学生党都在用 外语学习必备的九个app超级实用! 不背单词(单词本) 界面设计的十分简洁,深邃模式的壁纸特别好看!听写模式也很人性化!可以把刚才学过的单词重复读出来然后自己在纸…

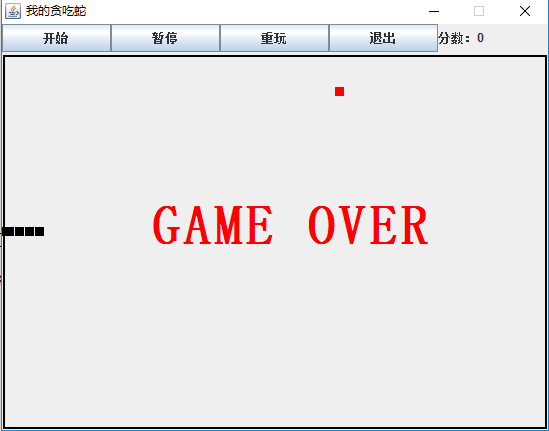

贪吃蛇java源代码

这个贪吃蛇是我学完Java之后的课程设计作业,做了有挺久的,做完这个小游戏,自己对Java的一些知识也更了解了些。其中包括按完按钮后焦点的处理啊,还有就是图形的闪烁问题。我当时做的时候基本是在自己电脑上完成的,后来…

推荐文章

- 案例——蚂蚁金服初探,唯一的金融互联网生态...

- 翻页 上一页/下一页

- #内部类#

- (09)Hive——CTE 公共表达式

- (10)(10.8) 固件下载

- (11)香橙派+apache2与php+天猫精灵=自建平台语音支持--天猫精灵对接6

- (2022级)成都工业学院数据库原理及应用实验三:数据定义语言DDL

- (C++进阶)使用Eigen库进行多项式曲线拟合

- (done) 有服务器的权限时,如何查看服务器监听的端口?

- (undone) 阅读 MapReduce 论文笔记

- (第11天)【leetcode题解】344、反转字符串 541、反转字符串II #替换数字

- (二)什么是Vite——Vite 和 Webpack 区别(冷启动)