人工智能安全问题与研究

在自动驾驶、客服机器人等人工智能应用中发生了一系列安全事件,并引发了人们对人工智能应用前景的担忧,去年爆火的Chatgpt也有在人的引诱下发生了“自己出逃的想法”,这种种现象都显现出需要对人工智能安全的问题研究的必要性

从学科发展的角度看,人工智能和网络空间安全存在密切的联系,人工智能安全则是这两个学科方向发展交叉的必然结果。 人工智能理论和技术有效地提升了网络空间安全攻击与防御的智能化水平; 人工智能模型与算法越来越多地被发现存在漏洞和安全风险,由此导致人工智能应用成为网络空间安全的新问题

人工智能安全是人工智能与网络空间安全的交叉学科。两个学科各自已经建立了深厚的理论和技术体系,而进一步看清这两个学科的交叉点及交叉的逻辑联系,则是理解和学习人工智能安全的关键

人工智能的概念自1956年被提出来以后,随计算技术发展而得到了发展。人工智能理论与技术所涉及的范畴不断扩大。 在基础理论方面,主要包括知识表示、搜索、推理、智能计算、机器学习理论、表示学习、智能规划、神经网络等。 在应用领域方面,主要包括领域知识发现与数据挖掘、专家系统、自然语言处理、图像处理、智能语音、生物识别、计算机视觉、智能机器人等。

不同学派对人工智能研究有不同的主张,从而形成了各自的主义,他们从不同的角度来思考、研究人工智能理论和方法。影响比较大的流派及其奉行的主义,

主要: 符号学派(符号主义)

仿生学派或生理学派(连接主义)

控制论学派(行为主义,或进化主义)

各个学派提出了大量人工智能理论和方法,但不管哪个学派几乎都没有关注到人工智能安全。 直到最近几年来,在大数据的驱动下,建立各种智能模型。人工智能安全问题逐步得到人们的关注,这是由于大数据处理及人工智能本身的技术架构所决定的

大数据驱动的人工智能

人工智能模型要求数据不断更新,而大数据的更新管理难度也使得数据对人工智能应用的安全风险大大提升。典型的数据安全问题有:数据过度采集、数据偏见歧视、数据资源滥用、数据伪造、威胁公平正义、隐私泄露和大数据杀熟等

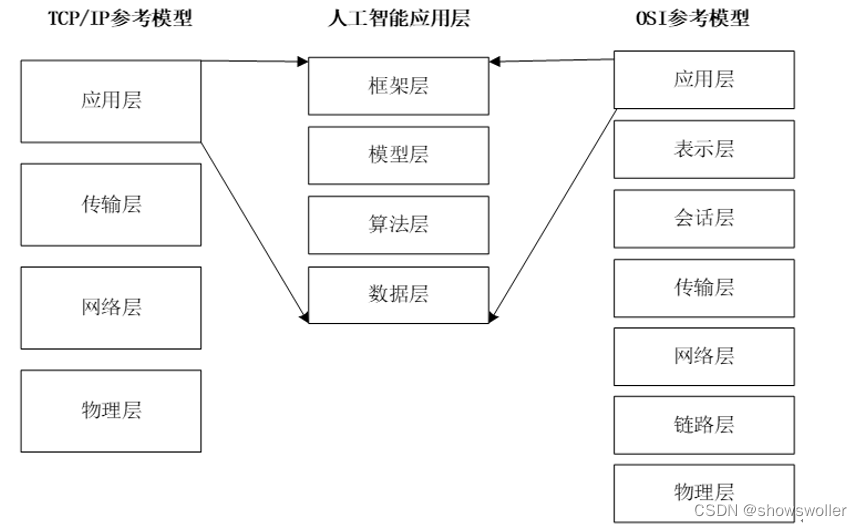

人工智能安全的层次结构

熟悉计算机网络的同学对下图中的两个模型相比十分熟悉,这也是人工智能安全与网络安全密切的原因之一

人工智能安全的脆弱性

信息技术都存在脆弱性或安全漏洞,这是产生安全问题的根本所在。人工智能技术也不例外,人工智能安全问题的产生也在于本身所存在的漏洞

数据分布假设的脆弱性

模型更新机制中的脆弱性

数据处理过程中的开放性

计算平台的漏洞

人工智能决策中的漏洞

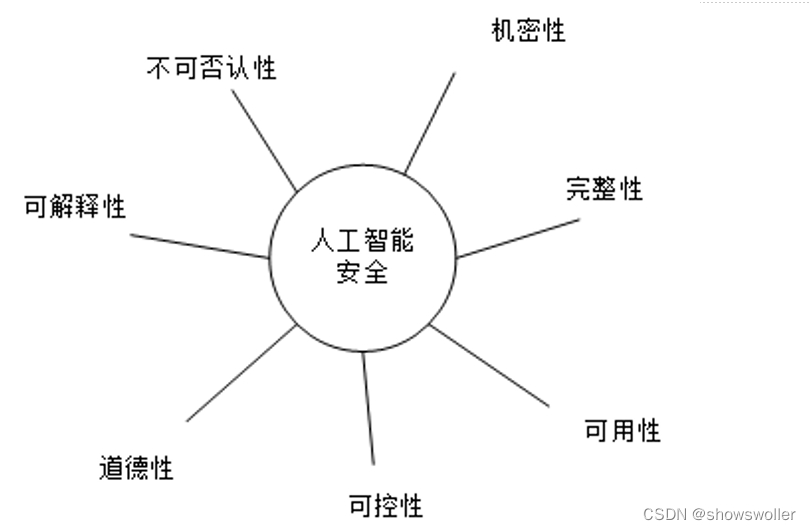

人工智能安全的基本属性

信息安全的基本属性包括:机密性(Confidentiality)、完整性(Integrity)、可用性(Availability)、可控性(Controllability)和不可否认性(Non-Repudiation)

智能系统作为信息系统的一种,除了拥有传统意义上的信息安全基本属性外,在模型算法层面还具有独有的属性

人工智能安全的技术体系

其中,人工智能模型与算法的攻击、人工智能防御与治理这两部分与狭义人工智能安全相关。它们侧重于监督学习、无监督等各类机器学习模型的攻击方法与防御方法,是人工智能安全体系中的重点部分

在模型的对抗攻击与防御中,攻击者的主要目的是,破坏机器学习系统、扰乱机器学习系统的检测识别功能以及从机器学习系统中进行隐私窃取。作为安全研究,攻击与防御是两个重要的视角

从攻击的角度看,对攻击者的行为、攻击假设及目标进行剖析,研究实现这些攻击目的的技术和方法

从防御方的角度看,针对各种攻击行为,研究相应的防御方法

人工智能安全的数据处理

具体方法包括小样本学习、非平衡数据处理和噪声学习三类

对于解决网络信息安全攻击与防御问题、对抗攻击防御和人工智能安全治理等中的主要问题,有一定参考价值

小样本、非平衡和噪声问题是三个典型的人工智能数据问题。这三个问题产生的原因,一方面是来自业务数据本身的问题,例如,入侵检测中某些类别的样本数据不容易获得、用户在标注数据时由于疲劳等原因导致标签出错

另一方面的原因则是来自对抗攻击环境下的攻击行为,攻击者通过在训练数据中添加噪声,恶意修改样本标签,在机器学习模型训练时选择特定的样本分布等方式来实现对机器学习系统的攻击

人工智能用于网络安全的攻击与防御

网络层:利用主机和网络设备的端口可以进行网络层的入侵检测、拒绝服务攻击等等

应用层涉及安全问题更多、更复杂,包括各种应用的安全问题,也包括了内容安全和行为安全。如垃圾邮件检测、社交网络账号冒用、舆情热点等

人工智能对抗攻击与防御

例子:金融欺诈检测、入侵检测等

检测中的核心部件通常是基于人工智能的各类模型,因此模型及相关数据成为攻击者的重要知识,必然成为对抗的重要途径和场所

人工智能对抗攻击技术体系包括了理论和攻击方法,其中理论部分主要针对人工智能的一些基础模型及其相关算法

从攻击者的角度,目前发现许多针对人工智能模型的攻击方法,并从攻击目的、攻击知识等多个角度进行归类。

机器学习隐私攻击与保护

当训练数据中包含个人敏感属性时,在机器学习过程中进行隐私保护成为机器学习是否能成功的重要问题

对机器学习的隐私攻击是一种特殊的对抗攻击,它专注于训练数据的敏感性获取、模型参数的推断,其攻击目的与一般的对抗攻击不同

机器学习隐私攻击的途径是多样化的,对于不同的机器学习系统而言,隐私攻击方法有一些类似的方法。在数据层面,也存在针对各种不同类型数据的隐私攻击方法

从机器学习隐私保护技术来看,总体上可以分为两大类,即从数据角度看的隐私保护和从计算架构角度的隐私保护

从数据角度看的隐私保护

数据层的隐私保护,这是针对原始数据的隐私保护,也是隐私保护方法开始研究时的入手点

模型的隐私保护,机器学习模型由模型结构类型、模型参数及其运算规则组成,相比而言,模型结构类型更容易推测,因此模型参数成为模型的敏感信息

从计算架构角度的隐私保护

机器学习即服务MLaaS:把机器学习模型部署在云计算环境中,并以服务的形式为用户提供调用

在分布式计算模式下,各参与计算的单位如何共享自己的私密数据,不同的方式就产生出不同的隐私计算架构

安全多方计算、联邦学习等

人工智能安全治理

从技术的角度看,人工智能治理的目的在于避免人工智能技术在实际应用中被无意识的误用和有意识的滥用

数据偏见 公平正义 数据标注质量 人工智能伦理

人工智能平台安全

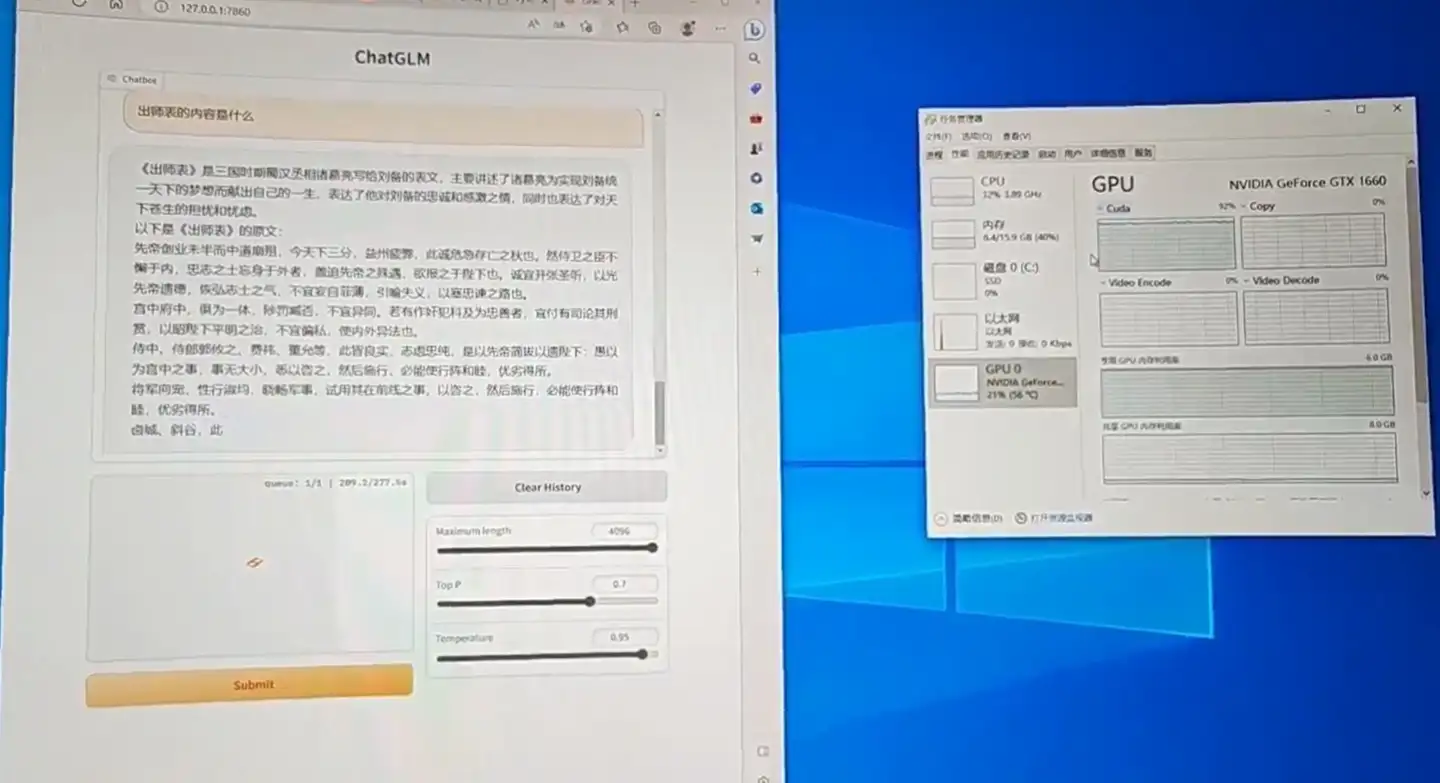

在云计算技术的驱动下,人工智能正以一种服务方式展现出来。其中,最典型的就是机器学习即服务

网络运行安全问题 人工智能平台自身的安全问题,主要体现为针对平台中的模型及其API的调用使用中的安全风险监测、管控。 数据的安全问题

数学基础

概率论与数理统计 线性代数 最优化方法 离散数学