来源:专知

本文为书籍介绍,建议阅读5分钟

沃尔夫勒姆不但讲清楚了GPT的底牌和命门,而且提出了一个可谓惊世骇俗的洞见。

精英日课解读的2023年3月9日刚刚出版的新书《ChatGPT在做什么…以及它为什么好使》(What Is ChatGPT Doing ... and Why Does It Work? ),作者是史蒂芬·沃尔夫勒姆(Stephen Wolfram)他是一个神人,他发明了Mathematics软件,他做了WolframAlpha网站,他搞了一个计算语言叫沃尔夫勒姆语言,他对整个物理学提出了全新的看法。

https://www.wolfram-media.com/products/what-is-chatgpt-doing-and-why-does-it-work/

这本书不是赶时髦,讲的不是GPT的一般功能,而是数学原理和哲学思辨,而数学和哲学是不会过时的。本书得到了OpenAI CEO山姆·奥特曼(Sam Altman)的背书,说是他所见过最好的解释。

沃尔夫勒姆不但讲清楚了GPT的底牌和命门,而且提出了一个可谓惊世骇俗的洞见。

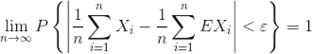

GPT和目前市面上所有的AI,本质上都是神经网络。所以GPT更像人脑,而不是像一般的计算机程序。GPT是一个语言模型,在最本质上,语言模型的功能无非是对文本进行合理的延续,说白了就是预测下一个词该说什么。也正式因为如此,如果让 GPT 做大数字的计算,他会出错。

但是,GPT 却为什么这么好用?奥特曼说,这是上天的眷顾。OpenAI最应该感恩的,是运气。

沃尔夫勒姆讲了GPT的一些特点,其中有三个最幸运的发现——

第一,GPT没有让人类教给它什么「自然语言处理(NLP)」之类的规则。所有语言特征,语法也好语义也好,全是它自己发现的,说白了就是暴力破解。事实证明让神经网络自己发现一切可说和不可说的语言规则,人不插手,是最好的办法。

第二,GPT表现出强烈的「自组织」能力,也就是「涌现」和「思维链」。你不需要人为给它安排什么组织,它自己就能长出各种组织来。

第三,也许是最神奇的一件事情是,GPT用同一个神经网络架构,似乎就能解决表面上相当不同的任务!按理说,画画应该有个画画神经网络,写文章应该有个写文章神经网络,编程应该有个编程神经网络,你得去分别训练——可是事实上,这些事情用同一个神经网络就能做。

GPT的底牌是:它只是一个语言模型,但同时,它很神奇。

GPT的命门是:它是用来思考的,不是用来执行冷酷无情的计算的。

这样说来,虽然GPT比人脑知道的更多、反应更快,但作为神经网络,它并没有在本质上超越人脑。而沃尔夫勒姆有一个洞见:用这么简单的规则组成的神经网络就能很好地模拟人脑的语言系统,这说明人脑的语言系统并不厉害,GPT证明了,语言系统是个简单系统!

沃尔夫勒姆让我们认识到了GPT的根本局限性:神经网络的计算范围是有限的。

Preface

What Is ChatGPT Doing ... and Why Does It Work?

It's Just Adding One Word at a Time

Where Do the Probabilities Come From?

What Is a Model?

Models for Human-Like Tasks

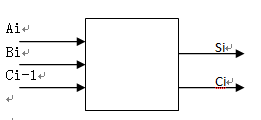

Neural Nets

Machine Learning, and the Training of Neural Nets

The Practice and Lore of Neural Net Training

"Surely a Network That's Big Enough Can Do Anything!"

The Concept of Embeddings

Inside ChatGPT

The Training of ChatGPT

Beyond Basic Training

What Really Lets ChatGPT Work?

Meaning Space and Semantic Laws of Motion

Semantic Grammar and the Power of Computational Language

So ... What Is ChatGPT Doing, and Why Does It Work?

Thanks

Wolfram|Alpha as the Way to Bring Computational Knowledge Superpowers to ChatGPT

ChatGPT and Wolfram|Alpha

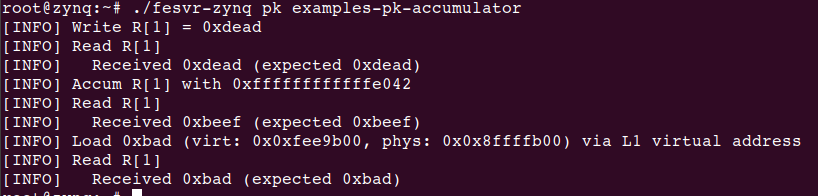

A Basic Example

A Few More Examples

The Path Forward

Additional Resources