1. 什么是余弦退火学习率?

余弦退火学习速率调度是改进深度神经网络学习过程的常用方法。当深度神经网络在大型数据集上训练时,它尤其有用,因为在大型数据集中,学习过程可能会陷入局部极小值。在训练过程中,学习率以不同的速率逐渐降低,直到达到零。这样,模型可以更好地收敛,从而提高预测的准确性。

2. 为什么需要余弦退火学习率?

-

PyTorch提供了一种有效的方法,通过torch.optim.lr_ scheduler模块中的CosineAnnealingLR类来实现余弦退火学习速率调度。余弦退火学习速率调度是一个受欢迎的选择,因为它允许网络最初学习更多,然后专注于微调学习。

-

余弦学习率的主要优点是,**它通过减少模型陷入局部极小值的机会和进行大的学习率更新,**有助于提高深度神经网络的泛化性能。因此,强烈建议深度学习从业者在培训他们的模型时使用这种方法。

3. 余弦退火学习率的Pytorch实现与可视化

3.1 模型应用的基本设置

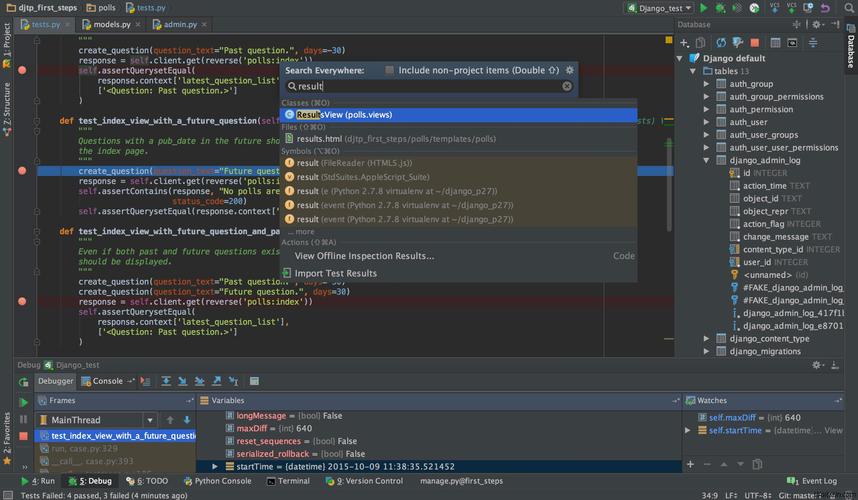

# 余弦退火的学习率设置

from torch.optim.lr_scheduler import CosineAnnealingLR

optimizer = torch.optim.SGD(model.parameters(), lr=0.1, momentum=0.9)

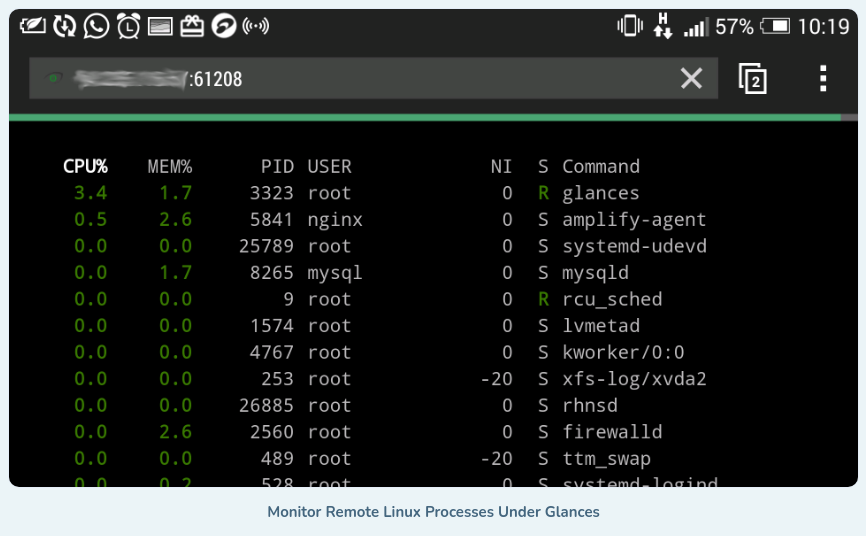

3.2 学习率变化过程可视化

import torch

import matplotlib.pyplot as plt

from torch.optim.lr_scheduler import CosineAnnealingLRoptimizer = torch.optim.SGD(model.parameters(), lr=0.1, momentum=0.9)

scheduler = CosineAnnealingLR(optimizer, T_max=100)lr_values = []epochs = 100

for epoch in range(epochs):lr_values.append(optimizer.param_groups[0]['lr'])# 设置学习率阶梯scheduler.step()plt.plot(lr_values)

plt.show()

当然,如果不运行模型,直接打印,学习率是不变的,在模型迭代训练过程中,学习率会不断调整,step()函数实现调整