11 月底,人工智能研究实验室OpenAI 发布了 ChatGPT 聊天机器人首个测试版本,这是一款基于人工智能的新型聊天机器人,可以与人类进行对话,经过测试后,新款机器人便踏上了社交网站之旅,尤其是在推特平台上,OpenAI首席执行官Sam Altman表示,聊天机器人推出一周内,试用客户已突破100万人。

OpenAI早些时候推出了Dall-E人工智能程序,这款程序使用人工智能将用户的文字转化为图像和创意艺术品,于 2015 年出现,得到了硅谷一些最著名的亿万富翁的资助,其中最著名的是埃隆·马斯克,他在三年后辞去了公司管理层的职务,旨在创建一个专注于人工智能发展的非营利组织。

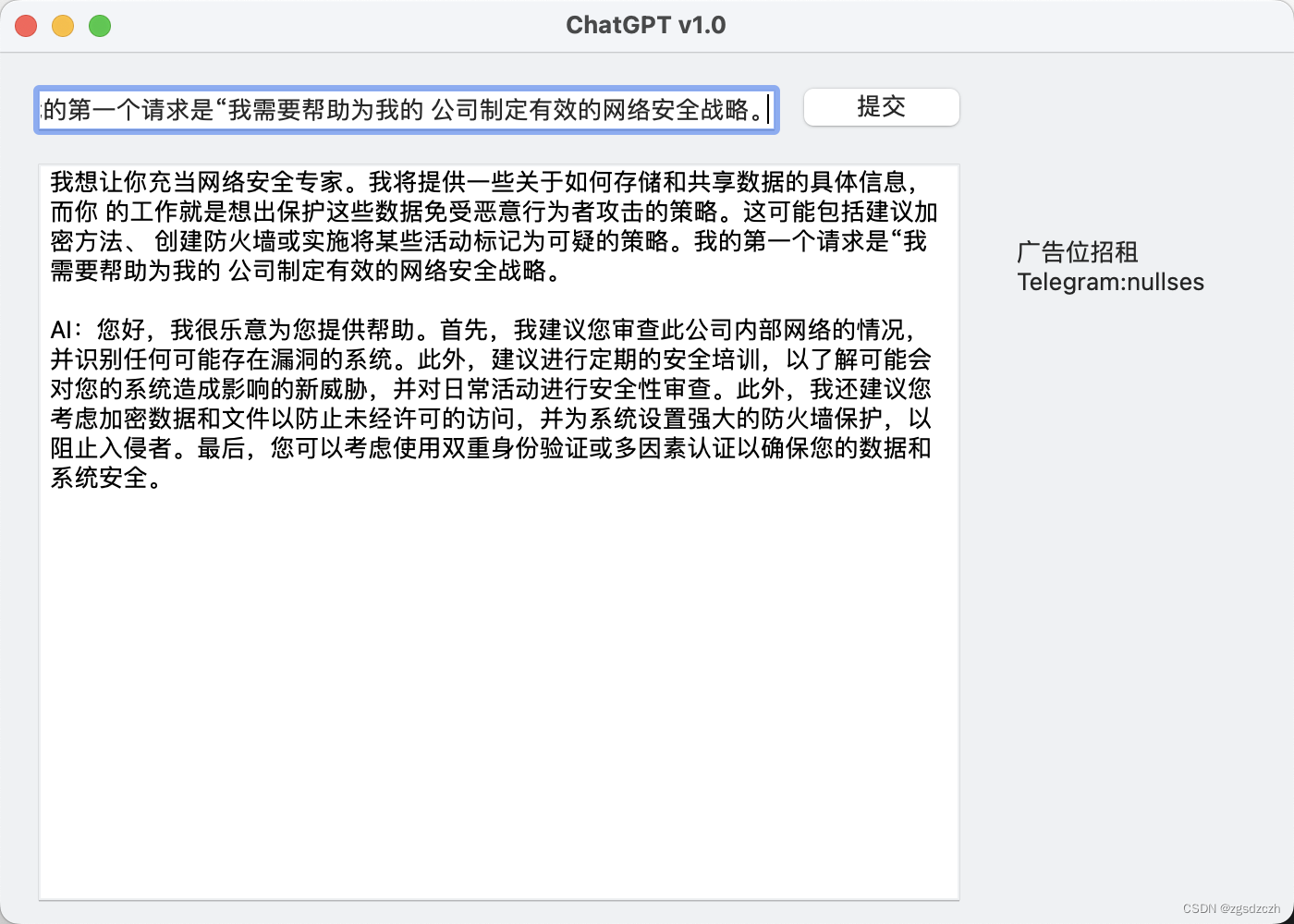

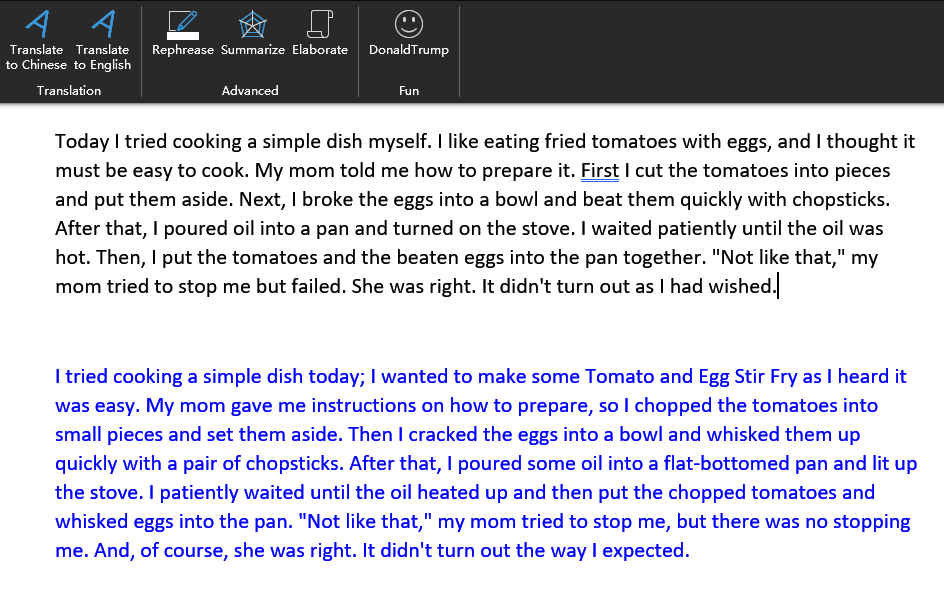

在过去的几天里,推特平台上转载了数百张与“GBT Chat”聊天机器人讨论的图片,几乎涵盖了所有话题,许多第一批用户都对这款聊天机器人的讨论、回答问题和写作的能力感到惊讶,机器人甚至还写过诗句、研究过文章,还写过一些笑话,甚至有人认为,这款机器人是软件和魔术的混合体!

与机器人聊天!

在过去十年中,大多数聊天机器人实验都以失败告终,除非你为机器人选择最佳响应并消除其余响应,否则,它不会给人留下深刻印象,最近几年,已经有一些人工智能程序在特定任务上取得了成功,例如编写营销内容,但大多仅限于此任务,不能在为其指定的范围之外添加任何新内容,但ChatGPT看起来有所不同,而且可能比以前的机器人更聪明、更古怪、更敏捷。

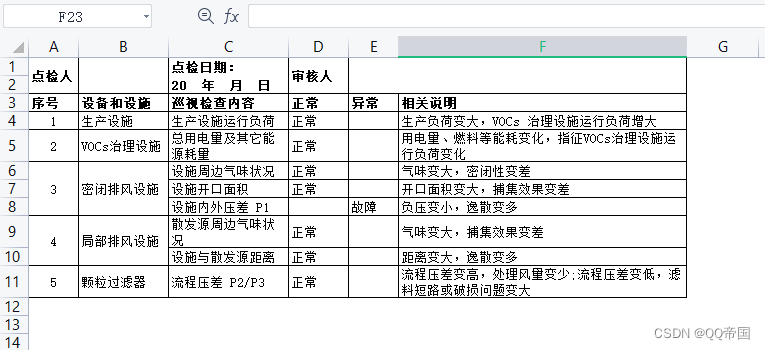

ChatGPT机器人项目的目标是尝试使用人工智能使语音听起来更流畅和自然,就像人类对话一样,用户可以向机器人提问,它会用完整的句子进行回答,试图模仿与真人自然对话的节奏,但OpenAI公司不断警告说,答案并不总是正确或适当的。

OpenAI公司的理念是在所有防火墙到位之前,向公众发布这些原型,希望用户评论、反馈和评分将有助于根据机器人在现实世界中的互动来发现和解决问题,这似乎正在发生,虽然在推特上转载的与机器人对话的许多截图都是奇怪而令人兴奋的对话,但用户也发现了对这些对话有用的应用程序,有人说,这是第一款聊天机器人,它足够有趣,可以与之交谈,也足够有用,可以询问信息,还可以参与哲学讨论并在实际事务中提供帮助,例如,机器人似乎可以帮助程序员发现并修复代码中的错误,许多人还要求这款机器人用 Python 等语言编写代码。

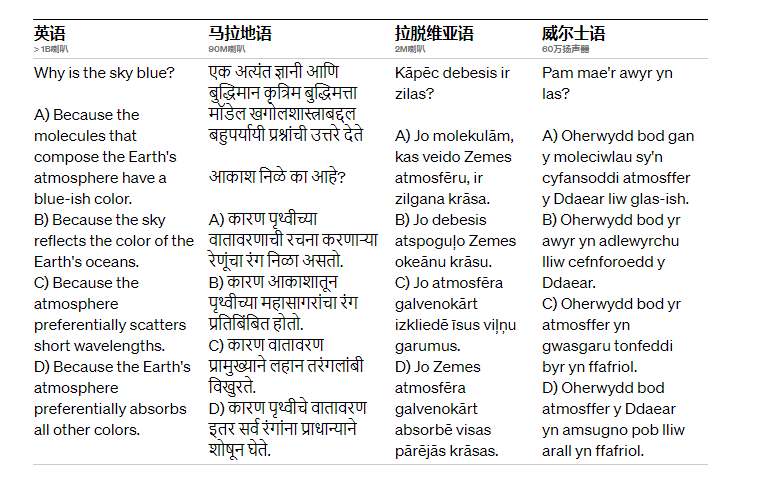

这款机器人还可以用简单的方式向幼儿解释复杂的科学术语或概念,它似乎也擅长回答课堂作业中经常出现的开放式分析性问题,为此,用户要求这款机器人针对特定主题撰写适合研究的文章,结果令人印象深刻,由于人工智能技术,一些作家甚至期望学术文章以目前的形式结束。

向人类学习!

支持聊天机器人的技术并不是全新的,基于“GPT-3.5”文本生成器,这是“GPT-3”版本的现代版本,在 2020 年由 OpenAI 推出时也引起了人们的关注,OpenAI是众多公司、学术实验室和独立研究人员之一,多年来,一直致力于创建更先进的聊天机器人,当然,这些系统不能完全像人类一样说话,但它们通常看起来是,或者这可能是它们未来的目标,有些人甚至期望它将取代我们所知道的传统搜索引擎,例如谷歌和其他搜索引擎。

谷歌本身最近也在开发自己的对话系统,称为 LaMDA,这个系统在6 月引发了巨大争议,因为该公司的一位工程师声称,与他交谈的人工智能具有人类意识,事情当然不是这样的,此外,但它抓住了公众的想象力,尽管谷歌并没有发布这个系统以供公众体验。

2018 年,谷歌和 OpenAI 等实验室的研究人员开始设计神经网络,以所谓的“大型语言模型”分析大量数字文本,其中包括书籍、维基百科文章、新闻和在线聊天记录,通过识别人们关联单词、数字和符号的方式中的数十亿种不同模式,这些系统学会自己编写文本并生成响应。

有关于此,聊天机器人本质上是“大型语言模型”,它们使用算法来分析从这些在线资源中收集的大量文本,以听起来像人类的语言回答用户的请求,然而,大多数聊天机器人没有记忆,也没有被编程为记住或从以前的对话中学习,从某种意义上说,它将每个新请求都视为一个全新的页面,而这正是“ChatGPT聊天”机器人与其他机器人的区别所在。

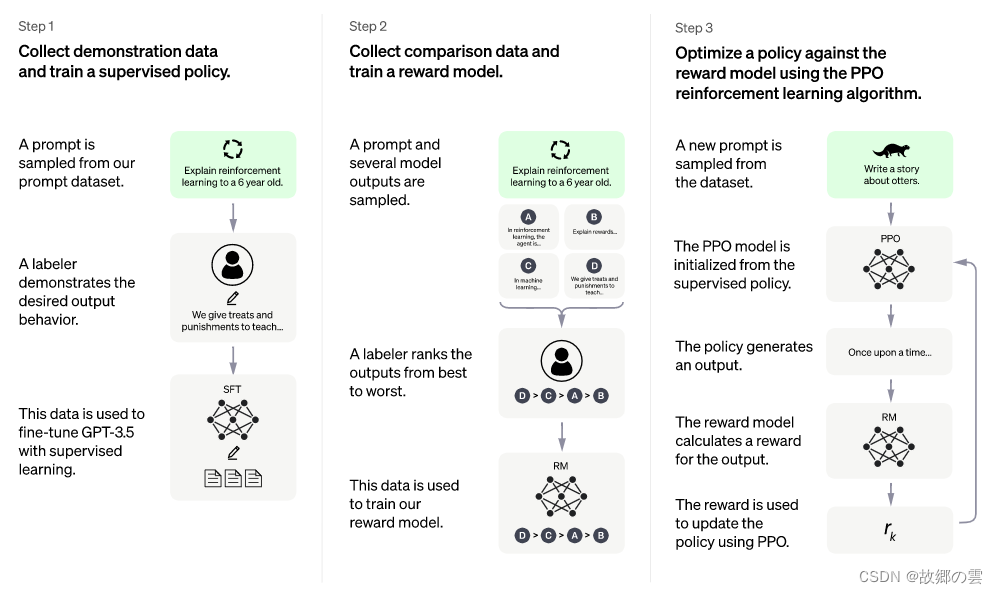

新机器人会记住用户之前说过的话,因为它依赖于一种称为“从人类反馈中强化学习”的机器学习技术,这是一种允许软件从人类反馈和评估中学习的技术,在测试完机器人后,用户被要求对机器人的反应进行评分:它们是否令人信服、有用或正确? 然后,使用强化学习技术,机器人利用这些评估来微调其系统,并更仔细地决定它会做什么和不会做什么。

简单来说,我们可以将“ChatGPT”机器人描述为一个人工智能系统,经过训练可以从从互联网上提取的大量文本中识别模式,然后,在人类的帮助下进行了更多的训练,以提供更好的对话和与人类更有用的对话。你得到的答案可能看起来很有说服力,甚至是可靠的,但它们可能是完全错误的答案,这正是 OpenAI 真正警告的事情。

ChatGPT聊天机器人盲点!

这提醒我们,新的聊天机器人绝不像乍看起来那样完美,因为它的工作方式和生成答案的方式往往使其容易提供错误答案,即使在对人类来说似乎很简单的数学问题中。12 月 5 日,世界上最著名的程序员云集网站之一 Stack Overflow 的管理员,阻止用户分享 ChatGPT聊天机器人生成的回复,他们解释说,机器人使用户可以很容易地提供现成的快速答案,并在网站上充斥着这些答案,乍一看似乎是正确的,但仔细检查后发现,这往往是错误的答案。

与谷歌有所不同,“ChatGPT”聊天机器人不具备爬取各种网站以获取当前事件信息的能力,而且它的知识仅限于它以前(2021 年之前)学到的东西,这使得它的一些答案显得过时了,甚至OpenAI首席执行官Sam Altman在他的推特帐户上的一条推文中发出警告说,机器人的能力非常有限,目前依靠它来做任何重要的事情都是错误的举动。

为了增加其使用的安全性,这款机器人被编程为默认拒绝“不适当的请求”,例如对非法活动给出答案,但是用户已经找到了绕过其中许多障碍的方法,包括将对非法活动的回答请求改写为理论思维实验,要求它写出涉及该活动的戏剧场景,甚至指示机器人禁用其安全功能。

据推测,评估这些机器人编程盲点以及它们如何被滥用于非法或恶意目的,应该是 OpenAI 向公众发布机器人版本进行测试目标的关键部分,未来的版本通常会关闭此类漏洞,以及你尚未发现的其他漏洞。

人工智能为大众服务!

虽然人工智能研究人员可能熟悉高效的语言机器人,但通过免费、易于使用的界面向公众提供如此强大的工具,这几乎是第一次,因为你只需要在网站上创建一个帐户,并开始使用和试验新机器人,但要注意,“Open AI”的服务尚未覆盖所有阿拉伯国家。

在人工智能图像生成器的激增中,同样的动态也很明显。同样,这些系统已经开发多年,但一直无法访问,但今年,像 Midjourney 和 Stable Diffusion 这样的系统,让任何人都可以免费、轻松地使用这项技术,突然之间,人工智能艺术和绘画在互联网上无处不在。

几乎同时,出现了应用程序“LensaAI”,这是一款在 iPhone 和 安卓设备上使用人工智能编辑照片的应用程序,这成为了最近这段时间大家最喜欢的新艺人,因此,你会发现,很多人的社交媒体头像突然看起来像动漫人物或油画,这款应用程序还使用了图像生成初创公司 Stability AI 的一项称为“稳定扩散”的技术,并将你提供的照片变成艺术品。

这些产品不仅告诉我们人工智能技术的发展程度,也证明了这些技术的使用已经为普通大众和非专业人士所用,不再局限于实验室和大型公司,这能够以一种几年前无人可以想象的方式,改变我们未来的生活。

了解更多

全面解读ChatGPT产业链机会

https://download.csdn.net/download/weixin_42814075/87452437

ChatGPT是人工智能的引爆点

https://download.csdn.net/download/weixin_42814075/87453823