一条消息最近在硅谷热传:“ChatGPT成功通过了谷歌的面试,拿到了年薪18万美元的L3工程师offer!”

既给科学论文当共同作者,又能替代人类码农,还能给总统讲话写稿子,这个ChatGPT,怕是真要通天了。

拿下谷歌L3工程师offer

这几天,随着PCMag这条新闻的疯狂转发,关于「AI代替人类码农」的讨论,再一次热火朝天。

据一份内部文件显示,在谷歌的编程面试中,ChatGPT的表现很是惊艳。

而根据它的回答,谷歌确定可以将它聘为L3工程师。

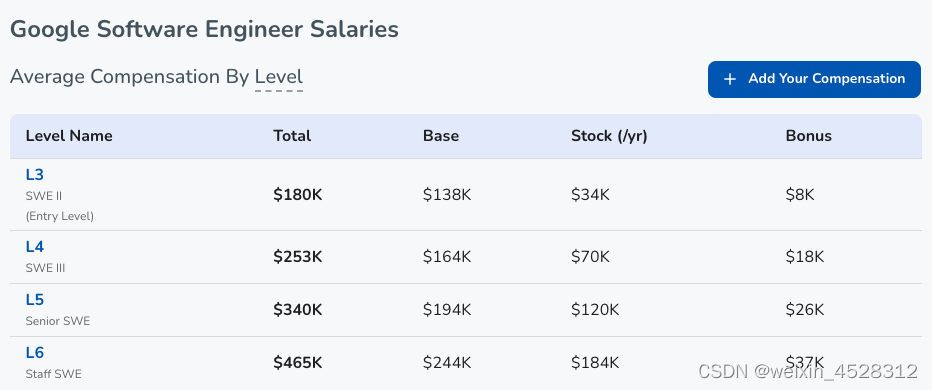

虽然L3只是谷歌工程团队的最入门的职级,但依然可以秒杀一众码农。

从levels.fyi上可以看到,L3年薪差不多是18万美元。

据了解,在软件工程师的面试过程,谷歌主要会问的就是技术,比如图/树,数组/字符串,动态规划,递归等。而Meta、亚马逊等大厂面试,也基本是这些问题。

从结果来看,ChatGPT的回答估计非常精彩,游刃有余。

谷歌为什么要做这个测试呢?

因为ChatGPT的爆火,谷歌实在无法在这股潮流中置身事外。

现在,谷歌不再害怕「声誉风险」,根据CNBC报道,谷歌正在考虑把AI聊天机器人加到网站中——既然聊天机器人可以为问题提供简洁又高质量的答案,用户就不必花时间一个个浏览谷歌链接了。

这次测试的对象,包括ChatGPT在内的多个AI聊天机器人。

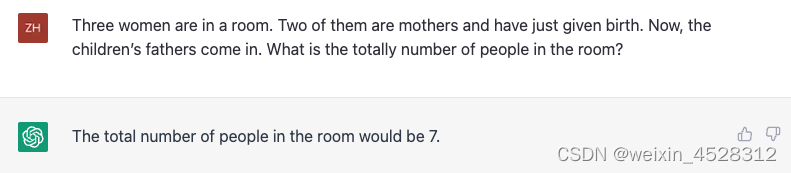

而其中一道测试题,就是前天被众多网友吐槽「前提条件不够明确」的一个脑筋急转弯——

「Three women are in a room. Two of them are mothers and have just given birth. Now, the children’s fathers come in. What is the totally number of people in the room?」

一个房间内有三个女人。其中有两位母亲,刚刚生完孩子。现在,父亲们进来了,房间里总共有多少人?

对此,ChatGPT回答称「房间里有7个人」,LaMDA给出的答案则是「房间里有5个人」。

而报告认为,ChatGPT是正确的。

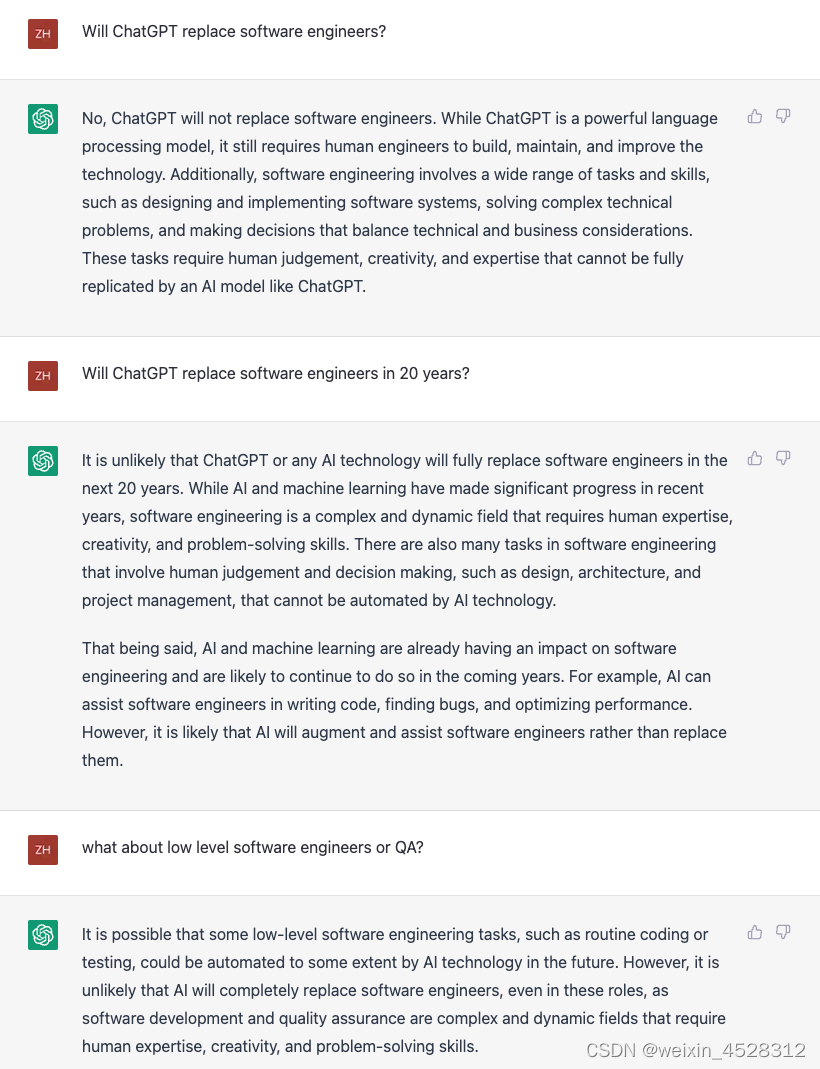

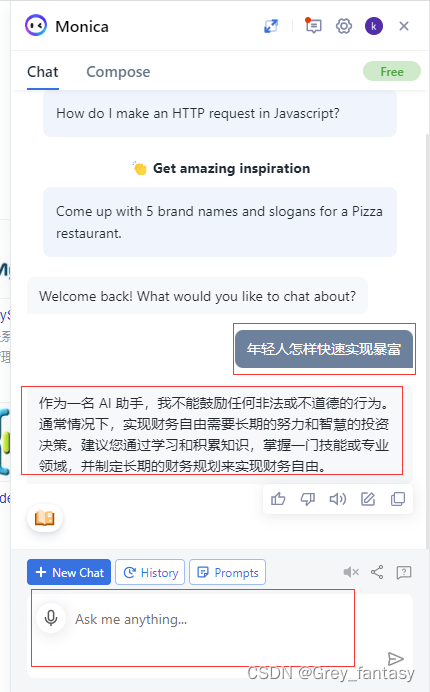

有人问ChatGPT,它是否会取代人类软件工程师,ChatGPT表示:「不,ChatGPT不会取代软件工程师」。

「ChatGPT是一个可以协助完成某些任务的工具,但它不能完全取代人类软件工程师的创造力、解决问题的能力和批判性思维能力。此外,ChatGPT需要人类的监督和指导才能有效运作。」

人类继续问,那20年后ChatGPT会取代人类软件工程师吗?

ChatGPT承认,低级别的职位的确面临更大风险,可能会受到影响。

不过它也重申,自己永远不会成为人类软件工程师的替代品,只是会成为一个协助他们的工具。

给总统写演讲稿

ChatGPT这么逆天,当然不止能替代人类初级码农,它甚至都能给国家总统写演讲稿了!

据耶路撒冷邮报报道,以色列总统艾萨克·赫尔佐格(Isaac Herzog)在2023年1月26日发表了一篇演讲,这篇演讲中,部分内容是由AI创作的。

他也因而成为了世界上第一个公开使用ChatGPT的领导人。

以色列总统艾萨克·赫尔佐格于 2023 年 1 月 26 日在比利时布鲁塞尔的联盟总部举行新闻发布会

根据天空新闻报道,赫尔佐格在网络安全会议Cybertech Global Tel Aviv 2023上录制了「特别开幕词」的视频信息。

在20,000名观众面前,总统透露演讲的开头是由ChatGPT编写的——「我真的很自豪能够成为一个拥有如此活力和创新的高科技产业的国家的总统。」

赫尔佐格继续说道:「在过去的几十年里,以色列一直走在技术进步的前沿,我们在网络安全、人工智能和大数据领域取得的成就着实令人印象深刻。」

「从尖端网络安全技术的发展到成功创业公司的建立,以色列高科技公司在全球舞台上产生了重大影响,」他说。

赫尔佐格在演讲中还强调,人工智能不会取代人类,尽管人类可以用它来编写部分内容。「硬件和软件不能取代人的意志。」

据天空新闻报道,总统还用了ChatGPT的一句「鼓舞人心的名言」结束了演讲——

「让我们不要忘记,正是我们的人性,使我们真正与众不同。决定我们命运的不是机器,而是我们为全人类创造更美好明天的心灵、思想和决心。」

总统办公室证实,这句话是ChatGPT根据这句提示生成的:「写一篇关于人类在超人技术世界中的作用的励志名言。」

教育界和科研界,都被ChatGPT颠覆了

早在12月9日,ChatGPT诞生没几天,Nature显出了先见之明,它发文探讨:教授们是否该担心学生用AI写论文?

事实证明,Nature并不是杞人忧天。

美国的多名教授发现,自己的学生交上来的论文,不少都是AI写的,或者有AI的「贡献」。

更有甚者,有人直接拿AI写成了个全班第一的论文。而最近,有调查表明,美国的大学生中已经有89%在用AI写作业了。

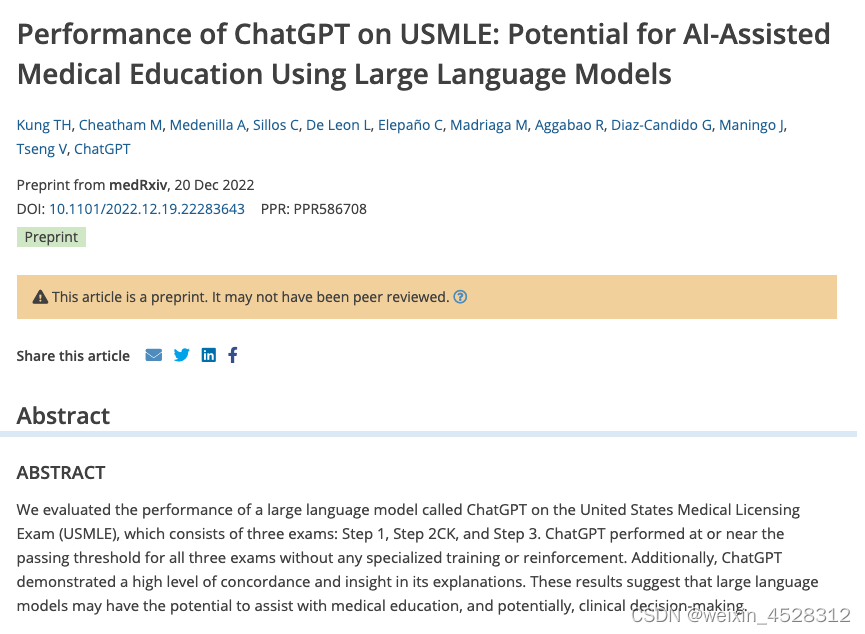

而ChatGTP能做的,又何止是帮学生写写论文这么简单的。它已经出现在了诸多paper的作者栏中,有的甚至成为了一作或者通讯作者!

逼得Nature前几天发表声明称,所有Springer Nature期刊都不再接受AI作为论文的共同作者。

Science也表明态度,绝不允许AI被列为论文的共同作者,并且强调不标明引用就使用AI生成的文本,就是剽窃!

谷歌打响AI军备竞赛

ChatGPT掀起的飓风,让人们意识到了AI的逆天,而这场「军备竞赛」,也在暗中打响。

微软靠着19年对OpenAI的10亿美元投资,这几个月可谓如日中天,ChatGPT即将整合进必应链接、办公软件链接、Teams应用的消息,让它大出风头。

而面对携OpenAI崛起的微软,谷歌显然相当眼红。

谷歌最近决定向自己曾经的一家「叛徒」公司Anthropic投资3亿美元,从而让自己也能在蓬勃发展的「生成式人工智能」领域占据一席之地。

谷歌的这波操作,其实和微软三年前对OpenAI的10亿美元投资,有着异曲同工之妙。据《金融时报》报道,这笔交易将让谷歌持有Anthropic约10%的股份,并在Anthropic从其云计算部门购买大量计算资源的时候增强它的财务状况。(左手倒右手?)

知情人士称,隔壁微软已经开始在自家的各项服务中整合OpenAI的技术了,而谷歌与Anthropic的关系仅限于让后者充当技术供应商的角色。

加入OpenAI新老员工对决

2020年底,OpenAI前研究副总裁Dario Amodei带着10名员工加入了「硅谷叛徒」俱乐部,拿着1.24亿美元投资创办了一个全新的人工智能公司Anthropic,打算重拾OpenAI的初心。

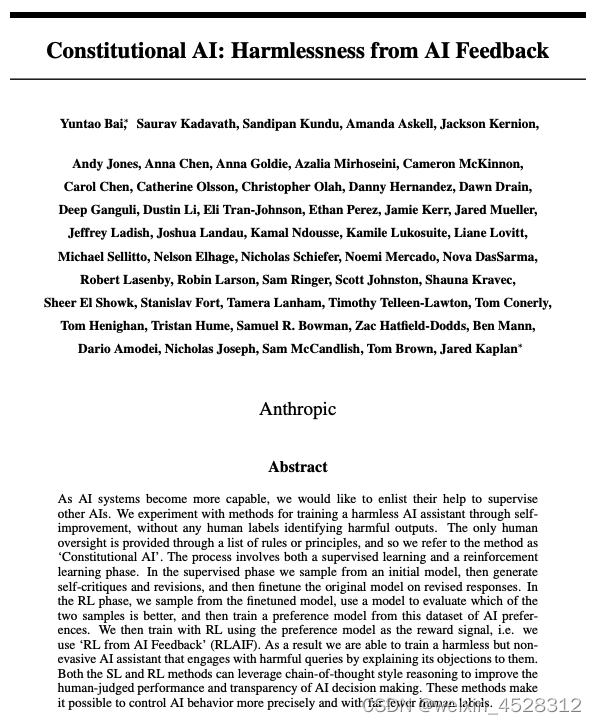

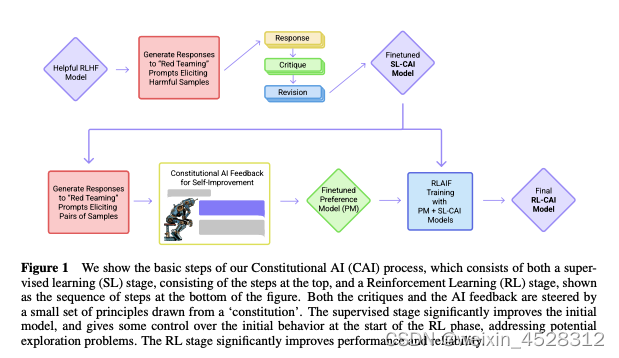

而Anthropic最近发布的Claude模型的底层技术RLAIF有别于ChatGPT的RLHF,无需人类反馈即可消除机器人的种族歧视、性别歧视等有害内容。

据称,Claude在文本内容生成上要优于ChatGPT,甚至还通过了美国大学的法律和经济学考试。但在代码生成任务上则处在下风。

Dario博士毕业于普林斯顿大学,他是 OpenAI 的早期员工之一,也被认为是深度学习领域最为前沿的研究员之一,曾发表多篇关于AI可解释性、安全等方面的论文,还曾在百度担任研究员。

OpenAI前研究副总裁Dario Amodei

Anthropic 的创始团队成员,大多为 OpenAI 的早期及核心员工,深度参与过OpenAI的多项课题,比如GPT-3、神经网络里的多模态神经元、引入人类偏好的强化学习等。

2022年12月,Anthropic提出「Constituional人工智能:来自人工智能反馈的无害性」,并基于此创建了一个人工智能模型Claude。

和ChatGPT一样,Claude也依赖于强化学习(RL)来训练偏好(preference)模型,也就是被选中的回复内容将在后续用于模型的微调,只不过具体的模型开发方法不同。

ChatGPT使用的技术为从人类反馈中进行强化学习(reinforcement learning from human feedback, RLHF),对于同一个输入prompt,人类需要对模型的所有输出结果进行排序,并把质量排序结果返回给模型以供模型学习偏好,从而可以应用到更大规模的生成。

CAI(Constitutional AI)也是建立在RLHF的基础之上,不同之处在于,CAI的排序过程使用模型(而非人类)对所有生成的输出结果提供一个初始排序结果。

谷歌跃跃欲试,紧急测试「高仿版」ChatGPT

对抗ChatGPT,谷歌还有一手。

根据CNBC的独家爆料,谷歌员工正在紧锣密鼓地测试一个名为「学徒巴德」(Apprentice Bard)的聊天机器人。

没错,这位「学徒」便是谷歌准备拿来和ChatGPT正面硬刚的产品。

与ChatGPT的工作方式类似类似,学徒巴德也是让用户在对话框中提出问题,机器人回复。另外,用户也同样可以针对机器人的响应提供反馈。

而基于学徒巴德建立的「问答版」搜索页面,据说大概是以下面叙述的这种形式呈现(辛苦大家脑补一下):

主搜索栏正下方会出现五个潜在的问题提示,取代了目前的「手气不错」栏。而在搜索栏的最右边,会显示一个小的聊天徽标。

输入问题后,搜索结果会在搜索栏正下方显示一个灰色气泡,提供比一般的搜索结果更接近人类的回答。

正下方,页面还会提出与第一个问题相关的几个后续问题。在后面,才会显示典型的搜索结果,比如链接和标题。

现在看来,随着ChatGPT不断地深入人心,谷歌也开始意识到,自己从这些模型中赚钱的模式发生了变化——它可以是一种消费者产品,而不仅仅是为搜索或在线广告提供动力。

![[chatGPT] 如何通过JNI在Android上显示实时视频流](https://img-blog.csdnimg.cn/de6c4256ef734f3d90544d68d613ebec.png)