概述

本文介绍了如何使用Python的Scrapy库编写一个简单的爬虫程序,实现从Amazon网站下载商品图片的功能。Scrapy是一个强大的爬虫框架,提供了许多方便的特性,如选择器、管道、中间件、代理等。本文将重点介绍如何使用Scrapy的图片管道和代理中间件,以提高爬虫的效率和稳定性。

正文

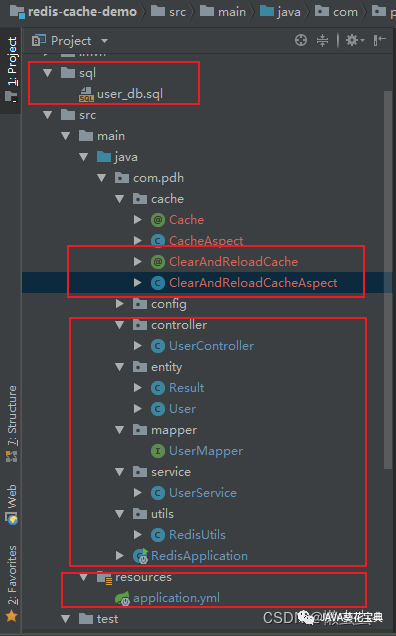

1. 创建Scrapy项目

首先,我们需要创建一个Scrapy项目,命名为amazon_image_downloader。在命令行中输入以下命令:

scrapy startproject amazon_image_downloader

这将在当前目录下生成一个名为amazon_image_downloader的文件夹,其中包含以下文件和子文件夹:

amazon_image_downloader/scrapy.cfg # 配置文件amazon_image_downloader/ # 项目的Python模块__init__.pyitems.py # 项目中的item文件middlewares.py # 项目中的中间件文件pipelines.py # 项目中的管道文件settings.py # 项目的设置文件spiders/ # 存放爬虫代码的目录__init__.py

2. 定义Item类

接下来,我们需要在items.py文件中定义一个Item类,用来存储我们要爬取的数据。在本例中,我们只需要爬取商品图片的URL和名称,所以我们可以定义如下:

import scrapyclass AmazonImageItem(scrapy.Item):# 定义一个Item类,用来存储图片的URL和名称image_urls = scrapy.Field() # 图片的URL列表image_name = scrapy.Field() # 图片的名称

3. 编写爬虫代码

然后,我们需要在spiders文件夹中创建一个名为amazon_spider.py的文件,编写我们的爬虫代码。我们可以使用Scrapy提供的CrawlSpider类来实现自动跟进链接的功能。我们需要指定以下内容:

- name: 爬虫的名称,用来运行爬虫时使用。

- allowed_domains: 允许爬取的域名列表,防止爬虫跑到其他网站上。

- start_urls: 起始URL列表,爬虫会从这些URL开始抓取数据。

- rules: 规则列表,用来指定如何从响应中提取链接并跟进。

- parse_item: 解析函数,用来从响应中提取数据并生成Item对象。

我们可以参考Amazon网站的结构和URL规律,编写如下代码:

import scrapy

from scrapy.spiders import CrawlSpider, Rule

from scrapy.linkextractors import LinkExtractor

from amazon_image_downloader.items import AmazonImageItemclass AmazonSpider(CrawlSpider):# 定义一个CrawlSpider类,用来实现自动跟进链接的功能name = 'amazon_spider' # 爬虫的名称allowed_domains = ['amazon.com'] # 允许爬取的域名列表start_urls = ['https://www.amazon.com/s?k=book'] # 起始URL列表rules = (# 定义规则列表,指定如何从响应中提取链接并跟进Rule(LinkExtractor(allow=r'/s\?k=book&page=\d+'), follow=True), # 匹配商品列表页的链接,并跟进Rule(LinkExtractor(allow=r'/dp/\w+'), callback='parse_item'), # 匹配商品详情页的链接,并调用parse_item函数)def parse_item(self, response):# 定义解析函数,从响应中提取数据并生成Item对象item = AmazonImageItem() # 创建一个Item对象item['image_urls'] = [response.xpath('//img[@id="imgBlkFront"]/@src').get()] # 从响应中提取图片的URL,并存入image_urls字段item['image_name'] = response.xpath('//span[@id="productTitle"]/text()').get().strip() # 从响应中提取图片的名称,并存入image_name字段return item # 返回Item对象

4. 配置图片管道和代理中间件

最后,我们需要在settings.py文件中配置图片管道和代理中间件,以实现图片的下载和代理的使用。我们需要修改以下内容:

- ITEM_PIPELINES: 项目中启用的管道类及其优先级的字典。我们需要启用Scrapy提供的ImagesPipeline类,并指定一个合适的优先级,如300。

- IMAGES_STORE: 图片管道使用的本地存储路径。我们可以指定一个名为images的文件夹,用来存放下载的图片。

- IMAGES_URLS_FIELD: 图片管道使用的Item字段,该字段的值是一个包含图片URL的列表。我们需要指定为image_urls,与我们定义的Item类一致。

- IMAGES_RESULT_FIELD: 图片管道使用的Item字段,该字段的值是一个包含图片信息的列表。我们可以指定为image_results,用来存储图片的路径、校验码、大小等信息。

- DOWNLOADER_MIDDLEWARES: 项目中启用的下载器中间件类及其优先级的字典。我们需要启用Scrapy提供的HttpProxyMiddleware类,并指定一个合适的优先级,如100。

- PROXY_POOL: 代理池,用来提供代理IP和端口。我们可以使用亿牛云爬虫代理提供的域名、端口、用户名、密码

- CONCURRENT_REQUESTS: Scrapy downloader 并发请求(concurrent requests)的最大值。我们可以根据我们的网络和代理的质量,设置一个合适的值,如16。

- CONCURRENT_REQUESTS_PER_DOMAIN: 对单个网站进行并发请求的最大值。我们可以根据目标网站的反爬策略,设置一个合适的值,如8。

- DOWNLOAD_DELAY: 下载两个页面之间等待的时间。这可以用来限制爬取速度,减轻服务器压力。我们可以根据目标网站的反爬策略,设置一个合适的值,如0.5秒。

修改后的settings.py文件如下:

# Scrapy settings for amazon_image_downloader projectassistant = 'amazon_image_downloader'SPIDER_MODULES = ['amazon_image_downloader.spiders']

NEWSPIDER_MODULE = 'amazon_image_downloader.spiders'# Crawl responsibly by identifying yourself (and your website) on the user-agent

#USER_AGENT = 'amazon_image_downloader (+http://www.yourdomain.com)'# Obey robots.txt rules

ROBOTSTXT_OBEY = False# Configure item pipelines

# See https://docs.scrapy.org/en/latest/topics/item-pipeline.html

ITEM_PIPELINES = {'scrapy.pipelines.images.ImagesPipeline': 300, # 启用图片管道,并指定优先级为300

}# Configure images pipeline

# See https://docs.scrapy.org/en/latest/topics/images.html

IMAGES_STORE = 'images' # 指定图片管道使用的本地存储路径为images文件夹

IMAGES_URLS_FIELD = 'image_urls' # 指定图片管道使用的Item字段为image_urls

IMAGES_RESULT_FIELD = 'image_results' # 指定图片管道使用的Item字段为image_results# Configure downloader middlewares

# See https://docs.scrapy.org/en/latest/topics/downloader-middleware.html

DOWNLOADER_MIDDLEWARES = {'scrapy.downloadermiddlewares.httpproxy.HttpProxyMiddleware': 100, # 启用代理中间件,并指定优先级为100

}# Configure proxy pool

# 亿牛云代理 https://www.16yun.cn

PROXY_POOL = ['http://username:password@domain:port', # 使用亿牛云爬虫代理提供的域名、端口、用户名、密码'http://username:password@domain:port',...

]# Enable or disable extensions

# See https://docs.scrapy.org/en/latest/topics/extensions.html

#EXTENSIONS = {

# 'scrapy.extensions.telnet.TelnetConsole': None,

#}# Configure item exporters

## Configure concurrent requests and download delay

# See https://docs.scrapy.org/en/latest/topics/settings.html

CONCURRENT_REQUESTS = 16 # 设置Scrapy downloader 并发请求的最大值为16

CONCURRENT_REQUESTS_PER_DOMAIN = 8 # 设置对单个网站进行并发请求的最大值为8

DOWNLOAD_DELAY = 0.5 # 设置下载两个页面之间等待的时间为0.5秒

结语

本文介绍了如何使用Python的Scrapy库编写一个简单的爬虫程序,实现从Amazon网站下载商品图片的功能。我们使用了Scrapy的图片管道和代理中间件,以提高爬虫的效率和稳定性。我们还使用了多线程技术,提高采集速度。这个爬虫程序只是一个示例,你可以根据你的具体需求进行修改和优化,感谢你的阅读。