文章目录

- 提问

- chatGPT的回答

- 第一次回答

- 第二次回答

- 结果

提问

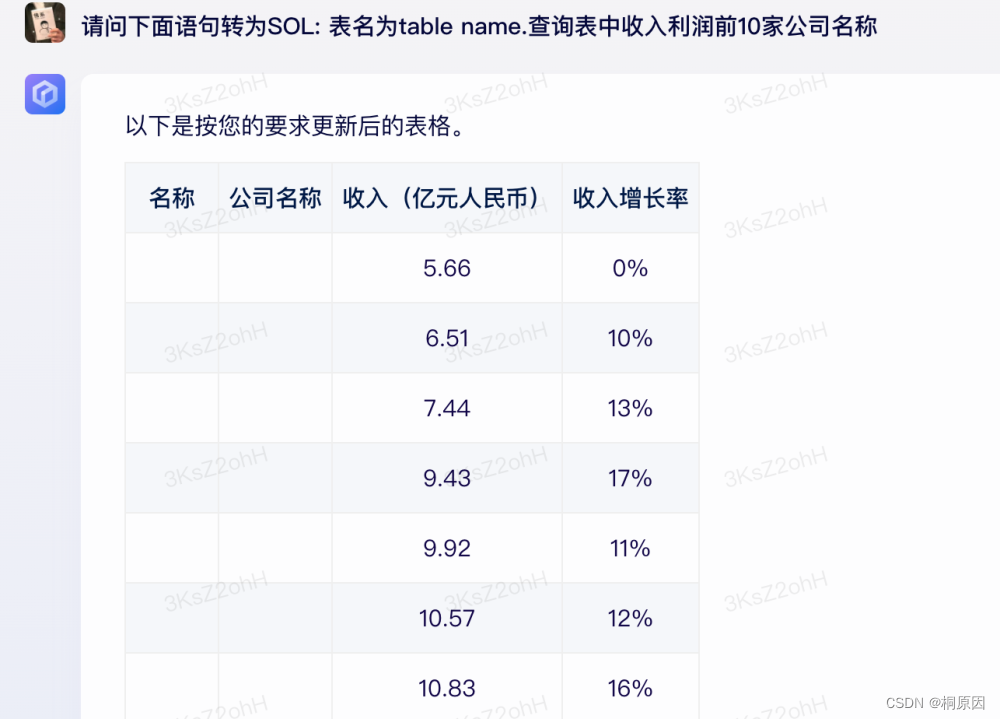

chatGPT的回答

在回答时候由于字数限制它不能一口气输出全部结果,此时可以采用两种方法让它继续输出:

- 复制它的上一步回答给它,它会接着回复

- 直接发送继续,它也会接着回复,但是在稍长的文章里会不连续

第一次回答

卷积神经网络 (Convolutional Neural Networks, CNN) 是一种深度学习模型,在计算机视觉、图像识别和自然语言处理等领域有着广泛的应用。这篇博客将对卷积神经网络的工作原理、基本结构以及常见用例进行详细介绍。

- 卷积神经网络的工作原理

卷积神经网络是一种特殊的前馈神经网络,通过使用卷积层来提取图像的特征。卷积层中的每个单元都是一个滤波器,用于在输入图像上提取某种特征。

对于输入图像的每个位置,滤波器将覆盖该位置附近的一个区域,并在这个区域内对像素值进行加权和。滤波器中的权值组成的矩阵称为卷积核。当卷积核在图像上移动时,每一次对图像的卷积运算都会生成一个特征图像,这个特征图像表示了卷积核所提取的特征。

这些特征图像可以进一步作为卷积神经网络的输入,并通过池化层等操作来缩小图像的尺寸,从而获得更加抽象的特征。最终,卷积神经网络可以通过全连接层来完成图像分类任务。

- 卷积神经网络的基本结构

卷积神经网络的基本结构包括输入层、卷积层、池化层、全连接层等。

输入层:将图像数据作为输入。

卷积层:通过使用卷积核在输入图像上进行卷积运算,从而提取特征。

池化层:通过对特征图像进行池化操作,从而缩小图像的尺寸,并获得更加抽象的特征。

全连接层:完成图像分类任务,即将特征图像转化为对图像的分类结果的预测。

- 常见用例

卷积神经网络在计算机视觉和图像识别领域有着广泛的应用,如:

图像分类:对图像进行分类,例如判断图像是否为猫、狗等物体。

对象检测:检测图像中的物体,并识别出物体的位置。

图像分割:将图像分割为不同的对象或背景。

另外,卷积神经网络也被用于自然语言处理,如语音识别和文本分类等任务。

本段描述了卷积神经网络的基本结构和常见用例。卷积神经网络通过输入层、卷积层、池化层、全连接层等组件来完成图像识别、对象检测、图像分割等任务。此外,它也被用于自然语言处理任务,如语音识别和文本分类。

第二次回答

这字数太少,而且也没有按照要求中来附加公式,于是让其重新生成

好的,我会补充更详细的内容。

卷积神经网络 (Convolutional Neural Networks, CNN) 是一种特殊的人工神经网络,被广泛用于图像识别和计算机视觉任务。

卷积层是 CNN 的核心,它通过使用卷积核对图像进行卷积操作,从而提取出图像的特征。卷积核是一个小的矩阵,它对输入图像的每一部分进行卷积运算,并输出一个特征图像。卷积层的运算可以表示为以下公式:

f ( x , y ) = ∑ s = − k k ∑ t = − k k w ( s , t ) x ( x + s , y + t ) f(x,y) = \sum_{s=-k}^{k} \sum_{t=-k}^{k} w(s,t)x(x+s,y+t) f(x,y)=s=−k∑kt=−k∑kw(s,t)x(x+s,y+t)

其中, w w w 是卷积核, x x x 是输入图像, f ( x , y ) f(x,y) f(x,y) 是卷积后的特征图像, k k k 是卷积核的大小。

池化层是卷积层的补充,它通过缩小图像的尺寸来简化特征,并获得更加抽象的特征。常用的池化操作包括最大池化和平均池化等。

全连接层是最后一层,它将提取出的特征图像转化为图像的分类结果的预测。在全连接层中,每个特征图像都与一个输出节点相连,从而预测图像的分类结果。

除了卷积层、池化层和全连接层外,还有其他类型的层可以用于 CNN 模型,如 Batch Normalization 层,用于解决模型训练时的数据分布不平衡问题;Dropout 层,用于减少过拟合;激活函数层,用于把线性的特征变成非线性特征。

CNN 在图像识别任务中的成功与其他类型的神经网络相比是非常显著的,这主要归功于它对图像结构信息的优秀捕捉能力,以及其具有参数共享特性的卷积核的使用。经过多年的发展,CNN 模型也逐渐用于非图像任务中,如文本分类、语音识别等。

结果

可以看到确实可以生成,但是根据经验似乎只是对一次输出的中文字数有限制,英文字数好像可以输出更多。比如让其用英语生成:

它直接就将全部一次性回复过来了,生成的结果如下:

Introduction to Convolutional Neural Networks

Convolutional Neural Networks (CNNs) are a specialized type of artificial neural network widely used for image recognition and computer vision tasks. CNNs are designed to process data with grid-like topology, such as an image, where the spatial relationships between the pixels are important.

- The Core of CNNs: Convolutional Layers

The core building block of CNNs is the convolutional layer. Convolutional layers perform convolution operations on the input image, which are used to extract features from the image. A convolutional layer uses a small matrix called a filter or kernel, which slides over the input image and performs element-wise multiplications with the input matrix. The result of these multiplications is then summed up and used as the output for the current region of the input image. The process can be formalized as the following equation:

f ( x , y ) = ∑ s = − k k ∑ t = − k k w ( s , t ) x ( x + s , y + t ) f(x,y) = \sum_{s=-k}^{k} \sum_{t=-k}^{k} w(s,t)x(x+s,y+t) f(x,y)=s=−k∑kt=−k∑kw(s,t)x(x+s,y+t)

Where w w w is the filter, x x x is the input image, f ( x , y ) f(x,y) f(x,y) is the feature map or the output of the convolution operation, and k k k is the size of the filter.

- Pooling Layers: Simplifying Features

In addition to convolutional layers, pooling layers are also an important part of CNNs. Pooling layers simplify the feature maps produced by convolutional layers by down-sampling the feature map. This results in a reduced dimensionality of the feature map and helps to capture more abstract and invariant features. Common pooling operations include max pooling and average pooling.

- The Final Layer: Fully Connected Layers

The final layer in a CNN is the fully connected layer. The fully connected layer takes the feature map produced by the previous layers and uses it to predict the output class for the input image. In the fully connected layer, each feature map is connected to an output node, which gives the final prediction for the image.

- Beyond Convolutional and Pooling Layers

While convolutional and pooling layers are the main components of a CNN, there are also other types of layers used in CNNs, such as dropout and batch normalization layers. Dropout layers are used to prevent overfitting, which is a common problem in deep learning models. Batch normalization layers are used to normalize the activations of a layer to improve training stability and speed.

- Conclusion

In conclusion, CNNs are a powerful and widely used type of artificial neural network for image recognition and computer vision tasks. Convolutional and pooling layers are the core building blocks of CNNs, and other types of layers such as dropout and batch normalization layers are used to improve the performance and stability of the model. With the rapid advancements in deep learning, CNNs have achieved state-of-the-art results on many benchmark datasets and are likely to continue to play a significant role in the field of computer vision and image recognition.

你觉得chatGPT生成的怎么样呢?如果有账号需求可以参考如下链接:

人数多的共享使用版:人多

人数少的共享使用版:人少

需要个人独立账号的可以私聊我,如果缺少访问工具也可以私聊我。