目录

Video generation models as world simulators(视频生成模型作为世界模拟器)

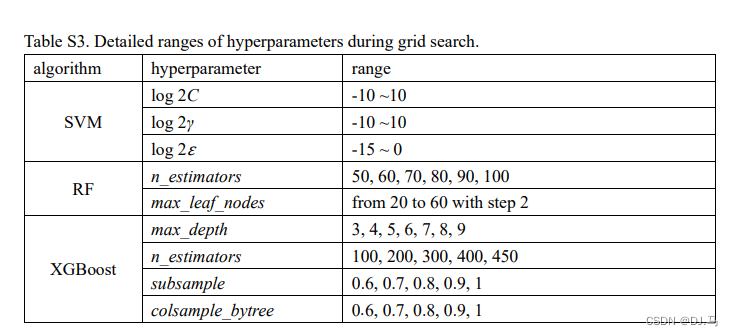

Turning visual data into patches (将视觉数据转换为图像块)

Video compression network (视频压缩网络)

Spacetime Latent Patches (隐空间时空编码块 )

Scaling transformers for video generation (扩展Transformer用于视频生成)

Variable durations, resolutions, aspect ratios (可变持续时间、分辨率、宽高比)

Sampling flexibility (采样灵活性 )

Improved framing and composition (改进的构图和画面组成)

Language understanding (语言理解 )

Prompting with images and videos (使用图片和视频进行提示)

Animating DALL·E images (制作DALL·E图像动画)

Extending generated videos (延长生成的视频)

Video-to-video editing (视频到视频编辑 )

Connecting videos (连接视频 )

Image generation capabilities (图像生成能力)

Emerging simulation capabilities (涌现的模拟能力)

Video generation models as world simulators(视频生成模型作为世界模拟器)

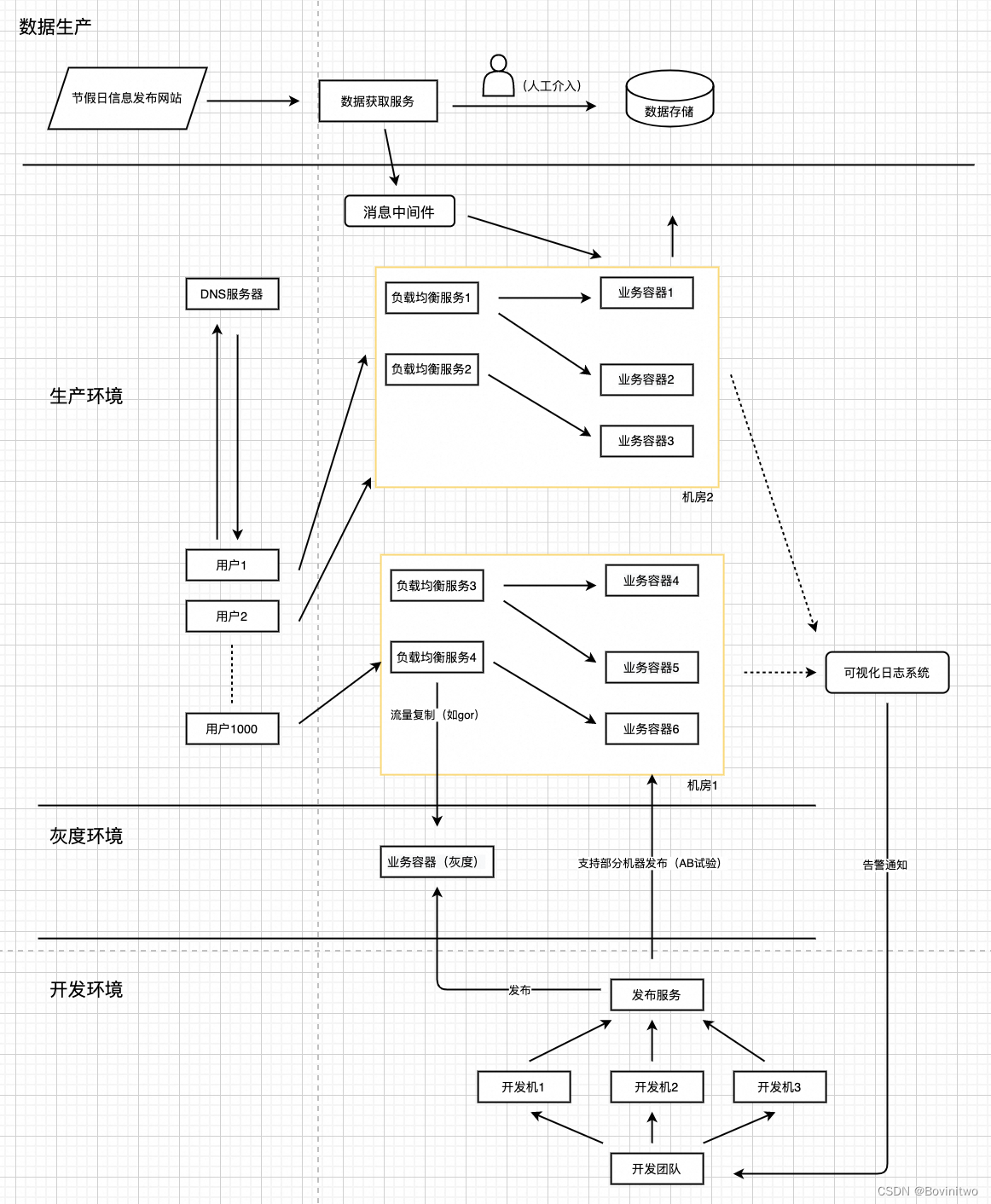

We explore large-scale training of generative models on video data. Specifically, we train text-conditional diffusion models jointly on videos and images of variable durations, resolutions and aspect ratios. We leverage a transformer architecture that operates on spacetime patches of video and image latent codes. Our largest model, Sora, is capable of generating a minute of high fidelity video. Our results suggest that scaling video generation models is a promising path towards building general purpose simulators of the physical world.

我们探索了在视频数据上进行大规模训练生成模型。具体来说,我们联合训练了文本条件扩散模型,处理不同持续时间、分辨率和宽高比的视频和图像。我们利用了一种在视频和图像潜码的时空块上操作的变压器架构。我们最大的模型Sora能够生成一分钟的高保真视频。我们的结果表明,扩大视频生成模型的规模是朝着构建物理世界通用模拟器的有前途的路径。

This technical report focuses on (1) our method for turning visual data of all types into a unified representation that enables large-scale training of generative models, and (2) qualitative evaluation of Sora’s capabilities and limitations. Model and implementation details are not included in this report.

本技术报告重点介绍:(1)我们将各类视觉数据转换为统一表示的方法,该方法能够实现生成模型的大规模训练;(2)Sora能力和局限性的定性评估。报告中未包含模型和实现细节。

Much prior work has studied generative modeling of video data using a variety of methods, including recurrent networks,generative adversarial networks,4,5,6,7 autoregressive transformers,8,9 and diffusion models.10,11,12 These works often focus on a narrow category of visual data, on shorter videos, or on videos of a fixed size. Sora is a generalist model of visual data—it can generate videos and images spanning diverse durations, aspect ratios and resolutions, up to a full minute of high definition video.

以前的许多工作已经研究了使用各种方法对视频数据进行生成建模,包括循环网络、生成对抗网络、自回归变换器和扩散模型。这些工作通常专注于狭窄类别的视觉数据、较短的视频或固定大小的视频。Sora是一种通用的视觉数据模型——它可以生成持续时间、宽高比和分辨率各异的视频和图像,长达一分钟的高清视频。

Turning visual data into patches (将视觉数据转换为图像块)

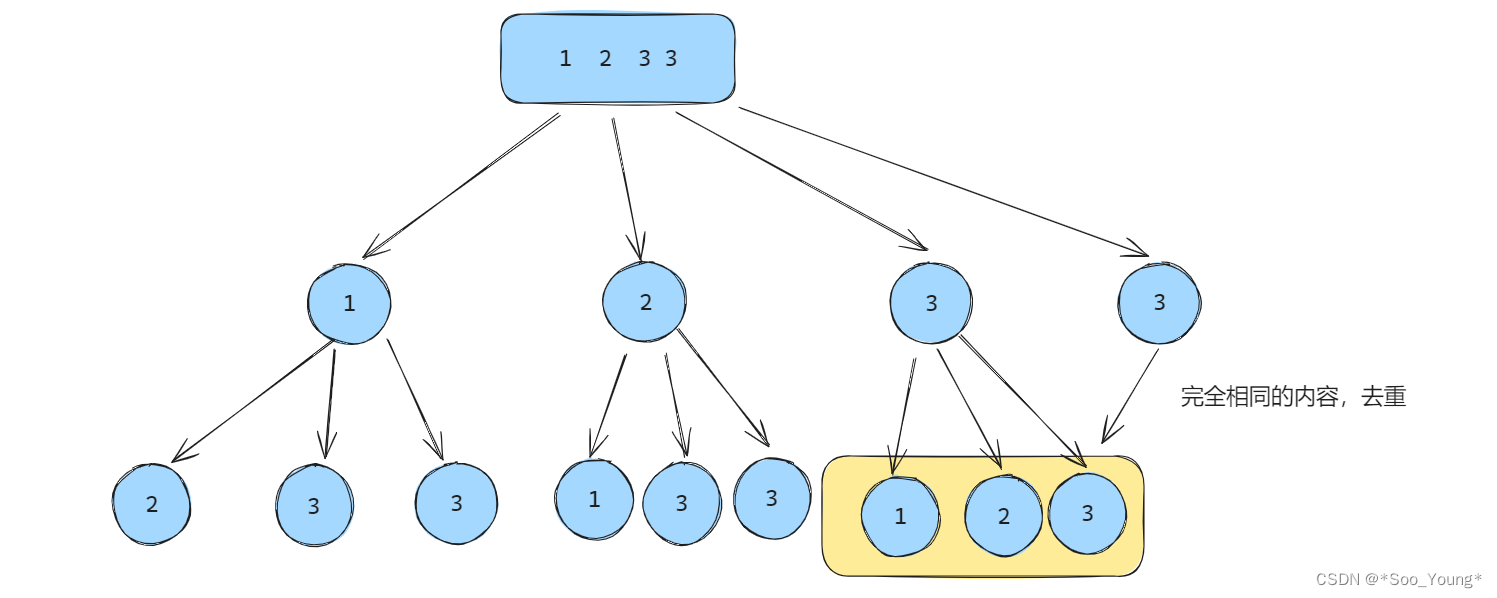

We take inspiration from large language models which acquire generalist capabilities by training on internet-scale data.13,14 The success of the LLM paradigm is enabled in part by the use of tokens that elegantly unify diverse modalities of text—code, math and various natural languages. In this work, we consider how generative models of visual data can inherit such benefits. Whereas LLMs have text tokens, Sora has visual patches. Patches have previously been shown to be an effective representation for models of visual data.15,16,17,18 We find that patches are a highly-scalable and effective representation for training generative models on diverse types of videos and images.

我们从大型语言模型中获得灵感,这些模型通过在互联网规模的数据上训练来获得通用能力。这种范式的成功在一定程度上得益于使用词元编码/令牌(token),它们巧妙地统一了文本的多种形式——代码、数学和各种自然语言。在这项工作中,我们考虑如何让视觉数据的生成模型继承这些好处。与拥有文本令牌的不同,Sora拥有视觉块嵌入编码(visual patches)。视觉块已被证明是视觉数据模型的一种有效表示。我们发现,视觉块是一种高度可扩展且有效的表示形式,用于在多种类型的视频和图像上训练生成模型。

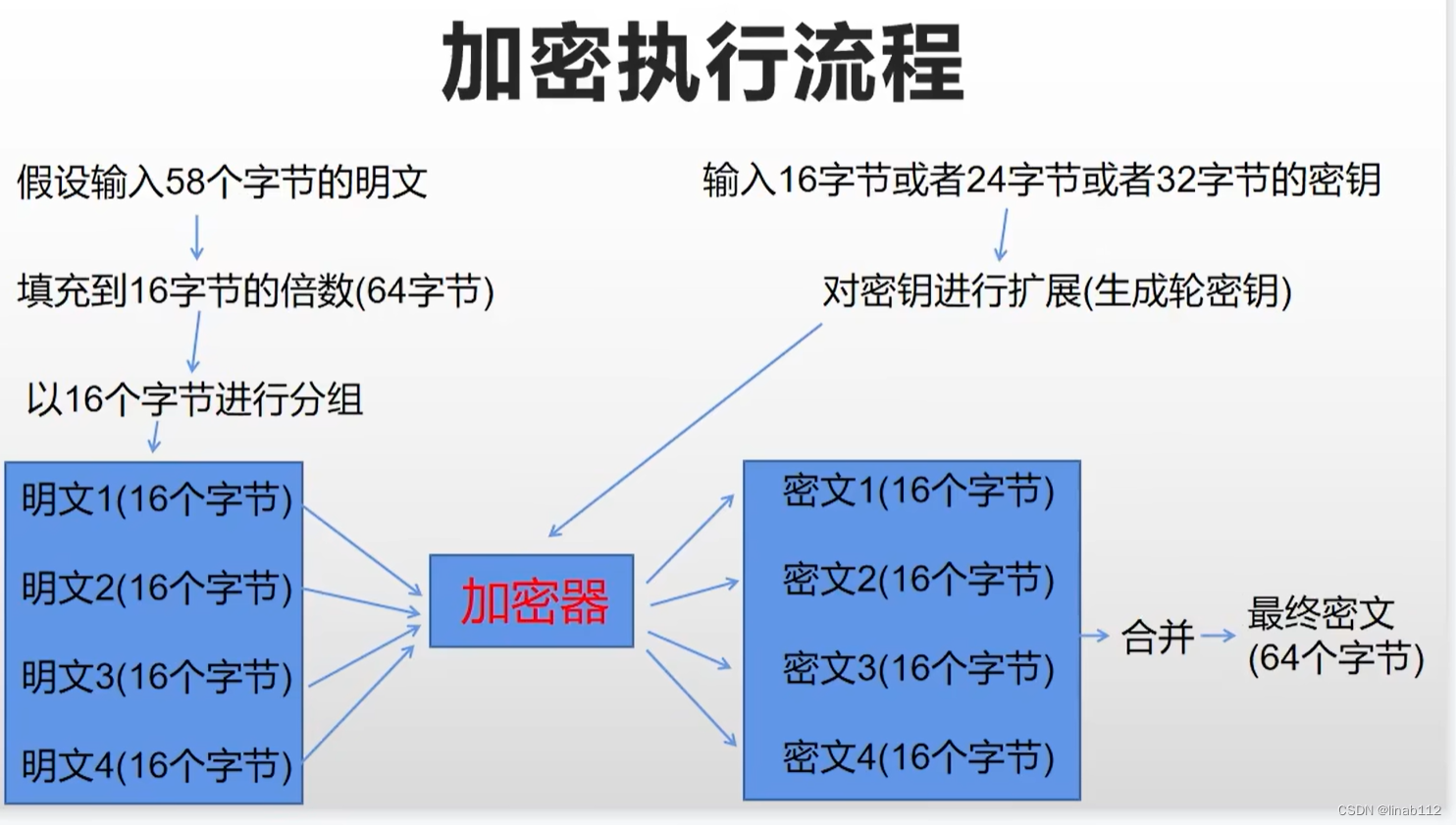

At a high level, we turn videos into patches by first compressing videos into a lower-dimensional latent space,19 and subsequently decomposing the representation into spacetime patches.

在高维上,我们首先将视频压缩到一个低维潜在空间,然后将表示分解成时空嵌入,从而将视频转换成一系列编码块。

Video compression network (视频压缩网络)

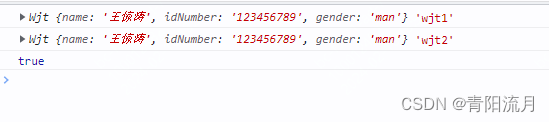

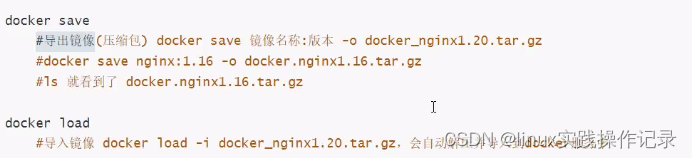

We train a network that reduces the dimensionality of visual data.20 This network takes raw video as input and outputs a latent representation that is compressed both temporally and spatially. Sora is trained on and subsequently generates videos within this compressed latent space. We also train a corresponding decoder model that maps generated latents back to pixel space.

我们训练了一个网络,用于降低视觉数据的维度。这个网络将原始视频作为输入,并输出一个在时间和空间上都被压缩的潜在表示。Sora在这个压缩的潜在空间内接受训练,并随后生成视频。我们还训练了一个相应的解码器模型,将生成的潜在表示映射回像素空间。

Spacetime Latent Patches (隐空间时空编码块 )

Given a compressed input video, we extract a sequence of spacetime patches which act as transformer tokens. This scheme works for images too since images are just videos with a single frame. Our patch-based representation enables Sora to train on videos and images of variable resolutions, durations and aspect ratios. At inference time, we can control the size of generated videos by arranging randomly-initialized patches in an appropriately-sized grid.

给定一个压缩的输入视频,我们提取一系列时空编码块作为transformer令牌(token)。这种方案也适用于图像,因为图像只是帧数为单一的视频。我们基于补丁的表示使得Sora能够训练不同分辨率、持续时间和宽高比的视频和图像。在推理时,我们可以通过在适当大小的网格中排列随机初始化的编码块来控制生成视频的大小。

Scaling transformers for video generation (扩展Transformer用于视频生成)

Sora is a diffusion model21,22,23,24,25; given input noisy patches (and conditioning information like text prompts), it’s trained to predict the original “clean” patches. Importantly, Sora is a diffusion transformer.26 Transformers have demonstrated remarkable scaling properties across a variety of domains, including language modeling,13,14 computer vision,15,16,17,18 and image generation.27,28,29

Sora是一个扩散模型;给定输入的噪声块(和像文本提示这样的条件信息),它被训练来预测原始的“干净”块。重要的是,Sora是一个扩散变换器。变换器在包括语言建模、计算机视觉和图像生成等多个领域展现了显著的扩展属性。

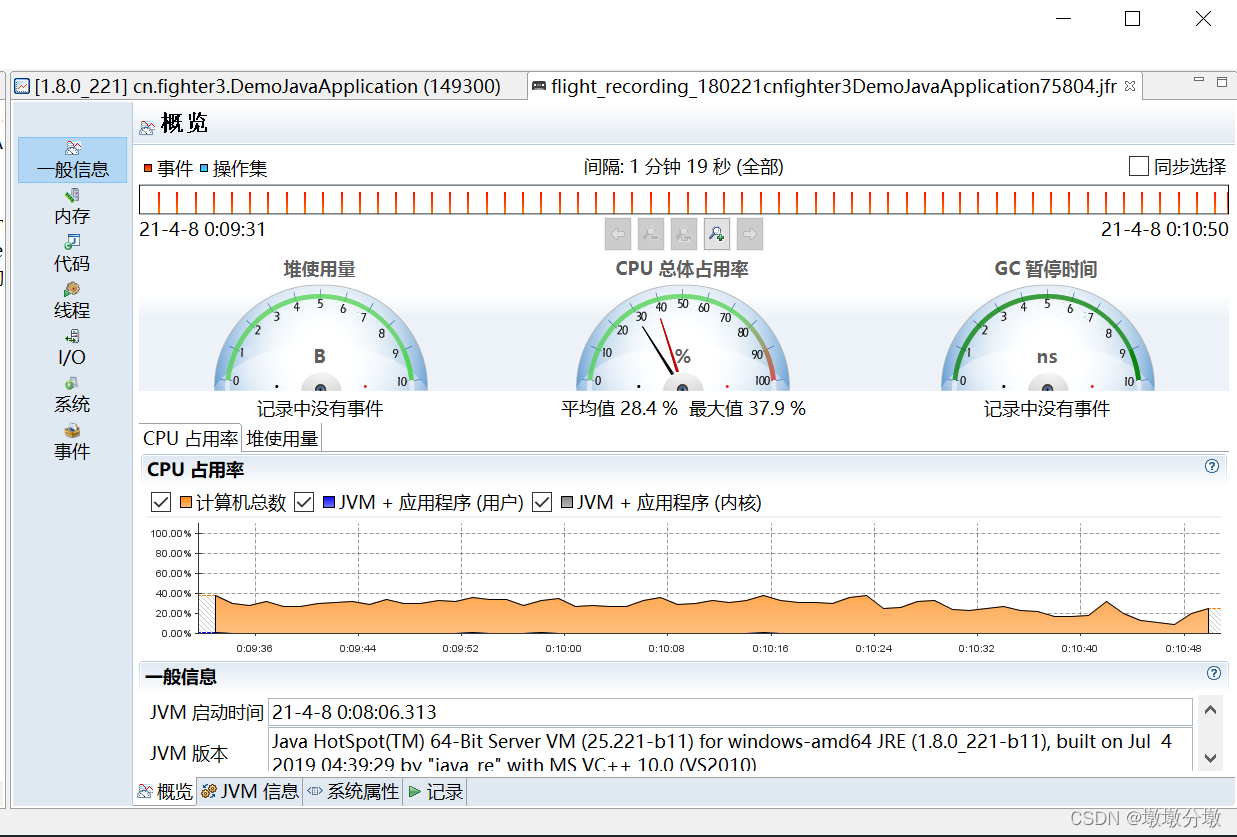

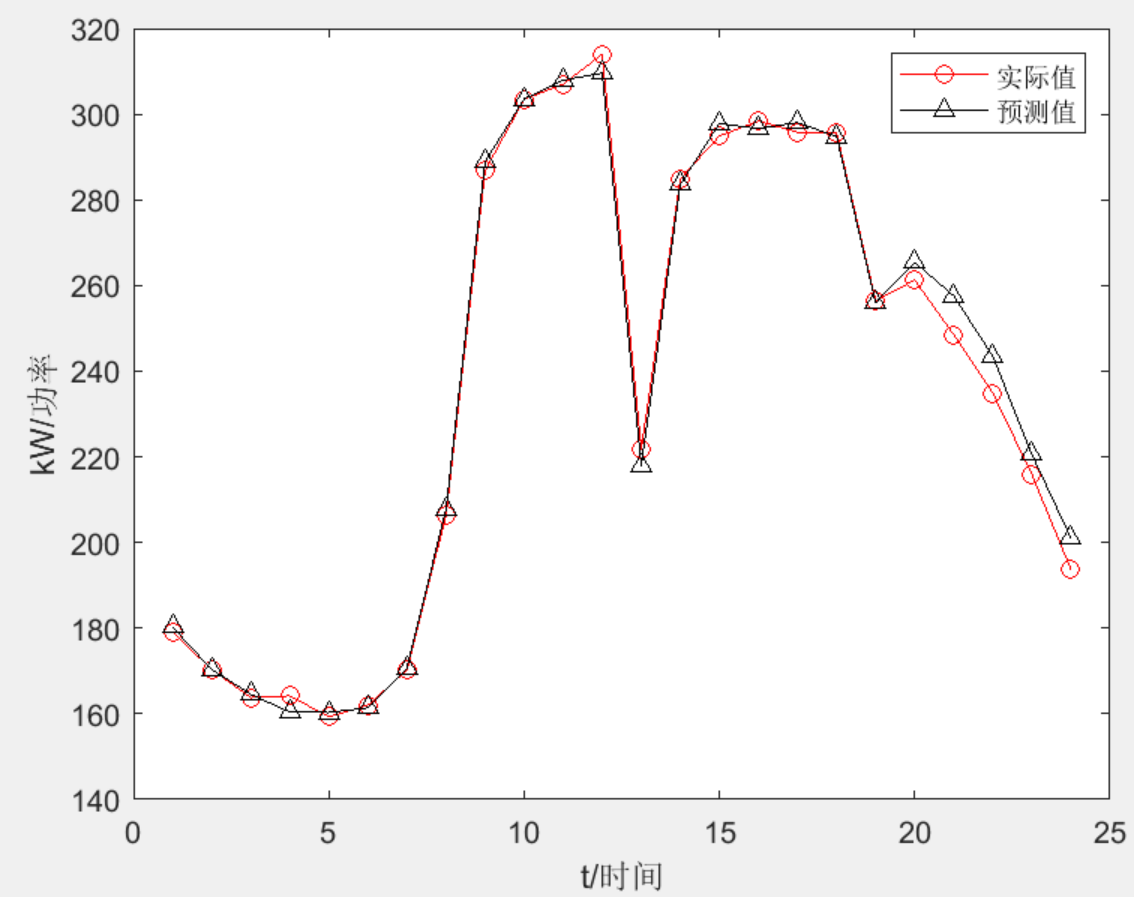

In this work, we find that diffusion transformers scale effectively as video models as well. Below, we show a comparison of video samples with fixed seeds and inputs as training progresses. Sample quality improves markedly as training compute increases.

在这项工作中,我们发现扩散变换器作为视频模型也能有效地扩展。下面,我们展示了训练进展过程中,使用固定种子和输入的视频样本比较。随着训练计算量的增加,样本质量显著提高。

Variable durations, resolutions, aspect ratios (可变持续时间、分辨率、宽高比)

Past approaches to image and video generation typically resize, crop or trim videos to a standard size – e.g., 4 second videos at 256x256 resolution. We find that instead training on data at its native size provides several benefits.

过去在图像和视频生成中的方法通常会将视频调整大小、裁剪或剪辑到一个标准尺寸——例如,4秒长的视频,分辨率为256x256。我们发现,直接在数据的原始尺寸上进行训练可以带来几个好处。

Sampling flexibility (采样灵活性 )

Sora can sample widescreen 1920x1080p videos, vertical 1080x1920 videos and everything inbetween. This lets Sora create content for different devices directly at their native aspect ratios. It also lets us quickly prototype content at lower sizes before generating at full resolution—all with the same model.

Sora可以采样宽屏1920x1080p视频、竖屏1080x1920视频以及介于两者之间的所有格式。这使得Sora能够直接按照不同设备的原生宽高比创建内容。它还允许我们在使用同一模型生成全分辨率内容之前,快速原型化较小尺寸的内容。

Improved framing and composition (改进的构图和画面组成)

We empirically find that training on videos at their native aspect ratios improves composition and framing. We compare Sora against a version of our model that crops all training videos to be square, which is common practice when training generative models. The model trained on square crops (left) sometimes generates videos where the subject is only partially in view. In comparison, videos from Sora (right)s have improved framing.

我们通过实证发现,在视频的原始宽高比上进行训练可以改善构图和取景。我们将Sora与一个版本的模型进行了比较,该模型将所有训练视频裁剪成正方形,这是训练生成模型时的常见做法。在正方形裁剪上训练的模型(左侧)有时会生成主体只部分出现在视野中的视频。相比之下,来自Sora的视频(右侧)具有改善的取景。

Language understanding (语言理解 )

Training text-to-video generation systems requires a large amount of videos with corresponding text captions. We apply the re-captioning technique introduced in DALL·E 330 to videos. We first train a highly descriptive captioner model and then use it to produce text captions for all videos in our training set. We find that training on highly descriptive video captions improves text fidelity as well as the overall quality of videos.

训练文本到视频生成系统需要大量带有相应文字标题的视频。我们将在DALL·E 3中引入的重新标注技术应用到视频上。我们首先训练一个高度描述性的标注模型,然后使用它为我们训练集中的所有视频生成文字标题。我们发现,在高度描述性的视频标题上进行训练可以提高文本的准确性以及视频的整体质量。

Similar to DALL·E 3, we also leverage GPT to turn short user prompts into longer detailed captions that are sent to the video model. This enables Sora to generate high quality videos that accurately follow user prompts.

类似于DALL·E 3,我们也利用GPT将用户的简短提示转换成更长的详细说明,然后发送给视频模型。这使得Sora能够生成高质量的视频,准确地遵循用户的提示。

Prompting with images and videos (使用图片和视频进行提示)

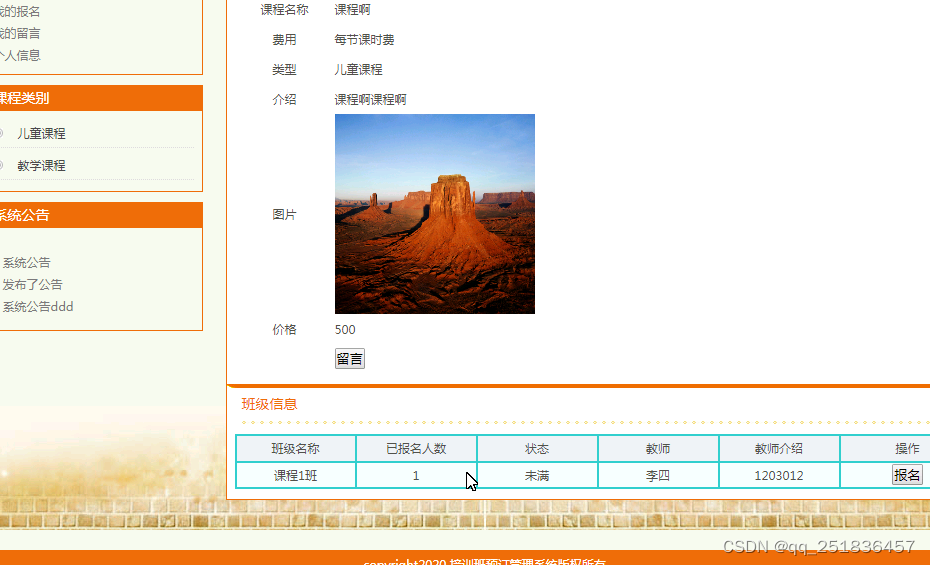

All of the results above and in our landing page show text-to-video samples. But Sora can also be prompted with other inputs, such as pre-existing images or video. This capability enables Sora to perform a wide range of image and video editing tasks—creating perfectly looping video, animating static images, extending videos forwards or backwards in time, etc.

上述结果以及我们的登录页面展示了文本到视频的样本。但是Sora也可以通过其他输入进行提示,例如预先存在的图片或视频。这项能力使得Sora能够执行广泛的图像和视频编辑任务——创建完美循环的视频,为静态图像添加动画,向前或向后延长视频的时间等。

Animating DALL·E images (制作DALL·E图像动画)

Sora is capable of generating videos provided an image and prompt as input. Below we show example videos generated based on DALL·E 231 and DALL·E 330 images.

Sora能够根据输入的图片和提示生成视频。下面我们展示了基于DALL·E 2 31 和DALL·E 3 30 图片生成的示例视频。

Extending generated videos (延长生成的视频)

Sora is also capable of extending videos, either forward or backward in time. Below are four videos that were all extended backward in time starting from a segment of a generated video. As a result, each of the four videos starts different from the others, yet all four videos lead to the same ending.

Sora也能够将视频向前或向后延长时间。下面是四个视频,它们都是从生成的视频片段开始向后延长的。因此,这四个视频的开头各不相同,但最终都会达到相同的结局。

We can use this method to extend a video both forward and backward to produce a seamless infinite loop.

我们可以使用这种方法将视频向前和向后扩展,以制作出无缝的无限循环。

Video-to-video editing (视频到视频编辑 )

Diffusion models have enabled a plethora of methods for editing images and videos from text prompts. Below we apply one of these methods, SDEdit,32 to Sora. This technique enables Sora to transform the styles and environments of input videos zero-shot.

扩散模型使得从文本提示编辑图像和视频的方法层出不穷。下面我们将其中一种方法,SDEdit,应用于Sora。这项技术使得Sora能够零次学习地转换输入视频的风格和环境。

Connecting videos (连接视频 )

We can also use Sora to gradually interpolate between two input videos, creating seamless transitions between videos with entirely different subjects and scene compositions. In the examples below, the videos in the center interpolate between the corresponding videos on the left and right.

我们还可以使用Sora在两个输入视频之间逐渐插值,创建在完全不同主题和场景构成的视频之间的无缝过渡。在下面的例子中,中间的视频在左右两边对应视频之间进行插值。

Image generation capabilities (图像生成能力)

Sora is also capable of generating images. We do this by arranging patches of Gaussian noise in a spatial grid with a temporal extent of one frame. The model can generate images of variable sizes—up to 2048x2048 resolution.

Sora也能够生成图像。我们通过在具有一个帧时间范围的空间网格中排列高斯噪声块来实现这一点。该模型可以生成不同大小的图像——分辨率最高可达2048x2048。

Close-up portrait shot of a woman in autumn, extreme detail, shallow depth of field

秋天里一位女性的特写肖像,极致细节,浅景深

Vibrant coral reef teeming with colorful fish and sea creatures

充满活力的珊瑚礁,挤满了五彩缤纷的鱼类和海洋生物

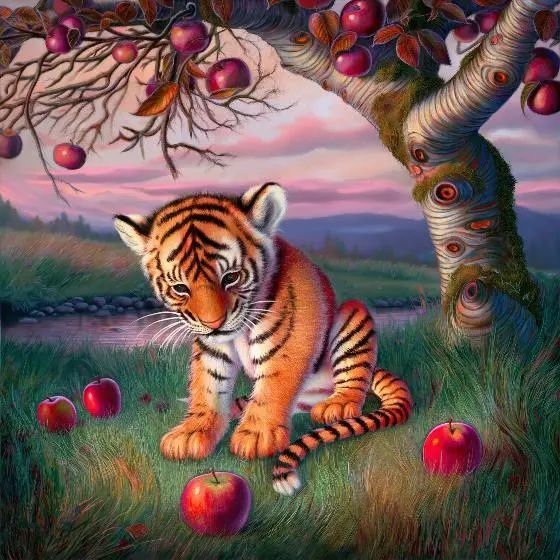

Digital art of a young tiger under an apple tree in a matte painting style with gorgeous details

数字艺术的一只幼年老虎在苹果树下,采用哑光绘画风格,细节华丽

A snowy mountain village with cozy cabins and a northern lights display, high detail and photorealistic dslr, 50mm f/1.2

一个雪山村庄,有着舒适的小木屋和北极光展示,高清晰度和逼真的数码单反相机,50mm f/1.2镜头拍摄。

Emerging simulation capabilities (涌现的模拟能力)

We find that video models exhibit a number of interesting emergent capabilities when trained at scale. These capabilities enable Sora to simulate some aspects of people, animals and environments from the physical world. These properties emerge without any explicit inductive biases for 3D, objects, etc.—they are purely phenomena of scale.

我们发现,当在大规模上训练时,视频模型展现出许多有趣的新兴能力。这些能力使得Sora能够模拟现实世界中人类、动物和环境的某些方面。这些属性并没有任何针对3D、物体等的明确归纳偏见——它们纯粹是规模效应的现象。

3D consistency. Sora can generate videos with dynamic camera motion. As the camera shifts and rotates, people and scene elements move consistently through three-dimensional space.

3D一致性。Sora能够生成具有动态相机运动的视频。随着相机的移动和旋转,人物和场景元素在三维空间中保持一致地移动。

Long-range coherence and object permanence. A significant challenge for video generation systems has been maintaining temporal consistency when sampling long videos. We find that Sora is often, though not always, able to effectively model both short- and long-range dependencies. For example, our model can persist people, animals and objects even when they are occluded or leave the frame. Likewise, it can generate multiple shots of the same character in a single sample, maintaining their appearance throughout the video.

长距离一致性和物体恒存性。对于视频生成系统来说,一个重大挑战是在采样长视频时保持时间上的连贯性。我们发现,尽管不总是如此,Sora通常能够有效地建模短距离和长距离依赖关系。例如,我们的模型即使在人、动物和物体被遮挡或离开画面时,也能持续保持它们的存在。同样,它能在单个样本中生成同一角色的多个镜头,并在整个视频中保持其外观。

Interacting with the world. Sora can sometimes simulate actions that affect the state of the world in simple ways. For example, a painter can leave new strokes along a canvas that persist over time, or a man can eat a burger and leave bite marks.

与世界互动。Sora有时可以模拟一些简单的动作来影响世界的状态。例如,画家可以在画布上留下随时间持续存在的新笔触,或者一个人可以吃一个汉堡并留下咬痕。

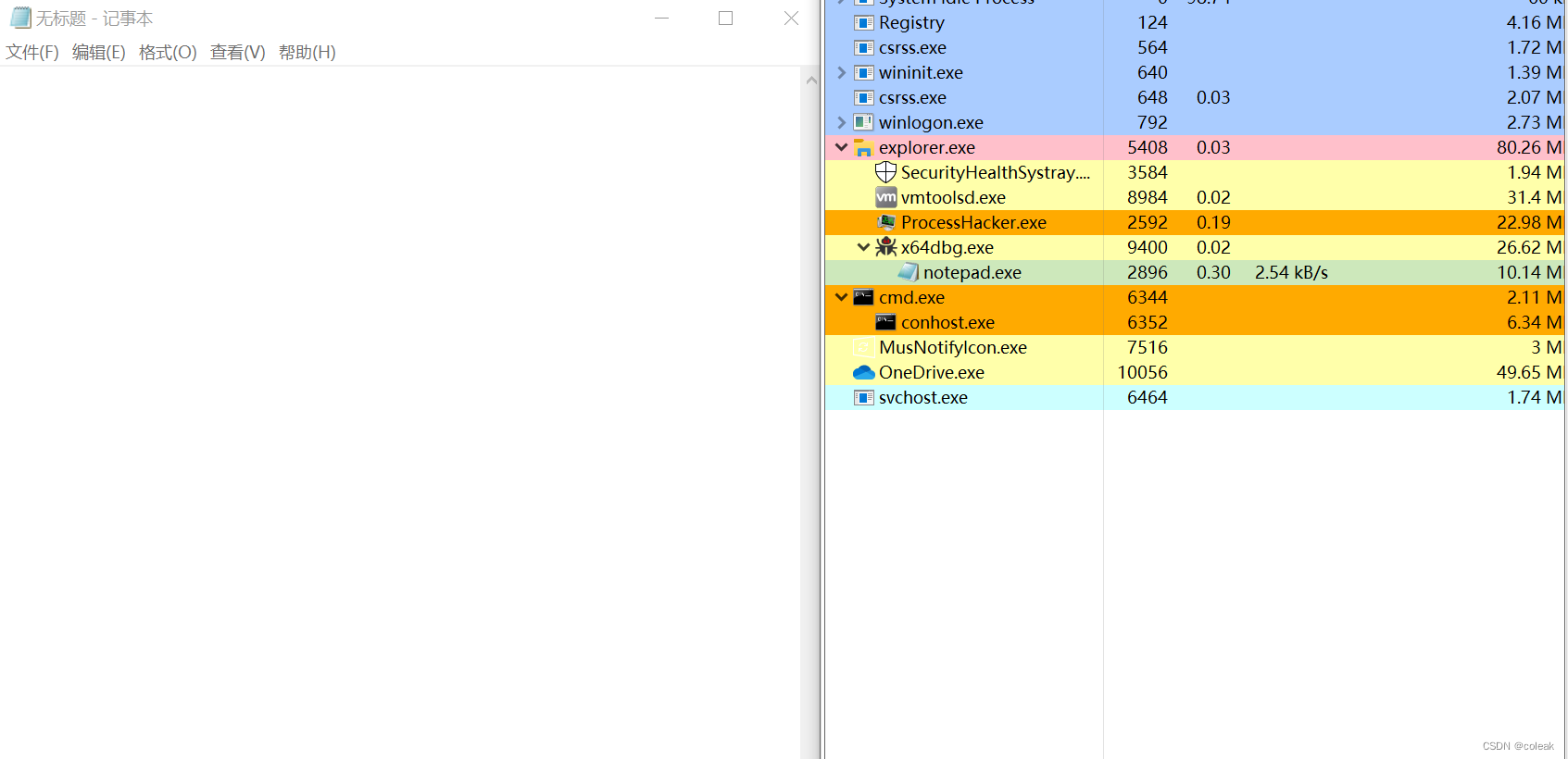

Simulating digital worlds. Sora is also able to simulate artificial processes–one example is video games. Sora can simultaneously control the player in Minecraft with a basic policy while also rendering the world and its dynamics in high fidelity. These capabilities can be elicited zero-shot by prompting Sora with captions mentioning “Minecraft.”

模拟数字世界。Sora也能够模拟人工过程——一个例子是视频游戏。Sora可以在同时控制《我的世界》中的玩家采用基本策略的同时,还能以高保真度渲染世界及其动态。通过用提到“我的世界”的字幕提示Sora,可以零次尝试地引发这些能力。

These capabilities suggest that continued scaling of video models is a promising path towards the development of highly-capable simulators of the physical and digital world, and the objects, animals and people that live within them.

这些能力表明,持续扩展视频模型是朝着开发高度能够模拟物理和数字世界及其内部的物体、动物和人类的有希望的道路。