Editing Large Language Models: Problems, Methods, and Opportunities

论文链接

代码链接

摘要

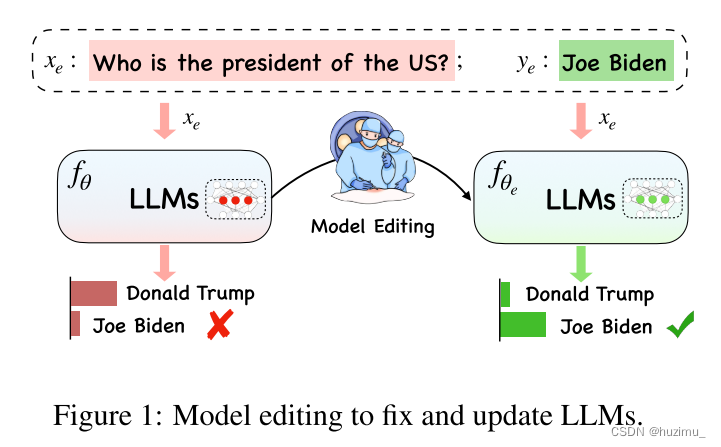

由于大语言模型(LLM)中可能存在一些过时的、不适当的和错误的信息,所以有必要纠正模型中的相关信息。如何高效地修改模型中的相关信息而不影响无关的信息,是模型编辑方法试图解决的问题。本篇文章对大语言模型上的模型编辑方法(model editing)进行了分类介绍和评估,并提出了一个新的基准,包括评估数据集和评估标准。

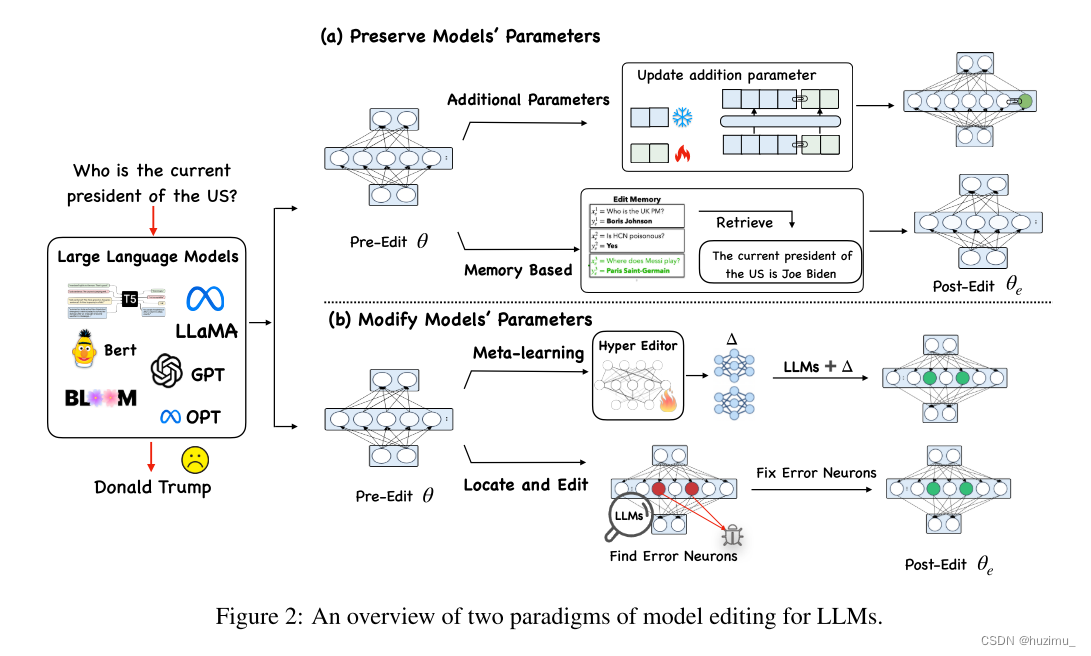

分类

LLM上的模型编辑方法主要包括两类:(a) 模型参数不变(Preserving LLMs’ Parameters);(b) 模型参数改变(Preserving LLMs’ Parameters)。模型参数不变的方法又可以分为额外参数 (Additional Parameters) 和基于记忆的 (Memory-based Model)方法。而模型参数改变的方法又可以分为定位然后编辑类(Locate-Then-Edit)和元学习类(Meta-learning)。

Methods for Preserving LLMs’ Parameters

Memory-based Model 该类方法又两类分支,一种是借助一个在新的事实上训练的模型辅助预测,另一种是借助检索到的知识作为提示词的一部分信息。

Additional Parameters 该类方法引入额外的可训练参数,这些参数根据新的事实数据集训练,而模型的原始参数不变。

Methods for Modifying LLMs’ Parameters

Locate-Then-Edit 该类方法首先定位到特定知识相关的参数,然后直接进行修改(无需额外的训练和微调)。

Meta-learning 该类方法应用一个超网络学习更新模型参数的变量。