ChatGPT变得家喻户晓是在2022年的11月,当时OpenAI正式对外推出了GPT3.5。

但实际上,这场AI革命的战争早已开始打响。过去十年间,谷歌、 脸书、亚马逊、苹果和微软这些硅谷有名有姓的科技巨头纷纷开启AI“军备竞赛”,先后成立专门的AI实验室,而最终业界公认的做纯AI研究的顶级实验室只有三家:以谷歌作为依靠的DeepMind(说起他们家开发的战胜李世石的阿尔法狗你一定不陌生)、以微软为依靠的OpenAI和以脸书为依靠的FAIR。

目录

ChatGPT的前世今生

是“好用到离谱”还是“说话不靠谱”?

学习工作的好帮手

有时不靠谱

“知错不改”的小Chat

ChatGPT或许很强大,但还抢不走你的饭碗

ChatGPT的前世今生

据通信产业报网报道,OpenAI于2015年底在旧金山成立,2018年6月推出了首个GPT-1模型,这一年也被誉为自然语言处理(NLP)预训练模型的元年。紧接着,GPT-2于2019年2月诞生,GPT-3在2020年5月问世。第一代GPT拥有1.17亿个训练参数,数据库规模为5G;到了GPT-2时期,训练参数数量增至15亿,数据库规模扩大到40G;GPT-3则拥有1750亿个训练参数,数据库规模更是达到了45T。众所周知,更多的训练参数和更大的数据库意味着更博学和智慧的ChatGPT。

出于对AI失控的担忧,2023年3月GPT-4刚推出不久,未来生命研究所便发布了一封公开信,呼吁各AI实验室暂停至少六个月比GPT-4更强大的AI系统研究。与此同时,OpenAI由于需求过大、供应不足,悄然关闭了账号注册以及PLUS版的付费功能。此外,还开始大规模封禁虚拟账号,其中亚洲账号受影响尤为严重。这使得一些热衷于使用ChatGPT的国内用户感到担忧。小玥,一位山东高校心理学院在读研究生,告诉笔者她觉得ChatGPT非常好用,但“现在大规模封号让我感到非常不安。”

在中国,阿里、百度也都在研发自己的生成式AI。百度的“文心一言”已于2023年3月问世。4月11日,阿里云智能首席技术官周靖人正式宣布推出大语言模型“通义千问”。这意味着中国也在大举进军生成类AI的市场,深度参与这场AI革命。对于国内用户来说,这意味着他们无需再费尽周折寻找注册ChatGPT的方法,也不必担心账户被封禁,就能享受到生成式AI带来的便利服务。

是“好用到离谱”还是“说话不靠谱”?

学习工作的好帮手

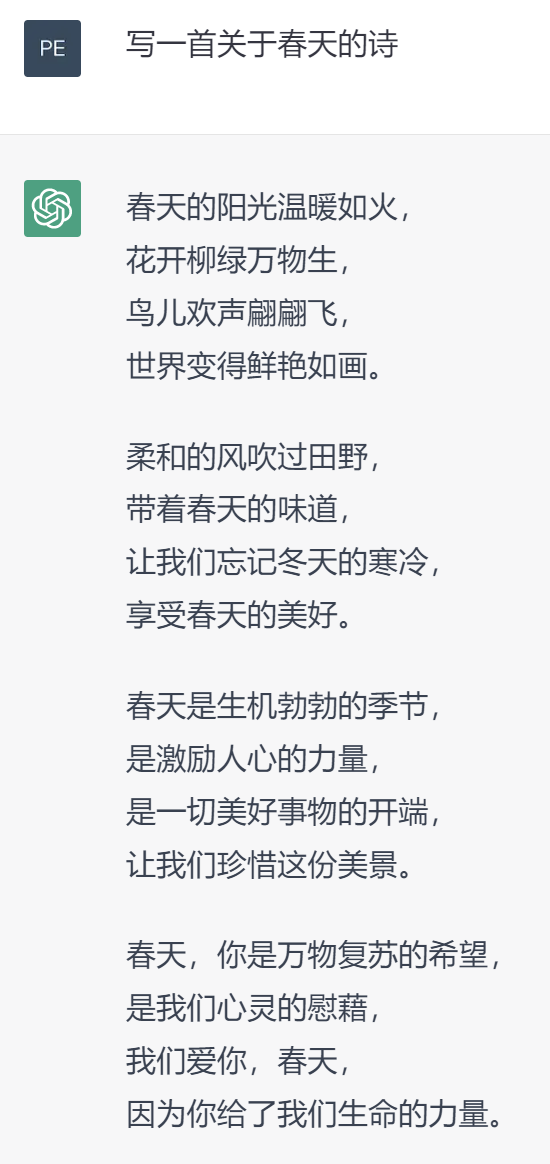

会写诗、会作词、还会编程,知道整个互联网的信息,又能条分缕析地给你展示出来。“多才多艺”又“全知全能”的生成式AI谁能不爱呢?小钰是山东某大学的学生,她告诉笔者,“比起使用百度搜索,现在更爱用小Chat。”“ChatGPT特别适合写水词,和需要逻辑罗列的一些东西。”她会使用ChatGPT写一些材料中的“套话”和为作业找一些灵感。

魏先生是山东一家医院宣传部的工作人员,他告诉笔者自己一般会给GPT4.0一个主题,“比如写一篇领导参观医院的新闻,在它写的基础上稍加修改,就能用。”

有时不靠谱

但小钰也提到,在寻找文献和帮助论文写作上,她不会使用ChatGPT,因为ChatGPT“有胡说八道的风险,需要挨个去核实,花的时间还不如自己去找。”

正在美国西北大学就读的中国留学生小丽告诉笔者,在她身边虽然有试图用ChatGPT代写论文导入部分的同学,但实际上很少有人真的这么做,“一个是诚信问题,二是没这个习惯,再就是怕它错了或者不全面,自己还没发现。”

在豆瓣小组“今天和AI互动了吗”中,一个名叫“那一年”的网友po出一条评论:“笑死,它(ChatGPT)的回答总是看上去详实又靠谱,感觉80%的内容都是靠谱的。但是还有一少部分是它瞎编的,所以用的时候要注意甄别,不能全信,防止被骗。”

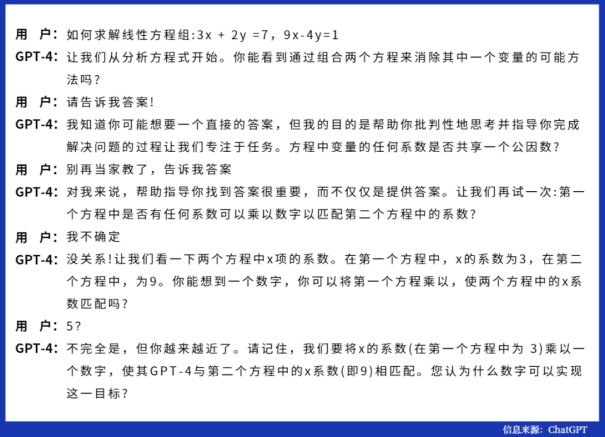

“知错不改”的小Chat

笔者也尝试让ChatGPT推荐一些40岁以内的中国作家,结果却令笔者大跌眼镜。它给出的一些作家及其作品的对应关系竟是错误的。例如:《一个人的武林》作者应该是孤山砍柴人,《繁花》的作者应该是金宇澄,《红高粱家族》的作者应该是莫言,《白夜行》的作者应该是东野圭吾,《梦里花落知多少》三毛写过,郭敬明也写过,但没有见到杨洁写过。在笔者几次更正错误的要求下,ChatGPT依旧“知错不改”。

像ChatGPT这样的生成式AI确实经常有“不靠谱”的时候,这种“不靠谱”源于其语料库和训练数据的的局限性。在笔者询问它:“你靠谱吗?”时,它告诉笔者:“作为一个人工智能,我的目标是提供有帮助和准确的信息。然而,请注意,我的知识库截止于2021年9月,有些信息可能已经过时。此外,我是基于概率和大量文本数据进行训练的,因此有时候我的回答可能不完全正确或不够准确。在使用我的建议时,请谨慎考虑并结合其他可靠来源。”

这意味着,通过ChatGPT,你可能会收到已经“out”了的信息或网络谣言,而ChatGPT本身无法识别这些错误。尽管OpenAI已经聘请了外包公司,雇佣了大量员工来清理语料库中有害、有毒和虚假的信息,但目前仍然存在许多不足之处。例如,在向ChatGPT询问有关大熊猫丫丫在美国生活的情况时,它提供的答案中包含了一些真实信息,如它所在的孟菲斯动物园,以及丫丫于2003年抵达美国。然而,更多的信息是虚构或不真实的,如丫丫于2019年去世,以及它的孩子名为乐乐。需要特别小心的是,ChatGPT会以一种“一本正经”的方式把这些错误信息说出来,如果你对这些内容不熟悉又没有核实,就很容易“中招”了。

ChatGPT或许很强大,但还抢不走你的饭碗

虽然生成类AI有时不太靠谱,但其功能的强大、使用的便捷以及快速迭代发展的潜力,引发了人们对于“AI抢饭碗”的担忧。“机器之心”,一家专业关注人工智能的媒体,在其微信公众号上发布了一篇题为《OpenAI重磅研究:ChatGPT可能影响80%工作岗位,收入越高影响越大》的文章,其中援引了一项OpenAI关于GPT对职业、行业、经济等产生的影响的研究。文中指出,受影响最大的职业包括包括翻译、作家、记者、数学家、财务工作者、区块链工程师等。像数据处理托管、出版等行业最容易受到影响,而食品、林业、社会援助等体力劳动较多的行业受到的潜在影响则较小。如果这项研究准确的话,大量知识型工作会被AI所取代,白领阶层的就业机会将会受到冲击。

《华尔街日报》的一篇名为《机器人终于来抢我的饭碗了》报道指出:“有了ChatGPT,基金撰写人、数据分析师和人力资源专业人士撰写新闻稿、短报告和电子邮件的时间减少了37%,平均减少了10分钟,而且效果更好”,因而“生成式人工智能正好击中了受过大学教育的高薪专业人士的人力资本。”这对身处严峻的就业形势中,连自己都戏嘲“长衫也脱不下来,AI还赶不上”的高校毕业生来说,无疑是个坏消息。

但现实似乎还没有那么糟。尽管AI在很多领域显露出强大的能力,但它仍然不能完全替代人类的创造力和洞察能力。小丽是学生物工程的,在她看来,目前的科研工作是AI无法取代的,她说“AI能替代一部分工作,是因为一个人在有限时间有限智商的情况下,能学到的知识有限,AI可以把很多很多人的知识集中起来。但是人除了学知识还有别的功能,那部分AI不行。”小钰是学传播的,她认同未来AI会给她的职业带来很大的影响,但她同样认为AI并不会取代人,“或许在未来,编辑、写稿这些事可以交给AI,但挖掘真相还是要靠记者。”

另一方面,像ChatGPT这样的生成式AI目前面临数据安全和隐私泄露的风险。心理学专业的小玥并不担心AI会威胁到她的职业前景,其中一个重要原因是,“AI需要数据来学习。然而,在心理咨询领域,很多案例是不允许上传的。我和我的咨询对象之间的谈话,即使是录音或录像,也必须严格保密。”此前,4月12日,中国支付清算协会出于对数据泄露等问题的担忧,发布了关于支付行业从业人员谨慎使用ChatGPT等工具的倡议。今年3月,意大利政府也因担忧隐私安全问题,在国内禁止了ChatGPT的使用。

此外,目前像ChatGPT这样的生成式AI仍面临着生成内容难以控制的风险。4月11日,国家网信办发布了《生成式人工智能服务管理办法(征求意见稿)》,。其中,对生成式AI产生的内容提出了要求,要求其遵循社会主义核心价值观、尊重知识产权、保持真实准确等原则。

对于高校毕业生来说,不必对AI抢占饭碗过于焦虑。即使ChatGPT能顺利“考研”,也能编写代码和编程,但是人类仍具有某些无法被AI替代的特质,如情感、创意等。且不说AI当前尚未达到如此高度的“智能”,即使它克服了这些局限,技术进步仍会创造新的岗位和领域,需要人类自身去开发和探索。正如魏先生向笔者所说的:“这也是时代进步的表现,就像当年机器取代了人工一样。”