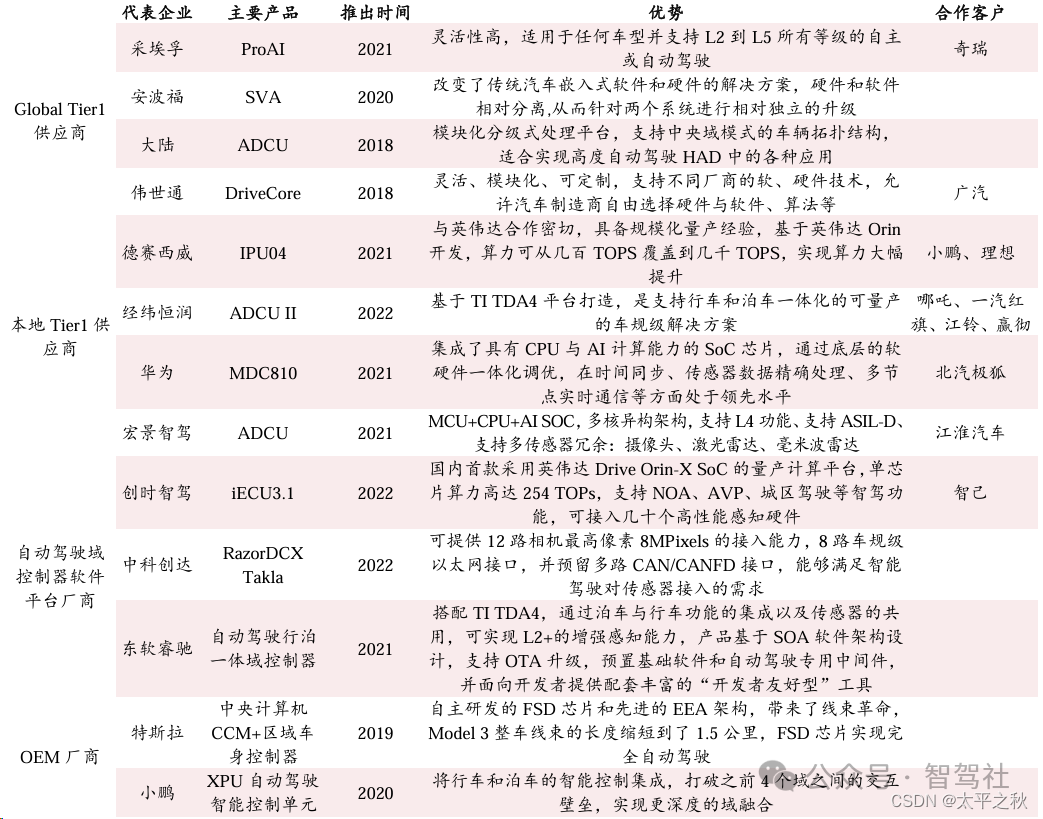

以下是八大常见的神经网络算法

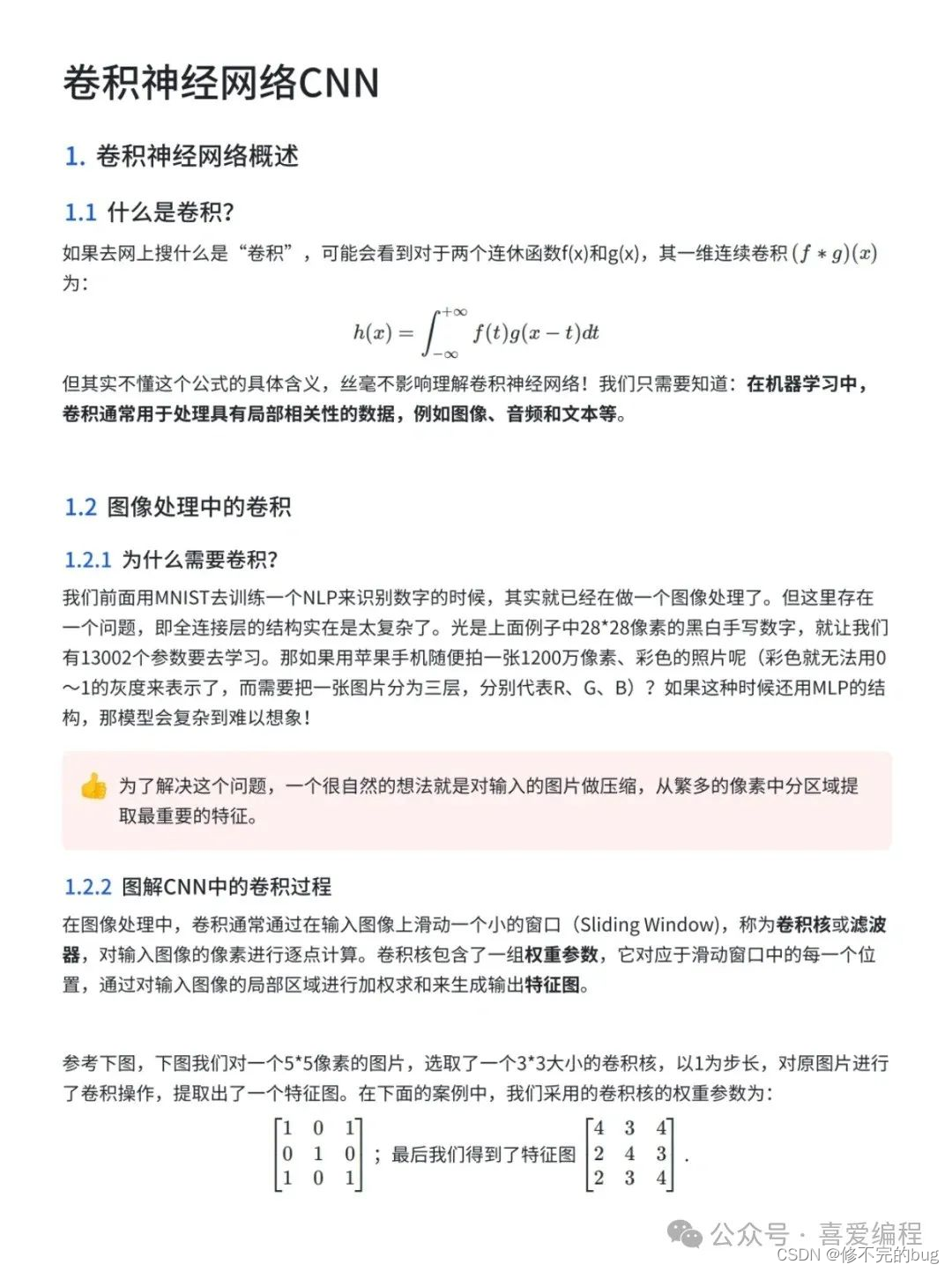

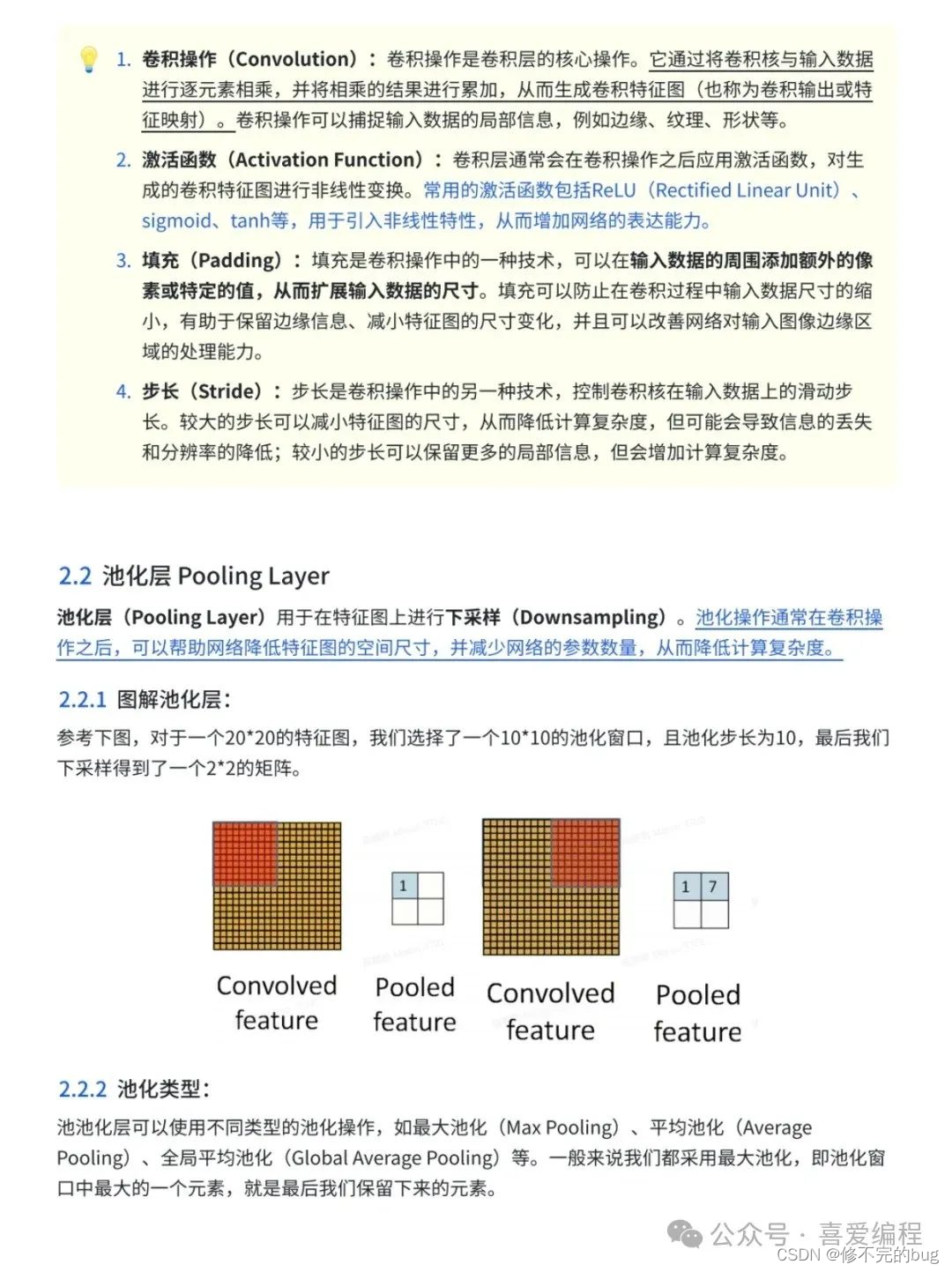

1️⃣卷积神经网络(CNN):

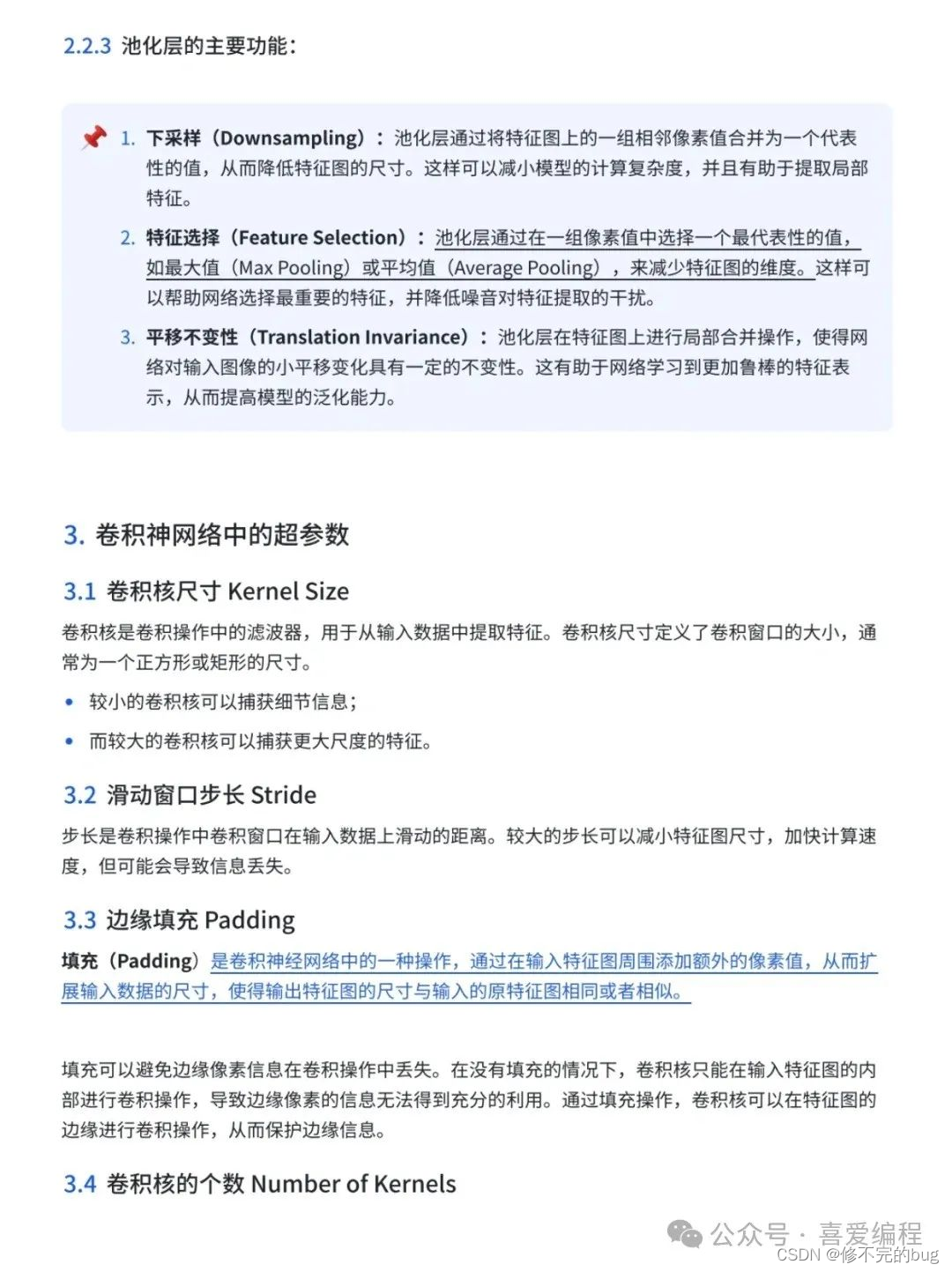

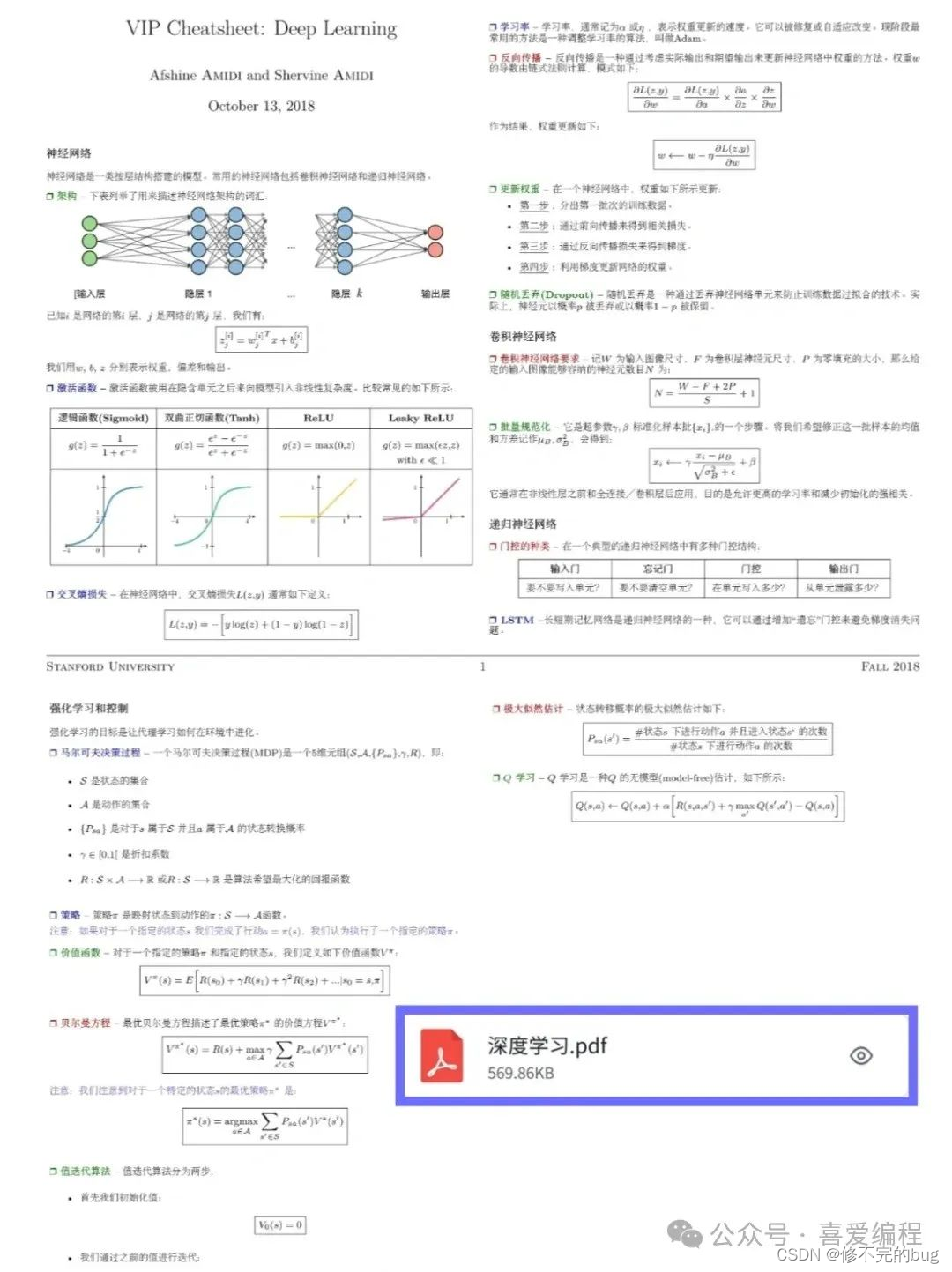

卷积神经网络(CNN)是一种深度学习模型,专门用于处理图像和音频等网格结构数据。它通过卷积操作提取特征,并通过池化操作降低数据维度。CNN在图像识别、物体检测等领域表现出色,因其局部感受野和参数共享的特点,能够有效提取数据的空间信息。

.

2️⃣循环神经网络(RNN):

循环神经网络适用于处理序列数据,如时间序列和文本。通过引入时间维度,RNN可以考虑数据的上下文信息。LSTM和GRU等变体解决了传统RNN的梯度问题,广泛应用于语言模型、文本生成等任务。

.

3️⃣生成对抗网络(GAN):

生成对抗网络由生成器和判别器组成,用于生成逼真的数据样本。生成器尝试生成与真实数据相似的样本,判别器努力区分真实和生成样本。GAN在图像生成、风格转换等领域创造了许多引人注目的成果。

.

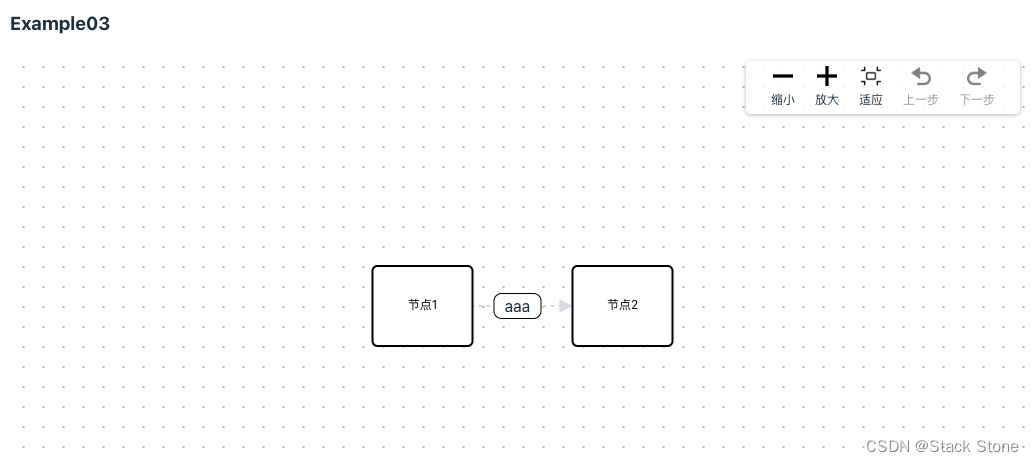

4️⃣图神经网络(GNN):

图神经网络(Graph Neural Networks,GNN)是一种用于处理图结构数据的深度学习模型。与传统的深度学习模型不同,GNN能够直接操作和学习图中节点和边的信息。它通过逐层更新节点的表示来传播和聚合信息,从而实现对整个图的信息处理和学习。

.

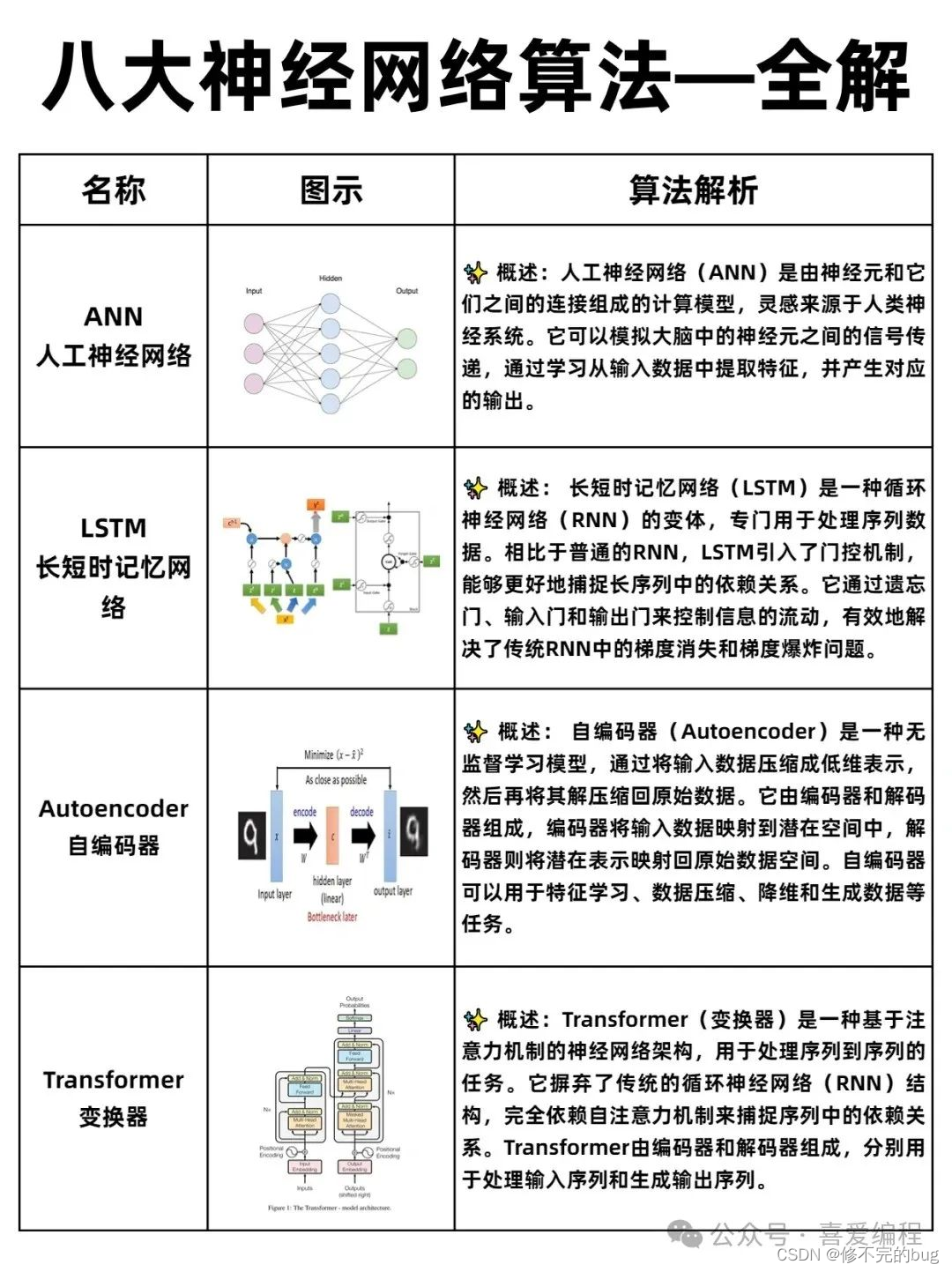

5️⃣长短时记忆网络(LSTM):

长短时记忆网络是一种循环神经网络的变体,专门用于解决长序列任务。通过门控机制,LSTM能够更好地捕获序列中的长期依赖关系,适用于语音识别、自然语言生成等任务。

.

6️⃣人工神经网络(ANN):

人工神经网络是一种模仿生物神经网络结构和功能的计算模型。它由大量的人工神经元组成,这些神经元通过连接权重相互连接。神经网络通过学习调整连接权重,从而实现对输入数据的表示和处理。

.

7️⃣自编码器(Autoencoder):

自编码器神经网络是一种无监督学习模型,用于学习数据的有效表示。它由编码器和解码器两部分组成,编码器将输入数据编码为低维度表示,解码器将该表示解码为原始数据。

.

8️⃣变换器(Transformer):

变换器是一种基于自注意力机制的神经网络,用于处理序列数据,如自然语言文本。它在NLP领域引起了革命,广泛用于翻译、生成、情感分析等任务。

完整PDF领取方法: