欢迎来到 Papicatch的博客

目录

🍉引言

🍈基本概念

🍈核心技术

🍈常用模型和方法

🍈应用领域

🍈挑战和未来发展

🍉案例分析

🍈机器翻译中的BERT模型

🍈情感分析在市场分析中的应用

🍈智能客服系统中的对话管理

🍉代码示例

🍈分词

🍈 词性标注

🍈命名实体识别

🍈文本生成

🍈情感分析

🍈机器翻译

🍉总结

🍉引言

自然语言处理(Natural Language Processing,NLP)是计算机科学和人工智能领域的一个重要分支,专注于计算机与人类语言的互动。它涉及使用计算机算法来处理和理解人类语言。以下是NLP的一些关键概念和应用。

🍈基本概念

- 语法和句法分析:分析句子的结构,包括词性标注(POS tagging)和依存句法分析(Dependency Parsing)。这些技术帮助理解句子的组成部分和它们之间的关系。

- 语义分析:理解句子的意义,包括词义消歧(Word Sense Disambiguation)和命名实体识别(Named Entity Recognition)。语义分析使计算机能够理解不同词汇在不同上下文中的含义。

- 文本生成:生成自然语言文本,如文本摘要、自动回复、对话系统等。这些应用使得机器可以生成符合语法和语义的自然语言文本。

- 情感分析:分析文本中的情感倾向,包括情感分类和情感强度分析。情感分析在市场分析和舆情监控中有重要应用。

🍈核心技术

- 分词:将文本分解为单独的词或词组,是中文处理中特别重要的一步。

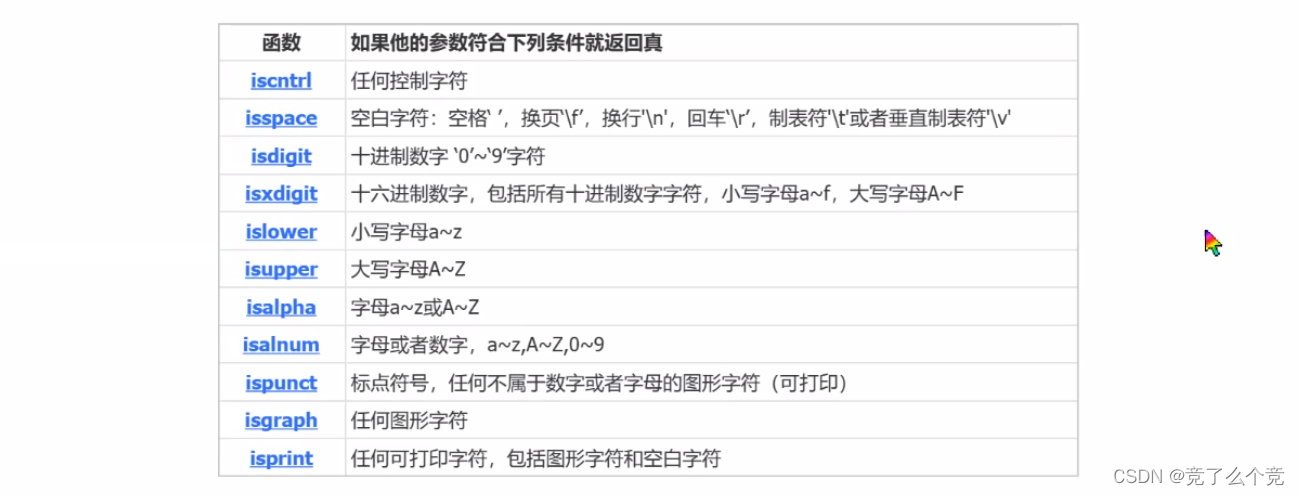

- 词性标注:为每个词分配一个词性标签(如名词、动词等),帮助理解词在句子中的功能。

- 命名实体识别:识别并分类文本中的实体,如人名、地名、组织名等。对于信息抽取和检索非常关键。

- 依存句法分析:分析句子中词与词之间的依存关系,有助于理解复杂句子的结构。

- 语义角色标注:识别句子中各个成分的语义角色,如施事、受事等,帮助深入理解句子含义。

🍈常用模型和方法

- 规则基础方法:基于语言学规则进行处理,但难以扩展和适应不同领域。

- 统计方法:利用大规模语料库和概率模型进行处理,如n-gram模型。

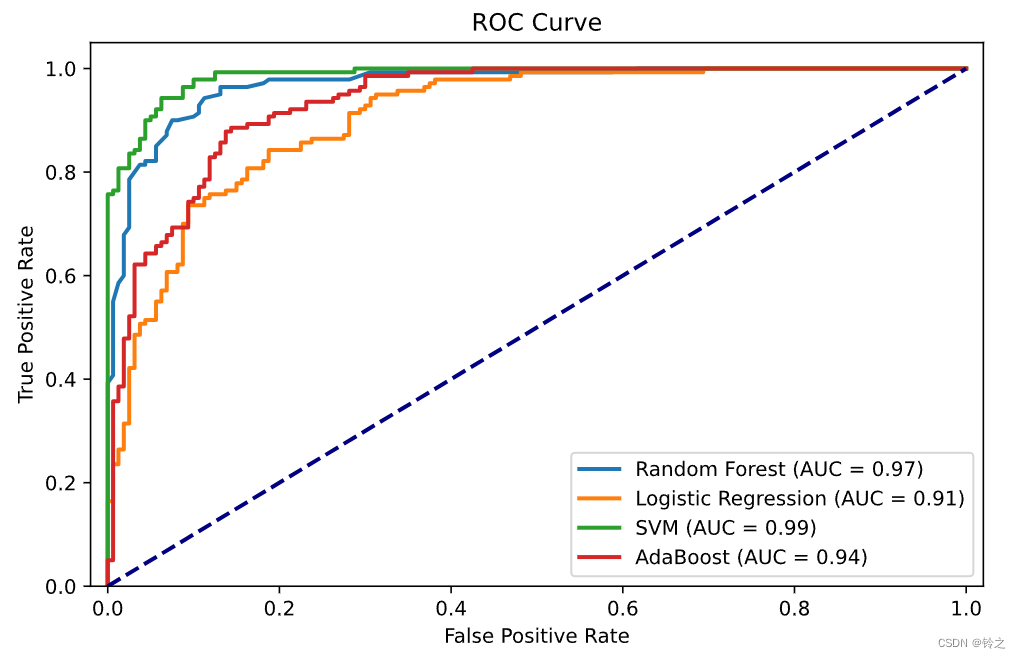

- 机器学习:包括支持向量机、决策树等传统机器学习算法,用于分类和预测。

- 深度学习:尤其是基于神经网络的方法,如循环神经网络(RNN)、长短期记忆网络(LSTM)、Transformer等。深度学习模型能够处理大规模数据并从中学习复杂的模式。

- 预训练模型:如BERT、GPT等,通过在大规模语料库上进行预训练,再进行特定任务的微调,这些模型显著提高了NLP任务的性能。

🍈应用领域

- 机器翻译:如Google翻译,通过自动翻译不同语言之间的文本,使得跨语言交流更加便捷。

- 信息检索:如搜索引擎,通过关键词匹配和自然语言理解提高搜索结果的相关性。

- 文本分类:如垃圾邮件过滤、新闻分类等,帮助自动化处理大量文本数据。

- 对话系统:如智能客服、虚拟助手(如Siri、Alexa等),实现人与机器的自然对话。

- 文本生成:如新闻自动生成、内容创作辅助等,提升内容生成的效率和质量。

- 情感分析:用于市场分析、舆情监控等,帮助理解公众对某些事件或产品的态度。

🍈挑战和未来发展

- 多语言处理:处理不同语言的多样性和复杂性,提高跨语言模型的性能。

- 上下文理解:提高模型对上下文的理解和推理能力,尤其是长文本和复杂句子中的上下文关系。

- 模型解释性:增强模型的可解释性和透明性,使得用户和开发者能够理解模型的决策过程。

- 数据隐私:保护用户数据隐私和安全,尤其在处理敏感信息时。

🍉案例分析

🍈机器翻译中的BERT模型

BERT(Bidirectional Encoder Representations from Transformers)是一种深度学习模型,通过双向编码器表示从大量文本数据中学习语言模式。它在翻译任务中显著提升了翻译的准确性和流畅度。例如,在中英翻译中,BERT模型能够更好地理解和翻译复杂句子结构,提高了翻译质量。

from transformers import MarianMTModel, MarianTokenizer# 加载预训练的MarianMT模型和tokenizer

model_name = 'Helsinki-NLP/opus-mt-en-zh'

tokenizer = MarianTokenizer.from_pretrained(model_name)

model = MarianMTModel.from_pretrained(model_name)# 翻译文本

text = "Natural Language Processing is an important field in AI."

translated = model.generate(**tokenizer.prepare_seq2seq_batch([text], return_tensors="pt"))

translated_text = [tokenizer.decode(t, skip_special_tokens=True) for t in translated]

print(translated_text)

🍈情感分析在市场分析中的应用

某电商平台使用情感分析技术来监控用户对新产品的反馈。通过分析用户评论,平台能够快速了解产品的优缺点,并进行相应的改进。这种实时的情感分析帮助企业及时响应市场变化,优化产品和服务。以下是一个简单的情感分析示例:

from transformers import pipeline# 加载预训练的情感分析模型

sentiment_analyzer = pipeline('sentiment-analysis')# 示例用户评论

reviews = ["This new product is fantastic! It exceeded my expectations.","I am not satisfied with the quality of this item.","Great value for money. I will definitely recommend it to others.",

]# 分析情感

results = sentiment_analyzer(reviews)

for review, result in zip(reviews, results):print(f"Review: {review}\nSentiment: {result['label']}, Confidence: {result['score']}\n")

🍈智能客服系统中的对话管理

某银行引入了基于NLP的智能客服系统,使用LSTM和Transformer模型处理客户的自然语言查询。智能客服能够理解客户问题并提供准确的回答,大大提升了客户服务效率和满意度。此外,通过对对话数据的分析,银行还能够不断改进和优化客服系统。以下是一个简单的对话系统示例:

from transformers import AutoModelForCausalLM, AutoTokenizer# 加载预训练的DialoGPT模型和tokenizer

model_name = "microsoft/DialoGPT-medium"

tokenizer = AutoTokenizer.from_pretrained(model_name)

model = AutoModelForCausalLM.from_pretrained(model_name)# 初始化对话历史

chat_history_ids = Nonedef chat_with_bot(user_input):global chat_history_idsnew_user_input_ids = tokenizer.encode(user_input + tokenizer.eos_token, return_tensors='pt')# 将新用户输入添加到对话历史中bot_input_ids = torch.cat([chat_history_ids, new_user_input_ids], dim=-1) if chat_history_ids is not None else new_user_input_ids# 生成响应chat_history_ids = model.generate(bot_input_ids, max_length=1000, pad_token_id=tokenizer.eos_token_id)# 解码并打印响应response = tokenizer.decode(chat_history_ids[:, bot_input_ids.shape[-1]:][0], skip_special_tokens=True)return response# 与客服系统进行对话

user_input = "I have an issue with my account balance."

response = chat_with_bot(user_input)

print(f"Bot: {response}")user_input = "What is the current interest rate for savings account?"

response = chat_with_bot(user_input)

print(f"Bot: {response}")

🍉代码示例

🍈分词

分词是将文本分解为单独的词或词组。在中文处理中尤其重要,因为中文没有明显的词界定符。

import jieba# 示例文本

text = "自然语言处理是人工智能领域的一个重要分支。"# 使用jieba进行中文分词

words = jieba.lcut(text)

print(words)

🍈 词性标注

词性标注是为每个词分配一个词性标签,帮助理解词在句子中的功能。

import nltk

from nltk import pos_tag, word_tokenize# 下载需要的数据

nltk.download('punkt')

nltk.download('averaged_perceptron_tagger')# 示例文本

text = "Natural Language Processing is an important field in AI."# 分词

words = word_tokenize(text)# 词性标注

tagged_words = pos_tag(words)

print(tagged_words)

🍈命名实体识别

命名实体识别(NER)用于识别并分类文本中的实体,如人名、地名、组织名等。

import spacy# 加载预训练的spaCy模型

nlp = spacy.load("en_core_web_sm")# 示例文本

text = "Apple is looking at buying U.K. startup for $1 billion."# 处理文本

doc = nlp(text)# 提取命名实体

for ent in doc.ents:print(ent.text, ent.label_)

🍈文本生成

使用预训练模型生成自然语言文本。以下示例使用Transformers库和GPT模型生成文本。

from transformers import pipeline# 加载预训练的文本生成模型

generator = pipeline('text-generation', model='gpt2')# 示例文本

text = "Natural Language Processing is"# 生成文本

generated_text = generator(text, max_length=50, num_return_sequences=1)

print(generated_text)

🍈情感分析

情感分析用于分析文本中的情感倾向,以下示例使用Transformers库的情感分析模型。

from transformers import pipeline# 加载预训练的情感分析模型

sentiment_analyzer = pipeline('sentiment-analysis')# 示例文本

text = "I love using natural language processing for text analysis!"# 情感分析

result = sentiment_analyzer(text)

print(result)

🍈机器翻译

使用预训练模型进行机器翻译。以下示例将英文文本翻译成法文。

from transformers import pipeline# 加载预训练的翻译模型

translator = pipeline('translation_en_to_fr')# 示例文本

text = "Natural Language Processing is a fascinating field."# 翻译文本

translated_text = translator(text)

print(translated_text)

🍉总结

NLP是一个跨学科领域,结合了计算机科学、语言学、数学和认知科学的知识,随着深度学习和大数据技术的发展,NLP的应用越来越广泛和深入。未来,随着技术的不断进步,NLP将在更多领域展现其潜力,推动人机交互的进一步发展。