目录

引言

智能优化算法概述

智能优化算法在KNN特征选择中的应用

应用步骤

UCI数据集

鲸鱼优化算法

一、算法背景与原理

二、算法组成与步骤

三、算法特点与优势

四、应用与挑战

代码实现

鲸鱼优化算法

主程序

打印结果

引言

智能优化算法在优化KNN(K近邻算法)特征选择中的应用,主要是通过模拟自然界中群体行为或生物进化过程来搜索最优的特征子集,以提高KNN模型的分类或回归性能。以下是一些常用的智能优化算法及其在KNN特征选择中的应用概述:

智能优化算法概述

智能优化算法主要包括演化算法和群体智能算法两大类。演化算法如遗传算法(GA)通过模拟生物进化过程中的选择、交叉和变异等操作来寻找最优解。群体智能算法则通过观察社会生物群体的行为,如蚁群算法(ACO)、粒子群优化算法(PSO)等,来搜索最优解。

智能优化算法在KNN特征选择中的应用

- 遗传算法(GA)

- 原理:遗传算法基于Darwin进化论和Mendel的遗传学说,通过模拟自然选择和遗传机制来搜索最优解。

- 应用:在KNN特征选择中,遗传算法可以将每个特征的选择与否编码为染色体上的基因,通过选择、交叉和变异等操作来迭代优化特征子集,最终找到适应度最高的特征组合。

- 粒子群优化算法(PSO)

- 原理:粒子群优化算法模拟鸟群觅食行为,通过粒子之间的合作与竞争来寻找最优解。每个粒子代表一个解(在这里是特征子集),粒子根据个体最优和全局最优位置更新自己的位置和速度。

- 应用:在KNN特征选择中,粒子群算法可以通过将特征子集编码为粒子的位置,并通过迭代优化找到适应度最高的特征子集。二进制粒子群算法(BPSO)特别适用于处理离散优化问题,如特征选择。

- 蚁群算法(ACO)

- 原理:蚁群算法模拟蚂蚁觅食过程中信息素的积累和跟随行为,通过候选解之间的信息交流来搜索最优解。

- 应用:在KNN特征选择中,蚁群算法可以将每个特征的选择与否视为蚂蚁的路径选择,通过信息素的积累和更新来指导搜索过程,最终找到最优的特征子集。

- 灰狼优化算法(GWO)

- 原理:灰狼优化算法模拟灰狼的社会层次和狩猎策略,通过Alpha、Beta、Delta和Omega四个等级的灰狼之间的协作来搜索最优解。

- 应用:在KNN特征选择中,灰狼优化算法可以将特征子集视为猎物,通过模拟灰狼的狩猎行为来迭代优化特征子集,最终找到最优的特征组合。

应用步骤

-

问题定义:明确KNN模型需要优化的目标(如分类准确率、回归误差等)和特征选择的范围。

-

算法选择:根据问题的特性和需求选择合适的智能优化算法。

-

编码与初始化:将特征选择问题编码为算法可处理的格式(如染色体、粒子位置等),并初始化算法参数和种群。

-

适应度评估:定义适应度函数来评估每个特征子集的优劣,通常使用KNN模型在验证集上的性能作为评估标准。

-

迭代优化:根据算法规则进行迭代优化,更新特征子集和算法参数,直到满足停止条件(如达到最大迭代次数、适应度不再显著提升等)。

-

结果分析:分析最终得到的特征子集对KNN模型性能的影响,并与其他特征选择方法进行比较。

UCI数据集

Breast Cancer Wisconsin (Diagnostic) 数据集是一个经典的医学数据集,最初由威斯康星州医院的Dr. William H. Wolberg收集。该数据集包含了乳腺癌患者的诊断结果和相关生理参数的统计信息,如肿块的大小、形状、边缘、质地、细胞核大小、细胞核形状等。这些特征是通过图像分析得到的,并用于预测乳腺癌的恶性程度和诊断结果。

鲸鱼优化算法

鲸鱼优化算法(Whale Optimization Algorithm,简称WOA)是一种由澳大利亚格里菲斯大学的Mirjalili等人于2016年提出的新型群体智能优化搜索方法。该算法模拟了自然界中座头鲸群体的狩猎行为,通过模拟鲸鱼群的自组织和自适应性来寻找最优解。以下是对鲸鱼优化算法的详细介绍:

一、算法背景与原理

背景:

鲸鱼在海洋中的行为特点包括分布式、自主、智能和适应性强等特点,这些特点使得鲸鱼在寻找食物和逃脱敌人方面具有很高的效率。鲸鱼优化算法旨在将这些优点应用于解决复杂的优化问题,如机器学习、数据挖掘、计算机视觉等领域。

原理:

WOA算法模拟了座头鲸的狩猎行为,主要包括包围猎物、螺旋攻击猎物(发泡网攻击)和随机搜索猎物三个主要动作。算法将当前最优候选解作为目标猎物(最优解),鲸鱼群根据当前自身与猎物位置的关系更新位置,通过搜索、包围和捕食行为来更新候选解,逐步逼近最优解。

二、算法组成与步骤

算法组成:

WOA算法的主要组成部分包括鲸鱼群的表示、鲸鱼的行为和互动以及适应性评价。鲸鱼群可以用一组向量来表示,每个向量代表一个鲸鱼的位置和速度。鲸鱼在寻找食物和避免敌人时会进行探索和互动行为,这些行为会影响鲸鱼群的动态过程。而鲸鱼群的适应性则通过评价函数来衡量,目标是找到使评价函数值最小的解。

算法步骤:

- 初始化鲸鱼群:随机生成一组鲸鱼的位置和速度作为算法的初始状态。

- 计算适应度:根据评价函数计算鲸鱼群的适应性评价值。

- 更新鲸鱼位置:

- 包围猎物:鲸鱼群会向当前最优解(猎物)靠拢。

- 螺旋攻击猎物:模拟座头鲸的螺旋吐泡泡行为,通过螺旋方程更新鲸鱼位置。

- 随机搜索猎物:当随机数满足一定条件时,鲸鱼会进行随机搜索,以跳出局部最优解。

- 迭代更新:重复上述步骤,每次迭代都更新鲸鱼的位置,直到满足停止条件(如达到最大迭代次数或解的质量满足要求)。

三、算法特点与优势

特点:

- 收敛速度快:WOA算法在求解优化问题时表现出较快的收敛速度。

- 全局搜索能力强:通过随机搜索和螺旋攻击等机制,WOA算法能够有效避免陷入局部最优解。

- 算法简单易实现:WOA算法的原理和步骤相对简单,易于编程实现。

优势:

- WOA算法在解决复杂的优化问题时具有较高的效率和适应性。

- 它已经被成功应用于多个领域,如机器学习、数据挖掘、计算机视觉等。

四、应用与挑战

应用:

鲸鱼优化算法在多个领域都有广泛的应用,包括但不限于:

- 机器学习模型的参数优化

- 数据挖掘中的聚类分析

- 计算机视觉中的图像分割和识别

挑战:

尽管WOA算法具有诸多优势,但在实际应用中也面临一些挑战:

- 参数设置敏感:算法的性能受参数设置影响较大,需要根据具体问题进行调整和优化。

- 对初始解的依赖:算法的性能可能受到初始解质量的影响。

- 高维问题处理:在处理高维优化问题时,算法的性能可能会下降。

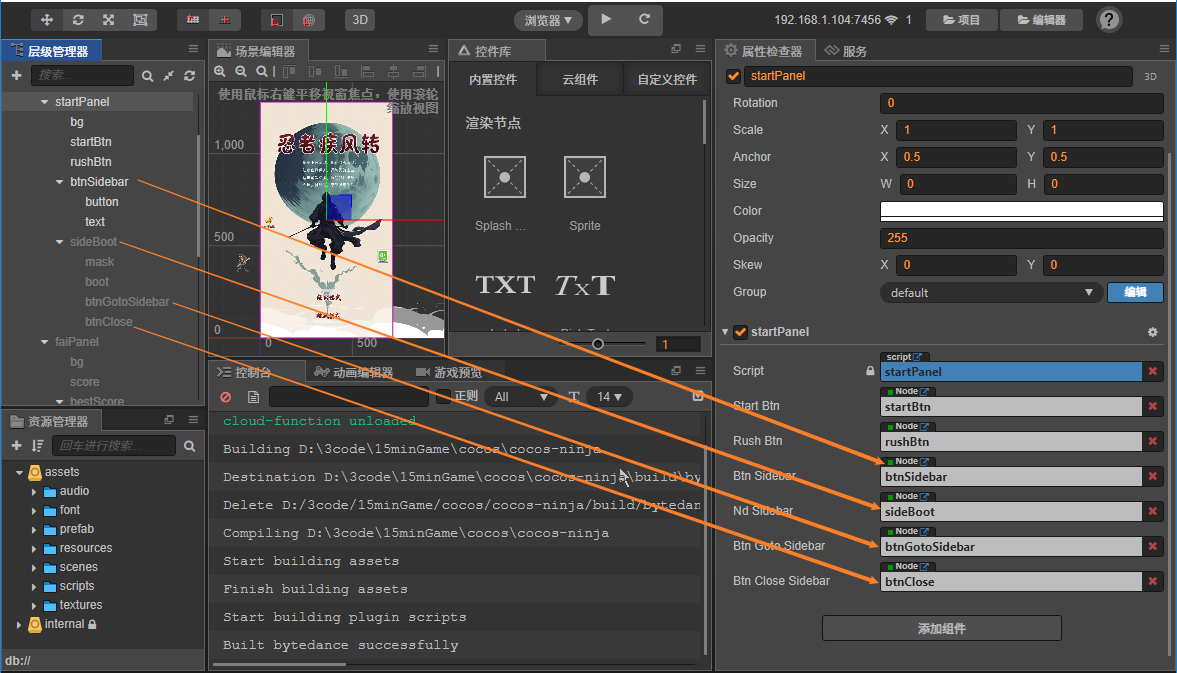

代码实现

鲸鱼优化算法

% The Whale Optimization Algorithm

function [Leader_score,Leader_pos,Convergence_curve]=WOA(SearchAgents_no,Max_iter,lb,ub,dim,trainData,testData,trainlabel,testlabel)% initialize position vector and score for the leader

Leader_pos=zeros(1,dim);

Leader_score=inf; %change this to -inf for maximization problems%Initialize the positions of search agents

Positions=round(initialization(SearchAgents_no,dim,ub,lb));Convergence_curve=zeros(1,Max_iter);t=0;% Loop counter% Main loop

while t<Max_iterfor i=1:size(Positions,1) % Return back the search agents that go beyond the boundaries of the search spaceFlag4ub=Positions(i,:)>ub;Flag4lb=Positions(i,:)<lb;Positions(i,:)=(Positions(i,:).*(~(Flag4ub+Flag4lb)))+ub.*Flag4ub+lb.*Flag4lb;% Calculate objective function for each search agentPositions(i,:) = checkempty(Positions(i,:),dim);fitness=objfun((Positions(i,:)),trainData,testData,trainlabel,testlabel,dim);% Update the leaderif fitness<Leader_score % Change this to > for maximization problemLeader_score=fitness; % Update alphaLeader_pos=Positions(i,:);endenda=2-t*((2)/Max_iter); % a decreases linearly fron 2 to 0 in Eq. (2.3)% a2 linearly dicreases from -1 to -2 to calculate t in Eq. (3.12)a2=-1+t*((-1)/Max_iter);% Update the Position of search agents for i=1:size(Positions,1)r1=rand(); % r1 is a random number in [0,1]r2=rand(); % r2 is a random number in [0,1]A=2*a*r1-a; % Eq. (2.3) in the paperC=2*r2; % Eq. (2.4) in the paperb=1; % parameters in Eq. (2.5)l=(a2-1)*rand+1; % parameters in Eq. (2.5)p = rand(); % p in Eq. (2.6)for j=1:size(Positions,2)if p<0.5 if abs(A)>=1rand_leader_index = floor(SearchAgents_no*rand()+1);X_rand = Positions(rand_leader_index, :);D_X_rand=abs(C*X_rand(j)-Positions(i,j)); % Eq. (2.7)Positions(i,j)=X_rand(j)-A*D_X_rand; % Eq. (2.8)elseif abs(A)<1D_Leader=abs(C*Leader_pos(j)-Positions(i,j)); % Eq. (2.1)Positions(i,j)=Leader_pos(j)-A*D_Leader; % Eq. (2.2)endelseif p>=0.5distance2Leader=abs(Leader_pos(j)-Positions(i,j));% Eq. (2.5)Positions(i,j)=distance2Leader*exp(b.*l).*cos(l.*2*pi)+Leader_pos(j);endendendt=t+1;Convergence_curve(t)=Leader_score;[t Leader_score]

end主程序

clc;

clear;%导入并划分数据集

load breast-cancer-wisconsinfor ii=1:size(data,2)nanindex=isnan(data(:,ii));data(nanindex,:)=[];

end

labels=data(:,end);

attributesData=data(:,1:end-1); [rows,colms]=size(attributesData); %数据集大小 [trainIdx,~,testIdx]=dividerand(rows,0.8,0,0.2);

trainData=attributesData(trainIdx,:); %训练集

testData=attributesData(testIdx,:); %测试集

trainlabel=labels(trainIdx,:); %训练集标签

testlabel=labels(testIdx,:); %测试集标签%调用fitcknn工具箱,进行KNN初始化聚类,得到聚类精度

Mdl = fitcknn(trainData,trainlabel,'NumNeighbors',5,'Standardize',1);

predictedLables_KNN=predict(Mdl,testData);

cp=classperf(testlabel,predictedLables_KNN);

err=cp.ErrorRate;

accuracy=cp.CorrectRate;%定义WOA优化目标函数,以KNN聚类精度为目标

dim=size(attributesData,2);

lb=0;ub=1;

SearchAgents_no=30; % 种群大小

Max_iteration=200; %最大迭代次数[Target_score,Target_pos,WOA_cg_curve]=WOA(SearchAgents_no,Max_iteration,lb,ub,dim,trainData,testData,trainlabel,testlabel);[error_WOA,accuracy_WOA,predictedLables_WOA]=finalEval(Target_pos,trainData,testData,trainlabel,testlabel); % 打印最优特征选择

fprintf('最优特征选择:\n');

for i = 1:length(Target_pos)if Target_pos(i) == 1fprintf('Feature %d\n', i);end

end打印结果